Heim >Technologie-Peripheriegeräte >KI >Runway und Luma kämpfen wieder! Yann LeCun bombardiert: Egal wie gut du bist, du bist kein „Weltmodel'

Runway und Luma kämpfen wieder! Yann LeCun bombardiert: Egal wie gut du bist, du bist kein „Weltmodel'

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOriginal

- 2024-07-03 09:13:061110Durchsuche

Machine Power Report

Herausgeber: Yang Wen

Die Welle der künstlichen Intelligenz, dargestellt durch große Modelle und AIGC, hat im Stillen die Art und Weise verändert, wie wir leben und arbeiten, aber die meisten Menschen Ich weiß immer noch nicht, wie man es benutzt.

Deshalb haben wir die Rubrik „KI im Einsatz“ ins Leben gerufen, um den Einsatz von KI anhand intuitiver, interessanter und prägnanter Anwendungsfälle für künstliche Intelligenz detailliert vorzustellen und alle zum Nachdenken anzuregen.

Wir heißen Leser auch willkommen, innovative Anwendungsfälle einzureichen, die sie persönlich praktiziert haben.

Die KI-Videoindustrie „kämpft“ wieder!

Am 29. Juni gab die bekannte generative KI-Plattform Runway bekannt, dass ihr neuestes Modell Gen-3 Alpha mit dem Testen für einige Benutzer begonnen hat.

Am selben Tag startete Luma eine neue Keyframe-Funktion und steht allen Nutzern kostenlos zur Verfügung.

Man kann sagen: „Du hast einen guten Plan, ich habe eine Leiter“, die beiden streiten endlos.

Das hat die Internetnutzer extrem glücklich gemacht: „Juni, was für ein wunderbarer Monat!“

„Verrückter Mai, verrückter Juni, so verrückt, dass ich nicht aufhören kann!“

-1-

Runway tötet Hollywood

Vor zwei Wochen, als der AI-Video-„King“ Runway ein neues Videogenerationsmodell Gen-3 Alpha auf den Markt brachte, wurde es zuerst Vorschau –

„innerhalb weniger Tage“ für zahlende Nutzer verfügbar sein, und irgendwann in der Zukunft wird auch die kostenlose Version für alle Nutzer zugänglich sein.

Am 29. Juni erfüllte Runway sein Versprechen und kündigte an, dass sein neuestes Gen-3 Alpha einigen Benutzern zum Testen zur Verfügung stehen würde.

Gen-3 Alpha ist sehr gefragt, da es im Vergleich zur vorherigen Generation erhebliche Verbesserungen in Bezug auf Licht und Schatten, Qualität, Komposition, textsemantische Wiederherstellung, physikalische Simulation und Handlungskonsistenz erzielt hat. Sogar der Slogan lautet „Für.“ Künstler, von Künstlern (geboren für Künstler, geboren von Künstlern)“.

Was bewirkt Gen-3 Alpha? Internetnutzer, die sich mit Blumenarrangements befassen, hatten schon immer das meiste Mitspracherecht. Als nächstes genießen Sie bitte -

Filmaufnahmen eines schrecklichen Monsters, das aus der Themse in London aufsteigt:

Ein trauriger Teddybär weint, weint, bis er traurig ist, und putzt sich mit einem Taschentuch die Nase:

Ein britisches Mädchen in einem wunderschönen Kleid läuft auf der Straße, auf der das Schloss steht, mit schnell fahrenden Fahrzeugen und langsamen Pferden an ihrer Seite:

Eine riesige Eidechse, besetzt mit wunderschönem Schmuck und Perlen, spaziert durch dichte Vegetation. Die Eidechsen funkeln im Licht und die Aufnahmen sind so realistisch wie eine Dokumentation.

Es gibt auch eine mit Diamanten besetzte Kröte, die mit Rubinen und Saphiren bedeckt ist:

In den Straßen der Stadt erzeugt der Regen nachts die Reflexion von Neonlichtern.

Die Kamera beginnt mit dem in der Pfütze reflektierten Licht, steigt langsam an, um die leuchtende Neon-Werbetafel zu zeigen, und zoomt dann weiter zurück, um die gesamte vom Regen durchnässte Straße zu zeigen.

Die Bewegung der Kamera: Zuerst auf das Spiegelbild in der Pfütze zielen, sie dann in einem Zug anheben und wieder zurückziehen, um die Stadtlandschaft in dieser regnerischen Nacht zu zeigen.

Videolink: https://www.php.cn/link/dbf138511ed1d9278bde43cc0000e49a

Der gelbe Schimmel, der in der Petrischale wächst, zeigt unter dem gedämpften und geheimnisvollen Licht eine kühle Farbe und voller Dynamik.

Im Herbstwald ist der Boden mit verschiedenen orangefarbenen, gelben und roten Laubblättern bedeckt.

Eine sanfte Brise wehte vorbei und die Kamera bewegte sich nahe am Boden. Ein Wirbelsturm begann sich zu bilden, der die abgefallenen Blätter aufhob und eine Spirale bildete. Die Kamera erhebt sich mit den abgefallenen Blättern und kreist um die rotierende Blättersäule.

Videolink: https://www.php.cn/link/dbf138511ed1d9278bde43cc0000e49a

Aus der niedrigen Perspektive eines mit Graffiti bedeckten Tunnels bewegt sich die Kamera stetig entlang der Straße durch eine kurze, dunkle Während wir den Tunnelabschnitt entlang fahren, fährt die Kamera schnell nach oben, als sie auf der anderen Seite erscheint und ein großes Feld mit bunten Wildblumen, umgeben von schneebedeckten Bergen, zeigt.

Videolink: https://www.php.cn/link/dbf138511ed1d9278bde43cc0000e49a

Eine Nahaufnahme vom Klavierspielen, die Finger springen auf den Tasten, keine Handverzerrung, sanfte Bewegungen, das Einzige Manko ist, es gibt keinen Ring am Ringfinger, sondern der Schatten „kommt aus dem Nichts“.

Netizens brachten auch Runway-Mitbegründer Cristóbal Valenzuela heraus, der ein Video für seine selbstgebaute Bienenkamera erstellte.

Setzen Sie die Kamera auf den Rücken der Biene und die aufgenommene Szene sieht so aus:

Videolink: https://www.php.cn/link/dbf138511ed1d9278bde43cc0000e49a

Setzen Sie sie auf Gesicht der Biene Es ist lila:

Videolink: https://www.php.cn/link/dbf138511ed1d9278bde43cc0000e49a

Also, wie sieht diese Taschenkamera aus?

Wenn sich die KI so weiter entwickelt, werden Hollywood-Schauspieler erneut streiken.

-2-

Lumas neue Keyframe-Funktion, reibungsloser Bildübergang

Am 29. Juni startete Luma AI die Keyframe-Funktion und mit einer Handbewegung war sie direkt für alle Benutzer kostenlos zugänglich.

Benutzer müssen nur die Start- und Endbilder hochladen und Textbeschreibungen hinzufügen, und Luma kann Spezialeffektvideos auf Hollywood-Niveau erstellen.

Zum Beispiel hat X-Netizen @hungrydonke zwei Keyframe-Fotos hochgeladen:

|

|

Dann geben Sie das Aufforderungswort ein: Plötzlich fällt ein Haufen schwarzer Konfetti (Plötzlich fällt plötzlich ein Haufen schwarzer Konfetti) Der Effekt ist wie folgt -

Netizen @JonathanSolder3 nutzte Midjourney zunächst, um zwei Bilder zu generieren:

|

|

Verwenden Sie dann die Luma-Keyframe-Funktion, um eine Animation der Super-Saiyajin-Transformation zu erstellen. Laut dem Autor benötigt Luma keine Einschaltaufforderung, geben Sie einfach „Super Saiyajin“ ein. 🔜 Animation „Der Wolf“, „Der Krieger“ und „Die Garderobe“.

Videolink: https://www.php.cn/link/dbf138511ed1d9278bde43cc0000e49a

Teufel verwandelt sich in Engel:

Orange verwandelt sich in Küken:

Starbucks-Logo-Transformation:

Yann LeCun „Bombardment“: Sie verstehen Physik überhaupt nicht

Als Sora Anfang des Jahres veröffentlicht wurde, wurde „Weltmodell“ plötzlich zu einem heißen Konzept.Später verwendete Googles Genie auch das Banner „Weltmodell“. Als Runway dieses Mal Gen-3 Alpha auf den Markt brachte, sagte der Beamte, es sei „ein wichtiger Schritt in Richtung Aufbau eines universellen Weltmodells“ gemacht worden.

Was genau ist ein Weltmodell?Tatsächlich gibt es dafür keine Standarddefinition, aber KI-Wissenschaftler glauben, dass Menschen und Tiere die Betriebsregeln der Welt auf subtile Weise erfassen, sodass sie „vorhersagen“ können, was als nächstes passieren wird, und Maßnahmen ergreifen können. Das Studium von Weltmodellen soll der KI ermöglichen, diese Fähigkeit zu erlernen.

Viele Leute glauben, dass die von Anwendungen wie Sora, Luma und Runway generierten Videos ziemlich realistisch sind und auch neue Videoinhalte in chronologischer Reihenfolge generieren können. Sie scheinen die Fähigkeit gelernt zu haben, die Entwicklung von Dingen vorherzusagen. Dies deckt sich mit dem Ziel der Weltmodellforschung. Allerdings hat Turing-Award-Gewinner Yann LeCun „kaltes Wasser eingegossen“. Er glaubt: „Das Produzieren der realistischsten Videos auf der Grundlage von Eingabeaufforderungen bedeutet nicht, dass das System die physische Welt versteht, und das Generieren kausaler Vorhersagen aus Weltmodellen ist etwas ganz anderes.“ Am 1. Juli veröffentlichte Yann LeCun 6 Beiträge in Folge Generative Modelle für Bombardierungsvideos. Er hat ein Video von KI-generiertem Turnen retweetet. Die Köpfe der Charaktere im Video verschwanden entweder aus dem Nichts oder es tauchten plötzlich vier Beine auf und überall waren alle möglichen seltsamen Bilder zu sehen.Videolink:

https://www.php.cn/link/dbf138511ed1d9278bde43cc0000e49aYann LeCun sagte, dass das Videogenerierungsmodell grundlegende physikalische Prinzipien nicht versteht, geschweige denn die Struktur des menschlichen Körpers.

„Sora und andere videogenerative Modelle haben ähnliche Probleme. Es besteht kein Zweifel daran, dass die Videogenerierungstechnologie mit der Zeit immer weiter fortgeschritten sein wird, aber ein gutes Weltmodell, das die Physik wirklich versteht, wird nicht generativ sein.“ Alle Vögel und Säugetiere verstehen das Physik besser als jedes Videogenerierungsmodell, aber keines von ihnen kann detaillierte Videos erzeugen“, sagte Yann LeCun.

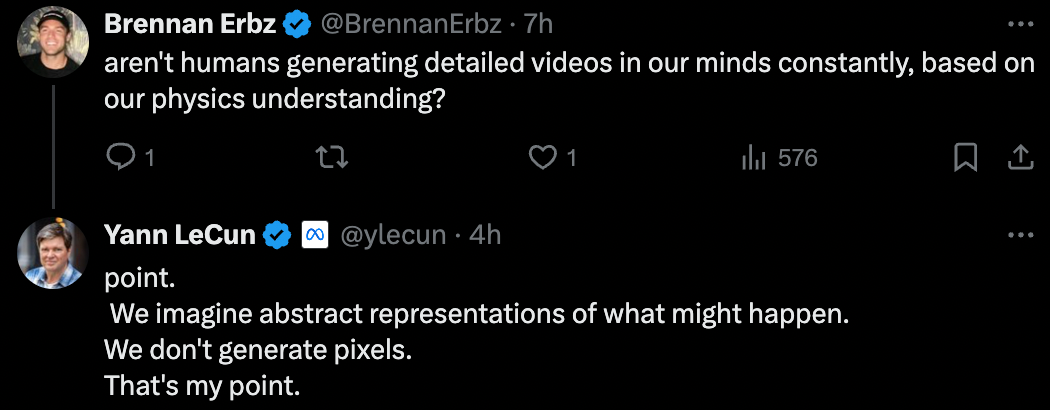

Einige Internetnutzer fragten: Erzeugen Menschen nicht ständig detaillierte „Videos“ in ihrem Kopf, basierend auf ihrem Verständnis der Physik?Yann LeCun beantwortete Fragen online: „Wir stellen uns abstrakte Szenarien vor, die auftreten können, anstatt Pixelbilder zu generieren. Das ist der Punkt, den ich zum Ausdruck bringen möchte.“

Yann LeCun erwidert: Nein, das tun sie nicht. Sie generieren lediglich abstrakte Szenarien dessen, was passieren könnte, was sich stark von der Erstellung detaillierter Videos unterscheidet.  In Zukunft werden wir über neue Kolumnen mehr AIGC-Falldemonstrationen anbieten, und jeder ist herzlich willkommen, sich der Gruppe zur Kommunikation anzuschließen.

In Zukunft werden wir über neue Kolumnen mehr AIGC-Falldemonstrationen anbieten, und jeder ist herzlich willkommen, sich der Gruppe zur Kommunikation anzuschließen.

Das obige ist der detaillierte Inhalt vonRunway und Luma kämpfen wieder! Yann LeCun bombardiert: Egal wie gut du bist, du bist kein „Weltmodel'. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr