PEFT(Parameter Efficient Fine-tuning)是一种优化深度学习模型微调过程的参数高效技术,旨在在有限的计算资源下实现高效微调。研究人员通过采用一系列策略来减少微调所需的计算资源,从而在保持模型性能的同时提高微调效率。这些策略包括减少微调训练的迭代次数、降低训练数据的采样率以及减少模型参数的更新频率等。通过这些方法,PEFT能够在资源受限的情况下,有效地进行深度学习模型的微调,为实际应用中的计算资源节约提供了一种有效的解决方案。

PEFT的应用广泛,包括图像分类和自然语言处理等领域。以下几个例子详细说明PEFT的应用。

1.图像分类

在图像分类任务中,PEFT可以通过以下策略来减少计算资源的使用:

- 逐层微调:首先,在较大的数据集上对模型进行预训练,然后逐层对模型进行微调。这种方法可以减少微调所需的计算资源,因为每层的微调次数较少。

- 微调头部:使用预训练模型的头部(即全连接层)作为新任务的起点,并对其进行微调。这种方法通常比对整个模型进行微调更有效,因为头部通常包含任务相关的信息。

- 数据增强:使用数据增强技术来扩充训练数据集,从而减少微调所需的数据量。

2.目标检测

在目标检测任务中,PEFT可以通过以下策略来减少计算资源的使用:

- 微调主干网络:使用预训练模型的主干网络作为新任务的起点,并对其进行微调。这种方法可以减少微调所需的计算资源,因为主干网络通常包含通用的特征提取器。

- 增量微调:使用预训练模型的检测头部作为新任务的起点,并对其进行微调。然后,将新的检测头部与预训练模型的主干网络结合起来,并对整个模型进行微调。这种方法可以减少微调所需的计算资源,因为只有新添加的检测头部需要进行微调。

- 数据增强:使用数据增强技术来扩充训练数据集,从而减少微调所需的数据量。

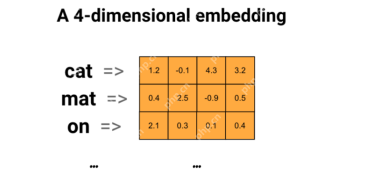

3.自然语言处理

在自然语言处理任务中,PEFT可以通过以下策略来减少计算资源的使用:

- 分层微调:首先,在较大的数据集上对语言模型进行预训练,然后逐层对模型进行微调。这种方法可以减少微调所需的计算资源,因为每层的微调次数较少。

- 微调头部:使用预训练模型的头部(即全连接层)作为新任务的起点,并对其进行微调。这种方法通常比对整个模型进行微调更有效,因为头部通常包含任务相关的信息。

- 数据增强:使用数据增强技术来扩充训练数据集,从而减少微调所需的数据量。

总的来说,PEFT是一种非常实用的深度学习模型微调技术,可以在有限的计算资源下提高模型的性能和微调的效率。在实际应用中,研究人员可以根据任务的特点和计算资源的限制选择合适的策略来进行微调,从而获得最佳的效果。

以上是PEFT参数优化技术:提高微调效率的探索的详细内容。更多信息请关注PHP中文网其他相关文章!

用Ollama -Analytics Vidhya简化本地LLM部署Apr 19, 2025 am 11:01 AM

用Ollama -Analytics Vidhya简化本地LLM部署Apr 19, 2025 am 11:01 AM利用Ollama本地开源LLMS的力量:综合指南 运行大型语言模型(LLMS)本地提供无与伦比的控制和透明度,但是设置环境可能令人生畏。 Ollama简化了这个过程

如何使用Monsterapi微调大语言模型Apr 19, 2025 am 10:49 AM

如何使用Monsterapi微调大语言模型Apr 19, 2025 am 10:49 AM利用微调LLM的功能与Monsterapi:综合指南 想象一个虚拟助手完美理解并预测您的需求。 由于大型语言模型(LLMS)的进步,这已成为现实。 但是,

5统计测试每个数据科学家都应该知道-Analytics VidhyaApr 19, 2025 am 10:27 AM

5统计测试每个数据科学家都应该知道-Analytics VidhyaApr 19, 2025 am 10:27 AM数据科学的基本统计测试:综合指南 从数据中解锁有价值的见解至关重要。 掌握统计测试对于实现这一目标至关重要。这些测试使数据科学家能够严格瓦尔

如何使用Florence -2 -Analytics Vidhya执行计算机视觉任务Apr 19, 2025 am 10:21 AM

如何使用Florence -2 -Analytics Vidhya执行计算机视觉任务Apr 19, 2025 am 10:21 AM介绍 原始变压器的引入为当前的大语言模型铺平了道路。同样,在引入变压器模型之后,引入了视觉变压器(VIT)。喜欢

使用Langchain Text Splitters -Analytics Vidhya拆分数据的7种方法Apr 19, 2025 am 10:11 AM

使用Langchain Text Splitters -Analytics Vidhya拆分数据的7种方法Apr 19, 2025 am 10:11 AMLangchain文本拆分器:优化LLM输入以提高效率和准确性 我们上一篇文章介绍了Langchain的文档加载程序。 但是,LLM具有上下文窗口大小的限制(以代币测量)。 超过此限制会截断数据,comp

免费生成的AI课程:开创创新的未来Apr 19, 2025 am 10:01 AM

免费生成的AI课程:开创创新的未来Apr 19, 2025 am 10:01 AM生成的AI:革命性的创造力和创新 生成的AI通过按下按钮来创建文本,图像,音乐和虚拟世界来改变行业。 它的影响跨越视频编辑,音乐制作,艺术,娱乐,HEA

使用通用句子编码器和Wikiqa创建QA模型Apr 19, 2025 am 10:00 AM

使用通用句子编码器和Wikiqa创建QA模型Apr 19, 2025 am 10:00 AM利用嵌入模型的力量来回答高级问题 在当今信息丰富的世界中,立即获得精确答案的能力至关重要。 本文展示了使用强大的提问(QA)模型

前十名必须阅读机器学习研究论文Apr 19, 2025 am 09:53 AM

前十名必须阅读机器学习研究论文Apr 19, 2025 am 09:53 AM本文探讨了十个彻底改变人工智能(AI)和机器学习(ML)的开创性出版物。 我们将研究神经网络和算法的最新突破,并解释驱动现代AI的核心概念。 Th

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

Dreamweaver Mac版

视觉化网页开发工具

记事本++7.3.1

好用且免费的代码编辑器

mPDF

mPDF是一个PHP库,可以从UTF-8编码的HTML生成PDF文件。原作者Ian Back编写mPDF以从他的网站上“即时”输出PDF文件,并处理不同的语言。与原始脚本如HTML2FPDF相比,它的速度较慢,并且在使用Unicode字体时生成的文件较大,但支持CSS样式等,并进行了大量增强。支持几乎所有语言,包括RTL(阿拉伯语和希伯来语)和CJK(中日韩)。支持嵌套的块级元素(如P、DIV),

安全考试浏览器

Safe Exam Browser是一个安全的浏览器环境,用于安全地进行在线考试。该软件将任何计算机变成一个安全的工作站。它控制对任何实用工具的访问,并防止学生使用未经授权的资源。

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。