RMSprop是一种广泛使用的优化器,用于更新神经网络的权重。它是由Geoffrey Hinton等人在2012年提出的,并且是Adam优化器的前身。改进的RMSprop算法的出现主要是为了解决SGD梯度下降算法中遇到的一些问题,例如梯度消失和梯度爆炸。通过使用改进的RMSprop算法,可以有效地调整学习速率,并且自适应地更新权重,从而提高深度学习模型的训练效果。

改进的RMSprop算法的核心思想是对梯度进行加权平均,以使不同时间步的梯度对权重的更新产生不同的影响。具体而言,RMSprop会计算每个参数的平方梯度的指数加权平均,并将其除以平均梯度的平方根。这个平方根作为分母,对每个参数的历史梯度进行归一化,进而使每个参数的更新量更加平稳。此外,RMSprop还可以调整学习率,使其在训练过程中逐渐减小,以提高模型的收敛速度和泛化能力。通过这种方式,RMSprop可以有效地处理梯度的变化,并帮助模型更好地适应不同的数据分布和优化目标。

具体来说,改进的RMSprop算法的更新公式如下所示:

\begin{aligned}

v_t&=\gamma v_{t-1}+(1-\gamma)(\nabla J(\theta_t))^2\

\theta_{t+1}&=\theta_t-\frac{\eta}{\sqrt{v_t}+\epsilon}\nabla J(\theta_t)

\end{aligned}

其中,v_t表示第t个时间步的平方梯度的指数加权平均数,通常使用衰减率gamma=0.9进行计算。学习率eta用于控制参数更新的步长,epsilon是一个小的常数,用于防止除以0的情况发生。这些参数在梯度下降算法中起到重要作用,通过调整它们的取值可以对优化过程进行精细的调节和优化。

改进的RMSprop算法的主要优点是可以自适应调整每个参数的学习率,从而降低了训练过程中的震荡和不稳定性。与传统的梯度下降算法相比,RMSprop可以更快地收敛,并且有更好的泛化能力。此外,RMSprop还可以处理稀疏梯度,使得在处理大型数据集时更为高效。

然而,RMSprop也存在一些缺点。首先,RMSprop的学习率可能会过小,导致模型收敛速度变慢。其次,RMSprop可能会受到噪声梯度的影响,从而导致模型的表现不佳。此外,RMSprop的性能还受到初始学习率、衰减率、常数$epsilon$等超参数的影响,需要进行经验调参。

rmsprop优化器可以防止过拟合吗

改进的RMSprop算法可以在某些情况下有助于减轻过拟合问题,但并不能完全解决过拟合。改进的RMSprop算法通过自适应地调整每个参数的学习率,以便更快地收敛到最优解。这有助于防止模型在训练集上过拟合,但并不保证模型不会在测试集上过拟合。因此,为了有效地减轻过拟合问题,通常需要采用其他技术,如正则化、dropout等。

rmsprop优化器的用法

改进的RMSprop算法是一种常见的梯度下降优化器,可以用于训练神经网络。以下是使用改进的RMSprop算法的一般步骤:

1.导入所需的库和数据集

2.构建神经网络模型

3.初始化改进的RMSprop算法,指定学习率和其他超参数

4.编译模型,指定损失函数和评估指标

5.训练模型,指定训练数据集、批次大小、训练周期数等参数

6.评估模型性能,使用测试数据集进行评估

7.调整模型架构、超参数等,以进一步改善模型性能

下面是一个使用Keras API实现改进的RMSprop算法的例子:

from keras.models import Sequential

from keras.layers import Dense

from keras.optimizers import RMSprop

from keras.datasets import mnist

# Load MNIST dataset

(train_images, train_labels), (test_images, test_labels) = mnist.load_data()

# Preprocess the data

train_images = train_images.reshape((60000, 784))

train_images = train_images.astype('float32') / 255

test_images = test_images.reshape((10000, 784))

test_images = test_images.astype('float32') / 255

# Build the model

model = Sequential()

model.add(Dense(512, activation='relu', input_shape=(784,)))

model.add(Dense(10, activation='softmax'))

# Initialize RMSprop optimizer

optimizer = RMSprop(lr=0.001, rho=0.9)

# Compile the model

model.compile(optimizer=optimizer,

loss='categorical_crossentropy',

metrics=['accuracy'])

# Train the model

model.fit(train_images, train_labels, epochs=5, batch_size=128)

# Evaluate the model

test_loss, test_acc = model.evaluate(test_images, test_labels)

print('Test accuracy:', test_acc)在上述代码中,我们首先加载MNIST数据集,并对其进行预处理。然后,我们使用Keras构建一个具有两个全连接层的神经网络模型,并使用改进的RMSprop算法进行优化。我们指定了学习率为0.001,rho参数为0.9。接下来,我们编译模型,使用交叉熵作为损失函数,使用精度作为评估指标。然后,我们使用训练数据集训练模型,指定了训练周期数为5,批次大小为128。最后,我们使用测试数据集评估模型性能,并输出测试精度。

以上是改进的RMSprop算法的详细内容。更多信息请关注PHP中文网其他相关文章!

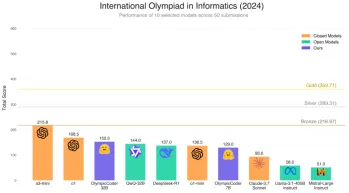

拥抱面部是否7B型号奥林匹克赛车击败克劳德3.7?Apr 23, 2025 am 11:49 AM

拥抱面部是否7B型号奥林匹克赛车击败克劳德3.7?Apr 23, 2025 am 11:49 AM拥抱Face的OlympicCoder-7B:强大的开源代码推理模型 开发以代码为中心的语言模型的竞赛正在加剧,拥抱面孔与强大的竞争者一起参加了比赛:OlympicCoder-7B,一种产品

4个新的双子座功能您可以错过Apr 23, 2025 am 11:48 AM

4个新的双子座功能您可以错过Apr 23, 2025 am 11:48 AM你们当中有多少人希望AI可以做更多的事情,而不仅仅是回答问题?我知道我有,最近,我对它的变化感到惊讶。 AI聊天机器人不仅要聊天,还关心创建,研究

Camunda为经纪人AI编排编写了新的分数Apr 23, 2025 am 11:46 AM

Camunda为经纪人AI编排编写了新的分数Apr 23, 2025 am 11:46 AM随着智能AI开始融入企业软件平台和应用程序的各个层面(我们必须强调的是,既有强大的核心工具,也有一些不太可靠的模拟工具),我们需要一套新的基础设施能力来管理这些智能体。 总部位于德国柏林的流程编排公司Camunda认为,它可以帮助智能AI发挥其应有的作用,并与新的数字工作场所中的准确业务目标和规则保持一致。该公司目前提供智能编排功能,旨在帮助组织建模、部署和管理AI智能体。 从实际的软件工程角度来看,这意味着什么? 确定性与非确定性流程的融合 该公司表示,关键在于允许用户(通常是数据科学家、软件

策划的企业AI体验是否有价值?Apr 23, 2025 am 11:45 AM

策划的企业AI体验是否有价值?Apr 23, 2025 am 11:45 AM参加Google Cloud Next '25,我渴望看到Google如何区分其AI产品。 有关代理空间(此处讨论)和客户体验套件(此处讨论)的最新公告很有希望,强调了商业价值

如何为抹布找到最佳的多语言嵌入模型?Apr 23, 2025 am 11:44 AM

如何为抹布找到最佳的多语言嵌入模型?Apr 23, 2025 am 11:44 AM为您的检索增强发电(RAG)系统选择最佳的多语言嵌入模型 在当今的相互联系的世界中,建立有效的多语言AI系统至关重要。 强大的多语言嵌入模型对于RE至关重要

麝香:奥斯汀的机器人需要每10,000英里进行干预Apr 23, 2025 am 11:42 AM

麝香:奥斯汀的机器人需要每10,000英里进行干预Apr 23, 2025 am 11:42 AM特斯拉的Austin Robotaxi发射:仔细观察Musk的主张 埃隆·马斯克(Elon Musk)最近宣布,特斯拉即将在德克萨斯州奥斯汀推出的Robotaxi发射,最初出于安全原因部署了一支小型10-20辆汽车,并有快速扩张的计划。 h

AI震惊的枢轴:从工作工具到数字治疗师和生活教练Apr 23, 2025 am 11:41 AM

AI震惊的枢轴:从工作工具到数字治疗师和生活教练Apr 23, 2025 am 11:41 AM人工智能的应用方式可能出乎意料。最初,我们很多人可能认为它主要用于代劳创意和技术任务,例如编写代码和创作内容。 然而,哈佛商业评论最近报道的一项调查表明情况并非如此。大多数用户寻求人工智能的并非是代劳工作,而是支持、组织,甚至是友谊! 报告称,人工智能应用案例的首位是治疗和陪伴。这表明其全天候可用性以及提供匿名、诚实建议和反馈的能力非常有价值。 另一方面,营销任务(例如撰写博客、创建社交媒体帖子或广告文案)在流行用途列表中的排名要低得多。 这是为什么呢?让我们看看研究结果及其对我们人类如何继续将

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。

螳螂BT

Mantis是一个易于部署的基于Web的缺陷跟踪工具,用于帮助产品缺陷跟踪。它需要PHP、MySQL和一个Web服务器。请查看我们的演示和托管服务。

Atom编辑器mac版下载

最流行的的开源编辑器

Dreamweaver Mac版

视觉化网页开发工具

SublimeText3 Linux新版

SublimeText3 Linux最新版