2021年9月25日,阿里云发布了开源项目通义千问140亿参数模型Qwen-14B以及其对话模型Qwen-14B-Chat,并且可以免费商用。Qwen-14B在多个权威评测中表现出色,超过了同等规模的模型,甚至有些指标接近Llama2-70B。此前,阿里云还开源了70亿参数模型Qwen-7B,仅一个多月的时间下载量就突破了100万,成为开源社区的热门项目

Qwen-14B是一款支持多种语言的高性能开源模型,相比同类模型使用了更多的高质量数据,整体训练数据超过3万亿Token,使得模型具备更强大的推理、认知、规划和记忆能力。Qwen-14B最大支持8k的上下文窗口长度。

图1:Qwen-14B在十二个权威测评中全方位超越同规模SOTA大模型

Qwen-14B-Chat是在基座模型上经过精细SFT得到的对话模型。借助基座模型强大性能,Qwen-14B-Chat生成内容的准确度大幅提升,也更符合人类偏好,内容创作上的想象力和丰富度也有显著扩展。

Qwen具备出色的工具调用能力,可以帮助开发者更快地构建基于Qwen的智能体。开发者可以使用简单的指令来教导Qwen使用复杂的工具,例如使用Code Interpreter工具来执行Python代码进行复杂的数学计算、数据分析和图表绘制等。此外,Qwen还可以开发出具备多文档问答和长文写作等能力的"高级数字助理"

百亿以内参数级别的大型语言模型目前是开发者进行应用开发和迭代的主流选择。Qwen-14B进一步提高了小尺寸模型的性能上限,在MMLU、C-Eval、GSM8K、MATH、GaoKao-Bench等12个权威测评中取得了最优成绩,超越了所有测评中的SOTA(State-Of-The-Art)大型模型,也全面超越了Llama-2-13B。与此同时,Qwen-7B也进行了全新升级,核心指标最高提升了22.5%

重写后的内容:图片2:Qwen-14B在相同尺寸模型上表现出更强的性能

用户可以直接从魔搭社区下载模型,也可以通过阿里云灵积平台访问和调用Qwen-14B和Qwen-14B-Chat。阿里云为用户提供完整的服务,包括模型训练、推理、部署和精调等方面

8月,阿里云开源通义千问70亿参数基座模型Qwen-7B,先后冲上HuggingFace、Github的trending榜单。短短一个多月,累计下载量突破100万。开源社区出现了50多个基于Qwen的模型,社区多个知名的工具和框架都集成了Qwen。

通义千问是中国最深入、应用最广泛的大型模型。国内已经有许多应用接入通义千问,这些应用的月活跃用户已经超过亿。许多中小企业、科研机构和个人开发者都在使用通义千问开发专属的大型模型或应用产品。例如,阿里巴巴旗下的淘宝、钉钉和未来精灵,以及外部的科研机构和创业企业

浙江大学联合高等教育出版社基于Qwen-7B开发了智海-三乐教育垂直大模型,已在全国12所高校应用。该模型具备智能问答、试题生成、学习导航、教学评估等功能。模型已在阿里云灵积平台上提供服务,只需一行代码即可调用。 浙江有鹿机器人科技有限公司在路面清洁机器人中集成了Qwen-7B,使机器人能够与用户进行实时交互,并理解用户的需求。它能够分析和拆解用户的高层指令,进行逻辑分析和任务规划,从而完成清洁任务

阿里云CTO周靖人表示,阿里云将持续支持和推动开源开放,致力于推动中国大模型生态系统的建设。阿里云坚信开源开放的力量,率先开源了自家研发的大模型技术,希望能够让更多的中小企业和个人开发者更快地接触和应用大模型技术

阿里云还领导着中国最大的AI模型开源社区魔搭ModelScope的建设,团结全行业的力量,共同推动大模型技术的普及和应用的实施。在过去的两个月内,魔搭社区的模型下载量从4500万飙升到8500万,增长接近100%

重新撰写的内容如下:附:

魔搭社区模型地址:

- https://www.php.cn/link/7463afe23eae7efe3c72737a5d3d693f

- https://www.php.cn/link/9578a63fbe545bd82cc5bbe749636af1

魔搭社区模型体验是什么?

阿里云灵积平台地址:

- https://www.php.cn/link/e44cf9762b402f5d8b5bc36f60304a15

- https://www.php.cn/link/1662d1307aaa81230b651ecf00d27180

需要重新写作的内容是:Qwen论文链接:

https://www.php.cn/link/da796dcc49ab9fc5ac26db17e02a9e33

Github:

HuggingFace(拥抱脸):

- https://www.php.cn/link/0247f3dd84906223785fddb18353bafe

- https://www.php.cn/link/0247f3dd84906223785fddb18353bafe-Chat

以上是阿里云通义千问14B模型开源!性能超越Llama2等同等尺寸模型的详细内容。更多信息请关注PHP中文网其他相关文章!

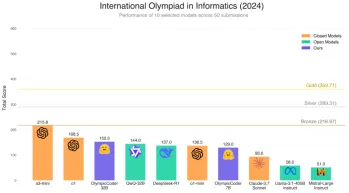

拥抱面部是否7B型号奥林匹克赛车击败克劳德3.7?Apr 23, 2025 am 11:49 AM

拥抱面部是否7B型号奥林匹克赛车击败克劳德3.7?Apr 23, 2025 am 11:49 AM拥抱Face的OlympicCoder-7B:强大的开源代码推理模型 开发以代码为中心的语言模型的竞赛正在加剧,拥抱面孔与强大的竞争者一起参加了比赛:OlympicCoder-7B,一种产品

4个新的双子座功能您可以错过Apr 23, 2025 am 11:48 AM

4个新的双子座功能您可以错过Apr 23, 2025 am 11:48 AM你们当中有多少人希望AI可以做更多的事情,而不仅仅是回答问题?我知道我有,最近,我对它的变化感到惊讶。 AI聊天机器人不仅要聊天,还关心创建,研究

Camunda为经纪人AI编排编写了新的分数Apr 23, 2025 am 11:46 AM

Camunda为经纪人AI编排编写了新的分数Apr 23, 2025 am 11:46 AM随着智能AI开始融入企业软件平台和应用程序的各个层面(我们必须强调的是,既有强大的核心工具,也有一些不太可靠的模拟工具),我们需要一套新的基础设施能力来管理这些智能体。 总部位于德国柏林的流程编排公司Camunda认为,它可以帮助智能AI发挥其应有的作用,并与新的数字工作场所中的准确业务目标和规则保持一致。该公司目前提供智能编排功能,旨在帮助组织建模、部署和管理AI智能体。 从实际的软件工程角度来看,这意味着什么? 确定性与非确定性流程的融合 该公司表示,关键在于允许用户(通常是数据科学家、软件

策划的企业AI体验是否有价值?Apr 23, 2025 am 11:45 AM

策划的企业AI体验是否有价值?Apr 23, 2025 am 11:45 AM参加Google Cloud Next '25,我渴望看到Google如何区分其AI产品。 有关代理空间(此处讨论)和客户体验套件(此处讨论)的最新公告很有希望,强调了商业价值

如何为抹布找到最佳的多语言嵌入模型?Apr 23, 2025 am 11:44 AM

如何为抹布找到最佳的多语言嵌入模型?Apr 23, 2025 am 11:44 AM为您的检索增强发电(RAG)系统选择最佳的多语言嵌入模型 在当今的相互联系的世界中,建立有效的多语言AI系统至关重要。 强大的多语言嵌入模型对于RE至关重要

麝香:奥斯汀的机器人需要每10,000英里进行干预Apr 23, 2025 am 11:42 AM

麝香:奥斯汀的机器人需要每10,000英里进行干预Apr 23, 2025 am 11:42 AM特斯拉的Austin Robotaxi发射:仔细观察Musk的主张 埃隆·马斯克(Elon Musk)最近宣布,特斯拉即将在德克萨斯州奥斯汀推出的Robotaxi发射,最初出于安全原因部署了一支小型10-20辆汽车,并有快速扩张的计划。 h

AI震惊的枢轴:从工作工具到数字治疗师和生活教练Apr 23, 2025 am 11:41 AM

AI震惊的枢轴:从工作工具到数字治疗师和生活教练Apr 23, 2025 am 11:41 AM人工智能的应用方式可能出乎意料。最初,我们很多人可能认为它主要用于代劳创意和技术任务,例如编写代码和创作内容。 然而,哈佛商业评论最近报道的一项调查表明情况并非如此。大多数用户寻求人工智能的并非是代劳工作,而是支持、组织,甚至是友谊! 报告称,人工智能应用案例的首位是治疗和陪伴。这表明其全天候可用性以及提供匿名、诚实建议和反馈的能力非常有价值。 另一方面,营销任务(例如撰写博客、创建社交媒体帖子或广告文案)在流行用途列表中的排名要低得多。 这是为什么呢?让我们看看研究结果及其对我们人类如何继续将

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。

mPDF

mPDF是一个PHP库,可以从UTF-8编码的HTML生成PDF文件。原作者Ian Back编写mPDF以从他的网站上“即时”输出PDF文件,并处理不同的语言。与原始脚本如HTML2FPDF相比,它的速度较慢,并且在使用Unicode字体时生成的文件较大,但支持CSS样式等,并进行了大量增强。支持几乎所有语言,包括RTL(阿拉伯语和希伯来语)和CJK(中日韩)。支持嵌套的块级元素(如P、DIV),

DVWA

Damn Vulnerable Web App (DVWA) 是一个PHP/MySQL的Web应用程序,非常容易受到攻击。它的主要目标是成为安全专业人员在合法环境中测试自己的技能和工具的辅助工具,帮助Web开发人员更好地理解保护Web应用程序的过程,并帮助教师/学生在课堂环境中教授/学习Web应用程序安全。DVWA的目标是通过简单直接的界面练习一些最常见的Web漏洞,难度各不相同。请注意,该软件中

Atom编辑器mac版下载

最流行的的开源编辑器

禅工作室 13.0.1

功能强大的PHP集成开发环境