用AI打击键盘侠和网络喷子,保护被网暴者的生命安全

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB转载

- 2023-05-06 16:55:091216浏览

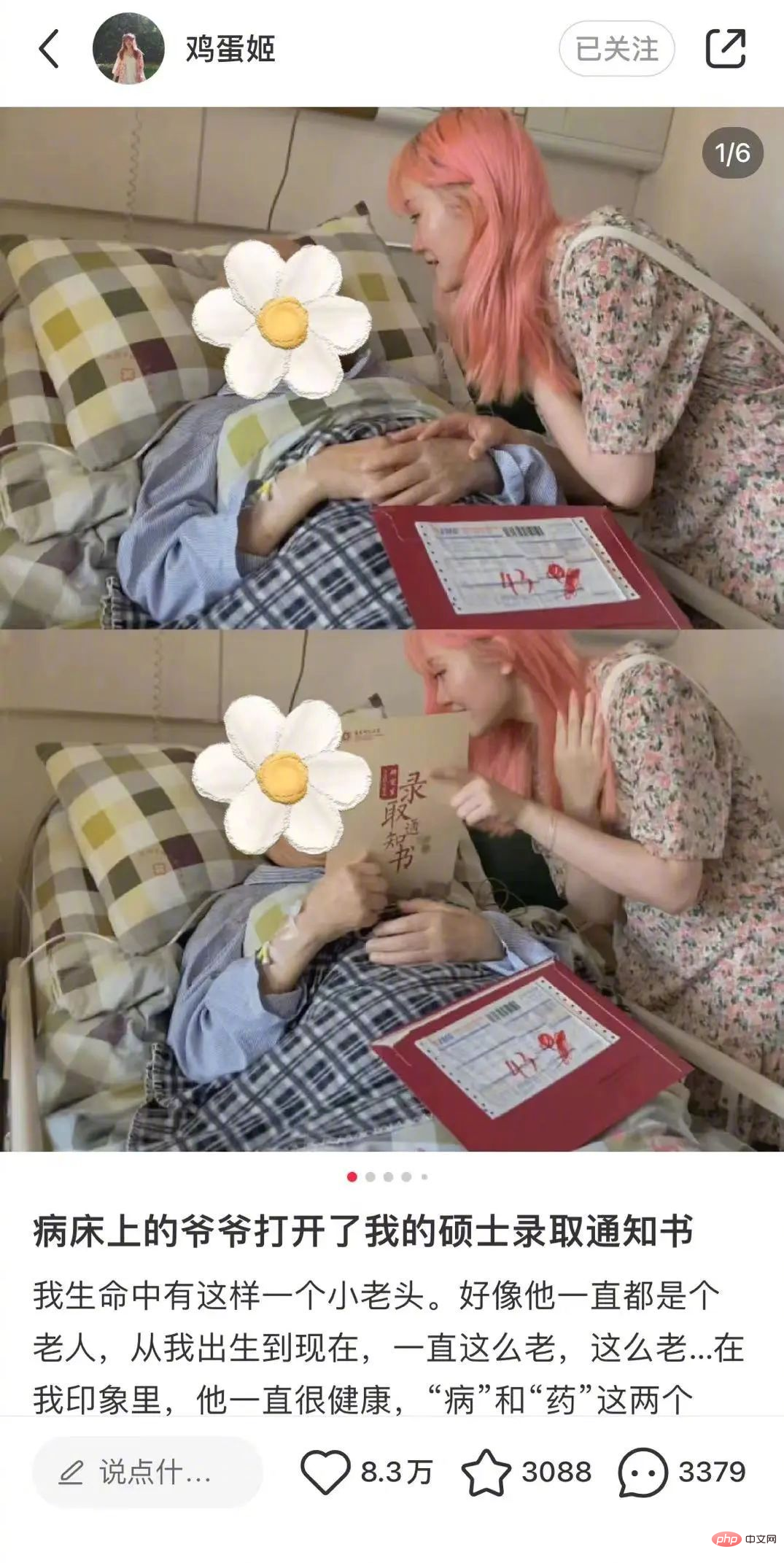

一个95后女生自杀了,起因只是在网上发布了这么一篇博文。

这篇充满温情的博文发布后,主人公郑灵华却遭遇到了大量的造谣和谩骂。

有人质疑她的身份,造谣说她是“陪酒女”,只是因为她的头发是粉色的;有人造谣她是“老少恋”、“恰流量”、“骗子精”,造谣她利用爷爷的病挣钱。

如是总总,不堪入目。尽管很多媒体对谣言进行了辟谣,但是郑灵华没有收到道歉,甚至郑灵华在拿起法律武器维权的时候,依然受到骚扰。

最终,郑灵华患上抑郁症,不久前结束了自己的生命。

这样的事情在互联网上发生过很多次,这种弥漫在网络世界的“人言可畏”不仅让人观感恶心,甚至能夺取人们的生命,这样的行为也有个专门的名词——网络暴力,简称“网暴”。

那么在AI已经可以和人类对答如流的今天,AI是否可以在识别网暴行为中发挥作用呢?

突破两大难点,识别网暴言论准确率超90%

尽管大部分互联网平台都已经上线了一些识别特别言论的系统,但是这些系统大多只是针对关键的词进行检测和删除,显然是不够智能的,稍加注意就能绕开这些限制。

事实上,准确识别网暴言论,需要做到两点:

- 如何联系上下文准确识别网暴言论?

- 如何高效识别网暴言论?

第一点关注的是网暴言论的内容,因为网络上大部分信件和留言都是分段的,往往是在对话中,网暴行为逐渐变得严重,最终酿成恶果。

第二点关注的是速度,毕竟互联网环境下,要处理的数据太多了,如果检测需要很久,那么这个系统将毫无实际价值,也不会得到采用。

英国的一组研究人员开发了一种新的人工智能模型,称为 BiCapsHate,它克服了这两个挑战,研究结果1月19日发表在《IEEE Transactions on Computational Social Systems》上的一项论文中。

该模型由五层深层神经网络组成,它从一个输入层开始,处理输入文本,然后到一个 embedding 层,将文本嵌入到一个数字表示中,然后是 BiCaps 层学习顺序和语言上下文表示,dense层为最终分类准备模型,最后输出层输出结果。

BiCaps 层是最重要的组成部分,它通过胶囊网络(capsule networks)有效地获取输入文本前后方向不同方向的上下文信息。得益于丰富的手工调试的浅层和深层辅助功能(包括Hatebase词典),使模型信息更加丰富。研究人员在五个基准数据集上进行了广泛的实验,以证明所提出的BiCapsHate模型的有效性。总体结果显示,BiCapsHate优于现有的最先进的方法,包括fBERT, HateBERT和ToxicBERT。

在平衡和非平衡数据集上,BiCapsHate分别达到94%和92% f-score的准确率。

速度快,可以在GPU运行

塔里克 · 安瓦尔(Tarique Anwar)是约克大学计算机科学系的讲师,他参与了这项研究。他指出,网上的争论往往会导致负面的、可恨的和辱骂性的“网暴”评论,而现有的社交媒体平台的内容审查做法无法控制这种情况。

他说:“此外,网上仇恨言论有时会映射现实环境,导致犯罪和暴力行为。”,塔里克 · 安瓦尔也表示,网上仇恨言论导致身体暴力和暴乱的例子有好几次。

为了帮助解决这个问题,塔里克 · 安瓦尔的团队决定开发 BiCapsHate,并且取得了非常好的效果。

正如安瓦尔指出的那样,语言在某些情况下可能是模棱两可的,即一个词在一种语境中可能是正面的,而在另一种语境中可能是就是负面的。此前的模型在这方面都不够优秀,如 HateBERT、 toxicBERT 和 fBERT,这些人工智能能够在一定程度上捕捉上下文,但是塔里克 · 安瓦尔认为“这些仍然不够好”。

BiCapsHate 的另一个优点是该模型能够使用有限的硬件资源执行计算。“(其他模型)需要像 GPU 这样的高端硬件资源,以及用于计算的高端系统,”塔里克 · 安瓦尔解释说。“相反,BiCapsHate……可以在 CPU 机器上执行,即使你只有8GB的内存。”

值得注意的是,到目前为止,该人工智能已经被开发和测试,仅用于分析英语言论,因此它将需要被改编为其他语言。与更激烈的仇恨言论相比,它也不太善于发现带有温和或微妙的仇恨语气的攻击性词语。

研究人员希望下一步能够探索评估在线表达仇恨的用户的心理健康状况的方法。如果有人担心这个人精神不稳定,并且可能对现实世界中的人施加身体暴力,可以考虑早期干预来降低发生这种情况的可能性。

以上是用AI打击键盘侠和网络喷子,保护被网暴者的生命安全的详细内容。更多信息请关注PHP中文网其他相关文章!