在自动驾驶技术不断迭代的当下,车辆的行为和轨迹预测对高效、安全驾驶有着极为重要的意义。动力学模型推演、可达性分析等传统的轨迹预测的方法虽然有着形式明晰、可解释性强的优点,但在复杂的交通环境中,其对于环境和物体交互的建模能力较为有限。因此,近年来大量研究和应用都基于各种深度学习方法(例如 LSTM、CNN、Transformer、GNN 等),各类数据集例如 BDD100K、nuScenes、Stanford Drone、ETH/UCY、INTERACTION、ApolloScape 等也纷纷涌现,为训练和评估深度神经网络模型提供了强力支持,不少 SOTA 模型例如 GroupNet、Trajectron++、MultiPath 等都表现出了良好的性能。

以上模型和数据集都集中在正常的道路行驶场景下,并充分利用车道线、交通灯等基础设施和特征辅助预测过程;由于交通法规的限制,绝大多数车辆的运动方式也较为明确。然而,在自动驾驶的 “最后一公里”—— 自动泊车场景下,我们将面对不少新的困难:

- 停车场内的交通规则和车道线要求并不严格,车辆也经常随意行驶 “抄近路”

- 为了完成泊车任务,车辆需要完成较为复杂的泊车动作,包括频繁的倒车、停车、转向等。在驾驶员经验不足的情况下,泊车可能成为一个漫长的过程

- 停车场内障碍物较多且杂乱,车间距离较近,稍不留神就可能导致碰撞和剐蹭

-

停车场内行人往往随意穿行,车辆需要更多的避让动作

在这样的场景下,简单套用现有的轨迹预测模型难以达到理想的效果,而重新训练模型又缺乏相应数据的支持。当下基于停车场景的数据集例如 CNRPark+EXT 和 CARPK 等,都仅为空闲停车位检测而设计,图片来源于提供监控相机第一人称视角、采样率低、且遮挡较多,无法用于轨迹预测。

在 2022 年 10 月刚刚结束的第 25 届 IEEE 智能交通系统国际会议 (IEEE ITSC 2022) 中,来自加州大学伯克利分校的研究者们发布了首个针对停车场景的高清视频 & 轨迹数据集,并在此数据集的基础上,利用 CNN 和 Transformer 架构提出了名为 “ParkPredict+” 的轨迹预测模型。

- 论文链接:https://arxiv.org/abs/2204.10777

- 数据集主页、试用和下载申请:https://sites.google.com/berkeley.edu/dlp-dataset (如无法访问,可尝试备用页面 https://www.php.cn/link/966eaa9527eb956f0dc8788132986707 )

- 数据集 Python API:https://github.com/MPC-Berkeley/dlp-dataset

数据集信息

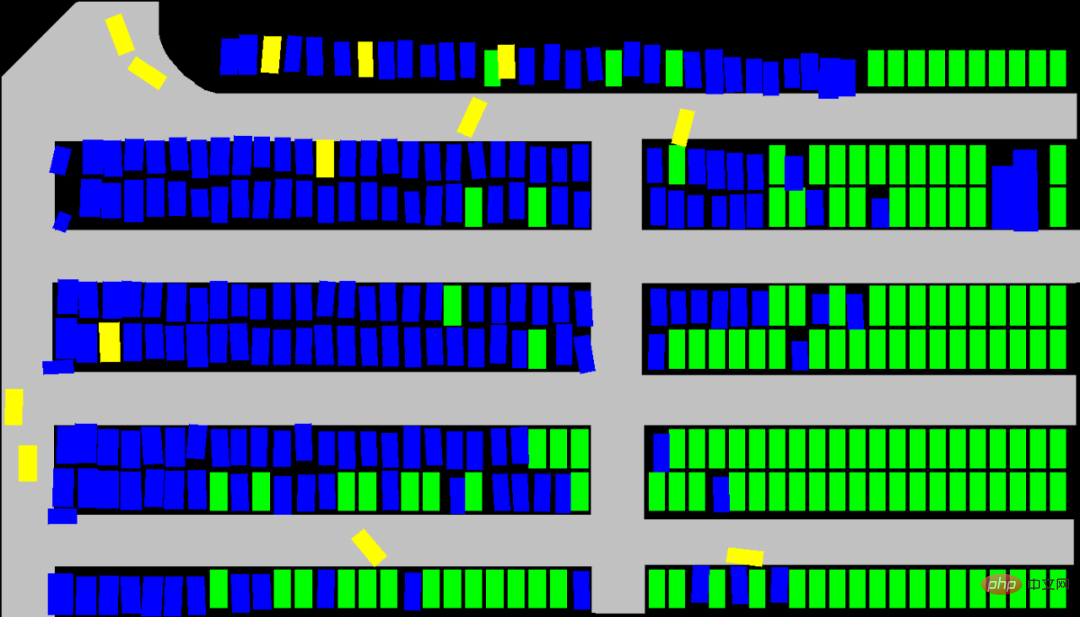

数据集由无人机进行采集,总时长为 3.5 小时,视频分辨率为 4K,采样率 25Hz。视野范围覆盖了约 140m x 80m 的停车场区域,共计约 400 个停车位。数据集经过精确标注,共采集到 1216 辆机动车、3904 辆自行车和 3904 位行人的轨迹。

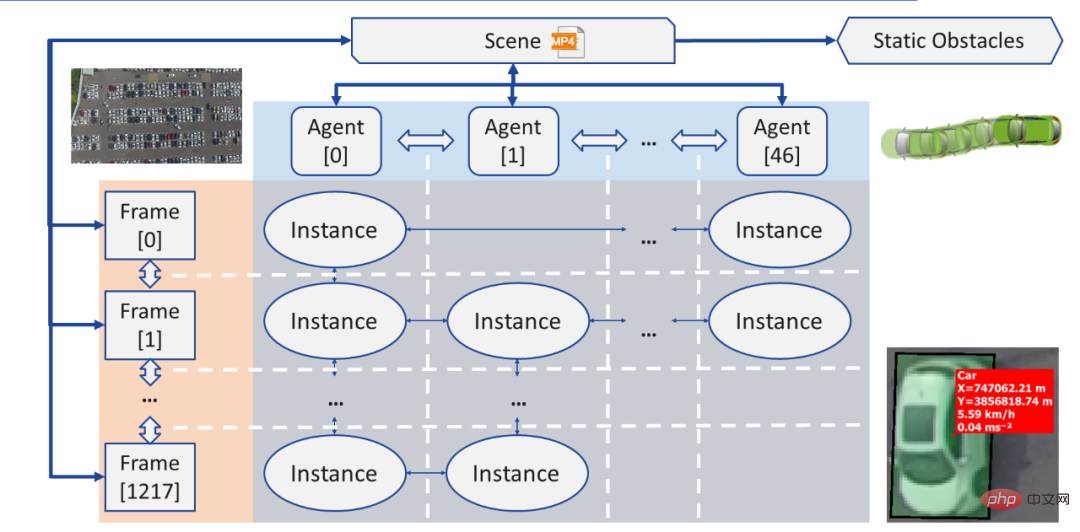

经过重新处理后,轨迹数据可以 JSON 的形式读取,并加载为连接图(Graph)的数据结构:

- 个体(Agent):每个个体(Agent)即为一个在当前场景(Scene)下运动的物体,具备几何形状、类型等属性,其运动轨迹被储存为一个包含实例(Instance)的链表(Linked List)

- 实例(Instance):每个实例(Instance)即为一个个体(Agent)在一帧(Frame)中的状态,包含其位置、转角、速度和加速度。每个实例都包含指向该个体在前一帧和后一帧下实例的指针

- 帧(Frame):每一帧(Frame)即为一个采样点,其包含当前时间下所有可见的实例(Instance),和指向前一帧和后一帧的指针

- 障碍物(Obstacle):障碍物即为在此次记录中完全没有移动的物体,包含各个物体的位置、转角和几何尺寸

- 场景(Scene):每个场景(Scene)对应于一个录制的视频文件,其包含指针,指向该录制的首帧和尾帧、所有个体(Agent)和所有障碍物(Obstacle)

数据集提供两种下载格式:

仅 JSON(推荐):JSON 文件包含所有个体的类型、形状、轨迹等信息,可以通过开源的 Python API 直接读取、预览、并生成语义图像(Semantic Images)。如果研究目标仅为轨迹和行为预测,JSON 格式可以满足所有的需求。

原视频和标注:如果研究是基于相机原图像(Raw Image)的目标检测、分隔、追踪等机器视觉领域课题,那么可能会需要下载原视频和标注。如有此需要,需要在数据集申请中明确描述该研究需求。另外,标注文件需自行解析。

行为和轨迹预测模型:ParkPredict+

作为应用示例,在 IEEE ITSC 2022 的论文《ParkPredict+: Multimodal Intent and Motion Prediction for Vehicles in Parking Lots with CNN and Transformer》中,研究团队利用此数据集,基于 CNN 和 Transformer 架构实现了在停车场场景下车辆的意图(Intent)和轨迹(Trajectory)预测。

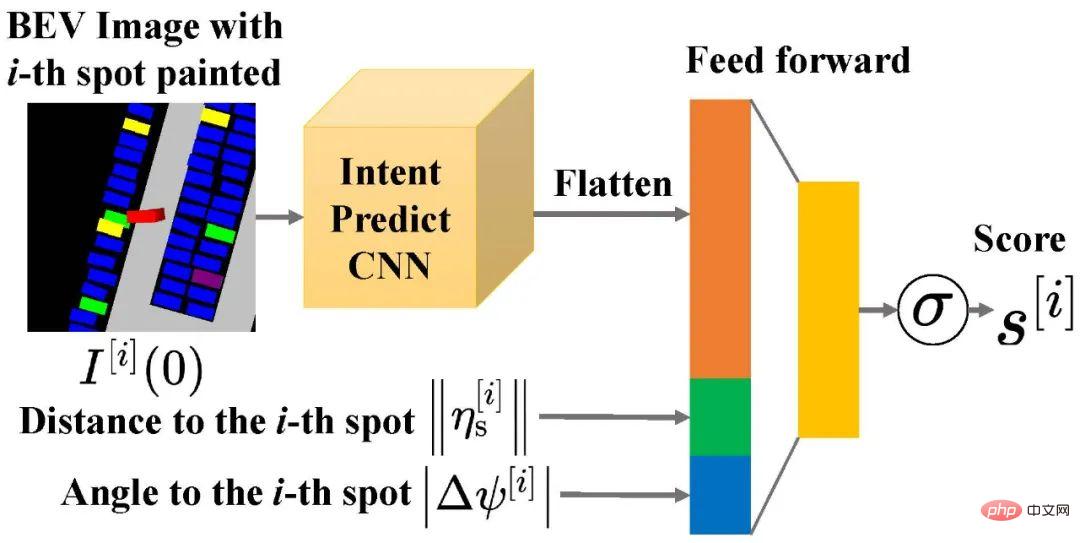

团队利用 CNN 模型,通过构建语义图像(Semantic Images),实现了对于车辆意图(Intent)分布概率的预测 。该模型仅需要构建车辆局部的环境信息,且可根据当前环境,不断变化可供选择的意图数量。

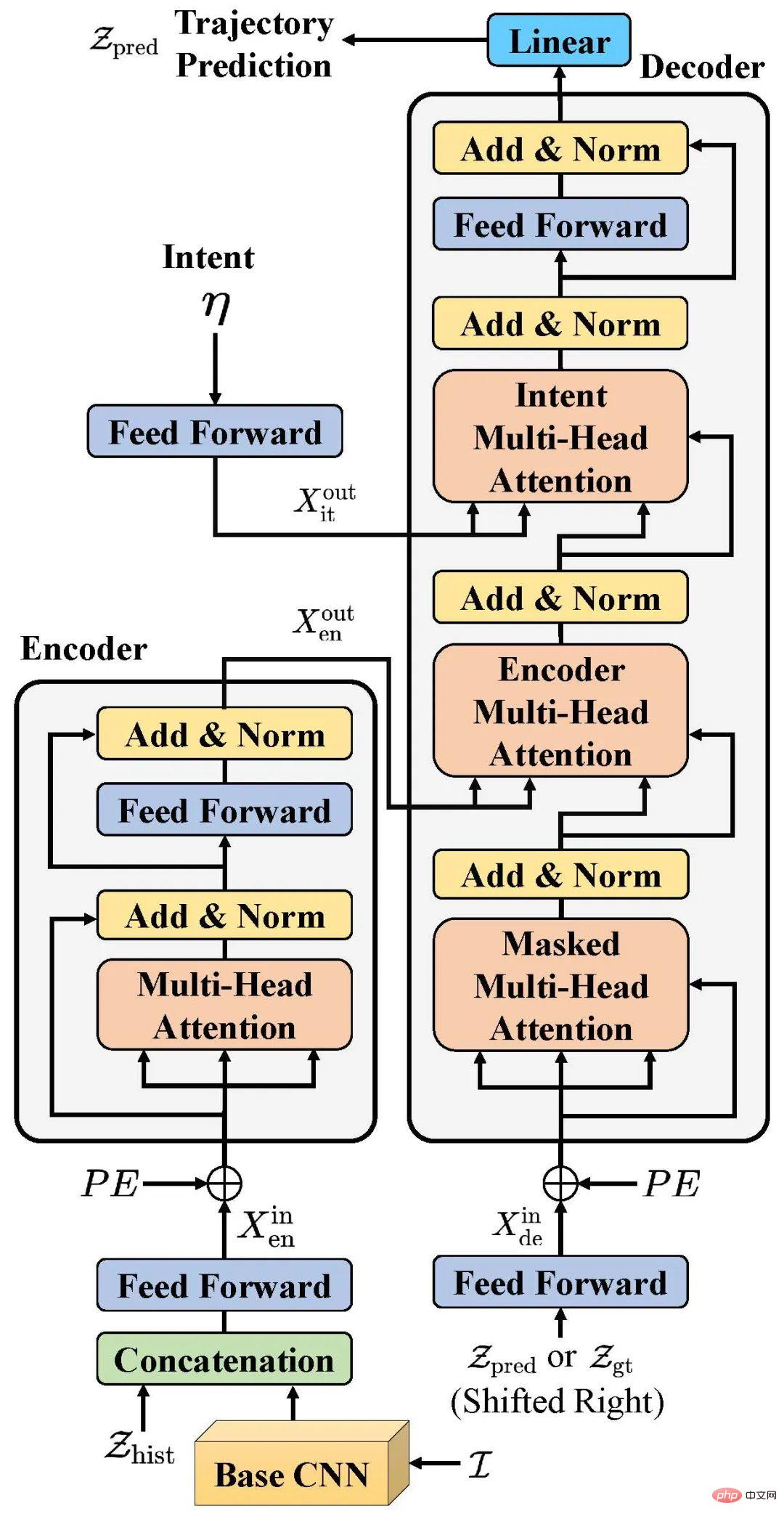

团队通过改进 Transformer 模型,将意图(Intent)预测结果、车辆的运动历史、周边环境的语义图作为输入提供,实现了多模态(Multi-modal)的意图和行为预测。

总结

- 作为首个针对泊车场景的高精度数据集,Dragon Lake Parking (DLP) 数据集可为该场景下大规模目标识别和追踪、空闲车位检测、车辆和行人的行为和轨迹预测、模仿学习等研究提供数据和 API 支持

- 通过使用 CNN 和 Transformer 架构,ParkPredict + 模型在泊车场景下的行为和轨迹预测中展现除了良好的能力

- Dragon Lake Parking (DLP) 数据集已开放试用和申请,可通过访问数据集主页 https://sites.google.com/berkeley.edu/dlp-dataset 了解详细信息(如无法访问,可尝试备用页面 https://www.php.cn/link/966eaa9527eb956f0dc8788132986707 )

以上是伯克利开源首个泊车场景下的高清数据集和预测模型,支持目标识别、轨迹预测的详细内容。更多信息请关注PHP中文网其他相关文章!

软AI的兴起及其对当今企业的意义Apr 15, 2025 am 11:36 AM

软AI的兴起及其对当今企业的意义Apr 15, 2025 am 11:36 AM软AI(被定义为AI系统,旨在使用近似推理,模式识别和灵活的决策执行特定的狭窄任务 - 试图通过拥抱歧义来模仿类似人类的思维。 但是这对业务意味着什么

为AI前沿的不断发展的安全框架Apr 15, 2025 am 11:34 AM

为AI前沿的不断发展的安全框架Apr 15, 2025 am 11:34 AM答案很明确 - 只是云计算需要向云本地安全工具转变,AI需要专门为AI独特需求而设计的新型安全解决方案。 云计算和安全课程的兴起 在

生成AI的3种方法放大了企业家:当心平均值!Apr 15, 2025 am 11:33 AM

生成AI的3种方法放大了企业家:当心平均值!Apr 15, 2025 am 11:33 AM企业家,并使用AI和Generative AI来改善其业务。同时,重要的是要记住生成的AI,就像所有技术一样,都是一个放大器 - 使得伟大和平庸,更糟。严格的2024研究O

Andrew Ng的新简短课程Apr 15, 2025 am 11:32 AM

Andrew Ng的新简短课程Apr 15, 2025 am 11:32 AM解锁嵌入模型的力量:深入研究安德鲁·NG的新课程 想象一个未来,机器可以完全准确地理解和回答您的问题。 这不是科幻小说;多亏了AI的进步,它已成为R

大语言模型(LLM)中的幻觉是不可避免的吗?Apr 15, 2025 am 11:31 AM

大语言模型(LLM)中的幻觉是不可避免的吗?Apr 15, 2025 am 11:31 AM大型语言模型(LLM)和不可避免的幻觉问题 您可能使用了诸如Chatgpt,Claude和Gemini之类的AI模型。 这些都是大型语言模型(LLM)的示例,在大规模文本数据集上训练的功能强大的AI系统

60%的问题 - AI搜索如何消耗您的流量Apr 15, 2025 am 11:28 AM

60%的问题 - AI搜索如何消耗您的流量Apr 15, 2025 am 11:28 AM最近的研究表明,根据行业和搜索类型,AI概述可能导致有机交通下降15-64%。这种根本性的变化导致营销人员重新考虑其在数字可见性方面的整个策略。 新的

麻省理工学院媒体实验室将人类蓬勃发展成为AI R&D的核心Apr 15, 2025 am 11:26 AM

麻省理工学院媒体实验室将人类蓬勃发展成为AI R&D的核心Apr 15, 2025 am 11:26 AM埃隆大学(Elon University)想象的数字未来中心的最新报告对近300名全球技术专家进行了调查。由此产生的报告“ 2035年成为人类”,得出的结论是,大多数人担心AI系统加深的采用

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

Atom编辑器mac版下载

最流行的的开源编辑器

Dreamweaver CS6

视觉化网页开发工具

EditPlus 中文破解版

体积小,语法高亮,不支持代码提示功能