译者 | 李睿

审校 | 孙淑娟

在具有感知功能的聊天机器人成为热门话题之前,大型语言模型(LLM)就已经引起了人们更多的兴奋和担忧。近年来,经过大量文本训练的深度学习模型——大型语言模型(LLM) 在几个用于衡量语言理解能力的基准方面表现出色。

诸如GPT-3和LaMDA之类的大型语言模型设法在较长的文本中保持连贯性。它们似乎对不同的主题很了解,并在冗长的对话中保持一致。大型语言模型(LLM)已经变得如此令人信服,以至于有些人将它们与人格和更高形式的智力联系在一起。

但是大型语言模型(LLM)能像人类一样进行逻辑推理吗?根据加州大学洛杉矶分校科学家发布的一篇研究论文,在大型语言模型(LLM)中使用的深度学习架构Transformers并没有学习模拟推理功能。与其相反,电脑们找到了明智的方法来学习推理问题中固有的统计特征。

研究人员在一个有限的问题空间中测试了当前流行的Transformer架构BERT。他们的研究结果表明,BERT可以准确地响应训练空间中分布内示例的推理问题,但不能推广到基于相同问题空间的其他分布中的示例。

而这些测试突出了深度神经网络的一些缺点以及用于评估它们的基准。

1.如何衡量人工智能中的逻辑推理?

人工智能系统针对自然语言处理和理解问题有几个基准测试,例如GLUE、SuperGLUE、SNLI和SqUAD。随着Transformer规模变得越来越大,并在更大的数据集上接受训练,Transformer已经能够在这些基准上逐步改进。

值得注意的是,人工智能系统在这些基准上的表现通常与人类智能进行比较。人类在这些基准上的表现与常识和逻辑推理能力密切相关。但目前尚不清楚大型语言模型的改进是因为它们获得了逻辑推理能力,还是因为它们接触了大量文本。

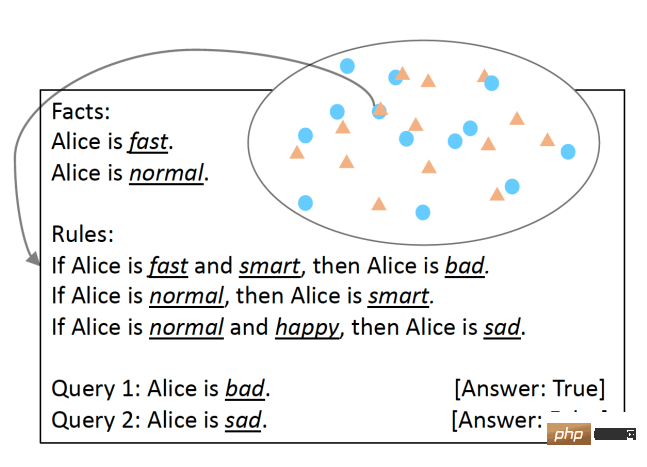

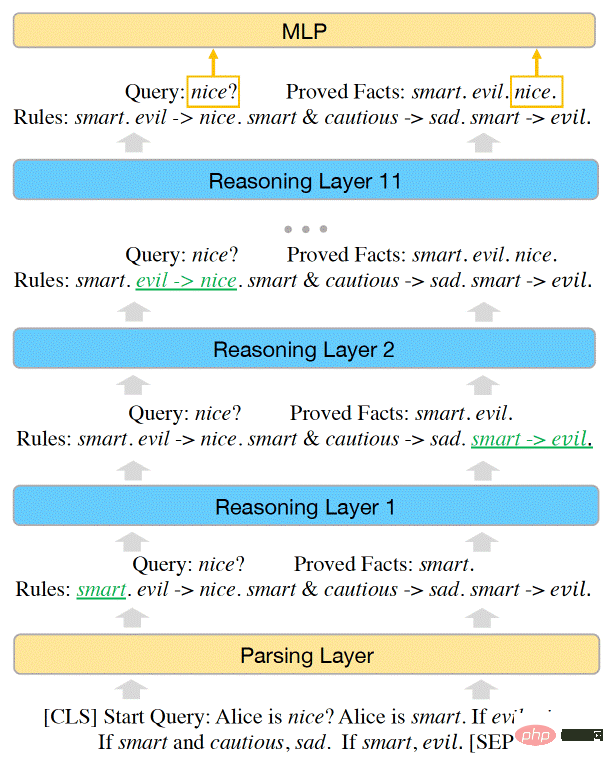

为了验证这一点,加州大学洛杉矶分校的研究人员开发了SimpleLogic,这是一类基于命题逻辑的逻辑推理问题。为了确保语言模型的推理能力经过严格测试,研究人员通过使用模板语言结构消除了语言差异。SimpleLogic问题由一组事实、规则、查询和标签组成。事实是已知为“真”的谓词。规则是条件,定义为条款。查询是机器学习模型必须响应的问题。标签是查询的答案,也就是“真”或“假”。 SimpleLogic问题被编译成连续的文本字符串,其中包含语言模型在训练和推理期间所期望的信号和分隔符。

以SimpleLogic格式提出的问题SimpleLogic的特点之一是它的问题是自包含的,不需要先验知识。这一点尤其重要,因为正如许多科学家所说,当人类说话时,他们忽略了共享的知识。这就是为什么当被问及每个人都知道的基本世界知识的问题时,语言模型经常陷入陷阱的原因。相比之下,SimpleLogic为开发人员提供解决其问题所需的一切。 因此,任何查看SimpleLogic格式提出的问题的开发人员都应该能够推断其规则,并能够处理新示例,无论他们的背景知识如何。

2.统计特征和逻辑推理

研究人员证明,SimpleLogic中的问题空间可以用一个推理函数来表示。研究人员进一步表明,BERT有足够的能力解决SimpleLogic中的所有问题,它们可以人工调整机器学习模型的参数来表示推理功能。

然而,当它们在SimpleLogic示例数据集上训练BERT时,该模型无法自行学习推理功能。机器学习模型设法在一个数据分布上实现近乎完美的准确性。但它并没有推广到同一问题空间内的其他分布。尽管训练数据集覆盖了整个问题空间,并且所有分布都来自同一推理函数,但情况仍然如此。

BERT Transformer模型的容量足以表示SimpleLogic的推理功能

(注:这与分布外泛化挑战不同,后者适用于开放空间问题。当模型无法泛化到OOD数据时,当处理不在其训练集分布范围内的数据时,其性能会显著下降。)

研究人员写道:“经过进一步调查,我们为这个悖论提供了一个解释:仅在分布测试示例上达到高精度的模型还没有学会推理。事实上,该模型已经学会在逻辑推理问题中使用统计特征来进行预测,而不是模拟正确的推理功能。”

这一发现凸显了将深度学习用于语言任务的一个重要挑战。神经网络非常擅长发现和拟合统计特征。在某些应用程序中,这可能非常有用。例如,在情感分析中,某些词和情感类别之间存在很强的相关性。

然而,对于逻辑推理任务,即使存在统计特征,其模型也应该尝试找到并学习潜在的推理功能。

研究人员写道:“当我们试图对神经模型进行端到端的训练,以解决既涉及逻辑推理又涉及先验知识且呈现语言差异的自然语言处理(NLP)任务时,应该小心谨慎。”他们强调,SimpleLogic带来的挑战在现实世界中变得更加严峻,大型语言模型(LLM)所需的大量信息根本不包含在数据中。

研究人员观察到,当他们从训练数据集中删除一个统计特征时,语言模型在相同问题空间的其他分布上的性能得到了改善。然而,问题是发现和删除多个统计特征说起来容易做起来难。正如研究人员在论文中指出的那样,“此类统计特征可能数不胜数,并且极其复杂,因此很难从训练数据中删除。”

3.深度学习中的推理

不幸的是,随着语言模型规模的变大,逻辑推理问题并没有消失。它只是隐藏在庞大的架构和非常大的训练语料库中。大型语言模型(LLM)可以描述事实并且很好地将句子拼接在一起,但是在逻辑推理方面,他们仍然使用统计特征进行推理,这不是一个坚实的基础。而且,没有迹象表明通过向Transformers添加层、参数和注意力头,逻辑推理的差距将被弥合。

这篇论文与其他显示神经网络在学习逻辑规则方面的局限性的工作一致,例如生命游戏或视觉数据的抽象推理。该论文强调了当前语言模型面临的主要挑战之一。正如加州大学洛杉矶分校的研究人员所指出的,“一方面,当一个模型被训练来从数据中学习一项任务时,它总是倾向于学习统计模式,这些模式固有地存在于推理示例中;然而,另一方面,逻辑规则从不依赖统计模式来进行推理。由于很难构建一个不包含统计特征的逻辑推理数据集,因此从数据中学习推理是很困难的。”

原文链接:https://bdtechtalks.com/2022/06/27/large-language-models-logical-reasoning/

以上是研究表明大型语言模型在逻辑推理方面存在问题的详细内容。更多信息请关注PHP中文网其他相关文章!

软AI的兴起及其对当今企业的意义Apr 15, 2025 am 11:36 AM

软AI的兴起及其对当今企业的意义Apr 15, 2025 am 11:36 AM软AI(被定义为AI系统,旨在使用近似推理,模式识别和灵活的决策执行特定的狭窄任务 - 试图通过拥抱歧义来模仿类似人类的思维。 但是这对业务意味着什么

为AI前沿的不断发展的安全框架Apr 15, 2025 am 11:34 AM

为AI前沿的不断发展的安全框架Apr 15, 2025 am 11:34 AM答案很明确 - 只是云计算需要向云本地安全工具转变,AI需要专门为AI独特需求而设计的新型安全解决方案。 云计算和安全课程的兴起 在

生成AI的3种方法放大了企业家:当心平均值!Apr 15, 2025 am 11:33 AM

生成AI的3种方法放大了企业家:当心平均值!Apr 15, 2025 am 11:33 AM企业家,并使用AI和Generative AI来改善其业务。同时,重要的是要记住生成的AI,就像所有技术一样,都是一个放大器 - 使得伟大和平庸,更糟。严格的2024研究O

Andrew Ng的新简短课程Apr 15, 2025 am 11:32 AM

Andrew Ng的新简短课程Apr 15, 2025 am 11:32 AM解锁嵌入模型的力量:深入研究安德鲁·NG的新课程 想象一个未来,机器可以完全准确地理解和回答您的问题。 这不是科幻小说;多亏了AI的进步,它已成为R

大语言模型(LLM)中的幻觉是不可避免的吗?Apr 15, 2025 am 11:31 AM

大语言模型(LLM)中的幻觉是不可避免的吗?Apr 15, 2025 am 11:31 AM大型语言模型(LLM)和不可避免的幻觉问题 您可能使用了诸如Chatgpt,Claude和Gemini之类的AI模型。 这些都是大型语言模型(LLM)的示例,在大规模文本数据集上训练的功能强大的AI系统

60%的问题 - AI搜索如何消耗您的流量Apr 15, 2025 am 11:28 AM

60%的问题 - AI搜索如何消耗您的流量Apr 15, 2025 am 11:28 AM最近的研究表明,根据行业和搜索类型,AI概述可能导致有机交通下降15-64%。这种根本性的变化导致营销人员重新考虑其在数字可见性方面的整个策略。 新的

麻省理工学院媒体实验室将人类蓬勃发展成为AI R&D的核心Apr 15, 2025 am 11:26 AM

麻省理工学院媒体实验室将人类蓬勃发展成为AI R&D的核心Apr 15, 2025 am 11:26 AM埃隆大学(Elon University)想象的数字未来中心的最新报告对近300名全球技术专家进行了调查。由此产生的报告“ 2035年成为人类”,得出的结论是,大多数人担心AI系统加深的采用

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

Atom编辑器mac版下载

最流行的的开源编辑器

Dreamweaver CS6

视觉化网页开发工具

EditPlus 中文破解版

体积小,语法高亮,不支持代码提示功能