作者 | JAMES VINCENT

译者 | 朱先忠

1、生成式人工智能越来越火爆但其产品合法性如何?

自去年以来,生成式人工智能越来越火爆。微软、Adobe和GitHub等公司正在将该技术集成到他们的产品中;初创企业正在筹集数亿美元,与之竞争;该软件甚至具有文化影响力,文本到图像的人工智能模型催生了无数的模因文化。但是,仔细听一听任何关于生成式人工智能的行业讨论,你会私下里听到,倡导者和批评者都以越来越担忧的语气低声提出了一个问题:这些事实上是否合法?

问题的产生是因为生成式人工智能系统的训练方式。与大多数机器学习软件一样,它们通过识别和复制数据中的模式来工作。但由于这些程序用于生成代码、文本、音乐和艺术的训练数据本身是由人类创建的,是从网络上“搜刮”来的,而且其中大部分数据本身以某种方式受到版权保护。

对于经历过渺远过去 (又名“2010年代”)的人工智能研究人员来说,这不是什么大问题。当时,最先进的模型只能生成指甲大小的模糊黑白人脸图像。这对人类没有明显的威胁。但在2022年,当一个单纯的业余爱好者可以在几个小时内使用Stable Diffusion这样的软件复制一位艺术家的风格,或者当公司销售人工智能生成的印刷品和社交媒体过滤器,这些都是活生生的设计师的仿制品时,合法性和道德问题变得更加紧迫。

2、生成式人工智能模型是在受版权保护的数据上训练的这合法吗?

以迪士尼插画家霍莉·蒙格特(Hollie Mengert)为例,她发现自己的艺术风格被加拿大的一名机械工程学生克隆为人工智能实验。这位学生下载了蒙格特的32篇作品,并花了几个小时训练了一个可以重现她的风格的机器学习模型。正如蒙格特告诉技术专家Andy Baio(他报道了这起案件):“就我个人而言,这感觉就像有人在做我所做的工作,用我学到的东西——我从2011年艺术学校毕业以来一直是一名职业艺术家——并用它来创作我不同意也不允许的艺术。”

但这公平吗?蒙格特对此能做些什么吗?

为了回答这些问题并了解生成式人工智能的法律前景,the Verge公司采访了一系列有关专家,包括律师、分析师和人工智能初创公司的员工。一些人满怀信心地表示,这些系统极有可能侵犯版权,并可能在不久的将来面临严重的法律挑战。其他人则持相反意见:目前在生成式人工智能领域发生的一切都是合法的,任何诉讼都注定会失败。

“我看到双方的人都对自己的立场非常自信,但现实是没有人知道,”一直密切关注生成式人工智能场景的贝奥告诉the Verge采访人员。“任何人如果说他们自信地知道这件事在法庭上的结果,那就错了。”

英国萨塞克斯大学(University of Sussex)专门研究人工智能和知识产权法的学者安德烈斯·瓜达木兹(Andres Guadamuz)表示,尽管有很多未知因素,但也有几个关键问题,这一话题的诸多不确定性由此展开。首先,你能获得生成式人工智能模型的输出的版权吗?如果是,谁拥有它?第二,如果你拥有用于训练人工智能的输入的版权,那么你对模型或其创建的内容有任何法律要求吗?一旦这些问题得到回答,一个更大的问题就出现了:你如何应对这项技术的影响?可以或应该对数据收集实施什么样的法律限制?构建这些系统的人和那些需要数据来创建这些系统的人们之间能存在和平吗?

让我们逐一回答这些问题。

3、输出问题:你能获得人工智能模型所创造的东西的版权吗?

至少对于第一个问题,答案并不太难。在美国,仅由机器生成的作品没有版权保护。然而,在创作者能够证明有大量人力投入的情况下,版权似乎是可能得到承认的。

今年9月,美国版权局首次批准了一本漫画书的注册,这本漫画书是借助文本到图像的AI Midstravel(一种类似于Open AI公司的DALL·E产品AI艺术作品生成器软件)生成的。这部漫画是一部完整的作品:18页的叙述,有人物、对话和传统的漫画布局。尽管有报道称美国版权局正在审查其决定,但该漫画的版权注册实际上尚未被撤销。看来,审查中的一个因素将是制作漫画所涉及的人力投入程度。创作这部作品的艺术家克里斯蒂娜·卡什塔诺娃(Kristina Kashtanova)告诉ipwatchdog.com,美国版权局要求她“提供我的过程细节,以表明在这部平面小说的创作过程中有大量的人类参与。”(美国版权局本身不评论具体案例。)

根据瓜达木兹的说法,这将是一个持续存在的问题,涉及到为借助人工智能生成的作品授予版权。“如果你只是键入‘cat by van Gogh’,我认为这不足以在美国获得版权,”他说。“但如果你开始尝试使用提示,并制作几幅图像,开始微调图像,开始使用种子数据,并开始进行更多的工程,我完全可以看到这受到版权保护。”

4、对于人工智能模型输出产品的版权可能取决于人类参与的程度

考虑到这一准则,生成式人工智能模型的绝大多数输出很可能无法受到版权保护。它们通常都是用几个关键词作为提示而大批量制作出来的。但更多涉及的过程会产生更好的案例。这些可能包括有争议的作品,比如人工智能生成的印刷品赢得了国家艺术博览会的比赛。在这种情况下,创作者表示,他花了数周时间磨练提示,并手动编辑完成的作品,这表明他有相当高的智力投入。

计算机科学家乔治·弗朗切切利(Giorgio Franceschelli)撰写了有关人工智能版权问题的文章,他表示,衡量人类输入对于欧盟的案件判决“尤其正确”。而在英国——西方人工智能初创公司关注的另一个主要司法管辖区——法律再次不同。不同寻常的是,英国是少数几个为仅由计算机生成的作品提供版权的国家之一,但它认为作者是“完成作品创作所需安排的人”。同样,还存在多个“读者”的问题(这个“人”是模型的开发人员还是其操作员?),但它为授予某种版权保护提供了优先权。

不过,瓜达木兹警告说,最终,注册版权只是第一步。“美国版权局不是法院,”他说。“如果你要起诉侵犯版权的人,你需要注册,但最终将是法院来决定这是否具有法律效力。”

5、输入问题:你可以使用受版权保护的数据来训练人工智能模型吗?

对于大多数专家来说,关于人工智能和版权的最大问题与用于训练这些模型的数据有关。大多数系统都是根据从网络上获取的大量内容进行训练的;可以是文本、代码或图像。例如,Stable Diffusion的训练数据集——最大和最有影响力的文本转绘画技术之一——包含从数百个域中提取的数十亿张图像;从WordPress和Blogspot上的个人博客到DeviantArt等艺术平台以及Shutterstock和Getty Images等股票图像网站,应有尽有。事实上,生成式人工智能的训练数据集非常庞大,很有可能你已经身在其中。

人工智能研究人员、初创公司和数十亿美元的科技公司使用的理由是,使用这些图像(至少在美国)受到公平使用原则的保护,该原则旨在鼓励使用受版权保护的作品来促进表达自由。

范德比尔特法学院(Vanderbilt Law School)教授丹尼尔·热尔维斯(Daniel Gervais)解释说,在决定某种东西是否合理使用时,有很多考虑因素。热尔维斯专门研究知识产权法,并撰写了大量关于这一点与人工智能如何交叉的文章。不过,他表示,有两个因素“更加突出”。“使用的目的或性质是什么,对市场的影响是什么。”换言之:用例是否以某种方式改变了材料的性质(通常被描述为“变革性”使用),以及它是否通过与原创作者的作品竞争而威胁到他们的生计?

6、在受版权保护的数据上训练生成式人工智能可能是合法的但你可能用非法的方式使用这个模型

考虑到这些因素所承担的责任,Gervais表示,版权数据训练系统“很有可能”会被合理使用。但对于生成内容来说,这一点并不一定如此。换句话说:你可以用别人的数据训练一个人工智能模型,但是你用这个模型做的事情可能是侵权的。我们不妨把它想象成为制造假币去看电影和试图用假币买车的区别。

考虑在不同场景中部署的同一文本到图像的AI模型,如果模型在数百万张图片上训练并用于生成新的图片,那么这极不可能构成侵犯版权。在这个过程中,训练数据已经被转换,输出不会威胁到原始艺术的市场。但是,如果你在一个特定艺术家的100张照片上微调模型,并生成与其风格相同的图片,那么一个不开心的艺术家就可能会对你提出有力的指控。

Gervais说,“如果你给人工智能10本斯蒂芬·金的小说,然后说‘制作一本斯蒂芬·金的小说’,那么你就是直接和史蒂芬·金竞争了。这是对人工智能的合理使用吗?可能并不是”。

然而至关重要的是,在公平和不公平使用的两极之间,有无数种情况下,投入、目的和产出都以不同的方式平衡,并可能以某种方式影响任何法律裁决。

生成式人工智能公司Wombo的参谋长Ryan Khurana表示,大多数销售这些服务的公司都意识到了这些差异。他在电子邮件中告诉the Verge:“故意使用基于版权作品的提示来生成输出……违反了每个主要玩家的服务条款。”但是,他补充道,“这执行起来很困难”,公司更感兴趣的是“想出防止以侵犯版权的方式使用模型的方法……,而不是限制训练数据”。这对于开源文本到图像模型(如Stable Diffusion)尤其如此,它可以在零监督或过滤的情况下进行训练和使用。该公司可能会掩护自己,但也可能会为侵犯版权的使用提供便利。

判断合理使用的另一个变量是训练数据和模型是否由学术研究人员和非营利组织创建。这通常会加强合理使用防御,初创企业也知道这一点。比如Stability AI没有直接收集模型的训练数据,也没有在软件背后训练模型。相反,它资助并协调了学者的这项工作,而稳定扩散模型是由一所德国大学授权的。这使得Stability AI可以将模型转化为商业服务(DreamStudio),同时与其发明者保持合法的距离。

拜奥将这种做法称为“AI数据清洗”。他指出,这种方法以前在创建面部识别AI软件时就已经使用过,并指出了MegaFace的例子,MegaFace是华盛顿大学的研究人员通过从Flickr上抓取照片汇编的数据集。贝奥说:“学术研究人员拿走了数据,清洗了数据,然后被商业公司使用。”他说,这些数据——包括数百万张个人照片——掌握在“面部识别公司Clearview AI、执法部门和中国政府”手中。这种经过反复测试和检验的清洗过程可能有助于保护生成型人工智能模型的创造者免于承担责任。

然而,这一切还有最后一个转折点,正如热尔韦指出的,由于最高法院涉及安迪·沃霍尔和普林斯的未决案件,当前对合理使用的解释可能在未来几个月内发生变化。该案涉及沃霍尔使用普林斯的照片创作艺术品。这是合理使用,还是侵犯版权?

Gervais说:“最高法院经常不正当使用,所以当他们这样做的时候,他们通常会做一些重大的事情。我认为他们在这里也会这样做。”。“而且,在等待最高法院修改法律的同时,说任何事情都是既定法律的做法是有风险的。”

7、艺术家和人工智能公司如何实现和平?

即使发现生成式人工智能模型的训练被合理使用所覆盖,这也很难解决该领域的问题。这不会安抚艺术家们的愤怒,因为他们的作品被用来培育商业模型,也不一定适用于其他生成式人工智能领域,比如代码和音乐。考虑到这一点,问题是:可以引入哪些补救措施,无论是技术上的还是其他方面的,以允许生成式人工智能蓬勃发展,同时为那些工作使该领域成为可能的创造者提供信贷或补偿?

最明显的建议是授权数据并向其创作者付费。不过,对一些人来说,这将扼杀该行业。《公平学习》(Fair Learning)一书的作者布莱恩·凯西(Bryan Casey)和马克·莱姆利(Mark Lemley)表示,训练数据集太大,“没有任何合理的选择去授权所有底层照片、视频、音频文件或文本用于新用途”。他们认为,允许任何版权主张,“相当于说,不是版权所有者会得到报酬,而是根本不允许使用”。允许“公平学习”,正如他们所说的,不仅鼓励创新,还允许开发更好的人工智能系统。

然而,其他人指出,我们已经解决了类似规模和复杂性的版权问题,并且可以再次这样做。The Verge采访的几位专家援引了一个比较,那就是音乐盗版时代,当时的文件共享程序建立在大规模侵犯版权的基础上,并在出现法律挑战而导致了尊重版权的新协议之前繁荣发展。

本月早些时候,马修·巴特里克(Matthew Butterick)告诉the Verge:“所以,在21世纪初,你有Napster,大家都很喜欢它,但它完全是非法的。而今天,我们有Spotify和iTunes这样的公司。”目前,马修·布特里克是一名律师,他起诉公司为训练人工智能模型而收集数据。“这些系统是如何产生的?通过公司进行授权交易并合法地引入内容。所有利益相关者都参与进来,并使其发挥作用。对我来说,人工智能不可能发生类似事情的想法有是灾难性的。”

8、公司和研究人员已经在试验补偿创作者的方法

Wombo的Ryan Khurana预测了类似的结果。他告诉the Verge:“音乐拥有迄今为止最复杂的版权规则,因为许可证的类型不同、版权持有人的种类繁多,以及涉及各种中介机构。”“考虑到围绕人工智能的法律问题的细微差别,我认为整个生成的领域将演变成一个类似于音乐的许可制度。”

其他替代方案也在试验中。例如,Shutterstock表示,它计划设立一个基金,以补偿那些将其工作卖给人工智能公司以训练其模型的个人,而DeviantArt为网络上共享的图像创建了一个元数据标签,警告人工智能研究人员不要篡改其内容。(至少有一个小型社交网络Cohost已经在其网站上使用了这个标签,并表示如果发现研究人员不顾一切地删减其图片,“将不排除采取法律行动”。)然而,这些方法遇到了来自艺术社区的不同群体。一次性许可费能弥补失去的生计吗?现在部署的无刮擦标签如何帮助其作品已经用于训练商业人工智能系统的艺术家?

对于许多创作者来说,损害似乎已经造成。但人工智能初创公司至少在为未来提出新的方法。一个明显的进步是,人工智能研究人员只需在不存在侵犯版权的可能性的情况下创建数据库——要么是因为材料已获得适当许可,要么是因为它是为人工智能训练的特定目的而创建的。一个这样的例子是“The Stack”——一个用于训练人工智能的数据集,旨在专门避免侵犯版权的指控。它只包含具有最许可的开源许可的代码,并为开发人员提供了一种根据请求删除数据的简单方法。其创建者表示,他们的模型可以在整个行业中使用。

“The Stack的方法绝对可以适用于其他媒体,”Hugging Face的机器学习与社会主管Yacine Jernite告诉The Verge,该公司与合作伙伴ServiceNow合作创建了The Stack。“这是探索广泛存在的同意机制重要的第一步,这些机制在考虑到从中提取人工智能训练数据的平台规则时发挥最佳作用。”Jernite表示,Hugging Face希望帮助创造人工智能研究人员如何对待创作者的“根本转变”。但到目前为止,该公司的做法仍属罕见。

9、接下来会发生什么?

无论我们在这些法律问题上落在何处,生成式人工智能领域的各个参与者都已经在为一些事情做准备。从这项技术中获利数百万的公司正在巩固自己的地位:一再宣称他们所做的一切都是合法的(同时可能希望没有人真正质疑这一说法)。在“无人区”的另一边,版权持有者们在没有完全承诺采取行动的情况下表明了自己的初步立场。盖蒂图片社(Getty Images)最近禁止了人工智能内容,因为这会给客户带来潜在的法律风险(首席执行官克雷格·彼得斯上个月告诉the Verge):“我不认为这是负责任的事情;相反,我认为这可能是非法的)。而音乐行业贸易组织RIAA宣称,人工智能驱动的音乐混音器和提取器侵犯了会员的版权(尽管他们没有发起任何实际的法律挑战)。

然而,随着日前针对微软、GitHub和OpenAI提起的集体诉讼,人工智能版权战争的第一枪已经打响。该案指控上述三家公司在未获得正当许可的情况下通过AI编码助手Copilot故意复制开源代码。在接受The Verge采访时,诉讼方的律师表示,这可能会为整个生成式人工智能领域开创先例。

“不过,一旦有人揭发真相,我认为诉讼将开始横飞遍地。”

与此同时,瓜达木兹和拜奥都表示,他们对还没有更多的相关法律挑战感到惊讶。“老实说,我大吃一惊,”瓜达穆兹说。“但我认为这在一定程度上是因为这些行业害怕成为第一个(起诉)败诉的行业。不过,一旦有人揭发真相,我认为诉讼将开始横飞遍地。”

拜奥表示,一个困难是,许多受这项技术影响最大的人——艺术家等——根本无法处于一个良好的状态去发起法律挑战。“他们没有资源,”他说。“这类诉讼非常昂贵且耗时,只有在你知道自己会赢的情况下才会进行。这就是为什么我一段时间以来一直认为,围绕AI艺术的第一场诉讼将来自库存图像网站。他们似乎准备从这项技术中损失重大,他们可以清楚地证明,他们的大量语料库被用于训练这些模型,而他们有资金将其告上法庭。”

瓜达木兹表示同意。他说,“每个人都知道它会有多么昂贵”,“无论谁提起诉讼,都将在下级法院得到裁决,然后他们将上诉,然后再次上诉,最终,这可能会一直到最高法院。”

原文链接:https://www.theverge.com/23444685/generative-ai-copyright-infringement-legal-fair-use-training-data

译者介绍

朱先忠,51CTO社区编辑,51CTO专家博客、讲师,潍坊一所高校计算机教师,自由编程界老兵一枚。

以上是版权之争:悬于AI造物之上的达摩克里斯之剑的详细内容。更多信息请关注PHP中文网其他相关文章!

Openai' o1-preview vs o1-mini:向前迈出的一步Apr 12, 2025 am 10:04 AM

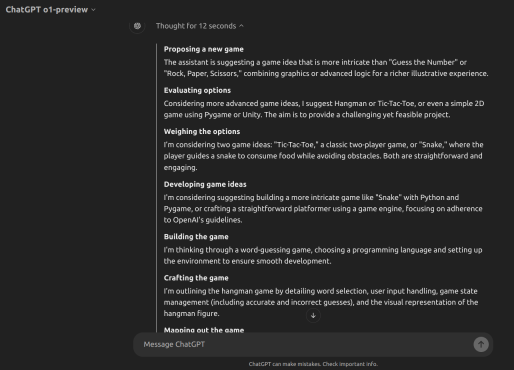

Openai' o1-preview vs o1-mini:向前迈出的一步Apr 12, 2025 am 10:04 AM介绍 9月12日,OpenAI发布了一项名为“与LLM的学习推理”的更新。他们介绍了O1模型,该模型是使用强化学习来应对复杂推理任务的训练。是什么设置了此mod

如何使用OpenAI O1构建游戏? - 分析VidhyaApr 12, 2025 am 10:03 AM

如何使用OpenAI O1构建游戏? - 分析VidhyaApr 12, 2025 am 10:03 AM介绍 OpenAI O1模型家族大大提高了推理能力和经济表现,尤其是在科学,编码和解决问题方面。 Openai的目标是创建越来越高的AI和O1模型

流行的LLM代理工具用于客户查询管理Apr 12, 2025 am 10:01 AM

流行的LLM代理工具用于客户查询管理Apr 12, 2025 am 10:01 AM介绍 如今,客户查询管理的世界正在以前所未有的速度移动,每天都有新的工具成为头条新闻。大型语言模型(LLM)代理是在这种情况下的最新创新,增强了Cu

100天企业的AI实施计划Apr 12, 2025 am 09:56 AM

100天企业的AI实施计划Apr 12, 2025 am 09:56 AM介绍 采用生成AI可能是任何公司的变革旅程。但是,Genai实施过程通常会繁琐且令人困惑。 Niit Lim的董事长兼联合创始人Rajendra Singh Pawar

Pixtral 12B与QWEN2-VL-72BApr 12, 2025 am 09:52 AM

Pixtral 12B与QWEN2-VL-72BApr 12, 2025 am 09:52 AM介绍 AI革命引起了创造力的新时代,在该时代,文本到图像模型正在重新定义艺术,设计和技术的交集。 pixtral 12b和qwen2-vl-72b是两个开创性的力量。

什么是PaperQA?如何帮助科学研究?Apr 12, 2025 am 09:51 AM

什么是PaperQA?如何帮助科学研究?Apr 12, 2025 am 09:51 AM介绍 随着人工智能的发展,科学研究已经发生了巨大的转变。每年在不同的技术和部门上发表数百万篇论文。但是,将这片信息海洋浏览到Retr

数据学:对幻觉的LLM接地-Analytics VidhyaApr 12, 2025 am 09:46 AM

数据学:对幻觉的LLM接地-Analytics VidhyaApr 12, 2025 am 09:46 AM介绍 大型语言模型正在迅速改变行业 - 迄今为止,它们为从银行业的个性化客户服务到全球沟通中的实时语言翻译提供了动力。他们可以回答任务

如何使用Crewai和Ollama建立多代理系统?Apr 12, 2025 am 09:44 AM

如何使用Crewai和Ollama建立多代理系统?Apr 12, 2025 am 09:44 AM介绍 不想在API上花钱,还是您担心隐私?还是您只想在本地运行LLMS?不用担心;本指南将帮助您使用本地LLMS构建代理和多代理框架

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

Atom编辑器mac版下载

最流行的的开源编辑器

SecLists

SecLists是最终安全测试人员的伙伴。它是一个包含各种类型列表的集合,这些列表在安全评估过程中经常使用,都在一个地方。SecLists通过方便地提供安全测试人员可能需要的所有列表,帮助提高安全测试的效率和生产力。列表类型包括用户名、密码、URL、模糊测试有效载荷、敏感数据模式、Web shell等等。测试人员只需将此存储库拉到新的测试机上,他就可以访问到所需的每种类型的列表。

DVWA

Damn Vulnerable Web App (DVWA) 是一个PHP/MySQL的Web应用程序,非常容易受到攻击。它的主要目标是成为安全专业人员在合法环境中测试自己的技能和工具的辅助工具,帮助Web开发人员更好地理解保护Web应用程序的过程,并帮助教师/学生在课堂环境中教授/学习Web应用程序安全。DVWA的目标是通过简单直接的界面练习一些最常见的Web漏洞,难度各不相同。请注意,该软件中

SublimeText3 Linux新版

SublimeText3 Linux最新版

EditPlus 中文破解版

体积小,语法高亮,不支持代码提示功能