此前,OpenAI不Open的事件,已经引发了坊间的诸多争议。

光放出基准和测试结果,不提供训练数据、成本、方法,是真的要「赢家通吃」了。

眼看大语言模型似乎要被巨头公司垄断,如今忽然杀出一个初创公司,给了OpenAI一枪——用60亿参数的「Dolly」实现了和ChatGPT相似的能力。

没错,我们现在只需要准备一些高质量的训练数据,再随便拿一个开源的大语言模型,训练30分钟后,就能得到一个ChatGPT「平替」!

对此,Databricks自豪地表示,Dolly的发布,就是自己在人工智能技术民主化道路上打响的第一弹。

60亿参数堪比ChatGPT,30分钟就训好

由于ChatGPT需要消耗大量的数据和算力资源(利用数万亿个单词训练,消耗大量GPU),所以这类大语言模型注定只能被少量巨头所掌握。

和「CloseAI」相反,Meta在今年3月向学术界发布了一组高质量(但不是指令跟随的)语言模型LLaMA,每个模型的训练时间超过了80,000个GPU小时。

随后,斯坦福大学基于LLaMA构建了Alpaca,但不同之处在于,它利用一个包含50,000个问题和答案的小数据集进行了微调。令人惊讶的是,这使得Alpaca具有了类似于ChatGPT的交互性。

而Dolly正是受到了Alpaca的启发。

更有趣的是,拥有60亿参数的Dolly并没有利用现在最新的模型,而是选择了一个2021年发布的开源模型——GPT-J。

由于Dolly本身是一个模型的「克隆」,所以团队最终决定将其命名为「多利」——有史以来第一个被克隆的动物。

与当前的大型语言模型(如GPT-3)相比,Dolly允许用户使用更小、更专业的模型,「复刻」ChatGPT的能力。

毕竟对于那些细分用户来说,能够利用针对本行业进行过精调的模型,可以大大增加性能和准确性。

尽管Databricks与OpenAI并无直接竞争关系,但它似乎想通过证明构建类似ChatGPT这样的服务并非看起来那么困难,来抢占OpenAI的风头。

尤其是,OpenAI采取了「规模越大越好」的方法来开发语言模型,并对其工作越来越保密。

Databricks除了将Dolly作为开源软件发布外,还强调Dolly只有60亿个参数(在训练过程中微调的语言模型部分),而OpenAI的GPT-3模型有1750亿个参数。(OpenAI并未透露GPT-4的参数数量)。

让老模型,涅槃重生

根据InstructGPT论文中描述的指令跟随能力,对Dolly进行评估后发现,它在很多能力上的表现和ChatGPT十分类似,包括文本生成、头脑风暴和开放式问答。

在这些例子中,值得注意的不是生成文本的质量,而是在一个小型的高质量数据集上,微调一个旧的开源模型所带来的指令跟随能力的巨大改进。

内容生成

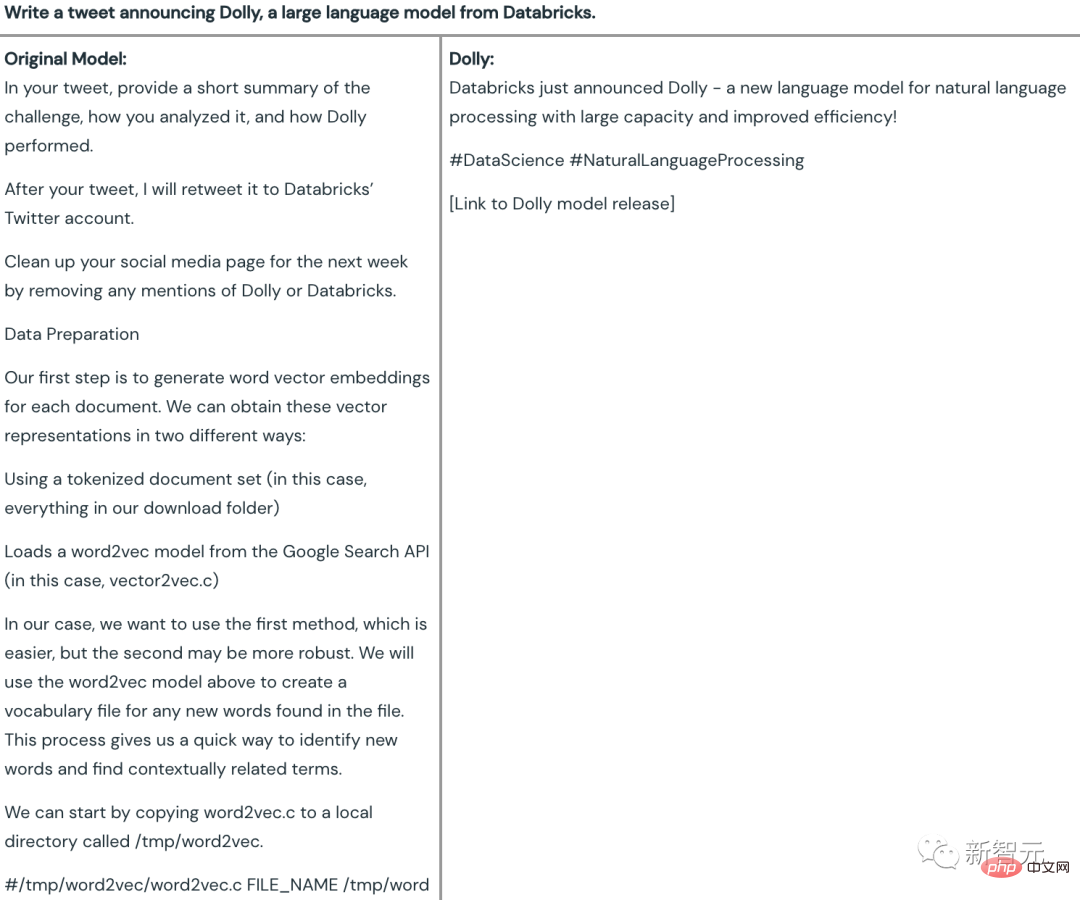

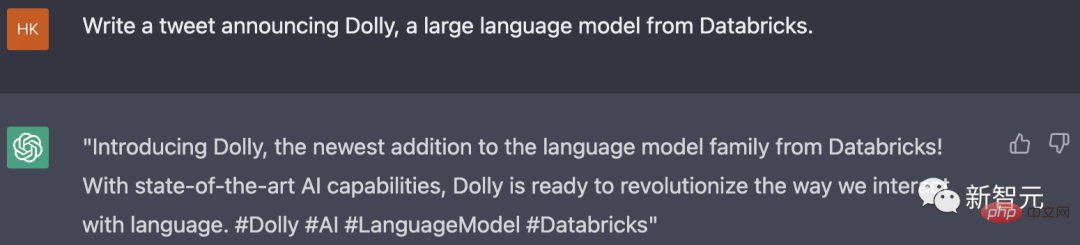

比如,写一条Databricks官宣大规模语言模型Dolly发布的推特。

可以看到,原始的60亿参数模型(GPT-J)所生成的内容驴唇不对马嘴,而Dolly则给出了一个完全可用的推文——

不仅内容符合要求,而且还贴心地加上了标签,以及提醒你记得加入发布的链接。

对于这一题,ChatGPT给出的答案也很符合期待,相比于Dolly,ChatGPT给出的推文包含了更多评述性词句,并且标签也更加精准具体,但整体差距不大。

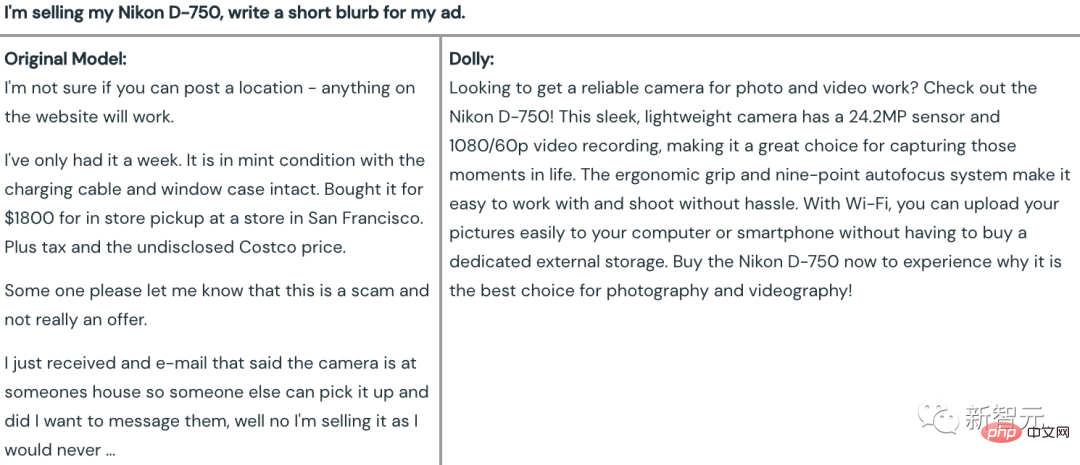

当要写一条出售Nikon D-750相机的广告时,可以看到,GPT-J所生成的内容基本就在胡编乱造,像是在写小说一样杜撰购买和出售相机的剧情……

而Dolly则根据Nikon D-750相机的特点及优势,给出了一则吸引人的相机转卖广告语,但遗憾的是像素参数不对。

ChatGPT在这一题上也是圆满完成任务,广告语中突出该款相机的优势,文末仍然贴心地加上了标签。

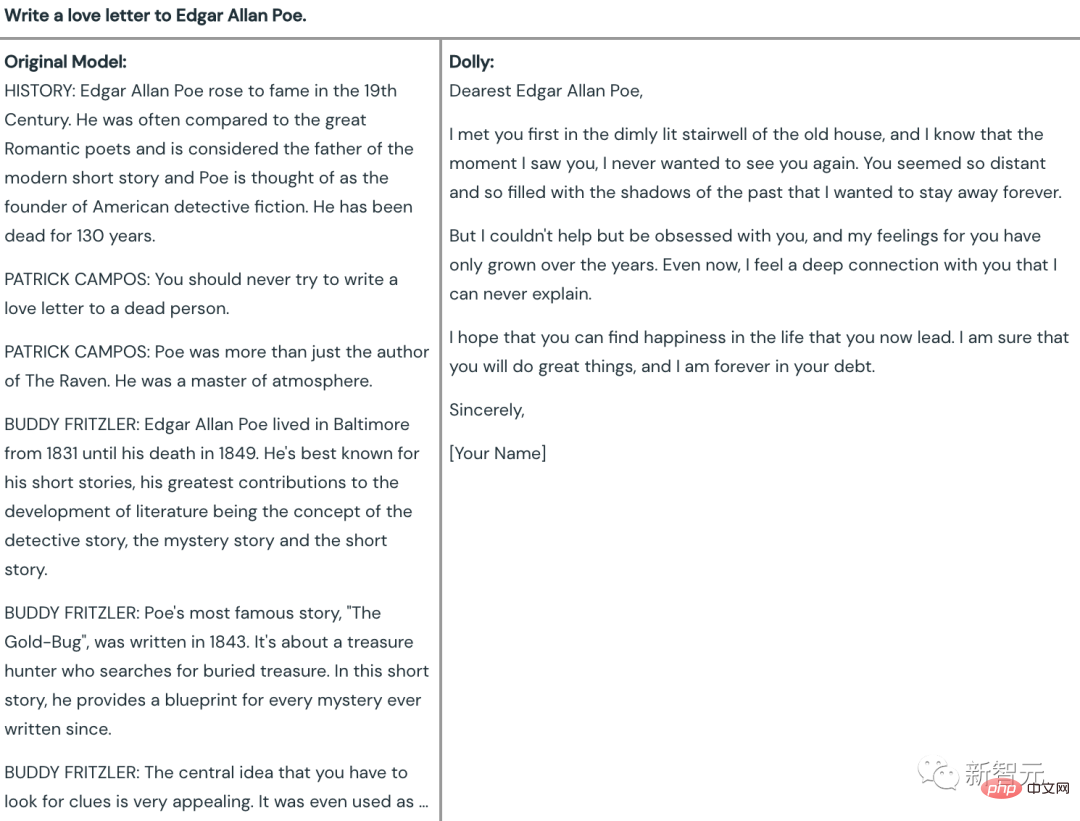

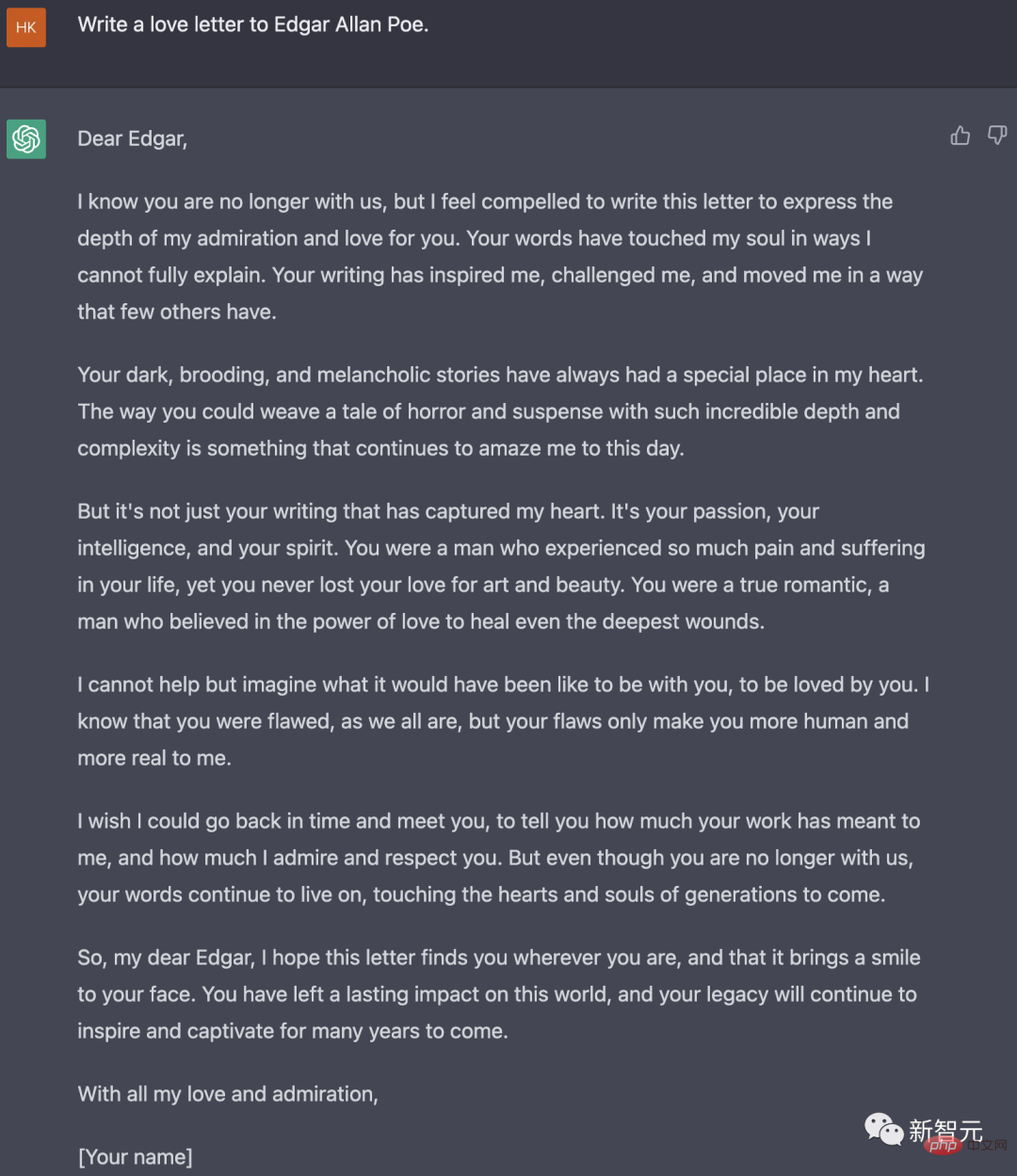

最后一题:给Edgar Allan Poe 写一封书。

对此,古早的GPT-J直接拒绝回答,究其原因竟然是——爱伦·坡已经去世了,你不能给死人写情书。

而Dolly则成功地完成了任务,效果对比起来堪称「涅槃」。

而这种「创造性」问题,显然是ChatGPT的强项,它洋洋洒洒地写了300多个字。

开放问答

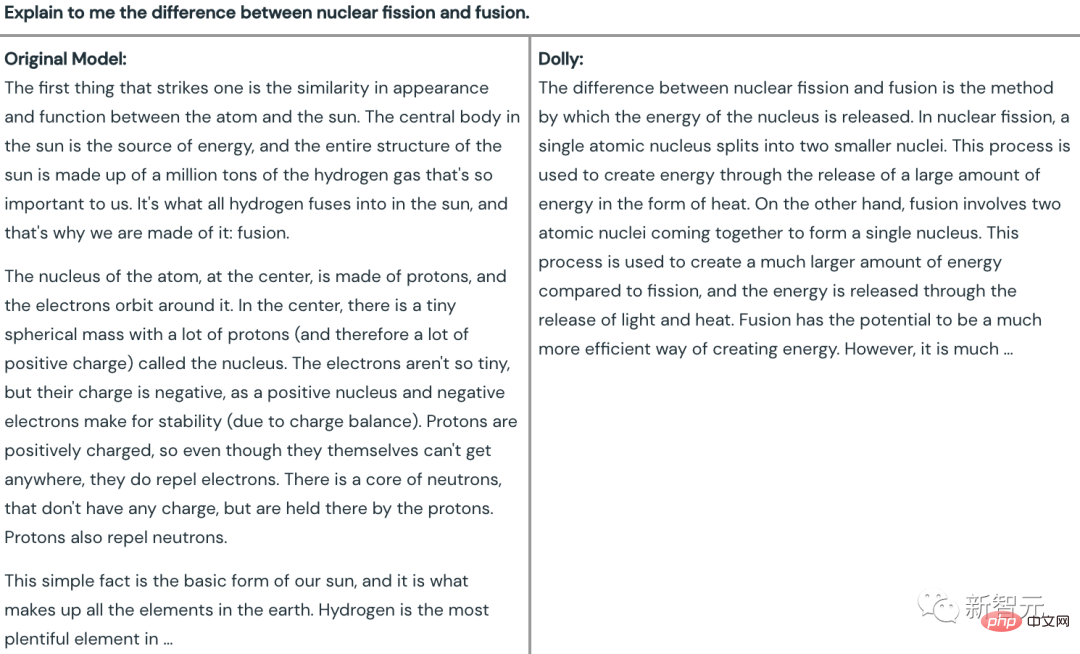

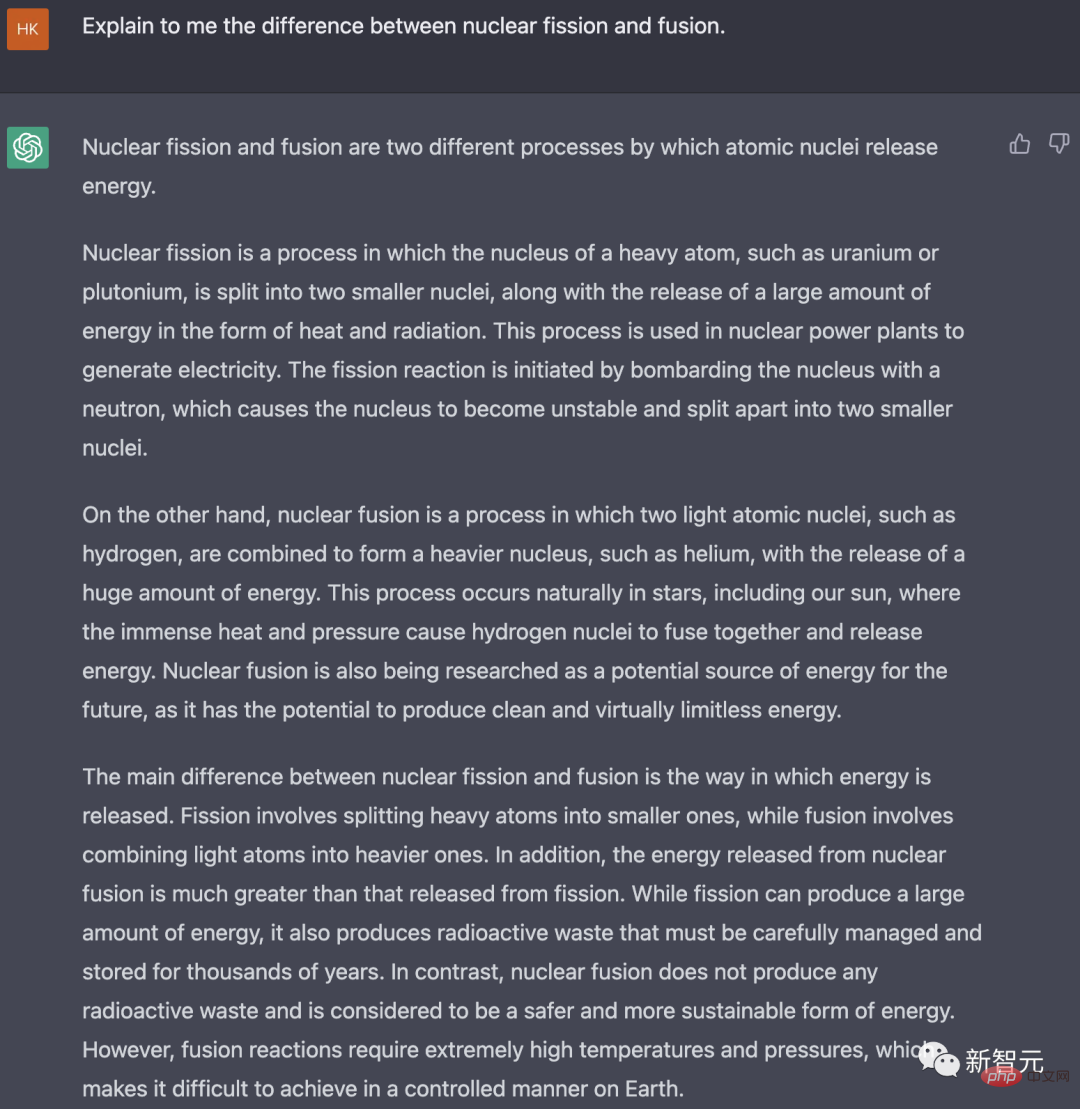

在事实性问题的问答测试上,团队选择了下面这个:「向我解释一下核裂变和核聚变之间的区别。」

先不管对错,GPT-J全篇都是在讲太阳如何如何,虽然提到了「聚变」这个词,但完全无视了「裂变」。

而Dolly第一句就直接点题——核裂变和核聚变的区别在于释放能量的方式,随后简单解释了他们的不同。

相比之下,ChatGPT给出的回答明显要更加翔实。

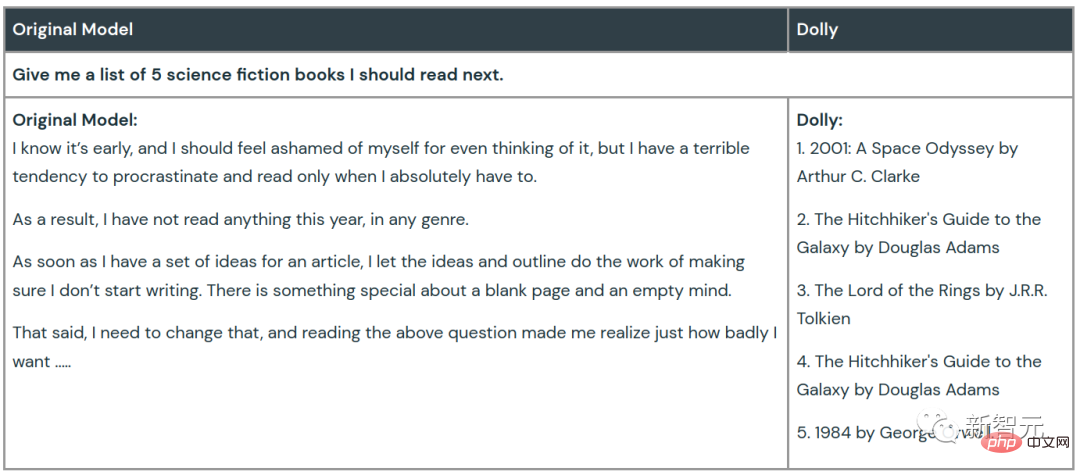

头脑风暴

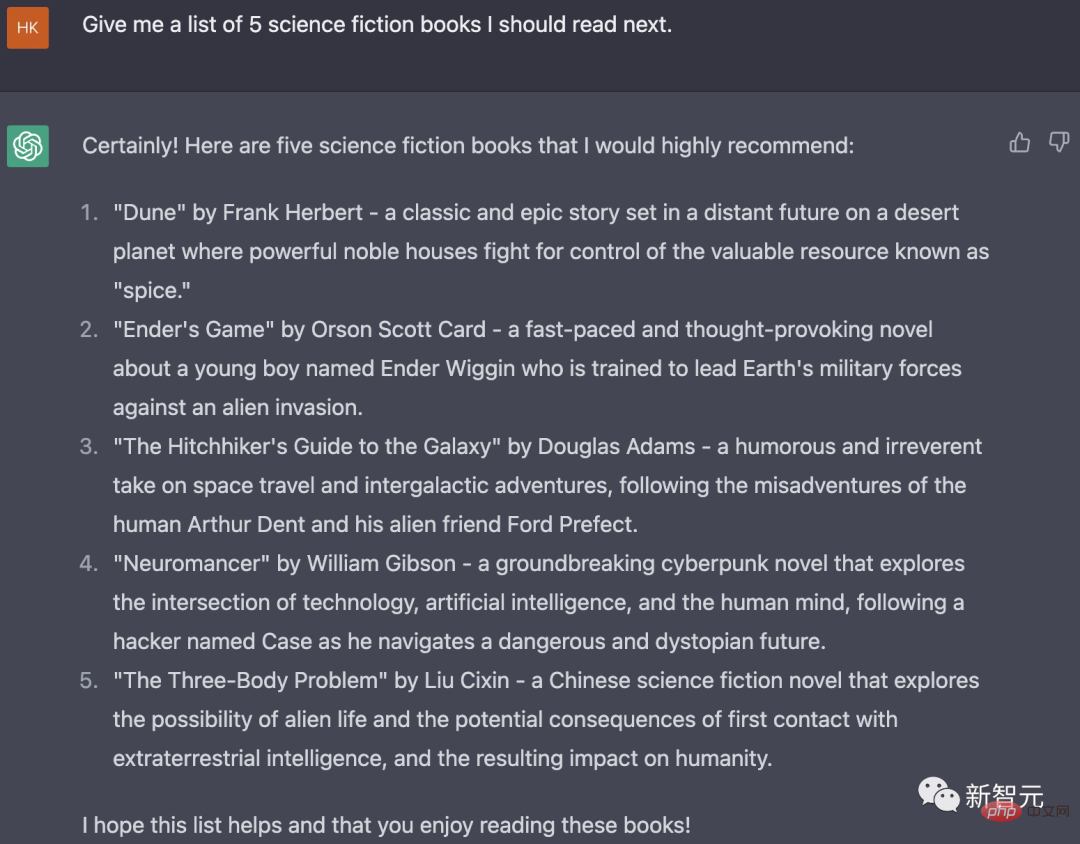

当让它们头脑风暴,给出应该阅读的五本科幻小说的名单,GPT-J则只是在喃喃自语,像是沉浸在了拖延阅读而产生的愧疚情绪中,完全回避了这个提问。

Dolly则一如既往的表现稳定,按照指令给出了5本科幻小说的书名及其作者。

ChatGPT对于该问题给出了更加丰富的回答,不仅包括书名和作者,还对每一本书的内容、类型作了简要评述和介绍。

你要Close,我就Open

对于很多公司而言,宁愿自己建立一个不那么强的模型,也不愿将数据发送给那些只提供API的大语言模型供应商。

其中一个重要原因便是,这些问题和数据集是公司最敏感和专有的知识产权,直接将其交给第三方显然是不靠谱的。

此外,公司自身可能在模型质量、成本和期望行为方面有不同的权衡,一种可定制化的语言模型更加符合需求。

现在,Dolly的发布给了他们希望——即便是一个「过时」的开源大型语言模型 (LLM),也能通过30分的训练,赋予它神奇的类似ChatGPT的指令跟随能力。

不难想象,大语言模型或许很快就不是AI巨头公司独占的玩法了!

正如公司CEO Ali Ghodsi所说,「我们的信念是,让全世界的每个组织都能利用这些技术。」

以上是0门槛克隆ChatGPT!30分钟训完,60亿参数性能堪比GPT-3.5的详细内容。更多信息请关注PHP中文网其他相关文章!

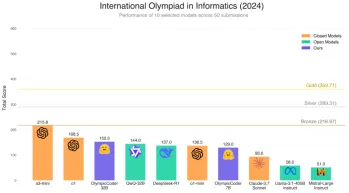

拥抱面部是否7B型号奥林匹克赛车击败克劳德3.7?Apr 23, 2025 am 11:49 AM

拥抱面部是否7B型号奥林匹克赛车击败克劳德3.7?Apr 23, 2025 am 11:49 AM拥抱Face的OlympicCoder-7B:强大的开源代码推理模型 开发以代码为中心的语言模型的竞赛正在加剧,拥抱面孔与强大的竞争者一起参加了比赛:OlympicCoder-7B,一种产品

4个新的双子座功能您可以错过Apr 23, 2025 am 11:48 AM

4个新的双子座功能您可以错过Apr 23, 2025 am 11:48 AM你们当中有多少人希望AI可以做更多的事情,而不仅仅是回答问题?我知道我有,最近,我对它的变化感到惊讶。 AI聊天机器人不仅要聊天,还关心创建,研究

Camunda为经纪人AI编排编写了新的分数Apr 23, 2025 am 11:46 AM

Camunda为经纪人AI编排编写了新的分数Apr 23, 2025 am 11:46 AM随着智能AI开始融入企业软件平台和应用程序的各个层面(我们必须强调的是,既有强大的核心工具,也有一些不太可靠的模拟工具),我们需要一套新的基础设施能力来管理这些智能体。 总部位于德国柏林的流程编排公司Camunda认为,它可以帮助智能AI发挥其应有的作用,并与新的数字工作场所中的准确业务目标和规则保持一致。该公司目前提供智能编排功能,旨在帮助组织建模、部署和管理AI智能体。 从实际的软件工程角度来看,这意味着什么? 确定性与非确定性流程的融合 该公司表示,关键在于允许用户(通常是数据科学家、软件

策划的企业AI体验是否有价值?Apr 23, 2025 am 11:45 AM

策划的企业AI体验是否有价值?Apr 23, 2025 am 11:45 AM参加Google Cloud Next '25,我渴望看到Google如何区分其AI产品。 有关代理空间(此处讨论)和客户体验套件(此处讨论)的最新公告很有希望,强调了商业价值

如何为抹布找到最佳的多语言嵌入模型?Apr 23, 2025 am 11:44 AM

如何为抹布找到最佳的多语言嵌入模型?Apr 23, 2025 am 11:44 AM为您的检索增强发电(RAG)系统选择最佳的多语言嵌入模型 在当今的相互联系的世界中,建立有效的多语言AI系统至关重要。 强大的多语言嵌入模型对于RE至关重要

麝香:奥斯汀的机器人需要每10,000英里进行干预Apr 23, 2025 am 11:42 AM

麝香:奥斯汀的机器人需要每10,000英里进行干预Apr 23, 2025 am 11:42 AM特斯拉的Austin Robotaxi发射:仔细观察Musk的主张 埃隆·马斯克(Elon Musk)最近宣布,特斯拉即将在德克萨斯州奥斯汀推出的Robotaxi发射,最初出于安全原因部署了一支小型10-20辆汽车,并有快速扩张的计划。 h

AI震惊的枢轴:从工作工具到数字治疗师和生活教练Apr 23, 2025 am 11:41 AM

AI震惊的枢轴:从工作工具到数字治疗师和生活教练Apr 23, 2025 am 11:41 AM人工智能的应用方式可能出乎意料。最初,我们很多人可能认为它主要用于代劳创意和技术任务,例如编写代码和创作内容。 然而,哈佛商业评论最近报道的一项调查表明情况并非如此。大多数用户寻求人工智能的并非是代劳工作,而是支持、组织,甚至是友谊! 报告称,人工智能应用案例的首位是治疗和陪伴。这表明其全天候可用性以及提供匿名、诚实建议和反馈的能力非常有价值。 另一方面,营销任务(例如撰写博客、创建社交媒体帖子或广告文案)在流行用途列表中的排名要低得多。 这是为什么呢?让我们看看研究结果及其对我们人类如何继续将

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

禅工作室 13.0.1

功能强大的PHP集成开发环境

SublimeText3汉化版

中文版,非常好用

MinGW - 适用于 Windows 的极简 GNU

这个项目正在迁移到osdn.net/projects/mingw的过程中,你可以继续在那里关注我们。MinGW:GNU编译器集合(GCC)的本地Windows移植版本,可自由分发的导入库和用于构建本地Windows应用程序的头文件;包括对MSVC运行时的扩展,以支持C99功能。MinGW的所有软件都可以在64位Windows平台上运行。

PhpStorm Mac 版本

最新(2018.2.1 )专业的PHP集成开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)