机器学习 (ML) 研究的多个子领域(如计算机视觉和自然语言处理)的许多最新进展,都是建立在利用大型、多样化的数据集和能够有效吸收所有数据的表达模型。

但这种高性能模型方法在机器人技术领域的应用却相对较少。

原因很简单,首先缺乏大规模和多样化的机器人数据,限制了模型吸收广泛机器人经验的能力。

其次,缺乏可从此类数据集中学习并有效泛化的表达力强、可扩展且速度足够快的实时推理模型。

而这次,谷歌推出的Robotics Transformer 1 (简称RT-1)是一种多任务模型,它可以标记机器人输入和输出动作(例如,相机图像、任务指令和电机命令)以在运行时实现高效推理,并使实时控制成为可能。

RT-1吸收了大量数据,让机器人胜任不同环境下的多种任务,从而提升机器性能和泛化能力

简单来说,就是让一个机器人同时干几份活。

该模型是在一个包含130k个episode的大型真实世界机器人数据集上训练的,该数据集涵盖700多项任务,使用Everyday Robots (EDR) 的13台机器人在17个月内收集而成。

结果表明,与现有技术相比,RT-1可以显著改进对新任务、环境和对象的零样本泛化。

Github链接小编也贴心地放在下面啦,有兴趣的小伙伴赶紧去看看。

https://github.com/google-research/robotics_transformer

RT-1模型具体原理

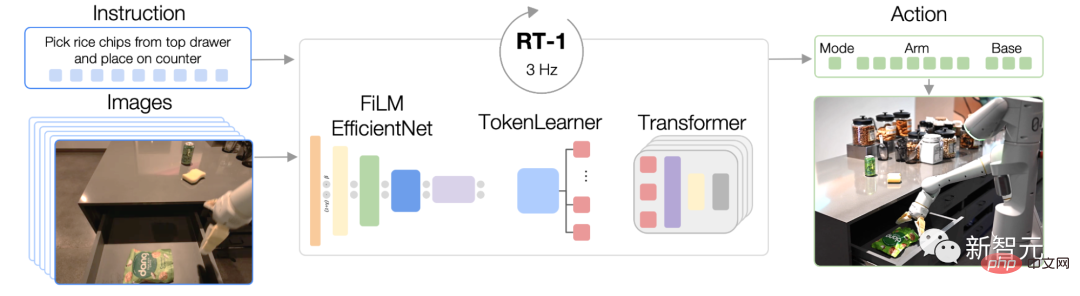

RT-1建立在Transformer架构上,它能从机器人的相机中获取图像历史记录并以自然语言表达的任务描述作为输入,同时直接输出标记化的动作。

RT-1的架构类似于仅解码器序列模型(decoder-only sequence model)的架构,该模型针对具有因果掩蔽的标准分类交叉熵目标进行训练。

该模型将文本指令和一组图像作为输入,通过预训练的 FiLM EfficientNet 模型将它们编码为标记,并通过 TokenLearner 对其进行压缩,然后经Transformer输出动作标记。

其主要功能包括:图像词元化(Image Tokenization)、动作词元化(Action Tokenization)和词元压缩(Token Compression )。

- 图像tokenization:我们通过在 ImageNet 上预训练的 EfficientNet-B3 模型传递图像,然后将生成的 9×9×512 空间特征图展平为81个标记。图像分词器以自然语言任务指令为条件,并使用初始化为身份的 FiLM 层在早期提取与任务相关的图像特征。

- 动作tokenization:机器人的动作维度是手臂运动的 7 个变量(x、y、z、滚动、俯仰、偏航、夹具打开),3 个基本运动变量(x、y、偏航),以及一个额外的离散变量在三种模式之间切换。

- Token压缩:该模型自适应地选择图像Token的软组合,这些组合可以根据它们对使用元素注意模块TokenLearner 进行学习的影响进行压缩,从而使推理速度提高2.4倍以上。

我们使用人类通过远程操作提供的演示,并用机器人执行指令的文本描述对每一集进行注释。

而这个机器人执行任务靠的是,「7个自由度的手臂、一个两指夹持器和一个移动底座」。

数据集中表示的一组高级技能包括拾取和放置物品、打开和关闭抽屉、将物品放入和取出抽屉、将细长的物品直立放置、将物体打翻等操作。

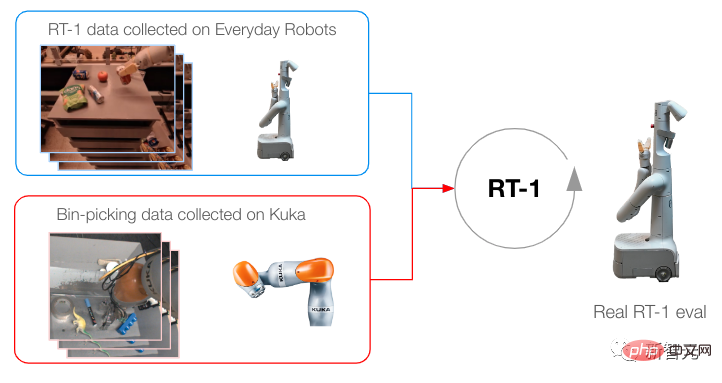

整合异质数据源

为进一步推动RT-1,我们使用从另一个机器人收集的数据对其进行训练,以测试 (1) 模型在出现新数据源时是否保持其在原始任务上的性能,以及 (2) 模型是否在泛化方面得到提升具有新的和不同的数据。

我们转换收集的数据以匹配我们使用EDR收集的原始数据集的动作规范和边界,并用任务指令标记每个数据集。

然后在每个训练批次中将Kuka数据与EDR数据以1:2的比例混合,以控制原始EDR技能的回归。

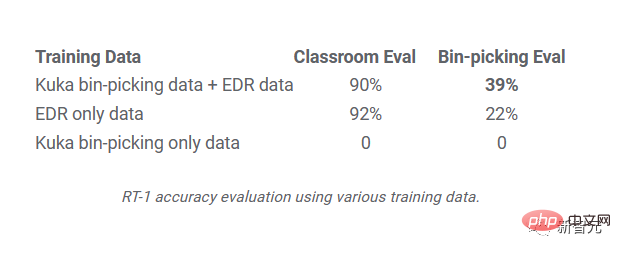

图为从多个机器人收集数据时的训练方法

结果表明,RT-1能够通过观察其他机器人的经验来获得新技能。

当RT-1在Kuka的垃圾箱拣选数据和机器人教室的现有EDR数据上进行训练时,仅使用 EDR 数据进行训练时的22% 「准确率跃升了近2倍」,达到39%。

当单独使用来自Kuka的拣选数据训练RT-1,并使用来自EDR机器人的拣选数据对其进行评估时,准确率为0%。

实验结果

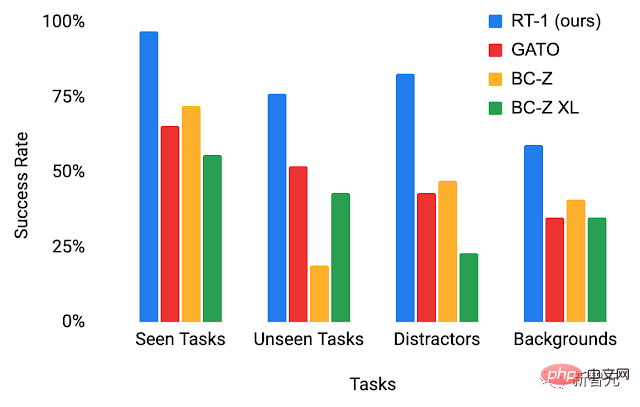

为更好地理解RT-1的泛化能力,我们针对三个基线研究了它的性能:Gato、BC-Z和BC-Z XL(即与 RT-1 具有相同数量参数的 BC-Z)。

并将其分为四个类别:

图为测试环境下RT-1与对照组的表现

- 可见任务表现(Seen tasks performance):在训练期间观测的任务表现;

-

不可见任务表现(Unseen tasks performance):在看不见的任务上的表现,其中技能和对象在训练集中是分开的;

- 稳健性(Robustness):在干扰因素介入期间的性能和背景变化(新厨房、照明、背景场景)的性能表现

- 远景场景(long-horizon scenarios):真实厨房中SayCan类自然语言指令的执行

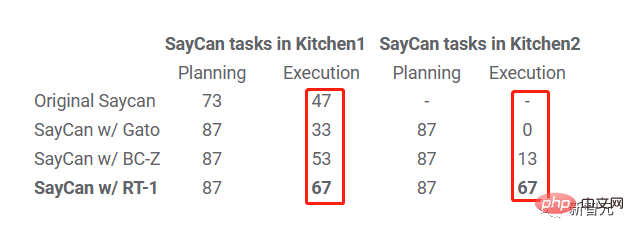

RT-1 的高性能和泛化能力可以通过SayCan实现远距离、移动操作任务。

SayCan的工作原理是将语言模型置于机器人可供性中,并利用少量提示将以自然语言表达的长期任务分解为一系列低级技能。

我们在两个真实厨房中使用RT-1和其他两个基线(SayCan with Gato 和 SayCan with BC-Z)评估SayCan。

下面,“Kitchen2”构成了比“Kitchen1”更具挑战性的泛化场景。用于收集大部分训练数据的模拟厨房是在 Kitchen1 之后建模的。

可以看到,SayCan with RT-1在 Kitchen1中的执行成功率为 67%,优于其他基线。

由于新的看不见的厨房带来的泛化困难,SayCan with Gato 和 SayCan with BCZ 的性能下降,但RT-1的成功率并没有因此下降。

以上是谷歌RT-1模型让一个机器人干几份活,700条指令成功率达97%的详细内容。更多信息请关注PHP中文网其他相关文章!

Markitdown MCP可以将任何文档转换为Markdowns!Apr 27, 2025 am 09:47 AM

Markitdown MCP可以将任何文档转换为Markdowns!Apr 27, 2025 am 09:47 AM处理文档不再只是在您的AI项目中打开文件,而是将混乱变成清晰度。诸如PDF,PowerPoints和Word之类的文档以各种形状和大小淹没了我们的工作流程。检索结构化

如何使用Google ADK进行建筑代理? - 分析VidhyaApr 27, 2025 am 09:42 AM

如何使用Google ADK进行建筑代理? - 分析VidhyaApr 27, 2025 am 09:42 AM利用Google的代理开发套件(ADK)的力量创建具有现实世界功能的智能代理!该教程通过使用ADK来构建对话代理,并支持Gemini和GPT等各种语言模型。 w

在LLM上使用SLM进行有效解决问题-Analytics VidhyaApr 27, 2025 am 09:27 AM

在LLM上使用SLM进行有效解决问题-Analytics VidhyaApr 27, 2025 am 09:27 AM摘要: 小型语言模型 (SLM) 专为效率而设计。在资源匮乏、实时性和隐私敏感的环境中,它们比大型语言模型 (LLM) 更胜一筹。 最适合专注型任务,尤其是在领域特异性、控制性和可解释性比通用知识或创造力更重要的情况下。 SLM 并非 LLMs 的替代品,但在精度、速度和成本效益至关重要时,它们是理想之选。 技术帮助我们用更少的资源取得更多成就。它一直是推动者,而非驱动者。从蒸汽机时代到互联网泡沫时期,技术的威力在于它帮助我们解决问题的程度。人工智能 (AI) 以及最近的生成式 AI 也不例

如何将Google Gemini模型用于计算机视觉任务? - 分析VidhyaApr 27, 2025 am 09:26 AM

如何将Google Gemini模型用于计算机视觉任务? - 分析VidhyaApr 27, 2025 am 09:26 AM利用Google双子座的力量用于计算机视觉:综合指南 领先的AI聊天机器人Google Gemini扩展了其功能,超越了对话,以涵盖强大的计算机视觉功能。 本指南详细说明了如何利用

Gemini 2.0 Flash vs O4-Mini:Google可以比OpenAI更好吗?Apr 27, 2025 am 09:20 AM

Gemini 2.0 Flash vs O4-Mini:Google可以比OpenAI更好吗?Apr 27, 2025 am 09:20 AM2025年的AI景观正在充满活力,而Google的Gemini 2.0 Flash和Openai的O4-Mini的到来。 这些尖端的车型分开了几周,具有可比的高级功能和令人印象深刻的基准分数。这个深入的比较

如何使用OpenAI GPT-Image-1 API生成和编辑图像Apr 27, 2025 am 09:16 AM

如何使用OpenAI GPT-Image-1 API生成和编辑图像Apr 27, 2025 am 09:16 AMOpenai的最新多模式模型GPT-Image-1彻底改变了Chatgpt和API的形象生成。 本文探讨了其功能,用法和应用程序。 目录 了解gpt-image-1 gpt-image-1的关键功能

如何使用清洁行执行数据预处理? - 分析VidhyaApr 27, 2025 am 09:15 AM

如何使用清洁行执行数据预处理? - 分析VidhyaApr 27, 2025 am 09:15 AM数据预处理对于成功的机器学习至关重要,但是实际数据集通常包含错误。清洁行提供了一种有效的解决方案,它使用其Python软件包来实施自信的学习算法。 它自动检测和

AI技能差距正在减慢供应链Apr 26, 2025 am 11:13 AM

AI技能差距正在减慢供应链Apr 26, 2025 am 11:13 AM经常使用“ AI-Ready劳动力”一词,但是在供应链行业中确实意味着什么? 供应链管理协会(ASCM)首席执行官安倍·埃什肯纳齐(Abe Eshkenazi)表示,它表示能够评论家的专业人员

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

Atom编辑器mac版下载

最流行的的开源编辑器

适用于 Eclipse 的 SAP NetWeaver 服务器适配器

将Eclipse与SAP NetWeaver应用服务器集成。

Dreamweaver Mac版

视觉化网页开发工具

VSCode Windows 64位 下载

微软推出的免费、功能强大的一款IDE编辑器

WebStorm Mac版

好用的JavaScript开发工具