機器學習技術在垃圾郵件偵測、語音辨識、翻譯和聊天機器人等領域中得到了廣泛應用。為了實現更好的性能和準確性,機器學習演算法透過從這些任務的資料中學習來進行訓練。然而,為了確保機器學習的有效性,數據必須具有代表性。此外,由於機器學習是一個不斷發展的領域,安全問題也成為了關注的焦點。在進行模型訓練之前,對資料集進行資料管理和預處理是必要的步驟。

在資料使用中的安全性方面,有兩個主要問題需要考慮。首先是數據不足的問題。如果我們所使用的資料不具代表性,那麼訓練出來的機器學習模型可能會產生偏差,並導致預測錯誤。因此,確保所使用的資料樣本能夠準確反映真實情況非常重要。 另一個問題是與工具、技術和流程相關的資料安全問題。在整個資料生命週期中,我們需要透過設計來解決這些問題。這意味著在資料收集、儲存、傳輸和處理的過程中,我們需要採取相應的安全措施,以保護資料的安全性和隱私性。這可能包括使用加密技術、存取控制和身份驗證機制,以及監控和稽核資料的使用。 綜上所述,為了確保資料使用的安全性,我們需要解決資料不足和與工具

#對抗訓練

##攻擊機器學習模型的目的是試圖愚弄模型,以繞過應用程式、API或智慧系統的主要目標。欺騙模型透過微小且難以察覺的輸入乾擾來實現。保護措施包括在對抗性範例的資料集上訓練模型或使用輸入清理等技術防禦手段。 透過對抗性範例進行訓練,該模型可以學習識別和防禦攻擊。這可能需要收集更多數據或使用過採樣或欠採樣等技術來平衡數據。 例如 代表性:模型在這次訓練後是否能很好地處理新資料? 準確性:模型是否使用最新資料進行訓練? 完整性:資料是否完整且沒有缺失值? 相關性:資料是否與要解決的問題相關? 輸入分析和轉換 輸入轉換涉及將輸入資料輸入模型之前對輸入資料進行應用轉換,這會使攻擊者更難製作有效的對抗性範例,因為轉換可能會改變輸入,使攻擊者更難以預測。異常檢測涉及識別數據中與正常行為的偏差。這可用於識別潛在的惡意輸入。離群值檢測涉及識別與其餘數據明顯不同的數據點。這可用於標記潛在的惡意資料。 總的來說,作為一個快速發展的領域,在使用模型做出重要決策的情況下,安全性尤其重要。機器學習模型更容易受到逆向工程的影響,在逆向工程中,攻擊者試圖對模型進行逆向工程以了解其工作原理或發現漏洞。由於新系統涉及結合多個模型的預測來做出最終預測,這可能會使攻擊者更難欺騙模型。以上是改善機器學習的安全性:策略與方法的詳細內容。更多資訊請關注PHP中文網其他相關文章!

AI遊戲開發通過Upheaval的Dreamer Portal進入其代理時代May 02, 2025 am 11:17 AM

AI遊戲開發通過Upheaval的Dreamer Portal進入其代理時代May 02, 2025 am 11:17 AM動盪遊戲:與AI代理商的遊戲開發徹底改變 Roupheaval是一家遊戲開發工作室,由暴風雪和黑曜石等行業巨頭的退伍軍人組成,有望用其創新的AI驅動的Platfor革新遊戲創作

Uber想成為您的Robotaxi商店,提供商會讓他們嗎?May 02, 2025 am 11:16 AM

Uber想成為您的Robotaxi商店,提供商會讓他們嗎?May 02, 2025 am 11:16 AMUber的Robotaxi策略:自動駕駛汽車的騎車生態系統 在最近的Curbivore會議上,Uber的Richard Willder推出了他們成為Robotaxi提供商的乘車平台的策略。 利用他們在

AI代理玩電子遊戲將改變未來的機器人May 02, 2025 am 11:15 AM

AI代理玩電子遊戲將改變未來的機器人May 02, 2025 am 11:15 AM事實證明,視頻遊戲是最先進的AI研究的寶貴測試理由,尤其是在自主代理商和現實世界機器人的開發中,甚至有可能促進人工通用情報(AGI)的追求。 一個

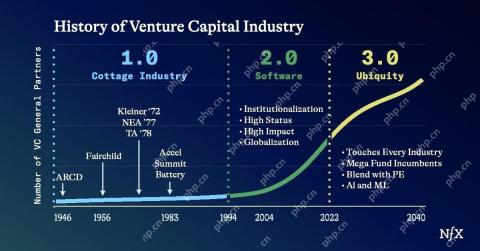

創業公司工業綜合體VC 3.0和James Currier的宣言May 02, 2025 am 11:14 AM

創業公司工業綜合體VC 3.0和James Currier的宣言May 02, 2025 am 11:14 AM不斷發展的風險投資格局的影響在媒體,財務報告和日常對話中顯而易見。 但是,對投資者,初創企業和資金的具體後果經常被忽略。 風險資本3.0:範式

Adobe在Adobe Max London 2025更新創意云和螢火蟲May 02, 2025 am 11:13 AM

Adobe在Adobe Max London 2025更新創意云和螢火蟲May 02, 2025 am 11:13 AMAdobe Max London 2025對Creative Cloud和Firefly進行了重大更新,反映了向可訪問性和生成AI的戰略轉變。 該分析結合了事件前簡報中的見解,並融合了Adobe Leadership。 (注意:Adob

Llamacon宣布的所有元數據May 02, 2025 am 11:12 AM

Llamacon宣布的所有元數據May 02, 2025 am 11:12 AMMeta的Llamacon公告展示了一項綜合的AI策略,旨在直接與OpenAI等封閉的AI系統競爭,同時為其開源模型創建了新的收入流。 這個多方面的方法目標bo

關於AI僅僅是普通技術的主張的釀造爭議May 02, 2025 am 11:10 AM

關於AI僅僅是普通技術的主張的釀造爭議May 02, 2025 am 11:10 AM人工智能領域對這一論斷存在嚴重分歧。一些人堅稱,是時候揭露“皇帝的新衣”了,而另一些人則強烈反對人工智能僅僅是普通技術的觀點。 讓我們來探討一下。 對這一創新性人工智能突破的分析,是我持續撰寫的福布斯專欄文章的一部分,該專欄涵蓋人工智能領域的最新進展,包括識別和解釋各種有影響力的人工智能複雜性(請點擊此處查看鏈接)。 人工智能作為普通技術 首先,需要一些基本知識來為這場重要的討論奠定基礎。 目前有大量的研究致力於進一步發展人工智能。總目標是實現人工通用智能(AGI)甚至可能實現人工超級智能(AS

模型公民,為什麼AI值是下一個業務碼May 02, 2025 am 11:09 AM

模型公民,為什麼AI值是下一個業務碼May 02, 2025 am 11:09 AM公司AI模型的有效性現在是一個關鍵的性能指標。自AI BOOM以來,從編寫生日邀請到編寫軟件代碼的所有事物都將生成AI使用。 這導致了語言mod的擴散

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。

Atom編輯器mac版下載

最受歡迎的的開源編輯器

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中