一、BERT模型能做什么

BERT模型是一种基于Transformer模型的自然语言处理模型,用于处理文本分类、问答系统、命名实体识别和语义相似度计算等任务。由于在多项自然语言处理任务中表现出色,BERT模型成为了当前最先进的预训练语言模型之一,因此受到广泛关注和应用。

BERT模型的全称是Bidirectional Encoder Representations from Transformers,即双向编码器转换器表示。相比于传统的自然语言处理模型,BERT模型具有以下几个显著优点:首先,BERT模型能够同时考虑前后文的上下文信息,从而更好地理解语义和语境。其次,BERT模型利用Transformer架构,使得模型能够并行处理输入序列,加快了训练和推断的速度。此外,BERT模型还通过预训练和微调的方式,能够在各种任务上实现更好的效果,并具有更好的迁移学

BERT模型是一种双向编码器,能够综合文本的前后上下文信息,更准确地理解文本的含义。

BERT模型通过无标注文本数据预训练,学习到更丰富的文本表示,提高下游任务表现。

Fine-tuning:BERT模型可通过微调来适应特定任务,这使得它可以在多个自然语言处理任务中应用,并且表现出色。

BERT模型在Transformer模型的基础上进行改进,主要有以下几个方面:

1.Masked Language Model(MLM):BERT模型在预训练阶段采用了MLM的方式,即对输入文本进行随机遮盖,然后让模型预测被遮盖的词是什么。这种方式强制模型学习上下文信息,并且能够有效地减少数据稀疏性问题。

2.Next Sentence Prediction(NSP):BERT模型还采用了NSP的方式,即在预训练阶段让模型判断两个句子是否是相邻的。这种方式可以帮助模型学习文本之间的关系,从而更好地理解文本的含义。

3.Transformer Encoder:BERT模型采用了Transformer Encoder作为基础模型,通过多层Transformer Encoder的堆叠,构建了深度的神经网络结构,从而获得更丰富的特征表示能力。

4.Fine-tuning:BERT模型还采用了Fine-tuning的方式来适应特定任务,通过在预训练模型的基础上微调模型,使其更好地适应不同的任务。这种方式在多个自然语言处理任务中都表现出了良好的效果。

二、BERT模型训练一次大概多久

一般来说,BERT模型的预训练需要花费数天到数周的时间,具体取决于以下因素的影响:

1.数据集规模:BERT模型需要大量的无标注文本数据进行预训练,数据集的规模越大,训练时间就越长。

2.模型规模:BERT模型的规模越大,需要的计算资源和训练时间就越多。

3.计算资源:BERT模型的训练需要使用大规模的计算资源,如GPU集群等,计算资源的数量和质量都会影响训练时间。

4.训练策略:BERT模型的训练还需要采用一些高效的训练策略,如梯度累积、动态学习率调整等,这些策略也会影响训练时间。

三、BERT模型的参数结构

BERT模型的参数结构可以分为以下几个部分:

1)词嵌入层(Embedding Layer):将输入的文本转化为词向量,一般使用WordPiece或BPE等算法进行分词和编码。

2)Transformer Encoder层:BERT模型采用多层Transformer Encoder进行特征提取和表示学习,每个Encoder包含多个Self-Attention和Feed-Forward子层。

3)池化层(Pooling Layer):将多个Transformer Encoder层的输出进行池化,生成一个固定长度的向量作为整个句子的表示。

4)输出层:根据具体的任务进行设计,可以是单个分类器、序列标注器、回归器等。

BERT模型的参数量非常大,一般采用预训练的方式进行训练,再通过Fine-tuning的方式在特定任务上进行微调。

四、BERT模型调优技巧

BERT模型的调优技巧可以分为以下几个方面:

1)学习率调整:BERT模型的训练需要进行学习率调整,一般采用warmup和decay等方式进行调整,使得模型能够更好地收敛。

2)梯度累积:由于BERT模型的参数量非常大,一次更新所有参数的计算量非常大,因此可以采用梯度累积的方式进行优化,即将多次计算得到的梯度进行累加,然后一次性对模型进行更新。

3)模型壓縮:BERT模型的規模很大,需要大量的運算資源進行訓練和推理,因此可以採用模型壓縮的方式來減少模型大小和計算量。常用的模型壓縮技術包括模型剪枝、量化和蒸餾等。

4)資料增強:為了提升模型的泛化能力,可以採用資料增強的方式,如隨機遮蓋、資料重複、字詞交換等方式,來擴充訓練資料集。

5)硬體最佳化:BERT模型的訓練和推理需要大量的運算資源,因此可以採用GPU或TPU等高效能硬體來加速訓練和推理過程,從而提高模型的訓練效率和推理速度。

6)Fine-tuning策略:針對不同的任務,可以採用不同的Fine-tuning策略來最佳化模型的效能,如微調層次、學習速率調整、梯度累積等方式。

總的來說,BERT模型是一種基於Transformer模型的預訓練語言模型,透過多層Transformer Encoder的堆疊和MLM、NSP等方式的改進,在自然語言處理方面取得了令人矚目的表現。同時,BERT模型也為其他自然語言處理任務的研究提供了新的思路和方法。

以上是深入解析BERT模型的詳細內容。更多資訊請關注PHP中文網其他相關文章!

特斯拉的Robovan是2024年的Robotaxi預告片中的隱藏寶石Apr 22, 2025 am 11:48 AM

特斯拉的Robovan是2024年的Robotaxi預告片中的隱藏寶石Apr 22, 2025 am 11:48 AM自2008年以來,我一直倡導這輛共享乘車麵包車,即後來被稱為“ Robotjitney”,後來是“ Vansit”,這是城市運輸的未來。 我預見這些車輛是21世紀的下一代過境解決方案Surpas

Sam俱樂部在AI上押注以消除收據檢查並增強零售Apr 22, 2025 am 11:29 AM

Sam俱樂部在AI上押注以消除收據檢查並增強零售Apr 22, 2025 am 11:29 AM革新結帳體驗 Sam's Club的創新性“ Just Go”系統建立在其現有的AI驅動“掃描和GO”技術的基礎上,使會員可以在購物旅行期間通過Sam's Club應用程序進行掃描。

Nvidia的AI Omniverse在GTC 2025擴展Apr 22, 2025 am 11:28 AM

Nvidia的AI Omniverse在GTC 2025擴展Apr 22, 2025 am 11:28 AMNVIDIA在GTC 2025上的增強可預測性和新產品陣容 NVIDIA是AI基礎架構的關鍵參與者,正在專注於提高其客戶的可預測性。 這涉及一致的產品交付,達到績效期望以及

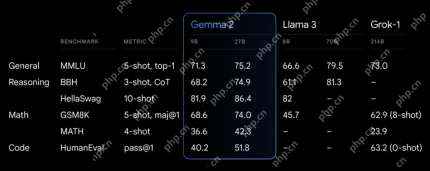

探索Google的功能Apr 22, 2025 am 11:26 AM

探索Google的功能Apr 22, 2025 am 11:26 AMGoogle的Gemma 2:強大,高效的語言模型 Google的Gemma語言模型家族以效率和性能而慶祝,隨著Gemma 2的到來而擴展。此最新版本包括兩種模型:270億個參數VER

下一波《 Genai:與Kirk Borne博士的觀點》 -Analytics VidhyaApr 22, 2025 am 11:21 AM

下一波《 Genai:與Kirk Borne博士的觀點》 -Analytics VidhyaApr 22, 2025 am 11:21 AM這一領先的數據劇集以數據科學家,天體物理學家和TEDX演講者Kirk Borne博士為特色。 Borne博士是大數據,AI和機器學習的著名專家,為當前狀態和未來的Traje提供了寶貴的見解

AI適合跑步者和運動員:我們取得了出色的進步Apr 22, 2025 am 11:12 AM

AI適合跑步者和運動員:我們取得了出色的進步Apr 22, 2025 am 11:12 AM這次演講中出現了一些非常有見地的觀點——關於工程學的背景信息,這些信息向我們展示了為什麼人工智能如此擅長支持人們的體育鍛煉。 我將從每位貢獻者的觀點中概括出一個核心思想,以展示三個設計方面,這些方面是我們探索人工智能在體育運動中應用的重要組成部分。 邊緣設備和原始個人數據 關於人工智能的這個想法實際上包含兩個組成部分——一個與我們放置大型語言模型的位置有關,另一個與我們人類語言和我們的生命體徵在實時測量時“表達”的語言之間的差異有關。 Alexander Amini 對跑步和網球都很了解,但他還

傑米·恩格斯特羅姆(Jamie Engstrom)關於卡特彼勒的技術,人才和轉型Apr 22, 2025 am 11:10 AM

傑米·恩格斯特羅姆(Jamie Engstrom)關於卡特彼勒的技術,人才和轉型Apr 22, 2025 am 11:10 AM卡特彼勒(Caterpillar)的首席信息官兼高級副總裁傑米·恩格斯特(Jamie Engstrom)領導了一支由28個國家 /地區的2200多名IT專業人員組成的全球團隊。 在卡特彼勒(Caterpillar)工作了26年,其中包括她目前的四年半,Engst

新的Google照片更新使任何具有Ultra HDR質量的照片流行Apr 22, 2025 am 11:09 AM

新的Google照片更新使任何具有Ultra HDR質量的照片流行Apr 22, 2025 am 11:09 AMGoogle Photos的新Ultra HDR工具:快速指南 使用Google Photos的新型Ultra HDR工具增強照片,將標準圖像轉換為充滿活力的高動態範圍傑作。對於社交媒體而言,此工具可提高任何照片的影響,

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

Dreamweaver Mac版

視覺化網頁開發工具

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中