人類的神經網路(腦)和人工神經網路(ANN)的關係是什麼?

有位老師曾經這樣比喻:就像是老鼠和米老鼠的關係。

現實中的神經網路功能強大,但與人類的感知、學習和理解方式完全不同。

例如ANN表現出人類感知中通常沒有的脆弱性,它們容易受到對抗性擾動的影響。

一個圖像,可能只需修改幾個像素點的值,或添加一些雜訊數據,

從人類的角度,觀察不到區別,而對於圖像分類網絡,就會識別成完全無關的類別。

不過,GoogleDeepMind的最新研究表明,我們之前的這種看法可能是錯的!

即使是數位影像的細微變化也會影響人類的感知。

換句話說,人類的判斷也會受到這種對抗性擾動的影響。

論文網址:https://www.nature.com/articles/s41467-023-40499-0

#GoogleDeepMind的這篇文章發表在《自然通訊》(Nature Communications)。

論文探討了人類是否也可能在受控測試條件下,表現出對相同擾動的敏感性。

透過一系列實驗,研究人員證明了這一點。

同時,這也顯示了人類和機器視覺之間的相似性。

對抗性圖像

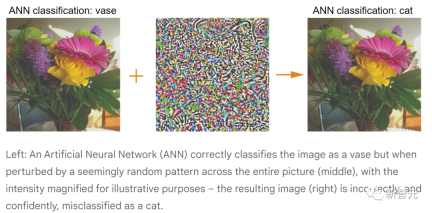

對抗性圖像是指對圖像進行微妙的更改,從而導致AI模型對圖像內容進行錯誤分類, ——這種故意欺騙被稱為對抗性打擊。

例如,攻擊可以有針對性地使AI模型將花瓶歸類為貓,或是除花瓶之外的任何東西。

上圖展示了對抗性攻擊的過程(為了便於人類觀察,中間的隨機擾動做了一些誇張)。

在數位影像中,RGB影像中的每個像素的取值在0-255之間(8位元深度時),數值表示單一像素的強度。

而對於對抗攻擊來說,對於像素值的改變在很小的範圍內,就可能達到攻擊效果。

在現實世界中,對實體物件的對抗性攻擊也可能成功,例如導致停車標誌被誤識別為限速標誌。

所以,出於安全考慮,研究人員已經在研究抵禦對抗性攻擊和降低其風險的方法。

對抗性影響人類感知

先前的研究表明,人們可能對提供清晰形狀線索的大幅度圖像擾動很敏感。

然而,更細緻的對抗性攻擊對人類有何影響?人們是否將影像中的擾動視為無害的隨機影像噪聲,它會影響人類的感知嗎?

為了找到答案,研究人員進行了受控行為實驗。

首先拍攝一系列原始影像,並對每個影像進行了兩次對抗性攻擊,以產生多對擾動影像。

在下面的動畫範例中,原始圖像被模型歸類為「花瓶」。

而由於對抗性攻擊,模型以高置信度將受到干擾的兩張影像進行錯誤分類,分別為「貓」和「卡車」。

接下來,人類參與者展示這兩張圖片,並提出了一個有針對性的問題:哪張圖片更像貓?

雖然這兩張照片看起來都不像貓,但他們不得不做出選擇。

通常,受試者認為自己隨意做出了選擇,但事實果真如此嗎?

如果大腦對微妙的對抗性攻擊不敏感,受試者選擇每張圖片的機率為50%。

然而實驗發現,選擇率(即人的感知偏差)要實實在在的高於偶然性(50%),而且實際上圖片像素的調整是很少的。

從參與者的角度來看,感覺就像他們被要求區分兩個幾乎相同的圖像。然而,先前的研究表明,人們在做出選擇時會利用微弱的感知訊號,——儘管這些訊號太弱而無法表達信心或意識。

在這個的例子中,我們可能會看到一個花瓶,但大腦中的一些活動告訴我們,它有貓的影子。

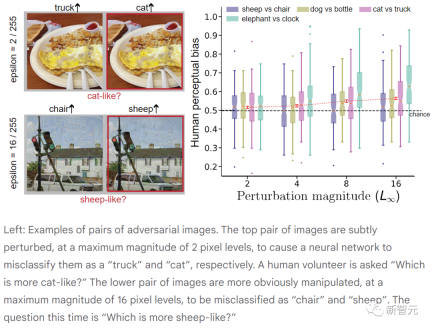

上圖展示了成對的對抗影像。最上面的一對影像受到微妙的擾動,最大幅度為2個像素,導致神經網路分別將它們錯誤地分類為「卡車」和「貓」。 (志工被問到「哪個更像貓?」)

下邊的一對圖像擾動更明顯,最大幅度為16像素,被神經網路錯誤地歸類為“椅子”和“羊”。 (這次的問題是「哪個更像綿羊?」)

在每個實驗中,參與者在一半以上的時間裡可靠地選擇了與目標問題相對應的對抗影像。雖然人類視覺不像機器視覺那樣容易受到對抗性擾動的影響,但這些擾動仍然會使人類偏向機器所做的決定。

如果人類的感知可能會受到對抗性圖像的影響,那麼這將是一個全新的但很關鍵的安全問題。

這需要我們深入研究探索人工智慧視覺系統行為和人類感知的異同,並建立更安全的人工智慧系統。

論文細節

產生對抗性擾動的標準程式從預先訓練的ANN分類器開始,該分類器將RGB圖像映射到一組固定類上的機率分佈。

對影像的任何變更(例如增加特定像素的紅色強度)都會對輸出機率分佈產生輕微變化。

對抗性影像透過搜尋(梯度下降)來獲得原始影像的擾動,該擾動導致ANN 降低分配給正確類別的機率(非針對性攻擊)或將高機率分配給某些指定的替代類別(針對性攻擊)。

為了確保擾動不會偏離原始影像太遠,在對抗性機器學習文獻中經常應用L (∞) 範數約束,指定任何像素都不能偏離其原始值超過±ε,ε通常遠小於[0–255] 像素強度範圍。

此約束適用於每個RGB顏色平面中的像素。雖然這種限制並不能阻止個體偵測到影像的變化,但透過適當選擇ε,在受擾動的影像中指示原始影像類別的主要訊號大多完好無損。

實驗

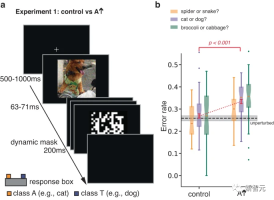

在最初的實驗中,作者研究了人類對短暫、遮蔽的對抗性圖像的分類反應。

透過限制暴露時間來增加分類錯誤,該實驗旨在提高個體對刺激物某些方面的敏感度,否則這些刺激物可能不會影響分類決策。

對真實類別T的影像進行了對抗性擾動,透過對擾動進行最佳化,使ANN傾向於將影像錯誤分類為A。參與者被要求在T和A之間做出強制選擇。

研究人員也在對照圖像上對參與者進行了測試,對照圖像是透過自上而下翻轉在A條件下獲得的對抗性擾動影像形成的。

這種簡單的轉換打破了對抗性擾動與影像之間像素到像素的對應關係,在很大程度上消除了對抗性擾動對ANN的影響,同時保留了擾動的規範和其他統計數據。

結果表明,與對照組影像相比,參與者更有可能將擾動影像判斷為A類別。

上面的實驗1使用了簡短的遮蔽演示,以限制原始影像類別(主要訊號)對反應的影響,從而揭示對抗性擾動(從屬訊號)的敏感性。

研究人員也設計了另外三個具有相同目標的實驗,但避免了大範圍擾動和有限曝光觀看的需要。

在這些實驗中,影像中的主要訊號無法系統性地引導反應選擇,從而使從屬訊號的影響得以顯現。

在每個實驗中,都會出現一對幾乎相同的未遮蔽刺激物,並且在選擇反應之前一直保持可見。這對刺激物具有相同的主導訊號,它們都是對同一底層影像的調製,但具有不同的從屬訊號。參與者需要選擇更像目標類別實例的圖像。

在實驗2中,兩個刺激物都是屬於T類的影像,其中一個經過擾動,ANN預測它更像T類,另一個經過擾動,被預測為更不像T類。

在實驗3中,刺激物是一幅屬於真實類別T的圖像,其中一幅被擾動以改變ANN的分類,使其向目標對抗類別A靠攏,另一則使用相同的擾動,但左右翻轉作為對照條件。

這種對照的作用是保留擾動的規範和其他統計量,但比實驗1中的對照更為保守,因為圖像的左右兩邊可能比圖像的上下部分具有更相似的統計量。

實驗4中的一對影像也是真實類別T的調製,一個被擾動得更像A類,一個更像第三類。試驗交替要求參與者選擇更像A的圖像,或更像第三類的圖像。

在實驗2-4中,每張影像的人類知覺偏差與ANN的偏差有顯著正相關。擾動幅度從2到16不等,小於先前對人類參與者研究的擾動,並且與對抗性機器學習研究中使用的擾動相似。

令人驚訝的是,即使是2個像素強度等級的擾動也足以可靠地影響人類感知。

實驗2的優點在於要求參與者做出直覺判斷(例如,兩個被擾動的貓圖像中哪一個更像貓) ;

然而,實驗2允許對抗性擾動僅透過銳利化或模糊影像,即可使影像或多或少像貓一樣。

實驗3的優點在於,配對了所比較的擾動的所有統計數據,而不僅僅是擾動的最大幅度。

但是,匹配擾動統計並不能確保擾動在添加到圖像中時同樣可感知,因此,參與者可能根據圖像失真進行選擇。

實驗4的優點在於,它證明了參與者對被問到的問題很敏感,因為相同的圖像對會根據提出的問題產生系統性不同的答案。

然而,實驗4要求參與者回答一個看似荒謬的問題(例如,兩個煎蛋捲圖像中的哪一個看起來更像貓?),導致問題解釋方式的可變性。

綜上所述,實驗2-4提供了趨於一致的證據,顯示即使擾動幅度非常小,且觀看時間不受限制,對人工智慧網路產生強烈影響的從屬對抗訊號,也會在相同方向影響人類的感知和判斷。

此外,延長觀察時間(自然感知的環境),是對抗性擾動產生實際後果的關鍵。

以上是谷歌DeepMind研究發現:對抗性攻擊可影響人類和AI的視覺識別,將花瓶誤認為貓!的詳細內容。更多資訊請關注PHP中文網其他相關文章!

優化您的組織與Genai代理商的電子郵件營銷Apr 13, 2025 am 11:44 AM

優化您的組織與Genai代理商的電子郵件營銷Apr 13, 2025 am 11:44 AM介紹 恭喜!您經營一家成功的業務。通過您的網頁,社交媒體活動,網絡研討會,會議,免費資源和其他來源,您每天收集5000個電子郵件ID。下一個明顯的步驟是

Apache Pinot實時應用程序性能監視Apr 13, 2025 am 11:40 AM

Apache Pinot實時應用程序性能監視Apr 13, 2025 am 11:40 AM介紹 在當今快節奏的軟件開發環境中,確保最佳應用程序性能至關重要。監視實時指標,例如響應時間,錯誤率和資源利用率可以幫助MAIN

Chatgpt擊中了10億用戶? Openai首席執行官說:'短短幾週內翻了一番Apr 13, 2025 am 11:23 AM

Chatgpt擊中了10億用戶? Openai首席執行官說:'短短幾週內翻了一番Apr 13, 2025 am 11:23 AM“您有幾個用戶?”他扮演。 阿爾特曼回答說:“我認為我們上次說的是每週5億個活躍者,而且它正在迅速增長。” “你告訴我,就像在短短幾週內翻了一番,”安德森繼續說道。 “我說那個私人

pixtral -12b:Mistral AI'第一個多模型模型 - 分析VidhyaApr 13, 2025 am 11:20 AM

pixtral -12b:Mistral AI'第一個多模型模型 - 分析VidhyaApr 13, 2025 am 11:20 AM介紹 Mistral發布了其第一個多模式模型,即Pixtral-12b-2409。該模型建立在Mistral的120億參數Nemo 12B之上。是什麼設置了該模型?現在可以拍攝圖像和Tex

生成AI應用的代理框架 - 分析VidhyaApr 13, 2025 am 11:13 AM

生成AI應用的代理框架 - 分析VidhyaApr 13, 2025 am 11:13 AM想像一下,擁有一個由AI驅動的助手,不僅可以響應您的查詢,還可以自主收集信息,執行任務甚至處理多種類型的數據(TEXT,圖像和代碼)。聽起來有未來派?在這個a

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

PhpStorm Mac 版本

最新(2018.2.1 )專業的PHP整合開發工具

禪工作室 13.0.1

強大的PHP整合開發環境

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器