Transformer架構已經橫掃了包括自然語言處理、電腦視覺、語音、多模態等多個領域,不過目前只是實驗效果非常驚艷,對Transformer工作原理的相關研究仍然十分有限。

其中最大謎團在於,Transformer為什麼只依靠一個「簡單的預測損失」就能從梯度訓練動態(gradient training dynamics)中湧現出高效的表徵?

最近田徑棟博士公佈了團隊的最新研究成果,以數學嚴格方式,分析了1層Transformer(一個自註意力層加一個解碼器層)在下一個token預測任務上的SGD訓練動態。

論文連結:https://arxiv.org/abs/2305.16380

#這篇論文打開了自註意力層如何組合輸入token動態過程的黑盒子,並揭示了潛在的歸納偏見的性質。

具體來說,在沒有位置編碼、長輸入序列、以及解碼器層比自註意力層學習更快的假設下,研究人員證明了自註意力就是一個判別式掃描演算法(discriminative scanning algorithm):

從均勻分佈的注意力(uniform attention)開始,對於要預測的特定下一個token,模型逐漸關注不同的key token,而較少關注那些出現在多個next token窗口中的常見token

#對於不同的token,模型會逐漸降低注意力權重,遵循訓練集中的key token和query token之間從低到高共現的順序。

有趣的是,這個過程不會導致贏家通吃,而是由兩層學習率控制的相變而減速,最後變成(幾乎)固定的token組合,在合成和真實世界的數據上也驗證了這種動態。

田淵棟博士是Meta人工智慧研究院研究員、研究經理,圍棋AI專案負責人,其研究方向為深度增強學習及其在遊戲中的應用,以及深度學習模型的理論分析。先後於2005年及2008年取得上海交通大學本碩學位,2013年獲得美國卡內基美隆大學機器人研究所博士學位。

曾獲2013年國際電腦視覺大會(ICCV)馬爾獎提名(Marr Prize Honorable Mentions),ICML2021傑出論文榮譽提名獎。

曾在博士畢業後發布《博士五年總結》系列,從研究方向選擇、閱讀積累、時間管理、工作態度、收入和可持續的職業發展等方面對博士生涯總結心得和體會。

揭秘1層Transformer

基於Transformer架構的預訓練模型通常只包含非常簡單的監督任務,例如預測下一個單字、填空等,但卻可以為下游任務提供非常豐富的表徵,實在令人費解。

之前的工作雖然已經證明了Transformer本質上就是一個通用近似器(universal approximator),但先前常用的機器學習模型,例如kNN、核SVM、多層感知機等其實也是通用近似器,這種理論無法解釋這兩類模型在效能上的巨大差距。

研究人員認為,了解Transformer的訓練動態(training dynamics)是很重要的,也就是說,在訓練過程中,可學習參數是如何隨時間變化的。

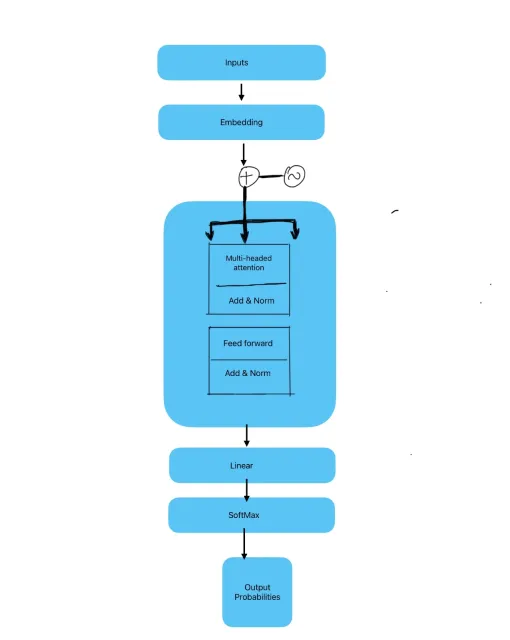

文章首先以嚴謹數學定義的方式,形式化描述了1層無位置編碼Transformer的SGD在下一個token預測(GPT系列模型常用的訓練範式)上的訓練動態。

1層的Transformer包含一個softmax自註意力層和預測下一個token的解碼器層。

在假設序列很長,而且解碼器的學習速度比自註意力層快的情況下,證明了訓練期間自註意力的動態行為:

1. 頻率偏差Frequency Bias

##模型會逐漸關注那些與query token大量共現的key token,而對那些共現較少的token降低注意力。

2. 判別偏差Discrimitive Bias

##模型更關注那些在下一個要預測的token中唯一出現的獨特token,而對那些在多個下一個token中出現的通用token失去興趣。這兩個特性表明,自註意力隱式地運行著一種判別式掃描(discriminative scanning)的演算法,並存在歸納偏差(inductive bias),即偏向於經常與query token共同出現的獨特的key token

此外,雖然自註意力層在訓練過程中趨向於變得更加稀疏,但正如頻率偏差所暗示的,模型因為訓練動態中的相變(phase transition),所以不會崩潰為獨熱(one hot)。

研究結果進一步表明,相變的開始是由學習率控制的:大的學習率會產生稀疏的注意力模式,而在固定的自註意力學習率下,大的解碼器學習率會導致更快的相變和密集的注意力模式。

研究人員將工作中發現的SGD動態命名為掃描(scan)和snap:

掃描階段:自註意力集中在key tokens上,即不同的、經常與下一個預測token同時出現的token;其他所有token的注意力都下降。

snap階段:注意力全中幾乎凍結,token組合固定。

以上是田淵棟新作:打開1層Transformer黑盒,注意力機制沒那麼神秘的詳細內容。更多資訊請關注PHP中文網其他相關文章!

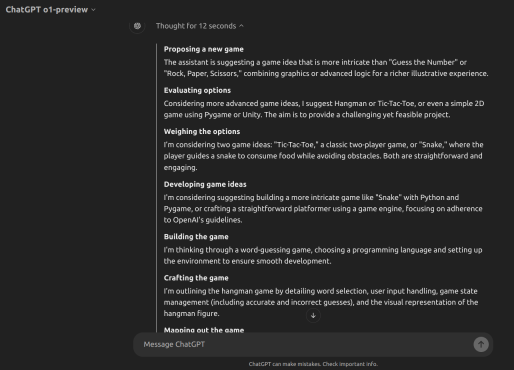

如何使用OpenAI O1構建遊戲? - 分析VidhyaApr 12, 2025 am 10:03 AM

如何使用OpenAI O1構建遊戲? - 分析VidhyaApr 12, 2025 am 10:03 AM介紹 OpenAI O1模型家族大大提高了推理能力和經濟表現,尤其是在科學,編碼和解決問題方面。 Openai的目標是創建越來越高的AI和O1模型

流行的LLM代理工具用於客戶查詢管理Apr 12, 2025 am 10:01 AM

流行的LLM代理工具用於客戶查詢管理Apr 12, 2025 am 10:01 AM介紹 如今,客戶查詢管理的世界正在以前所未有的速度移動,每天都有新的工具成為頭條新聞。大型語言模型(LLM)代理是在這種情況下的最新創新,增強了Cu

100天企業的AI實施計劃Apr 12, 2025 am 09:56 AM

100天企業的AI實施計劃Apr 12, 2025 am 09:56 AM介紹 採用生成AI可能是任何公司的變革旅程。但是,Genai實施過程通常會繁瑣且令人困惑。 Niit Lim的董事長兼聯合創始人Rajendra Singh Pawar

Pixtral 12B與QWEN2-VL-72BApr 12, 2025 am 09:52 AM

Pixtral 12B與QWEN2-VL-72BApr 12, 2025 am 09:52 AM介紹 人工智能革命引起了創造力的新時代,文本對圖像模型正在重新定義藝術,設計和技術的交集。 pixtral 12b和qwen2-vl-72b是兩個開創性的力量。

什麼是PaperQA?如何幫助科學研究?Apr 12, 2025 am 09:51 AM

什麼是PaperQA?如何幫助科學研究?Apr 12, 2025 am 09:51 AM介紹 隨著人工智能的發展,科學研究已經發生了巨大的轉變。每年在不同的技術和部門上發表數百萬篇論文。但是,將這片信息海洋瀏覽到Retr

數據學:對幻覺的LLM接地-Analytics VidhyaApr 12, 2025 am 09:46 AM

數據學:對幻覺的LLM接地-Analytics VidhyaApr 12, 2025 am 09:46 AM介紹 大型語言模型正在迅速改變行業 - 迄今為止,它們為從銀行業的個性化客戶服務到全球溝通中的實時語言翻譯提供了動力。他們可以回答任務

如何使用Crewai和Ollama建立多代理系統?Apr 12, 2025 am 09:44 AM

如何使用Crewai和Ollama建立多代理系統?Apr 12, 2025 am 09:44 AM介紹 不想在API上花錢,還是您擔心隱私?還是您只想在本地運行LLMS?不用擔心;本指南將幫助您使用本地LLMS構建代理和多代理框架

AV字節:Openai' apple apple and visual ai等 - 分析vidhyaApr 12, 2025 am 09:38 AM

AV字節:Openai' apple apple and visual ai等 - 分析vidhyaApr 12, 2025 am 09:38 AM介紹 本週,人工智能(AI)世界上充滿了重大更新。從OpenAI的O1模型展示高級推理到蘋果的開創性視覺智能技術,Tech

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Atom編輯器mac版下載

最受歡迎的的開源編輯器

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。