警惕四大AI新騙術!有人10分鐘被騙430萬

- PHPz轉載

- 2023-05-27 16:25:391340瀏覽

作者 | 吳菲凝 李水青

#編輯 | 心緣

#最近幾天,AI新騙局在全國炸開了鍋。

前有AI論文造假和新聞造假,後有疑似AI換臉的楊冪、迪麗熱巴出現在直播間賣貨。昨日內蒙古包頭的一起「AI電信詐騙10分鐘騙走430萬」登上微博熱搜,引起全民關注。

就在今早,一組引起美股大跌的五角大廈爆炸圖片被官方證實為假,疑似由AI合成。

隨著AI技術掀起新一波落地潮,AI深度偽造(DeepFake)內容在全球病毒式傳播,引起產業的強烈擔憂。

早在2019年,智東西就調查報道過深度偽造AI換臉黑產(《AI換臉黑產:100元打包200部換臉色情片,5張照片就可客製化影片》)近年來,深度偽造技術與反深度偽造技術的博弈持續不斷,相關部門也逐步完善監管法規。當下,隨著以GPT-4為代表的AI大模型技術迭代進化,深度偽造內容正捲土重來,在全球掀起更大的風浪。

從文章到圖片,從人聲到影片的動態效果都能被最大程度還原,瞞天過海騙過公眾,更有各種詐騙套路層出不窮、防不勝防。這些AI偽造內容對許多年輕人來說都真假難辨,老人、小孩更容易上當。而一旦他們的信任被不法份子用來違法犯罪,後果不堪設想。

有人工智慧技術專家告訴智東西,對於目前這些AI深度偽造技術產生的音視頻等內容,一般人用肉眼來鑑別的難度非常之大。

傳統騙局換上了一件由AI包裹的“新外衣”,更為隱蔽也更加讓人防不勝防。這些AI新騙局是如何騙人的?難辨真假的AI偽造內容要怎麼去識破?產業亂象又有什麼樣的解法?透過對市面上各種AI新騙術進行梳理分析,本文對這些問題進行了深入探討。

一、10分鐘換臉影片騙走430萬,這四大AI新騙局要警惕

今年3月,一份名為《暫停大型人工智慧研究》的公開信在未來生命研究所官網上發布,包括特斯拉CEO伊隆馬斯克(Elon Musk)、蘋果公司聯合創始人史蒂夫•沃茲尼亞克(Steve Wozniak)等人在內的千名科學家、企業高管簽字呼籲暫緩GPT-4以上版本的研發,他們矛頭所指都是強大AI技術可能的負面用途。

AI負面用途的爆發遠快於我們的想像。隨著AI技術能力加速迭代和落地,AI偽造變得更加容易、內容也更為逼真,隨之而來的是假新聞、假圖片絡繹不絕,變聲、換臉造成的惡性事件引發社會擔憂。很多人感到,「有圖有真相」、「眼見為實」的常識似乎受到了有史以來最猛烈的衝擊。

1、換臉影片:10分鐘騙走430萬

或許我們的身邊已經發生了不少由AI換臉引發的惡性事件,只是我們尚未察覺。

近日,內蒙古包頭市自治區公安局網偵部門偵破一起利用AI進行電信詐騙的案件,罪犯假借好友名義稱自己急需用錢,並撥打微信視頻聯繫這位受害者郭先生。

出於對好友的信任,再加上已經視訊聊天核實了對方的身份,郭先生放鬆了警惕,分兩筆匯款將430萬打到了罪犯的銀行卡上,但他萬萬沒想到所謂的微信視訊通話中的「好友」是由AI換臉技術製作而成的。罪犯利用AI換臉技術,佯裝成好友對他進行電信詐騙。目前在警方攔截下,已追回336.84萬元,仍有93.16萬元已被轉移走。

AI換臉是最容易獲取對方信任的一類詐騙手段,詐騙者往往利用AI技術換臉成受害者熟悉的人,並撥打電話和對方確認訊息。

面對這類新型詐騙方式,一是需要保護好個人訊息,不輕易提供任何涉及個人隱私的資訊給他人,不隨意點進陌生連結、下載陌生軟體;二是要透過各種管道核驗對方身份,對潛在風險保持警覺。

和「AI換臉」功能極為相似的是「AI脫衣」。早在今年3月,一則“女子地鐵照被AI一鍵脫衣傳播”的新聞沖上了熱搜,一名女性搭乘地鐵時的一張照片被人用AI軟體“一鍵脫衣”,遭到惡意傳播,罪犯也廣泛散步不實訊息對該女子進行污衊。

這樣的「一鍵脫衣」技術早在2019年就已在國外出現,但因廣泛的輿論爭議和聲討,計畫迅速關閉下架。這股不良之風在今年的AI熱中再次吹到國內,在網路上以「AI」、「換裝」、「軟體」等關鍵字組合搜尋時仍能出現不少隱藏極深的相關軟體,有心者甚至用此來製作、傳播色情淫穢視頻,AI視頻變裝服務已成為一門鏈條完整的黑色產業。

「AI換臉」在先前已被大量使用到影視劇二度創作、趣味惡搞影片、表情包製作當中,但其中隱藏的法律風險和侵權糾紛依舊不容忽視。近期,據企查官網資訊顯示,上海魚腥草資訊科技有限公司就因旗下一款換臉手機APP而遭多位網紅部落客起訴。

▲App Store中有近百款「AI換臉」應用程式

早些時候,一位名為“特效合成師洪亮”的視頻博主在自己的視頻中,將電視劇《你是我的榮耀》中男主演楊洋的臉,通過AI換臉技術換成了自己的臉,最後遭到主演粉絲的追打,因而引起了不少網友的注意。

▲「特效合成師洪亮」帳號上傳的部分AI合成換臉影片

這位影片部落客以換臉男明星為噱頭,實則是給自己的影視特效製作付費課程引流,但行為上已經給出演電視劇的演員迪麗熱巴、楊洋等人造成了侵權。 《狂飆》爆火之後,也有不少粉絲將劇情片段與電視劇版《西遊記》換臉進行二度創作,在傳播度和話題討論上為電視劇又貢獻了一波熱度,但卻對出演電視的演員造成了一定困擾。

蹭流量的行為,無論是對被換臉的明星,還是對技術充滿好奇的公眾,都產生了不良的影響和困擾,娛樂和技術之間的界限不應模糊至此。

2、聲音合成:復刻人聲瞞天過海

#前有「AI孫燕姿」爆火,後有AI人聲克隆闖入配音圈,AI的聲音合成技術被炒得火熱,也衍生出不少的惡性事件和相關受害者。

一位網友用美國知名歌手弗蘭克·奧什(Frank Ocean)的歌曲片段訓練出來仿冒其音樂風格的歌曲,並在地下音樂論壇上發布欄這些“音樂作品”,還將這些歌曲偽造成是在錄音時不小心洩漏的版本,最後蒙混過關,賣出了近970美元(折合為6700元人民幣)的價格。

不久之前,西班牙的一家電影製作公司Peabody Films也遭受了AI電話的詐騙,詐騙者偽裝成著名演員“卷福”本尼迪克特•康伯巴奇(Benedict Cumberbatch)向公司稱對公司的電影很感興趣,有合作意向,但需要公司先轉20萬英鎊(折合約170萬人民幣)的定金,之後再談具體的合作細節。

電影公司意識到了事情的不對勁,向該演員的經紀公司進行求證才發現從頭到尾就是一場AI騙局。

海外還有不少利用AI克隆聲音進行詐騙勒索的新聞,部分案件涉案金額令人咋舌,高達百萬美金。這類詐騙者往往透過電話錄音等素材提取某人的聲音進行聲音合成,再利用偽造後的聲音來騙過熟人,就這需要公眾對陌生電話保持警惕,即使是熟人也可能被偽造聲音。

美國CBS電視台的電視新聞雜誌節目60 Minutes在5月22日的最新一期節目中,現場展示了黑客是怎樣克隆聲音來騙過同事,並成功竊取護照信息的。

▲60 Minutes在推特中上傳了完整影片

只花了5分鐘時間,駭客就透過AI克隆複製了Sharyn的聲音,並透過工具替換了手機上來電顯示的名稱,成功騙過了她的同事,輕易地得到了她的姓名、護照號碼等私人資訊。

3、偽造照片:川普“被捕”,教宗穿著羽絨衣走秀

在AI換臉影片鋪天蓋地傳播的情況下,AI假照片更是氾濫成災。

美東時間5月22日,一張五角大廈附近地區發生爆炸的圖片在社群媒體上瘋傳。這張假照片的廣泛流傳,甚至導致標普500指數短線下跌約0.3%至盤中低點,由漲轉跌。

隨後美國國防部發言人立即證實,這同樣是一張由AI生成的虛假圖片,這張圖具有明顯的AI生成特徵,比如路燈有些歪,圍欄長在了人行道上等。

Midjourney生成的90年代情侶寫真已經讓網友真假難辨,3月時幾張前美國總統川普被捕的組圖在推特上瘋傳。

照片中的川普被警察包圍,又按倒在地,看起來狼狽又慌亂。在聽證會上,他掩面痛哭,還在潮濕陰暗的囚房中穿上了獄服。這些圖片是由公民記者網站Bellingcat的創辦人艾略特·希金斯(Eliot Higgins)以Midjounrney製作。組圖發出後,他的帳號也隨之被封查。

▲一組由Midjounrney產生的川普「被捕」圖

「川普被捕圖」發出不久之後,教宗方濟各穿著巴黎世界羽絨衣走秀的照片在網路上引起軒然大波,發出不久後便有了2800多萬的點擊量,讓不少網友都信以為真。

▲教宗身著巴黎世家羽絨外套走秀

創作者巴勃羅·澤維爾(Pablo Xavier)稱,自己完全沒想到這組圖片居然會走紅,自己只是突然想到了巴黎世家的羽絨服、巴黎或者羅馬的街道等。

Reddit論壇上的Midjourney板塊中,一組「2001年卡斯卡迪亞9.1級大地震,引發的海嘯摧毀了俄勒岡州」被大面積傳播,照片當中的受災現場一片混亂,救災人員、新聞記者、政府官員等人相繼出現,人們面帶憂慮、驚恐和慌張。但實際上這完全是一張AI引發的“災難”,歷史上並不存在。而這些要素齊全、顏色真實的圖片場景讓人看起來難辨真偽。

4、編撰新聞:AI成為謠言砲製機

#5月7日,甘肅省平涼市公安局網安大隊偵破了一起AI炮製假訊息的案件。

據悉,犯罪利用ChatGPT將自己從全網蒐集而來的社會熱點新聞修改編輯,編撰出一條「今晨甘肅一火車撞上修路工人致9人死亡」的虛假新聞,藉此來取得網路流量和關注度來變現。

這則新聞一經發布後便獲得了超1.5萬點擊量,好在警方在輿論進一步發酵前介入調查,證實是犯罪嫌疑人利用AI技術進行的新聞造假。

不光是讀者們需要鑑別釣魚網站中的AI假新聞,老牌媒體有時也會被AI假新聞矇騙。

英國《每日郵報》(The DailyMail)曾在4月24日刊登過一則新聞,稱“一位22歲的加拿大男子為在韓國以偶像身份出道而整容12次,最終喪命” 。

▲報道稱,為了在即將上映的美劇中扮演韓流明星BTS組合中的Jimin,22歲的加拿大演員花了2.2萬美元做了12次整形手術,最終不幸身亡

這則新聞引起全球多家媒體關注,韓國YTN新聞頻道等電視台迅速跟進報道,網友們對此也表示了自己的同情與惋惜。

▲網友對其離世的消息表示惋惜

#

然而事情在一位駐韓記者以及美國廣播電台iHeartRadio提出質疑後全面反轉:該男子可能壓根就不存在。網友將其照片拿去AI內容檢測網站查證後發現,照片有75%的可能性是AI生成的,韓國MBC電視台求證警方後也得到了「未收到類似死亡案例報告」的回复,這則新聞立刻被證實為「AI造假新聞」。

但是事情還沒結束,本月初,該男子的家人決定起訴報道過「假新聞」的媒體以及男子所屬的經紀公司,還有第一位宣稱男子已死亡的記者。言下之意就是,照片並非是AI生成的,男子的確因整容過度而引發的手術併發症而喪命。

多家媒體在未經核實身份,也沒手握實質性證據的情況下,稱該男子的身份和信息都是編纂的,讓一場由AI引發的鬧劇徹底變為了一場慘痛的悲劇。

這些由AI編篡出的新聞不僅混淆了大眾的視聽,更是讓本就沒有時間和耐心看清事情全貌的路人們失去了分辨真相的能力。

二、被「AI」過的明星們:「AI孫燕姿」翻唱爆火,「AI楊冪」換臉賣貨

#當AI科技氾濫時,演藝圈明星成了首當其衝的重災區。

近日爆火的孫燕姿在昨晚對「AI孫燕姿」的出現發長文給予回應。

▲孫燕姿回應「AI孫燕姿」的出現(中文翻譯版)

她對於「AI孫燕姿」的出現採取了較寬容的態度,並未透過法律手段進行追究。她說:「無法跟一個沒幾分鐘就能推出一首新專輯的『人』來比。」她認為,雖然它(AI)既沒有情緒,也沒有音調的變化,但人類再怎麼快也無法超越它。

從回應中不難看出,雖然孫燕姿對AI生成的音樂並不欣賞,但人類確實難以在一時之間趕上機器人的學習能力,她選擇對這些熱歌翻唱視頻淡然處之。

最早是因為AI翻唱而重新進入大眾視野的歌手孫燕姿,因其獨特的音色和唱腔風格和多首熱門歌曲都有極高的適配度,在網友的AI技術下,她“翻唱”的《發如雪》《下雨天》《我記得》等歌曲播放量均破百萬。

▲「AI孫燕姿」播放量排行靠前的幾首歌曲

而孫燕姿也並非是唯一被「AI翻唱」的歌手,還有AI周杰倫、AI王心凌、AI騰格爾等人陸續出現。

儘管孫燕姿選擇不追究法律責任,但當AI技術已經濫用到損害商業利益、觸及法律紅線時,還需要及時維護自己的正當權益。

根據中國新聞網報道,近日,有多個直播間都開始採用AI換臉明星的方式進行直播帶貨,女明星如楊冪、迪麗熱巴、Anglebaby等人成了重點換臉對象,明星臉的帶貨主播能達到更好的引流效果,並節省廣告宣傳成本,消費者或明星粉絲可能會衝著明星效應進行消費而被坑騙。

據提供換臉服務的網站介紹,購買現成模型,如果素材充足的話,只用半個小時到幾個小時的事件就能直接合成長達幾小時的視頻,全套模型的購買價格為3.5萬元,遠低於邀請一位明星本人直播帶貨的報價。

在幾大主流電商平台中,「AI換臉」「視訊換臉」等關鍵字都被平台屏蔽,但透過轉換搜尋關鍵字以及其他方式仍能找到不少相關商品。

AI換臉技術並非是近期才興起。早在2017年,一位名為DeepFake網友將情色電影中的女主角換臉成好萊塢明星蓋爾加朵(Gal Gadot),這是AI換臉技術首次出現在公眾視野當中。後來由於大量投訴者表示不滿,其帳號被官方封禁,而此後的AI換臉技術則以他的名字命名為“DeepFake”。

AI換臉真正在國內火起來是在2019年初,一段透過AI技術將《射雕英雄傳》中黃蓉扮演者朱茵的臉替換為楊冪的影片在網路上熱傳,有網友表示毫無違和感,也有網友提出可能會侵犯原扮演者的肖像權,製作者肖先生對此回應稱:主要適用於技術交流,不會用於營利行為。

▲網友將演員朱茵在《射雕英雄傳》中扮演的「黃蓉」一角替換為演員楊冪的臉

這也成為國內使用AI進行影視劇二創的早期開端。

AI技術如今早已被不法分子盯上,並用於各類層出不窮的換臉花樣上,不止是娛樂圈明星,也有不少普通人被所謂的「私密照片」敲詐勒索。多位網路安全部門的民警稱,AI深度合成技術在先前因為缺乏監管,造成了不少資訊安全隱患和網路傳播亂象,甚至間接導致了刑事案件的發生。

三、一場大型AI普法運動興起,哪些行為侵權違法了?

許多人的肖像、聲音在未經允許的情況下被傳播,影音產品在未談版權的情況下被拿來使用牟利,更有甚者是違法行為利用偽造信息進行財產詐騙甚至綁架勒索,損害人們的人身及財產權益。

面對這些更惡劣的情況,人們需要拿起法律的武器來保護自己,由此而來的將是一場有利於產業發展的大型AI普法運動。

臉部和聲音的偽造橫行,首先面臨的是個人隱私侵權問題。根據《民法典》第一千零一十九條:「任何組織或個人不得以醜化、污損,或利用資訊科技手段偽造等方式侵害他人的肖像權。未經肖像權人同意,不得製作、使用、公開肖像權人的肖像,但是法律另有規定的除外。」同時,「對自然人聲音的保護,參照適用肖像權保護的有關規定。」而讓人們更擔心的是,偽造資訊如果落到不發分子手裡,可能會進一步利用信任侵害人們的財產權甚至是健康權。

除了人身權利,AI偽造內容涉及的影音素材的版權侵權問題也備受關注。近期,歌手孫燕姿發文稱表示了對“AI孫燕姿”淡然處之,但更多的被偽造的人選擇拿起法律武器保護自己,比如據媒體報道,上海魚腥草信息科技有限公司因某款換臉手機APP被多位網紅部落客起訴。

上海大邦律師事務所資深合夥人、智慧財產權律師遊雲庭撰文稱,根據智慧財產權法律,用真人語音訓練人工智慧並產生歌曲,如果不做商用,大概率不侵權,但發佈在網路上還是應先拿到相關的詞曲著作權、伴奏音樂、影片使用素材的授權。人工智慧生成的作品有先天的版權瑕疵,不應享有著作權並收取授權費用。使用者使用人工智慧生成的作品如果被他人侵權,可以依據《反不正當競爭法》維權。

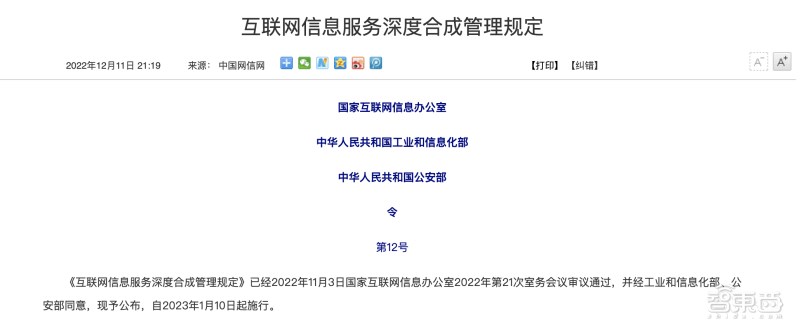

實際上,我國一些人工智慧領域的專門法規也已有規定。國家網信辦等部門已在2022年12月頒布《網路資訊服務深度合成管理規定》,以25條規定劃定深度合成技術使用規範,包括不得利用深度合成服務侵犯他人合法權益等法律、應用程式分發平台應落實上架審核、服務提供及技術支持者應加強技術管理等規定。

就在4月11日,國家網路資訊辦公室又迅速起草了《生成式人工智慧服務管理辦法(徵求意見稿)》,涉及的生成式人工智慧包括基於演算法、模型、規則生成文字、圖片、聲音、影片、程式碼等內容的技術,可以說是對當下的AI偽造進行了全面的規定。 (《重磅!首個國家AIGC監管文件,生成式AI服務管理辦法公佈徵求意見稿》)

此外,我國頒布的《中華人民共和國網路安全法》、《中華人民共和國資料安全法》、《中華人民共和國個人資訊保護法》、《網路資訊服務管理辦法》等法律、行政法規程度都對此有所規定,可以成為維護合法權益的相關依據。

四、一般人有AI內容辨識“防禦術”,平台要負起責任

「造假」和「打假」並不是因為AI而產生,但今天的AI技術讓「造假」變得更容易且更難分辨。面對鋪面而來的AI偽造內容,人們自己有沒有能夠辨識的技巧?

知名安全公司瑞萊智慧RealAI聯合創始人、演算法科學家蕭子豪告訴智東西,目前深度偽造技術不斷進化,生成的聲音和視頻越來越逼真,普通人肉眼鑑別的難度非常大。

「一般人如果遇到這類情況,可以在影片時有意識地引導對方做一些動作,如:大幅度的搖頭或張嘴。如果騙子技術手段較弱,那麼我們有可能發現對方臉部邊緣或牙齒的瑕疵,從而識別出AI換臉。不過,這個方法對於識別出'高水平'的詐騙分子,還存在難度。此外,還可以追問幾個只有你與借款者之間才知道的私密信息,來核實對方身分。」

「在防止自己上當受騙的同時,還要注意保護好個人圖像,盡量避免在公開平台大量曬自己的照片和視頻,給不法分子提供便利。因為,深偽視頻製作的原材料是個人圖片、視頻,這些數據越多訓練出的視頻也就越逼真、越難以鑑別。」蕭子豪補充說。

AI讓騙局和錯誤訊息變得更加難以被發現,科技公司及內容分發平台的審核把關變得更加重要。

蘋果公司聯合創始人史蒂夫·沃茲尼亞克(Steve Wozniak)最近在一次採訪中警告稱,AI內容應該被明確標記,並且需要對該行業進行監管。任何由AI生成內容都應該由發布者來承擔責任,但不代表大型科技公司可以逃脫法律制裁,沃茲尼亞克認為,監管機構應該追究大型科技公司的責任。

根據我國頒布的《網路資訊服務深度合成管理規定》,內容提供者需依照對產生的圖片、影片等內容進行識別等。實際上,我們已經看到小紅書等國內社群平台標記了疑似AI生成內容,能起到一定預防作用。但AI生成內容的最後一個關口還在用戶自己,媒體平台只能扮演一個過濾角色。

結語:抵制負面應用,AI攻防戰打響

#不斷進化的AI技術讓文字、圖像、影片的生成變得更容易、更逼真,同時深度偽造內容也隨之氾濫。深度偽造內容輕則混淆視聽、被有心者用以謀利,重則可能被不法分子利用進行詐騙甚至勒索犯罪,引起了人們對AI生成內容監管的迫切關注。

隨著AI詐騙新套路引起社會問題,產業中的使用者、技術提供者和營運商、內容分發平台及內容生產者都需要加強自律。實際上,我國已經提前頒布了一系列相關法律法規,AI負面應用問題的暴露有望帶來一場全民的技術普法運動,從而促進產業更健康發展。

以上是警惕四大AI新騙術!有人10分鐘被騙430萬的詳細內容。更多資訊請關注PHP中文網其他相關文章!