目錄:

- #Composer: Creative and Controllable Image Synthesis with Composable Conditions

- Structure and Content-Guided Video Synthesis 與 Diffusion Models

- The connectome of an insect brain

- Uncertainty-driven dynamics for active learning of interatomic potentials

- Combinatorial synthesis for AI-driven materials discovery

- Masked Images Are Counterfactual Samples for Robustine -tuning

- One Transformer Fits All Distributions in Multi-Modal Diffusion at Scale

- ArXiv Weekly Radiostation:NLP、CV、ML 更多精選論文(附音訊)

論文1:Composer: Creative and Controllable Image Synthesis with Composable Conditions

- #作者:Lianghua Huang 等

- #論文網址:https://arxiv.org/pdf/2302.09778v2.pdf

摘要:在AI 繪畫領域,許多研究者都在致力於提升AI 繪畫模型的可控性,也就是讓模型生成的圖像更加符合人類要求。前段時間,一個名為 ControlNet 的車型將這種可控性推上了新的高峰。大約在同一時間,來自阿里巴巴和螞蟻集團的研究者也在同一領域做出了成果,本文是這項成果的詳細介紹。

#建議:AI 繪畫新想法:國產開源50 億參數新模型,合成可控性、品質實現飛躍。

論文2:Structure and Content-Guided Video Synthesis 與 Diffusion Models

- 作者:Patrick Esser 等

- #論文網址:https://arxiv.org/pdf/2302.03011.pdf

#摘要:

相信很多人已經領會過生成式AI 技術的魅力,特別是在經歷了2022 年的AIGC 爆發之後。以Stable Diffusion 為代表的文本到圖像生成技術一度風靡全球,無數用戶湧入,借助AI 之筆表達自己的藝術想像……

近日,曾參與創建Stable Diffusion 的Runway 公司推出了一個新的人工智慧模型“Gen-1”,該模型透過應用文字prompt 或參考圖像指定的任何風格,可將現有影片轉化為新影片。例如將「街上的人」變成「黏土木偶」,只需要一行 prompt。

- 推薦:加上特技只需一句話or 一張圖,Stable Diffusion 的公司把AIGC 玩出了新花樣。

- 論文3:The connectome of an insect brain

作者:MICHAEL WINDING 等

###論文網址:https://www.science.org/doi/10.1126/science.add9330############ #########摘要:###研究人員完成了迄今為止最先進的昆蟲大腦圖譜,這是神經科學領域的里程碑式成就,使科學家更接近對思考機制的真正理解。 ######由約翰斯・霍普金斯大學和劍橋大學領導的國際團隊製作了一張驚人的詳細圖譜,描繪了果蠅幼蟲大腦中的每一個神經連接,這是一個與人類大腦相當的原型科學模型。該研究可能會支持未來的大腦研究並激發新的機器學習架構。

#推薦:迄今為止最全昆蟲大腦圖譜,可能激發新的機器學習架構。

論文4:Uncertainty-driven dynamics for active learning of interatomic potentials

- 作者:Maksim Kulichenko 等

- 論文網址:https://www.nature.com/articles/s43588-023-00406-5

#摘要:機器學習(ML) 模型,如果針對高保真量子模擬的資料集進行訓練,可以產生準確且高效的原子間勢。主動學習 (AL) 是迭代產生不同資料集的強大工具。在這種方法中,ML 模型提供了不確定性估計值及其對每個新原子構型的預測。如果不確定性估計超過某個閾值,則該構型將包含在資料集中。

近日,來自美國洛斯阿拉莫斯國家實驗室的研究人員制定了一種策略:主動學習的不確定性驅動動力學(UDD-AL),以更快地發現有意義地擴充訓練資料集的構型。 UDD-AL 修改了分子動力學模擬中使用的位能面,以支持存在較大模型不確定性的構型空間區域。 UDD-AL 的表現在兩個 AL 任務中得到了證明。下圖為甘胺酸測試案例的 UDD-AL 和 MD-AL 方法比較。

# 推薦:Nature 子刊| 不確定性驅動、用於主動學習的動力學用於自動採樣。

論文5:Combinatorial synthesis for AI-driven materials discovery

- 作者:John M. Gregoire 等

- 論文地址:https://www.nature.com/articles/s44160-023-00251-4

摘要:合成是固態材料實驗的基石,任何合成技術都必然涉及改變一些合成參數,最常見的是成分和退火溫度。 「組合合成」通常是指自動化 / 並行化材料合成,以創建具有一個或多個合成參數系統變化的材料集合。人工智慧控制的實驗工作流程對組合合成提出了新的要求。

在此,加州理工學院的研究人員概述了組合合成,設想了由組合合成和 AI 技術的共同開發所推動的加速材料科學的未來。並建立了評估不同技術之間權衡的十個指標,涵蓋速度、可擴展性、範圍和品質。這些指標有助於評估一項技術對給定工作流程的適用性,並說明組合合成的進步將如何開創加速材料科學的新時代。如下為組合合成平台的合成指標及各自評估。

#推薦:Nature Synthesis 綜述:人工智慧驅動材料發現的組合合成。

論文 6:Masked Images Are Counterfactual Samples for Robust Fine-tuning

- 作者:Yao Xiao 等

- 论文地址:https://arxiv.org/abs/2303.03052

摘要:中山大学人机物智能融合实验室(HCP)在 AIGC 及多模态大模型方面成果丰硕,在近期的 AAAI 2023、CVPR 2023 先后入选了十余篇,位列全球研究机构的第一梯队。其中一个工作实现了用因果模型来显著提升多模态大模型在调优中的可控及泛化性 ——《Masked Images Are Counterfactual Samples for Robust Fine-tuning》。

推荐:中山大学 HCP 实验室新突破:用因果范式再升级多模态大模型。

论文 7:One Transformer Fits All Distributions in Multi-Modal Diffusion at Scale

- 作者:Fan Bao 等

- 论文地址:https://ml.cs.tsinghua.edu.cn/diffusion/unidiffuser.pdf

摘要:该论文提出了一个为多模态设计的概率建模框架 UniDiffuser,并采用该团队提出的基于 transformer 的网络架构 U-ViT,在开源的大规模图文数据集 LAION-5B 上训练了一个十亿参数量的模型,使得一个底层模型能够高质量地完成多种生成任务(图 1)。简单来讲,除了单向的文生图,还能实现图生文、图文联合生成、无条件图文生成、图文改写等多种功能,大幅提升文图内容的生产效率,也进一步提升了生成式模型的应用想象力。

推荐:清华朱军团队开源首个基于 Transformer 的多模态扩散大模型,文图互生、改写全拿下。

ArXiv Weekly Radiostation

机器之心联合由楚航、罗若天、梅洪源发起的ArXiv Weekly Radiostation,在 7 Papers 的基础上,精选本周更多重要论文,包括NLP、CV、ML领域各10篇精选,并提供音频形式的论文摘要简介。

本周 10 篇 NLP 精选论文是:

1. GLEN: General-Purpose Event Detection for Thousands of Types. (from Martha Palmer, Jiawei Han)

2. An Overview on Language Models: Recent Developments and Outlook. (from C.-C. Jay Kuo)

3. Learning Cross-lingual Visual Speech Representations. (from Maja Pantic)

4. Translating Radiology Reports into Plain Language using ChatGPT and GPT-4 with Prompt Learning: Promising Results, Limitations, and Potential. (from Ge Wang)

5. A Picture is Worth a Thousand Words: Language Models Plan from Pixels. (from Honglak Lee)

6. Do Transformers Parse while Predicting the Masked Word?. (from Sanjeev Arora)

7. The Learnability of In-Context Learning. (from Amnon Shashua)

8. Is In-hospital Meta-information Useful for Abstractive Discharge Summary Generation?. (from Yuji Matsumoto)

9. ChatGPT Participates in a Computer Science Exam. (from Ulrike von Luxburg)

10. Team SheffieldVeraAI at SemEval-2023 Task 3: Mono and multilingual approaches for news genre, topic and persuasion technique classification. (from Kalina Bontcheva)

本周 10 篇 CV 精选论文是:

1. From Local Binary Patterns to Pixel Difference Networks for Efficient Visual Representation Learning. (from Matti Pietikäinen, Li Liu)

2。類別級多部件多關節 3D 形狀組裝。 (取自 Wojciech Matusik、Leonidas Guibas)

3。 PartNeRF:無需 3D 監督即可產生零件感知的可編輯 3D 形狀。 (出自列奧尼達斯·吉巴斯)

4。探索多視圖 3D 感知的循環長期時間融合。 (出自張翔宇)

5.抓住您所需要的:透過靈活的組件審議重新思考複雜的表結構識別。 (來自劉冰)

6。使用視覺和語言模型進行統一視覺關係偵測。 (出自楊明軒)

7.透過 Reliable Bank 進行水下影像恢復的對比半監督學習。 (來自劉歡)

8。 InstMove:用於以物件為中心的視訊分割的實例運動。 (來自白向,Alan Yuille)

9. ViTO:視覺變壓器操作員。 (來自喬治·艾姆·卡尼亞達基斯)

10。開放詞彙分割和檢測的簡單框架。 (摘自高劍鋒、張雷)

##本週第 10 篇 ML 精選論文是:

1.透過超球面均勻性間隙概括和解耦神經崩潰。 (出自 Bernhard Schölkopf)

2。 AutoTransfer:具有知識遷移的 AutoML-圖形神經網路的應用。 (來自 Jure Leskovec)

3。關係多工學習:對資料和任務之間的關係進行建模。 (取自 Jure Leskovec)

4。可解釋的異常值總結。 (來自塞繆爾·馬登)

5。基於視覺提示的個人化聯邦學習。 (摘自陶大成)

6. NOvA 使用稀疏 CNN 和 Transformer 進行中微子物理的可解釋聯合事件粒子重建。 (來自皮埃爾·巴爾迪)

7。 FedLP:用於通訊計算高效聯邦學習的分層剪枝機制。 (來自王飛、Khaled B. Letaief)

8。 NeurIPS 2022 上的 Traffic4cast-根據稀疏節點資料預測沿圖邊緣的動態:來自固定車輛偵測器的整個城市交通和預計到達時間。 (來自 Sepp Hochreiter)

#9。透過持續學習中的輔助網路實現更好的穩定性-可塑性權衡。 (來自托馬斯·霍夫曼)

10。快速調整的轉向原型,可實現免排練的持續學習。 (取自迪米特里斯·N·梅塔克薩斯)

以上是一句話為影片加特效;迄今為止最全昆蟲大腦圖譜的詳細內容。更多資訊請關注PHP中文網其他相關文章!

AI內部部署的隱藏危險:治理差距和災難性風險Apr 28, 2025 am 11:12 AM

AI內部部署的隱藏危險:治理差距和災難性風險Apr 28, 2025 am 11:12 AMApollo Research的一份新報告顯示,先進的AI系統的不受檢查的內部部署構成了重大風險。 在大型人工智能公司中缺乏監督,普遍存在,允許潛在的災難性結果

構建AI測謊儀Apr 28, 2025 am 11:11 AM

構建AI測謊儀Apr 28, 2025 am 11:11 AM傳統測謊儀已經過時了。依靠腕帶連接的指針,打印出受試者生命體徵和身體反應的測謊儀,在識破謊言方面並不精確。這就是為什麼測謊結果通常不被法庭採納的原因,儘管它曾導致許多無辜者入獄。 相比之下,人工智能是一個強大的數據引擎,其工作原理是全方位觀察。這意味著科學家可以通過多種途徑將人工智能應用於尋求真相的應用中。 一種方法是像測謊儀一樣分析被審問者的生命體徵反應,但採用更詳細、更精確的比較分析。 另一種方法是利用語言標記來分析人們實際所說的話,並運用邏輯和推理。 俗話說,一個謊言會滋生另一個謊言,最終

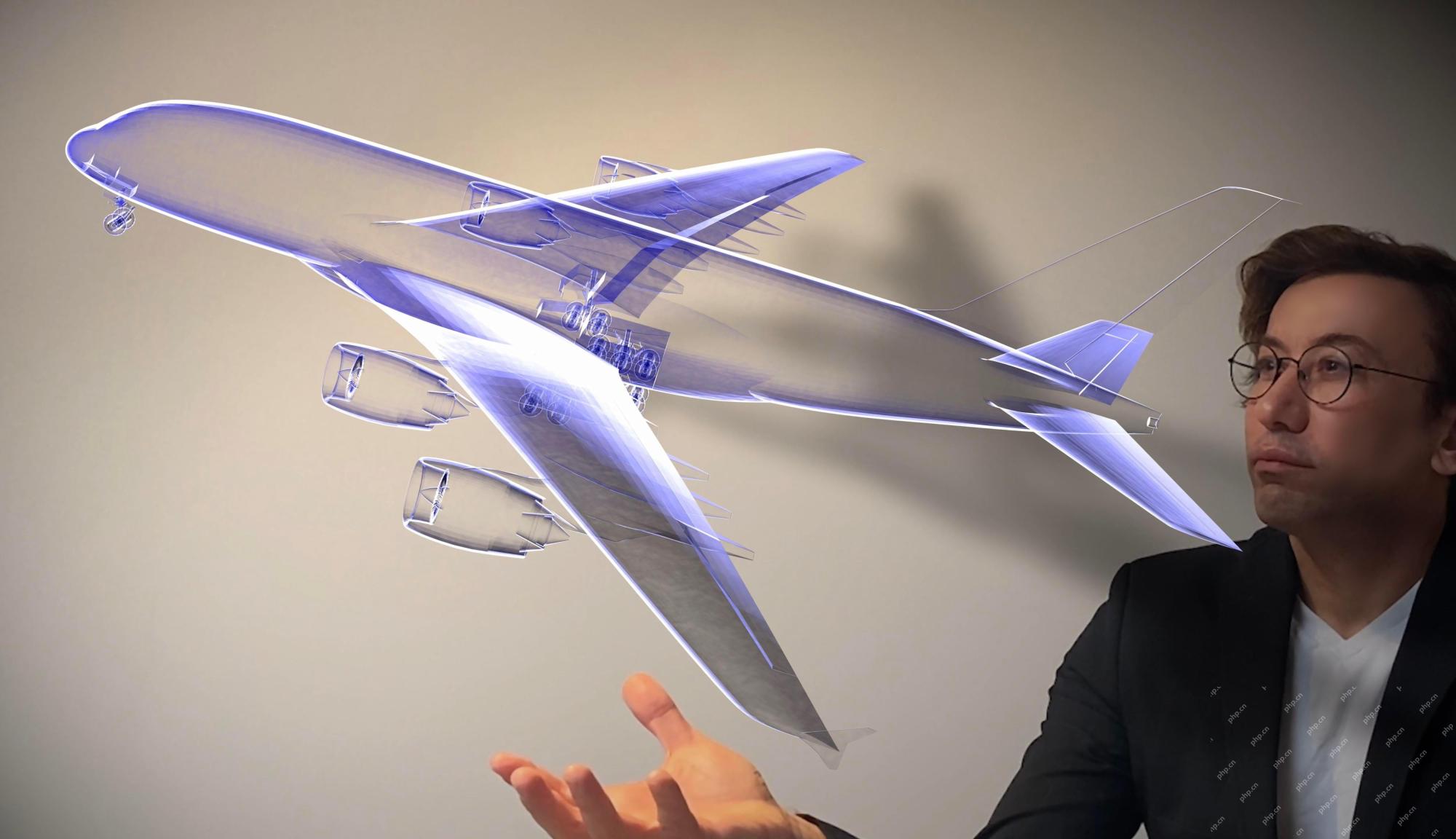

AI是否已清除航空航天行業的起飛?Apr 28, 2025 am 11:10 AM

AI是否已清除航空航天行業的起飛?Apr 28, 2025 am 11:10 AM航空航天業是創新的先驅,它利用AI應對其最複雜的挑戰。 現代航空的越來越複雜性需要AI的自動化和實時智能功能,以提高安全性,降低操作

觀看北京的春季機器人比賽Apr 28, 2025 am 11:09 AM

觀看北京的春季機器人比賽Apr 28, 2025 am 11:09 AM機器人技術的飛速發展為我們帶來了一個引人入勝的案例研究。 來自Noetix的N2機器人重達40多磅,身高3英尺,據說可以後空翻。 Unitree公司推出的G1機器人重量約為N2的兩倍,身高約4英尺。比賽中還有許多體型更小的類人機器人參賽,甚至還有一款由風扇驅動前進的機器人。 數據解讀 這場半程馬拉松吸引了超過12,000名觀眾,但只有21台類人機器人參賽。儘管政府指出參賽機器人賽前進行了“強化訓練”,但並非所有機器人均完成了全程比賽。 冠軍——由北京類人機器人創新中心研發的Tiangong Ult

鏡子陷阱:人工智能倫理和人類想像力的崩潰Apr 28, 2025 am 11:08 AM

鏡子陷阱:人工智能倫理和人類想像力的崩潰Apr 28, 2025 am 11:08 AM人工智能以目前的形式並不是真正智能的。它擅長模仿和完善現有數據。 我們不是在創造人工智能,而是人工推斷 - 處理信息的機器,而人類則

新的Google洩漏揭示了方便的Google照片功能更新Apr 28, 2025 am 11:07 AM

新的Google洩漏揭示了方便的Google照片功能更新Apr 28, 2025 am 11:07 AM一份報告發現,在谷歌相冊Android版7.26版本的代碼中隱藏了一個更新的界面,每次查看照片時,都會在屏幕底部顯示一行新檢測到的面孔縮略圖。 新的面部縮略圖缺少姓名標籤,所以我懷疑您需要單獨點擊它們才能查看有關每個檢測到的人員的更多信息。就目前而言,此功能除了谷歌相冊已在您的圖像中找到這些人之外,不提供任何其他信息。 此功能尚未上線,因此我們不知道谷歌將如何準確地使用它。谷歌可以使用縮略圖來加快查找所選人員的更多照片的速度,或者可能用於其他目的,例如選擇要編輯的個人。我們拭目以待。 就目前而言

加固芬特的指南 - 分析VidhyaApr 28, 2025 am 09:30 AM

加固芬特的指南 - 分析VidhyaApr 28, 2025 am 09:30 AM增強者通過教授模型根據人類反饋進行調整來震撼AI的開發。它將監督的學習基金會與基於獎勵的更新融合在一起,使其更安全,更準確,真正地幫助

讓我們跳舞:結構化運動以微調我們的人類神經網Apr 27, 2025 am 11:09 AM

讓我們跳舞:結構化運動以微調我們的人類神經網Apr 27, 2025 am 11:09 AM科學家已經廣泛研究了人類和更簡單的神經網絡(如秀麗隱桿線蟲中的神經網絡),以了解其功能。 但是,出現了一個關鍵問題:我們如何使自己的神經網絡與新穎的AI一起有效地工作

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

SublimeText3 英文版

推薦:為Win版本,支援程式碼提示!

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。