2023將至,吳恩達、Bengio等大佬年度展望!懂理性的AI模型要來了?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-12 22:04:011133瀏覽

還有不到3天,2022年就要過去了。

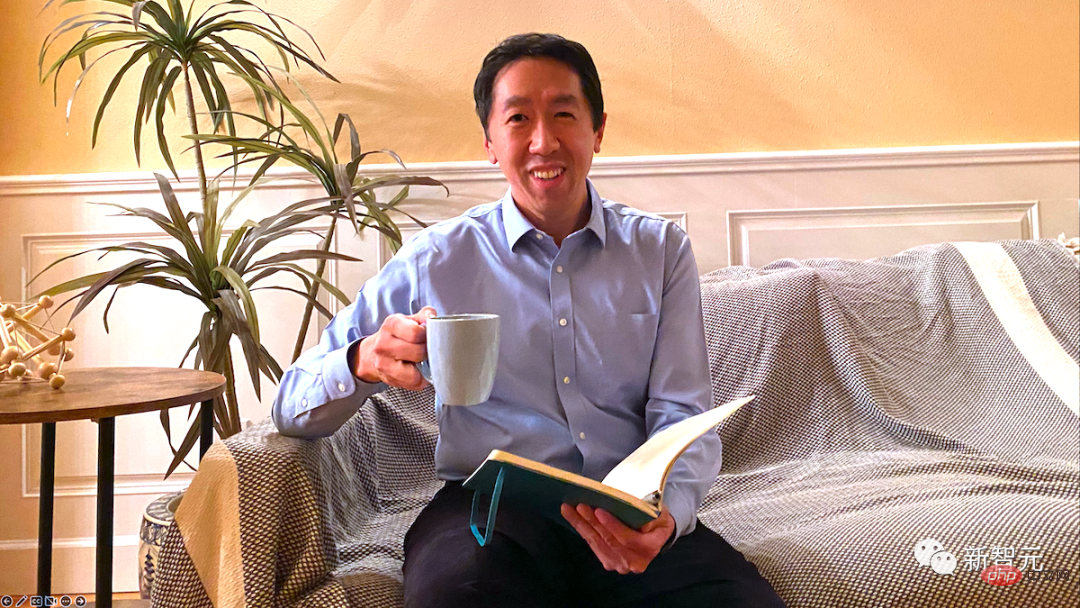

辭舊迎新之際,吳恩達、Bengio等一眾AI大佬們在DeepLearning.ai聚在一起,展望了自己眼中的2023年。

作為DeepLearning.ai的創始人,吳恩達首先發表了歡迎致辭,並回憶起自己剛開始搞研究的那段歲月,為這場多位大佬參與的討論開了個好頭。

親愛的朋友們:

#當我們進入新的一年時,讓我們不要把2023年看作是一個單一孤立的年份,而是我們未來完成長期目標的年份中的第一年。有些結果需要很長時間才能實現,但如果我們設想出一條道路,而不是簡單地從一個里程碑到另一個里程碑,就能更有效地做到這一點。

我年輕的時候,幾乎沒有把短期行動與長期成果具體連結起來。我總是會專注於下一個目標、專案或研究論文,說是有一個模糊的10年目標,但沒有一個明確的路徑來實現。

10年前,我一週就建立了我的第一個機器學習課程(經常在凌晨2點拍攝)。今年,我更新了機器學習專業的課程內容,並更好地規劃了整個課程(雖然有些拍攝仍然是在凌晨2點進行的,但數量減少了!)。

在以前的業務中,我傾向於打造一個產品,然後才考慮如何將其推向客戶。如今,即使在起步階段,我也更考慮客戶的需求。

朋友和導師的回饋可以幫助你塑造你的願景。我成長過程中的一大步,就是學會信任某些專家和導師的建議,並且努力去理解。例如,我有朋友是全球地緣政治的專家,他們有時會建議我在特定國家加大投資。

我自己是得不出這個結論的,因為我對這些國家並不了解。但我已經學會了解釋我的長期計劃,徵求他們的回饋意見,並在他們給我指出不同的方向時認真傾聽。

現在,我的首要目標之一是讓人工智慧創新的民主化。讓更多的人能夠建立客製化的人工智慧系統,並從中獲得收益。雖然實現這一目標的道路漫長而艱難,但我可以看到實現這一目標的步驟,而朋友和導師的建議也大大塑造了我的思維。

隨著2023年的到來,你能在多遠的未來做出計畫?你想在某個主題上獲得專業知識,推動你的職業生涯,還是解決技術問題?透過路徑假設(即使是未經測試的假設),徵求回饋意見來加以測試和完善?

為2023年心懷夢想。

新年快樂!

吳恩達

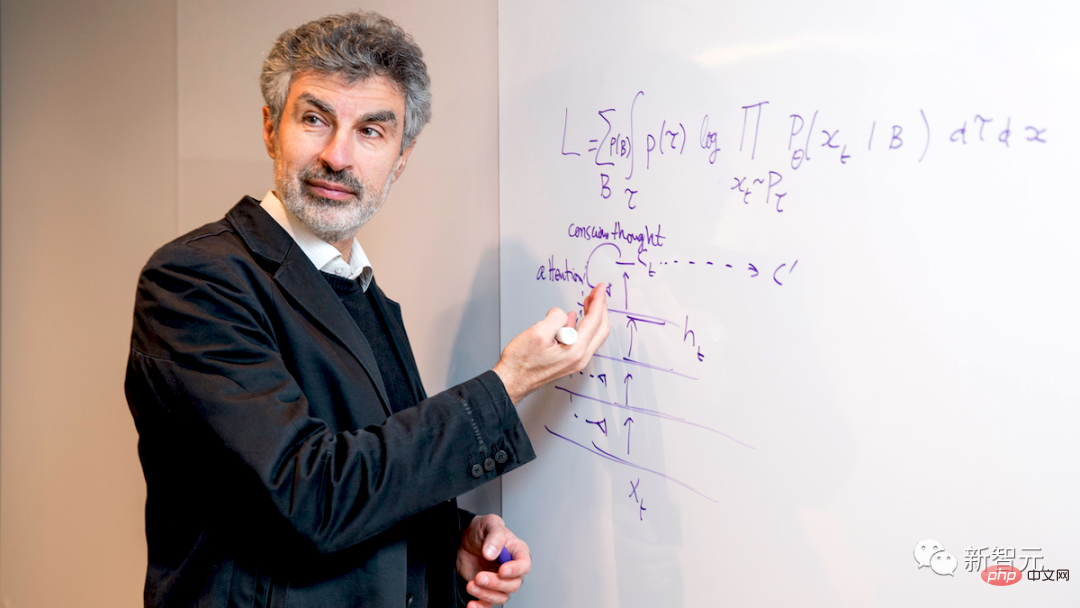

#Yoshua Bengio:尋找具備理性的AI模型

過去,深度學習的進展主要是「大力出奇蹟」:採用最新的架構,提升硬件,擴大算力、數據和規模。我們是否已經擁有了我們所需要的架構,剩下的就是開發更好的硬體和資料集,以便我們能夠繼續擴大規模?現在還缺什麼嗎?

我認為是缺的,我希望在未來的一年裡能找到這些缺少的東西。

我一直在與神經科學家和認知神經科學家合作,研究最先進的系統和人類之間的差距。簡單地擴大模型規模並不能填補這種差距。相反,在目前的模型中建立類似人類的能力,來發現和推理高層次的概念和它們之間的關係,可能會讓差距變得更大。

考慮學習一項新任務所需的例子數量,即所謂的「樣本複雜度」。訓練一個深度學習模型玩一個新的視頻遊戲需要大量的遊戲玩法,這些玩法對而人類而言,可以很快學會。但計算機需要考慮無數的可能性,來規劃一條從A到B的高效率路線。而人類則不需要。

人類可以選擇正確的知識片段,並將這些片段貼合在一起,形成一套相關的解釋、答案或計畫。此外,給定一組變量,人類非常擅長確定哪些是原因,哪些是結果。而目前的人工智慧技術在這個能力上還無法接近人類水準。

通常情況下,AI系統對產生的答案和方案的正確性高度自信,即使實際上是錯誤的。這個問題在文字產生器或聊天機器人這樣的應用中可能是一些很有趣的笑話,但換到自動駕駛汽車或醫療診斷系統中,卻可能威脅到生命。

目前的AI系統的行事特徵,部分原因是它們就是被設計成這樣的。例如,文字產生器的訓練只是為了預測下一個單詞,而不是建立一個內部資料結構,也不必說明所操作的概念以及它們之間的關係。

但我認為,我們可以設計出能夠追蹤事情背後的意義,並對其進行推理的AI系統,同時仍能發揮當前深度學習方法的眾多優勢。這樣就可以解決從過度的樣本複雜性到過度自信的不正確性等各種挑戰。

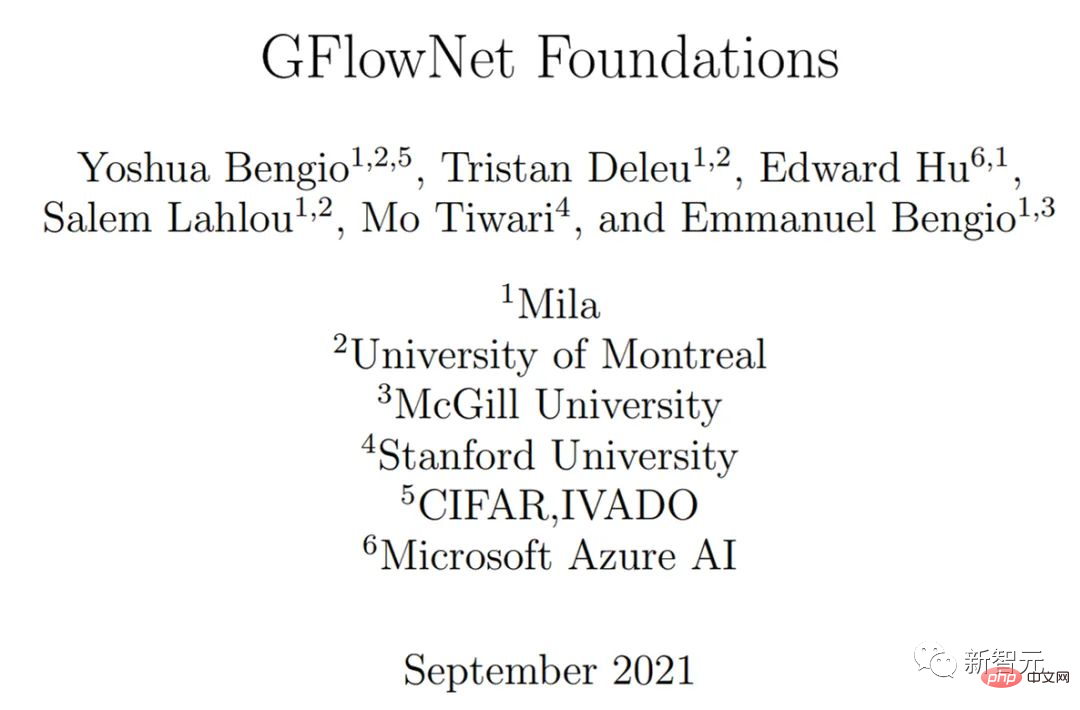

論文連結:https://arxiv.org/pdf/2111.09266.pdf

#我對「生成流網路」GFlowNets很感興趣,這是我們團隊一年前開始的一種訓練深度網路的新方法。這個想法的靈感來自於人類透過一連串步驟進行推理的方式,在每一步都加入新的相關資訊。

這就像是強化學習,因為模型是按順序學習政策來解決問題的。它也像生成式建模,因為它可以對解決方案進行抽樣,以對應於進行機率推理。

如果你想到一個圖像的解釋,你的想法可以轉換成一個句子,但它不是句子本身。相反,它包含關於該句子中的概念的語義和關係資訊。一般來說,我們把這種語義內容表示為一個圖,其中每個節點是一個概念或變數。

我不認為這是唯一的解決方案,我期待著看到多種多樣的方法。透過多樣化的探索,我們將有更大的機會找到目前AI領域缺失的東西,彌補當前人類和人類層面的AI之間的差距。

#Yoshua Bengio是蒙特婁大學電腦科學教授和Mila-魁北克人工智慧研究所的科學主任。他與Geoffrey Hinton和Yann LeCun一起獲得了2018年圖靈獎,以表彰他對深度學習的突破性貢獻。

Alon Halevy:個人資料時間軸

Alon Halevy是一位以色列裔美國電腦科學家,也是資料整合領域的專家。他從2005年到2015年擔任Google的研究科學家,負責Google資料融合表。

他是ACM會員,並於2000年獲得美國總統獎 (PECASE)。他也是科技公司Nimble Technology(現為Actuate Corporation)和Transformic Inc.的創辦人。

在2023年的展望中,Halevy聚焦於個人資料時間軸(personal data timeline)的建構。

公司和組織如何使用使用者資料?這一重要議題在技術圈和政策界都受到了廣泛關注。

2023年,還有一個同樣重要、值得更多關注的問題:作為個人,我們如何利用產生的數據來改善我們的健康,增加活力和生產力?

我們每天都在產生各種資料。照片捕捉我們的生活經歷,手機記錄我們的運動情況和位置,網路服務記錄我們的消費和購買內容。

我們也會記錄各種願望:想要前往的旅行和嘗試的餐廳、計劃欣賞的書籍和電影,以及想要進行的社交活動。

不久後,智慧眼鏡將更細緻地記錄我們的種種體驗。然而,這些數據分散在許多應用程式中。為了更好地總結過去的經歷,我們需要每天從不同應用中整理過去的記憶。

能不能把所有的訊息都融合在一張個人時間表上,幫助我們朝著目標、希望和夢想前進呢?事實上,很久之前就有人有這樣的想法。

早在1945年,美國科學家範內瓦·布希(Vannevar Bush)就設計了一款產品,稱其為麥克斯儲存器(memex )。 90年代,戈登貝爾 (Gordon Bell) 和微軟研究院的同事建構了MyLifeBits,可以儲存一個人一生中所有的資訊。

但是,當我們把所有資料都保存在一個地方,保護隱私,防止資訊被濫用顯然是一個關鍵問題。

目前,沒有一家公司可以擁有我們所有的數據,也沒有儲存我們的所有數據的授權。因此,需要通力合作,建立支援個人時間軸的技術,包括用於資料交換、加密儲存和安全處理的協定。

建立個人時間軸,有兩個技術挑戰亟待解決。

第一個挑戰關於系統的智慧問答。儘管我們在基於文本和多模態數據的問答方面取得了重大進展,然而在許多情況下,智能問答要求我們明確推理答案集合。

#這是資料庫系統的基礎。例如,要回答「我在東京參觀了哪些咖啡館?」 或「我在兩小時內跑了多少次半程馬拉松?」 ,要求檢索集合作為中間答案。而在目前,自然語言處理中還無法完成這項任務。

從資料庫中汲取更多靈感,還需要讓系統能夠解釋答案的出處,並判斷答案是否正確完整。

建立個人時間軸的第二個挑戰,是如何開發個人資料軸分析技術,以改善使用者的生活品質。

根據正向心理學,人們可以為自己創造正向的體驗並養成更好的習慣,以實現更好的發展。一個可以存取我們生活點滴和目標的AI智能體,可以及時提醒我們需要完成和避免的事情。

當然,我們選擇做什麼取決於我們自己,但我相信,一個能夠全面了解我們的日常活動,擁有更好的記憶力和計劃能力的人工智慧會使每個人受益良多。

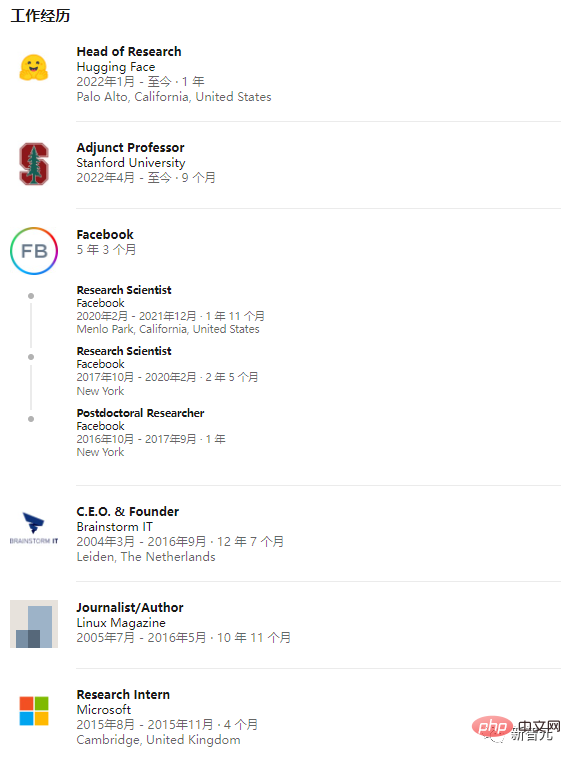

Douwe Kiela:少點炒作,多點謹慎

##Douwe Kiela是史丹佛大學符號系統的兼任教授。在劍橋大學完成碩士和博士學位後,Kiela分別在IBM、微軟、Facebook AI擔任研究員,並擔任Hugging Face的研究主管。

在新年展望中,Kiela表達了他對人工智慧系統發展的願望。

今年,我們真正看到人工智慧開始成為主流。像Stable Diffusion和ChatGPT這樣的系統完全激發了公眾的想像。

這是一個令人興奮的時刻,我們正處於偉大事物的風口浪尖:毫不誇張地說,這種能力的轉變會和工業革命一樣,產生顛覆性的影響。

但是在興奮之餘,我們應該警惕炒作,格外謹慎,以負責任的態度進行研發。

對大型語言模型而言,無論這些系統是否真的「有意義」,外行人都會將它們擬人化,因為它們有能力執行人類最具代表性的事:產生語言。

但是,我們必須讓大眾了解這些人工智慧系統的能力和局限性,因為大眾大多認為電腦還是那種老式的符號處理器,例如,它們擅長數學但不擅長藝術,而目前情況卻恰恰相反。

現代AI有項嚴重的缺陷,其係統很容易被無意誤用或有意濫用。它們不僅會產生錯誤的訊息,而且看起來非常自信,讓人相信。

這些AI系統對複雜的多模態人類世界缺乏足夠的理解,也不具備哲學家所說的「大眾心理學」,即解釋和預測他人行為和心理狀態的能力。

目前,AI系統還是不可持續的資源密集型產品,我們對輸入的訓練資料和輸出的模型之間的關係知之甚少。 #

同時,雖然模型擴展可以極大提高有效性——例如,某些功能只有在模型達到一定規模時才會出現——但也有跡象表明,隨著這模型擴展,更容易出現偏見,甚至是更不公平的系統。

因此,我對2023年的希望是,我們能改善這些問題。對多模態、定位和交互作用的研究可以使系統更好地理解現實世界和人類行為,從而更好地理解人類。

研究對齊、歸因和不確定性可以使AI系統更安全,更不容易產生幻覺,並建立更準確的獎勵模型。以數據為中心的人工智慧有望展示更有效率的縮放法則,更有效地將數據轉化為穩健和公平的模型。

論文連結:https://arxiv.org/pdf/2007.14435.pdf

#最後,我們應該更關注人工智慧持續的評估危機。我們需要對數據和模型進行更精細、更全面的測量,以確保我們能夠描述我們的進步和局限性,並從生態有效性(例如,AI系統在真實世界的應用案例)的角度出發,理解我們從人工智慧發展中真正想要獲得的東西。

Been Kim:用科學研究解釋模型

Been Kim是來自Google Brain的科學家,畢業於麻省理工大學,他的研究領域是互動式機器學習。

對於過去這一年裡AI所展現的創造力以及取得的諸多成就,她在激動興奮之餘,也提出了自己對未來AI研究的一些看法。

對AI來說,這是一個激動人心的時刻,在生成藝術和許多其他應用程式方面取得了令人著迷的進步,

雖然這些方向令人興奮,但我認為我們需要從事不那麼浮躁的工作,不光是AI能創造出更多東西,或是能設計出多大的模型:

回歸基礎並將研究人工智慧模型作為科學探究的目標。

為什麼要這麼做?

可解釋性領域旨在創建工具來為複雜模型的輸出產生解釋,幫助我們探索AI與人類的關係。

例如一種工具採用影像和分類模型,並以加權像素的形式產生解釋。像素的權重越高,它就越重要。例如,它的值對輸出的影響越大,它可能就越重要,但如何定義重要性因工具而異。

雖然生成AI已經取得了一些成功,但事實證明許多工具的運作方式出乎我們的意料。

例如未經訓練的模型的解釋在數量和質量上與訓練模型的解釋無法區分,儘管產生相同的輸出,但解釋通常會隨著輸入的微小變化而改變。

#此外,模型的輸出與工具的解釋之間沒有太多因果關係。其他工作表明,對模型輸出的良好解釋不一定會對人們使用模型的方式產生積極影響。

期望和結果之間的這種不匹配意味著什麼,我們該怎麼做?它表明我們需要檢查我們如何建立這些工具。

目前我們採用以工程為中心的方法:反覆試驗。我們基於直覺建構工具(例如我們為每個像素區塊而不是單一像素生成權重,解釋會更直觀)。

論文連結:https://arxiv.org/pdf/1811.12231.pdf

#圖賓根大學的一個團隊發現,神經網路看到的紋理(如大象的皮膚)比形狀(大象的輪廓)更多,即使我們在解釋圖像時看到了大象的輪廓可能是以集體高亮像素的形式。

這項研究告訴我們,模型可能看到的不是形狀,而是紋理,稱為歸納偏差——由於其架構或我們優化它的方式而導致的特定類別模型的趨勢。

揭示這種傾向可以幫助我們了解模型,就像揭示人類的傾向可以用來理解人類的行為(例如不公平的決定)一樣。

這種常用於理解人類的方法也可以幫助我們理解模型。對於模型,由於其內部結構的建構方式,我們還有一種工具:理論分析。

這個方向的工作已經在模型、最佳化器和損失函數的行為方面產生了令人興奮的理論結果。有些利用統計學、物理學、動力系統或訊號處理中的經典工具,許多來自不同領域的工具在人工智慧的研究中仍有待探索。

追求科學並不意味著我們應該停止實踐:科學使我們能夠根據原理和知識建構工具,而實踐則將理念變為現實。

論文連結:https://hal.inria.fr/inria-00112631/document

#實踐也可以啟發科學:在實踐中行之有效的東西可以為科學結構化的模型結構提供參考,就如同2012年的高性能卷積網絡激發了許多分析為什麼卷積有助於泛化的理論論文一樣。

Reza Zadeh:讓ML模型主動學習

Reza Zadeh是電腦視覺公司Matroid 的創辦人兼CEO ,畢業於史丹佛大學,他的研究領域是機器學習、分散式計算和離散應用數學,同時也是Databricks 的早期成員。

他認為,即將到來的2023將會是主動學習起飛的一年。

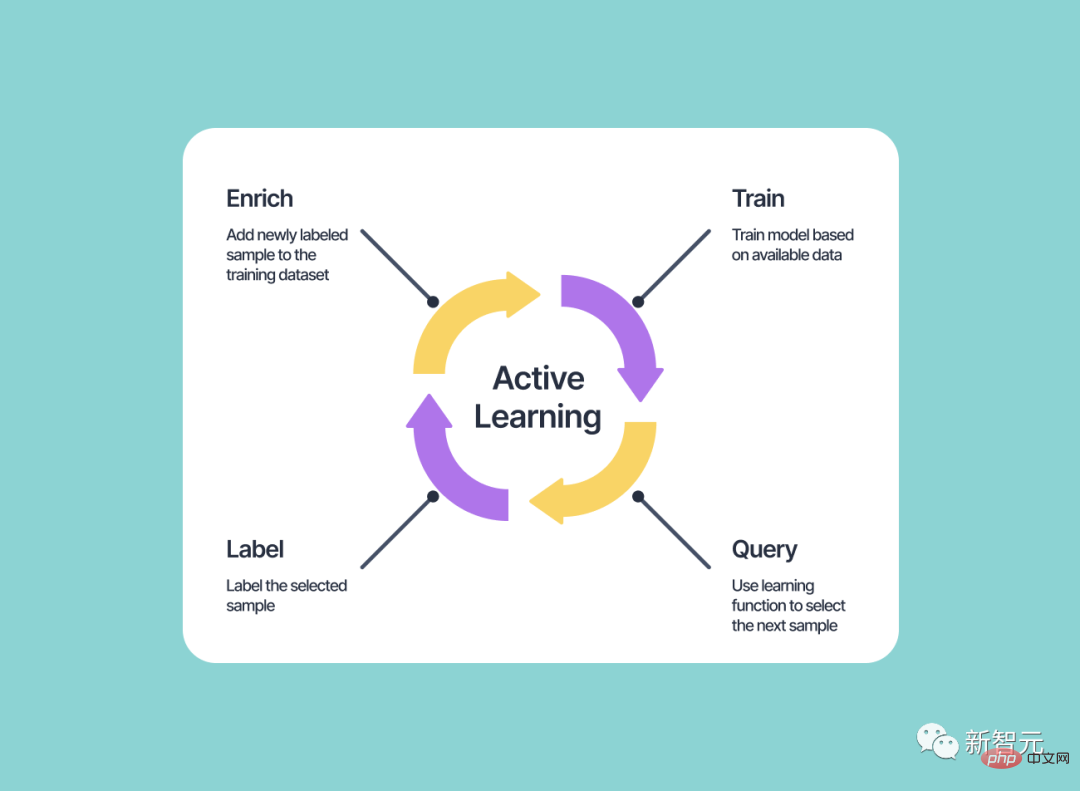

隨著我們進入新一年,人們希望生成AI的爆炸性增長將在主動學習(Active Learning )方面帶來重大進展。

#這種技術使ML系統能夠產生自己的訓練範例並對它們進行標記,而在大多數其他形式的機器學習中,演算法被賦予一組固定的範例,並且通常只能從這些範例中學習。

那麼主動學習可以為機器學習系統帶來什麼呢?

- 適應不斷變化的條件

- 從更少的標籤中學習

- 讓人們了解最有價值/最困難的實例

- ##實作更高的表現

主動學習的概念已經存在了幾十年,但從未真正流行起來。以前,演算法很難產生供人類評估並可推進學習演算法的圖像或句子。

但隨著圖像和文字生成AI的大火,主動學習有望取得重大突破。現在當學習演算法不確定其編碼空間的某些部分的正確標籤時,它可以主動從該部分生成資料以獲取輸入。

主動學習有可能徹底改變機器學習的方式,因為它允許系統隨著時間的推移不斷改進和適應。

主動學習系統不依賴一組固定的標記數據,而是可以尋找新的資訊和範例,以幫助它更好地理解它試圖解決的問題。

這可以帶來更準確和有效的機器學習模型,並且減少對大量標記資料的需求。

我對主動學習在生成AI的最新進展之上充滿期待。進入新的一年,我們很可能會看到更多實施主動學習技術的機器學習系統,2023 年可能是主動學習真正起飛的一年。 #

以上是2023將至,吳恩達、Bengio等大佬年度展望!懂理性的AI模型要來了?的詳細內容。更多資訊請關注PHP中文網其他相關文章!