南洋理工提出全場景圖生成PSG任務,像素級定位物體,還得預測56種關係

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-12 13:16:211045瀏覽

現在已經2022年了,但是當下大多數的電腦視覺任務卻仍然只專注於影像感知。比方說,影像分類任務只需要模型辨識影像中的物體物體類別。雖然目標偵測,影像分割等任務進一步要求找到物體的位置,然而,此類任務仍不足以說明模型獲得了對場景全面深入的理解。

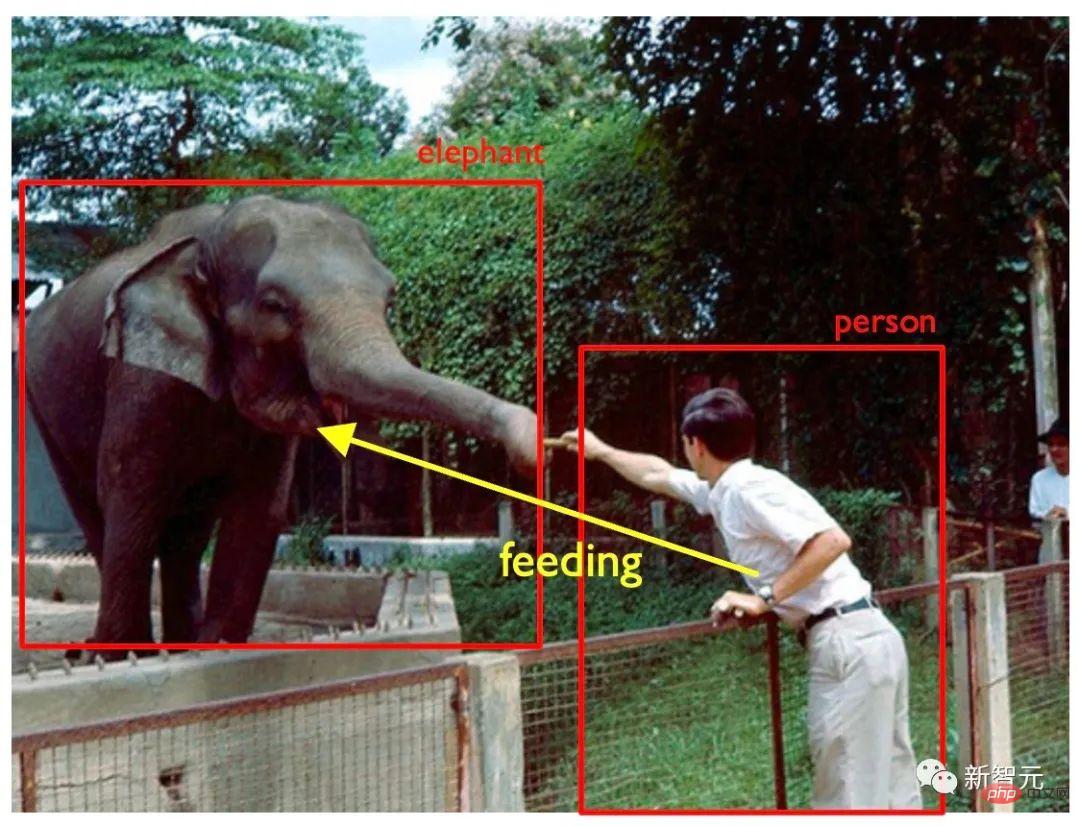

以下圖1為例,如果電腦視覺模型只偵測到圖片中的人、大象、柵欄、樹木等,我們通常不會認為模型已經理解了圖片,而此模型也無法根據理解做出更高階的決策,例如發出「禁止投餵」的警告。

圖1:原始範例圖

事實上,在智慧在城市、自動駕駛、智慧製造等許多現實世界的AI場景中,除了對場景中的目標進行定位外,我們通常也期待模型對影像中各個主體之間的關係進行推理和預測。例如,在自動駕駛應用中,自動車需要分析路邊的行人是在推車還是騎自行車。根據不同的情況,相應的後續決策可能會有所不同。

而在智慧工廠場景中,判斷操作員是否操作安全正確也需要監控端的模型有理解主體之間關係的能力。大多數現有的方法都是手動設定一些硬編碼的規則。這使得模型缺乏泛化性,難以適應其他特定情況。

場景圖產生任務(scene graph generation,或SGG)就旨在解決如上的問題。在目標物件分類和定位的要求之上,SGG任務也需要模型預測物件之間的關係(見圖 2)。

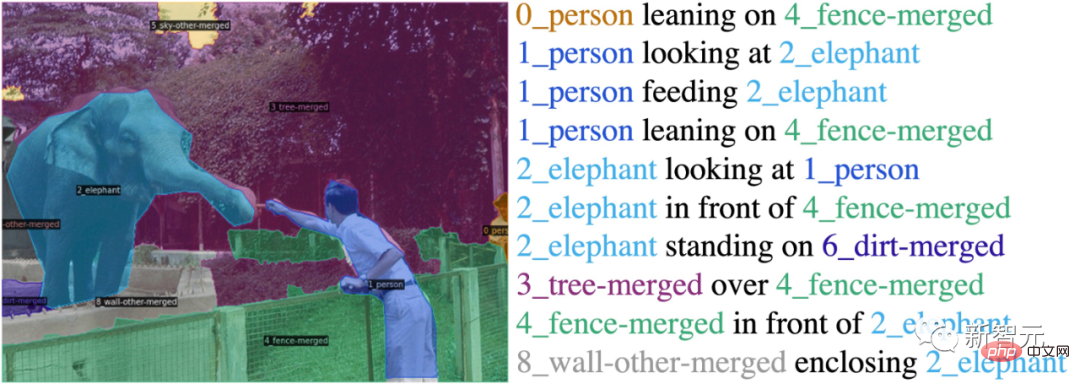

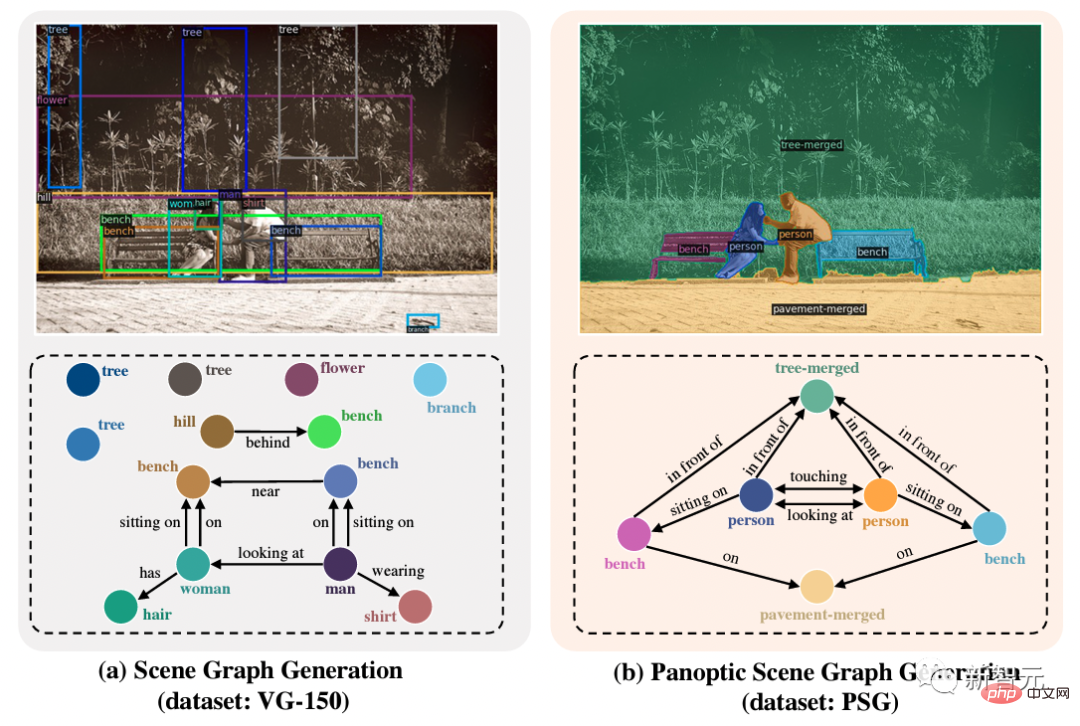

圖2:場景圖產生

傳統場景圖產生任務的資料集通常具有物件的邊界框標註,並標註邊界框之間的關係。但是,這種設定有幾個固有的缺陷:

(1)邊界框無法準確定位物體:如圖2所示,邊界框在標註人時不可避免地會包含人周圍的物體;

(2)背景無法標註:如圖2所示,大象身後的樹木用bounding box標註,幾乎覆蓋了整個圖像,所以涉及到背景的關係無法準確標註,這也使得場景圖無法完全覆蓋影像,無法達到全面的場景理解。

因此,作者提出全場景圖生成(PSG)任務,攜同一個精細標註的大規模PSG資料集。

圖3:全場景圖產生#如圖3 所示,該任務利用全景分割來全面且準確地定位物件和背景,從而解決場景圖生成任務的固有缺點,從而推動該領域朝著全面和深入的場景理解邁進。

論文資訊

#Paper link: https://arxiv.org/abs/2207.11247Project Page: https ://psgdataset.org/OpenPSG Codebase: https://github.com/Jingkang50/OpenPSGCompetition Link: https://www.cvmart.net/race/10349/baseECCV'22 SenseHuman Workshop Link: https://sense- https://sense- human.github.io/HuggingFace Demo Link: https://huggingface.co/spaces/ECCV2022/PSG

作者提出的PSG資料集包含近五萬張coco的圖片,並基於coco已有的全景分割標註,標註了分割區塊之間的關係。作者精細地定義了56種關係,包括了位置關係(over,in front of,等),常見的物體間關係(hanging from等),常見的生物動作(walking on,standing on,等),人類行為(cooking等),交通場景中的關係(driving,riding等),運動場景中的關係(kicking等),以及背景間關係(enclosing等)。作者要求標註員能用更精確的動詞表達就絕不用更模糊的表達,並且盡可能全地標註圖中的關係。

PSG模型效果展示

任務優勢

#作者透過下圖的例子再次理解全場景圖生成(PSG)任務的優勢:

#左圖來自SGG任務的傳統數據集Visual Genome (VG-150)。可以看到基於檢測框的標註通常不準確,而檢測框覆蓋的像素也不能準確定位物體,尤其是椅子,樹木之類的背景。同時,基於檢測框的關係標註通常會傾向的標註一些無聊的關係,如“人有頭”,“人穿著衣服”。

相較之下,右圖中提出的PSG 任務提供了更全面(包括前景和背景的互動)、更清晰(合適的物體粒度)和更準確(像素級準確)的場景圖表示,以推動場景理解領域的發展。

兩大類PSG模型

為了支撐提出的PSG任務,作者建立了一個開源程式碼平台OpenPSG,其中實現了四個雙階段的方法和兩個單階段的方法,方便大家開發、使用、分析。

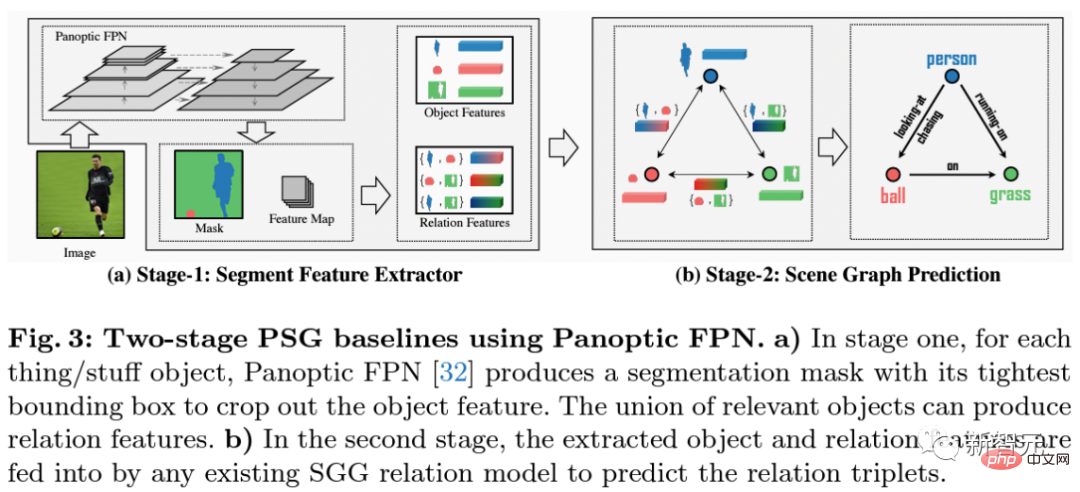

雙階段的方法利用Panoptic-FPN在第一階段中對影像進行全景分割。

接下來作者擷取全景分割所得到的物件的特徵以及每一對物件融合的關係特徵,送到下一階段的關係預測階段。框架已整合復現了傳統場景圖生成的經典方法IMP,VCTree,Motifs,和GPSNet。

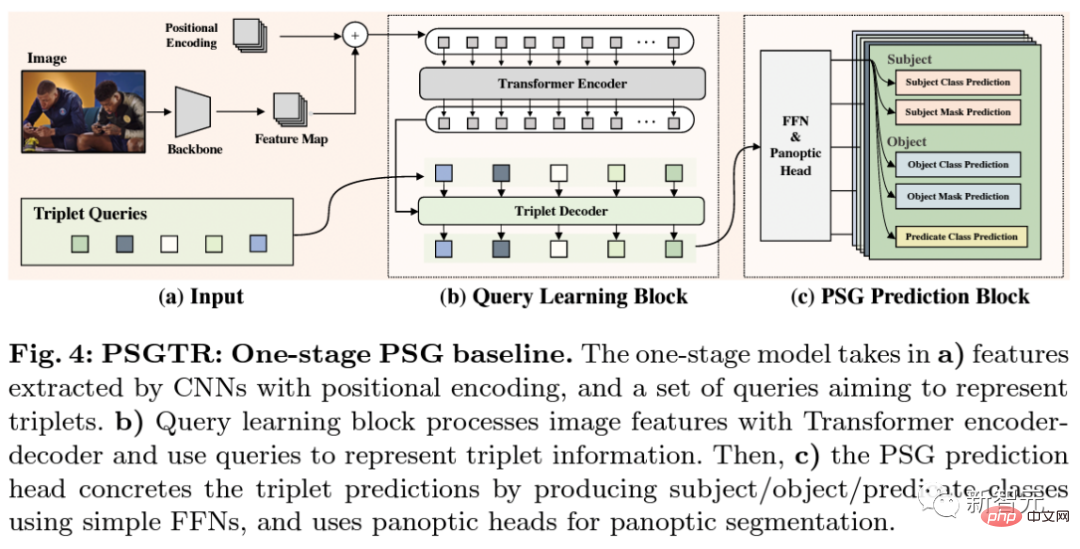

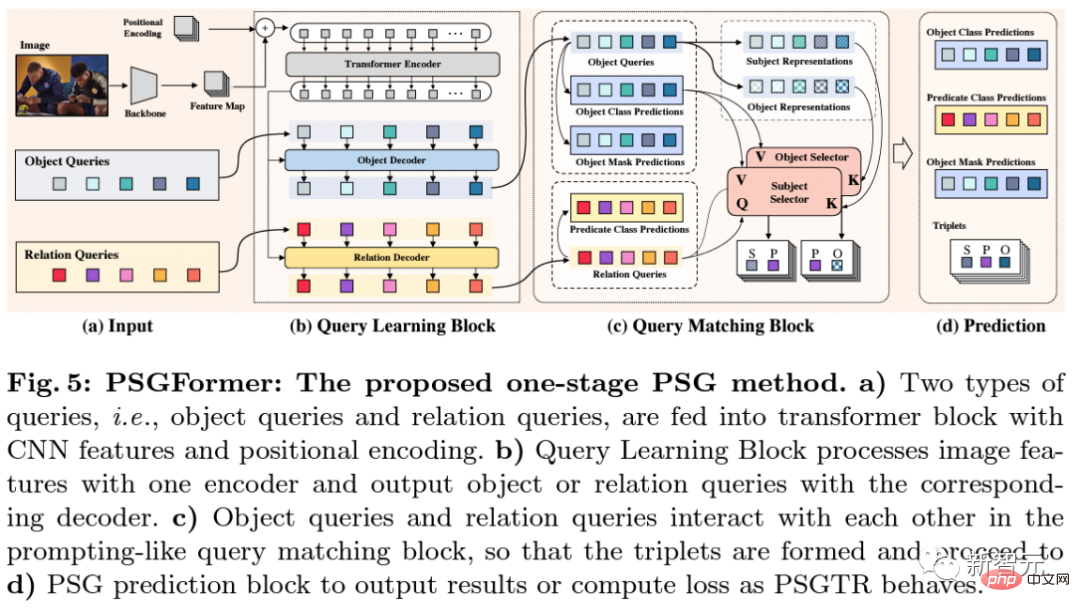

PSGFormer是基於雙decoder DETR的單階段方法。模型首先在a)中透過卷積神經網路backbone提取圖片特徵並加以位置編碼資訊作為編碼器的輸入,同時初始化一組用以表示三元組的queries。與DETR類似地, 在b)中模型將編碼器的輸出作為key和value與表示三元組的queries一同輸入解碼器進行cross-attention操作。接著模型在c)中將解碼完成的每個query分別輸入主謂賓三元組對應的預測模組,最後得到對應的三元組預測結果。 #####################PSGFormer基於雙decode的DETR的單階段方法。模型在a) 透過CNN擷取圖片特徵,加以位置編碼訊息輸入編碼器,同時初始化了兩組queries分別代表物體和關係。接著在b)步驟裡,模型基於編碼器編碼的圖片訊息,分別在物體解碼器和關係編碼器中透過cross-attention解碼學習物體query和關係query。 ############當兩類query都學習完畢後,在c)中透過映射後匹配,得到成對的三元組query。最後在d)中透過預測頭分別完成關於物體query和關係query的預測,並根據c)中的匹配結果得到最終的三元組預測結果。 ######

PSGTR與PSGFormer都是在DETR的基礎上進行擴展和改進的模型,不同的地方在於PSGTR用一組query對於三元組直接建模而PSGFormer則透過兩組query分別對物體和關係建模,兩種方法各有利弊,具體可參考論文中實驗結果。

結論分享

大部分在SGG任務上有效的方法在PSG任務上依舊有效。然而有一些利用較強的資料集統計先驗,或主謂賓中謂語方向先驗的方法可能沒那麼奏效。這可能是由於PSG資料集相較於傳統VG資料集的bias沒有那麼嚴重,並且對謂語動詞的定義更加清晰可學。因此,作者希望後續的方法能專注於視覺訊息的擷取和對圖片本身的理解。統計先驗可能在刷資料集上有效,但不本質。

比起雙階段模型,單階段模型目前能達到更好的效果。這可能得益於單階段模型有關於關係的監督訊號可以直接傳遞到feature map端,使得關係訊號參與了更多的模型學習,有利於對關係的捕捉。但由於本文只提出了若干基準模型,並沒有針對單階段或雙階段模型進行調優,因此目前還不能說單階段模型一定強於雙階段模型。這也希望參賽者繼續探索。

相比於傳統的SGG任務,PSG任務基於全景分割圖進行關係配對,要求對於每個關係中主賓物件的id 進行確認。相較於雙階段直接預測全景分割圖完成物體id 的劃分,單階段模型需要透過一系列後處理完成此步驟。若基於現有單階段模型進一步改進升級,如何在單階段模型中更有效的完成物體id的確認,產生更好的全景分割圖,仍是一個值得探索的話題。

最後,歡迎大家試試HuggingFace:

Demo:https://huggingface .co/spaces/ECCV2022/PSG

關於圖像生成的展望

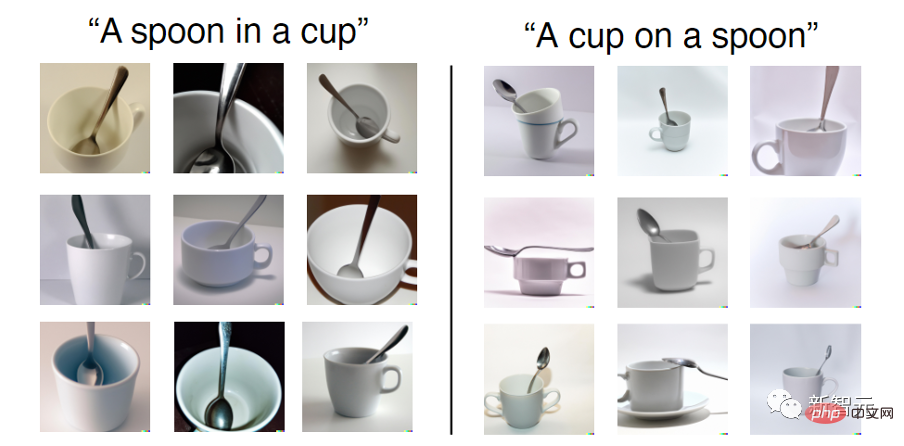

最近大火的基於文字輸入的生成模型(如DALL-E 2)著實令人驚嘆,但也有研究表明,這些生成模型可能只是把文本中的幾個實體黏合在一起,甚至都沒有理解文本中表達的空間關係。如下圖,雖然輸入的是「杯子在湯匙上」,產生的圖片仍然都是「湯匙在杯子裡」。

正巧,PSG資料集標註了基於mask的scene graph關係。作者可以利用scene graph和全景分割mask作為訓練對,得到一個text2mask的模型,在基於mask產生更細緻的圖片。因此,PSG資料集有可能也為注重關係的影像生成提供了潛在的解決方案。

P.S. 旨在激勵領域共同探索全面的場景識別的「PSG Challenge」火熱進行中,百萬獎金等你來拿! Competition Link: https://www.cvmart.net/race/10349/base

以上是南洋理工提出全場景圖生成PSG任務,像素級定位物體,還得預測56種關係的詳細內容。更多資訊請關注PHP中文網其他相關文章!