譯者 | 朱先忠

審校 | 孫淑娟

機器學習中的決策樹

# #現代機器學習演算法正在改變我們的日常生活。例如,像BERT這樣的大型語言模型正在為谷歌搜尋提供支持,GPT-3正在為許多高級語言應用程式提供支援。

另一方面,今天建立複雜的機器學習演算法比以往任何時候都容易得多。然而,無論機器學習演算法有多複雜,都屬於把它們歸納為以下學習類別之一:

#監督學習

無監督學習

半監督學習

半監督學習

強化學習

其實,決策樹算是最古老的有監督的機器學習演算法之一,可以解決廣泛的現實問題。研究表明,決策樹演算法的最早發明可以追溯到1963年。

- 接下來,讓我們深入研究這個演算法的細節,看看為什麼這類演算法今天仍然廣為流行。 什麼是決策樹?

- 決策樹演算法是一種流行的監督機器學習演算法,因為它處理複雜資料集的方法相對簡單得多。決策樹的名字來自於它們與「樹」這種結構的相似性;樹結構包括以節點和邊緣形式存在的根、枝和葉等幾個組成部分。它們用於決策分析,很像一個基於if-else的決策流程圖,這些決策會產生所需的預測。決策樹能夠學習這些if-else決策規則,從而拆分資料集,最後產生樹狀資料模型。

- 決策樹在分類問題的離散結果預測和迴歸問題的連續數值結果預測中得到了應用。多年來科學家們開發了許多不同的演算法,如CART、C4.5和ensemble演算法,如隨機森林和梯度增強樹等。

#決策樹演算法的目標是預測輸入資料集的結果。樹的資料集共劃分為三種形式:屬性、屬性的值和要預測的種類。與任何監督學習演算法一樣,資料集被劃分為訓練集和測試集兩種類型。其中,訓練集定義了演算法學習並應用於測試集的決策規則。

- 在聚集介紹決策樹演算法的步驟之前,讓我們先來了解決策樹的組成部分:

- 根節點:它是決策樹頂部的起始節點,包含所有屬性值。根節點根據演算法學習到的決策規則分成決策節點。

- 分支:分支是對應於屬性值的節點之間的連接器。在二進位拆分中,分支表示真路徑和假路徑。

- 決策節點/內部節點:內部節點是根節點和葉節點之間的決策節點,對應決策規則及其答案路徑。節點表示問題,分支顯示基於這些問題的相關答案的路徑。

葉節點:葉節點是表示目標預測的終端節點。這些節點不會進一步分裂。

#########以下是決策樹及其上述元件的視覺化表示,決策樹演算法經過以下步驟以達到所需的預測:########## #####演算法從具有所有屬性值的根節點開始。 ############根節點根據演算法從訓練集學習到的決策規則分成決策節點。 ############基於問題及其答案路徑,透過分支/邊緣傳遞內部決策節點。 ############繼續前面的步驟,直到到達葉節點或使用了所有屬性。 ###############為了在每個節點上選擇最佳屬性,將根據以下兩個屬性選擇度量之一進行拆分:#######- #基尼係數#(Gini index)測量基尼不純度(Gini Impurity),以指示演算法對隨機類別標籤進行錯誤分類的可能性。

- #資訊增益#測量分割後熵的改善,以避免預測類別的50/ 50分割。熵是給定資料樣本中不純度的數學量測。決策樹中的混沌狀態由接近#50/50的分割表示。

使用決策樹演算法的花卉分類案例

在了解了上述基礎知識後,接下來讓我們著手實現一個應用案例。在本文中,我們將使用Scikit學習庫在Python中實作決策樹分類模型。

關於資料集的簡單說明

本教學的資料集是一個鳶尾花資料集。 Scikit開源庫中已經內建了這個資料集,所以不需要開發人員再從外部載入它。此資料集共包括四個鳶尾屬性及對應的屬性值,這些屬性將輸入到模型中,以便預測三種類型的鳶尾花之一。

- 資料集中的屬性/特徵:萼片長度、萼片寬度、花瓣長度、花瓣寬度。

- 資料集中的預測標籤/花卉類型:Setosis、Versicolor、Virginica。

接下來,將給出決策樹分類器基於python語言實作的逐步程式碼說明。

匯入庫

首先,透過下面的一段程式碼匯入執行決策樹實作所需的函式庫。

import pandas as pd import numpy as np from sklearn.datasets import load_iris from sklearn.model_selection import train_test_split from sklearn.tree import DecisionTreeClassifier

載入鳶尾花(Iris)資料集

#以下程式碼展示了使用load_iris函數載入儲存到data_set變數中的sklearn.dataset庫中的鳶尾花數據集。接下來的兩行程式碼將實現列印鳶尾花類型和特徵資訊。

data_set = load_iris()

print('Iris plant classes to predict: ', data_set.target_names)

print('Four features of iris plant: ', data_set.feature_names)

分離屬性和標籤

#下面的程式碼行實現了將花的特性和類型資訊分開來,並將它們儲存在相應的變數中。其中,shape[0]函數負責決定儲存在X_att變數中的屬性數;資料集中的屬性值總數為150。

#提取花的特性和类型信息

X_att = data_set.data

y_label = data_set.target

print('数据集中总的样本数:', X_att.shape[0])其實,我們也可以建立一個視覺化表格來展示資料集中的一部分屬性值,方法是將X_att變數中的值加入panda函式庫中的DataFrame函數中即可。

data_view=pd.DataFrame({

'sepal length':X_att[:,0],

'sepal width':X_att[:,1],

'petal length':X_att[:,2],

'petal width':X_att[:,3],

'species':y_label

})

data_view.head()拆分資料集

以下程式碼展示了使用train_test_split函數將資料集拆分為訓練集和測試集兩部分。其中,此函數中的random_state參數用於為函數提供隨機種子,以便在每次執行時為給定資料集提供相同的結果;test_size表示測試集的大小;0.25表示拆分後測試資料佔25%而訓練資料佔75%。

#数据集拆分为训练集和测试集两部分 X_att_train, X_att_test, y_label_train, y_label_test = train_test_split(X_att, y_label, random_state = 42, test_size = 0.25)

應用決策樹分類函數

下面的程式碼透過使用DecisionTreeClassifier函數來建立一個#分類模型#來實作一棵決策樹,分類標準設定為「entropy」方式。此標準能夠將屬性選擇度量設定為資訊增益(Information gain)。然後,程式碼將模型與我們的屬性和標籤訓練集相符。

#应用决策树分类器 clf_dt = DecisionTreeClassifier(criterion = 'entropy') clf_dt.fit(X_att_train, y_label_train)

计算模型精度

下面的代码负责计算并打印决策树分类模型在训练集和测试集上的准确性。为了计算准确度分数,我们使用了predict函数。测试结果是:训练集和测试集的准确率分别为100%和94.7%。

print('Training data accuracy: ', accuracy_score(y_true=y_label_train, y_pred=clf_dt.predict(X_att_train)))

print('Test data accuracy: ', accuracy_score(y_true=y_label_test, y_pred=clf_dt.predict(X_att_test)))真实世界中的决策树应用程序

当今社会,机器学习决策树在许多行业的决策过程中都得到广泛应用。其中,决策树的最常见应用首先是在金融和营销部门,例如可用于如下一些子领域:

- 贷款批准

- 支出管理

- 客户流失预测

- 新产品的可行性分析,等等。

如何改进决策树?

作为本文决策树主题讨论的总结,我们有充分的理由安全地假设:决策树的可解释性仍然很受欢迎。决策树之所以容易理解,是因为它们可以被人类以可视化方式展现并便于解释。因此,它们是解决机器学习问题的直观方法,同时也能够确保结果是可解释的。机器学习中的可解释性是我们过去讨论过的一个小话题,它也与即将到来的人工智能伦理主题存在密切联系。

与任何其他机器学习算法一样,决策树自然也可以加以改进,以避免过度拟合和出现过于偏向于优势预测类别。剪枝和ensembling技术是克服决策树算法缺点方案最常采用的方法。决策树尽管存在这些缺点,但仍然是决策分析算法的基础,并将在机器学习领域始终保持重要位置。

译者介绍

朱先忠,51CTO社区编辑,51CTO专家博客、讲师,潍坊一所高校计算机教师,自由编程界老兵一枚。

原文标题:An Introduction to Decision Trees for Machine Learning,作者:Stylianos Kampakis

以上是機器學習決策樹實戰演練的詳細內容。更多資訊請關注PHP中文網其他相關文章!

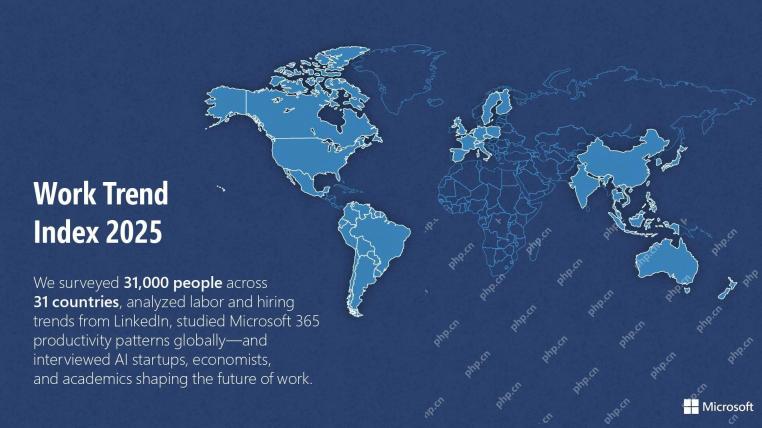

微軟工作趨勢指數2025顯示工作場所容量應變Apr 24, 2025 am 11:19 AM

微軟工作趨勢指數2025顯示工作場所容量應變Apr 24, 2025 am 11:19 AM由於AI的快速整合而加劇了工作場所的迅速危機危機,要求戰略轉變以外的增量調整。 WTI的調查結果強調了這一點:68%的員工在工作量上掙扎,導致BUR

AI可以理解嗎?中國房間的論點說不,但是對嗎?Apr 24, 2025 am 11:18 AM

AI可以理解嗎?中國房間的論點說不,但是對嗎?Apr 24, 2025 am 11:18 AM約翰·塞爾(John Searle)的中國房間論點:對AI理解的挑戰 Searle的思想實驗直接質疑人工智能是否可以真正理解語言或具有真正意識。 想像一個人,對下巴一無所知

中國的'智能” AI助手回應微軟召回的隱私缺陷Apr 24, 2025 am 11:17 AM

中國的'智能” AI助手回應微軟召回的隱私缺陷Apr 24, 2025 am 11:17 AM與西方同行相比,中國的科技巨頭在AI開發方面的課程不同。 他們不專注於技術基準和API集成,而是優先考慮“屏幕感知” AI助手 - AI T

Docker將熟悉的容器工作流程帶到AI型號和MCP工具Apr 24, 2025 am 11:16 AM

Docker將熟悉的容器工作流程帶到AI型號和MCP工具Apr 24, 2025 am 11:16 AMMCP:賦能AI系統訪問外部工具 模型上下文協議(MCP)讓AI應用能夠通過標準化接口與外部工具和數據源交互。由Anthropic開發並得到主要AI提供商的支持,MCP允許語言模型和智能體發現可用工具並使用合適的參數調用它們。然而,實施MCP服務器存在一些挑戰,包括環境衝突、安全漏洞以及跨平台行為不一致。 Forbes文章《Anthropic的模型上下文協議是AI智能體發展的一大步》作者:Janakiram MSVDocker通過容器化解決了這些問題。基於Docker Hub基礎設施構建的Doc

使用6種AI街頭智能策略來建立一家十億美元的創業Apr 24, 2025 am 11:15 AM

使用6種AI街頭智能策略來建立一家十億美元的創業Apr 24, 2025 am 11:15 AM有遠見的企業家採用的六種策略,他們利用尖端技術和精明的商業敏銳度來創造高利潤的可擴展公司,同時保持控制。本指南是針對有抱負的企業家的,旨在建立一個

Google照片更新解鎖了您所有圖片的驚人Ultra HDRApr 24, 2025 am 11:14 AM

Google照片更新解鎖了您所有圖片的驚人Ultra HDRApr 24, 2025 am 11:14 AMGoogle Photos的新型Ultra HDR工具:改變圖像增強的遊戲規則 Google Photos推出了一個功能強大的Ultra HDR轉換工具,將標準照片轉換為充滿活力的高動態範圍圖像。這種增強功能受益於攝影師

Descope建立AI代理集成的身份驗證框架Apr 24, 2025 am 11:13 AM

Descope建立AI代理集成的身份驗證框架Apr 24, 2025 am 11:13 AM技術架構解決了新興的身份驗證挑戰 代理身份集線器解決了許多組織僅在開始AI代理實施後發現的問題,即傳統身份驗證方法不是為機器設計的

Google Cloud Next 2025以及現代工作的未來Apr 24, 2025 am 11:12 AM

Google Cloud Next 2025以及現代工作的未來Apr 24, 2025 am 11:12 AM(注意:Google是我公司的諮詢客戶,Moor Insights&Strateging。) AI:從實驗到企業基金會 Google Cloud Next 2025展示了AI從實驗功能到企業技術的核心組成部分的演變,

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器

ZendStudio 13.5.1 Mac

強大的PHP整合開發環境

MantisBT

Mantis是一個易於部署的基於Web的缺陷追蹤工具,用於幫助產品缺陷追蹤。它需要PHP、MySQL和一個Web伺服器。請查看我們的演示和託管服務。

記事本++7.3.1

好用且免費的程式碼編輯器

mPDF

mPDF是一個PHP庫,可以從UTF-8編碼的HTML產生PDF檔案。原作者Ian Back編寫mPDF以從他的網站上「即時」輸出PDF文件,並處理不同的語言。與原始腳本如HTML2FPDF相比,它的速度較慢,並且在使用Unicode字體時產生的檔案較大,但支援CSS樣式等,並進行了大量增強。支援幾乎所有語言,包括RTL(阿拉伯語和希伯來語)和CJK(中日韓)。支援嵌套的區塊級元素(如P、DIV),