新年伊始,GoogleAI又開始發力文字-圖像生成模型了。

這次,他們的新模型Muse(繆斯)在CC3M資料集上達成了新SOTA(目前最佳水準)。

且其效率遠超熱門全球的DALL·E 2和Imagen (這兩個都屬於擴散模型),以及Parti (屬於自回歸模型)。

——單張512x512解析度影像的生成時間被壓縮到僅1.3秒。

在影像編輯方面,只需一句文字指令,就可以對原始影像進行編輯。

(似乎不用再為學ps頭禿了~)

#如果想要效果更精準,還能選定遮罩位置,編輯特定區域。例如,把背景的建築換成熱氣球。

Muse一經官宣,很快就吸引了大波關注,目前原貼已收穫4000 點讚。

看到Google的又一力作,有人甚至已經開始預言:

現在AI開發者的競爭非常激烈,看來2023將會是非常精彩的一年。

比DALL·E 2和Imagen更有效率

說回Google剛剛公開的Muse。

首先,就生成圖片的品質來說,Muse的作品大都畫質清晰、效果自然。

來看看更多例子感受一下~

例如戴著毛線帽的樹懶寶寶正在操作電腦;再例如酒杯中的一隻羊:

平時八竿子打不著的各種主體,在一張圖裡和諧共存,沒啥違和感。

要是你覺得這些還只能算AIGC的基操,那不妨再看看Muse的編輯功能。

例如一鍵換裝(還能換性別):

這既不需要加什麼遮罩,還能一句話搞定。

而如果用上遮罩的話,就能實現更6的操作,包括一鍵切換背景,從原地切換到紐約、巴黎、再到舊金山。

還能從海邊到倫敦、到花海,甚至飛到太空中的土星環上,玩一把刺激的滑板海豚跳。

(好傢伙,不僅能輕鬆雲旅遊,還能一鍵上天......)

效果著實挺出色。那Muse背後都有哪些技術支援?為什麼效率比DALL·E 2和Imagen更高?

一個重要的原因是,DALL·E 2和Imagen在訓練過程中,需要將所有學到的知識都儲存在模型參數中。

於是,它們不得不需要越來越大的模型、越來越多的訓練資料來獲取更多知識——將Better和Bigger綁在了一起。

代價就是參數量龐大,效率也受到了影響。

而根據GoogleAI團隊介紹,他們採用的主要方法名曰:掩碼影像建模 (Masked image modeling)。

這是一種新興的自我監督預訓練方法,其基本想法簡單來說就是:

輸入影像的一部分被隨機屏蔽掉,然後透過預訓練文字任務進行重建。

Muse模型在離散標記的空間遮罩上訓練,並結合從預訓練語言大模型中提取的文本,預測隨機遮蔽的圖像標記。

從上到下依序為:預訓練的文字編碼器、基礎模型、超解析度模型

Google團隊發現,使用預先訓練好的大語言模型,可以讓AI對語言的理解更加細緻透徹。

就輸出而言,由於AI對物體的空間關係、姿態等要素把握得很不錯,所以生成的圖像可以做到高保真。

與DALL·E 2、Imagen等像素空間的擴散模型相比,Muse用的是離散的token,且取樣迭代較少。

另外,和Parti等自迴歸模型相比,Muse使用了平行解碼,效率也更高。

FID上獲SOTA分數

前文提到,Muse不僅在效率上取得了提升,在生成影像品質上也非常優秀。

研究者把它與DALL·E、LAFITE、LDM、GLIDE、DALL·E 2,以及谷歌自家的Imagen和Parti進行PK,測試了它們的FID和CLIP分數。

(FID分數用於評估生成影像的質量,分數越低質量越高;CLIP分數則代表文字與影像的契合程度,分數越高越好。)

結果顯示,Muse-3B模型在COCO驗證集中的zero-shot FID-30K得分為7.88,僅次於參數較大的Imagen-3.4B和Parti-20B模型。

更優秀的是,Muse-900M模型在CC3M資料集上實現了新的SOTA,FID分數為6.06,這也意味著它與文字的匹配度是最高的。

同時,此模型的CLIP分數為0.26,也達到了同期最高水準。

除此之外,為了進一步證實Muse的出圖效率,研究者也比較了Muse與其他模型的單張影像產生時間:

#在256x256、512x512的解析度上Muse均達到了最快速度:0.5s和1.3s。

研究團隊

Muse的研究團隊來自Google,兩位共同一作分別是Huiwen Chang和Han Zhang。

Huiwen Chang,現為Google資深研究員。

她本科就讀於清華大學,博士畢業於普林斯頓大學,有在Adobe、Facebook等的實習經驗。

Han Zhang,本科畢業於中國農業大學,碩士就讀於北京郵電大學,後在羅格斯大學取得了電腦科學博士學位。

其研究方向為電腦視覺,深度學習和醫學影像分析等。

不過值得一提的是,目前Muse還沒有正式發布。

有網友調侃,雖然它應該很香,但以穀歌的“尿性”,Muse離正式發布可能還有很長時間——畢竟他們還有18年的AI都沒發呢。

話說回來,你覺得Muse的效果怎麼樣?

對於其正式發布之事,有木有一點期待?

傳送門:https://www.php.cn/link/854f1fb6f65734d9e49f708d6cd84ad6

參考鏈接:https://twitter.com/AlphaSignalAI/status/ 1610404589966180360

以上是效率碾壓DALL·E 2和Imagen,Google新模型達成新SOTA,還能一句話搞定PS的詳細內容。更多資訊請關注PHP中文網其他相關文章!

AI內部部署的隱藏危險:治理差距和災難性風險Apr 28, 2025 am 11:12 AM

AI內部部署的隱藏危險:治理差距和災難性風險Apr 28, 2025 am 11:12 AMApollo Research的一份新報告顯示,先進的AI系統的不受檢查的內部部署構成了重大風險。 在大型人工智能公司中缺乏監督,普遍存在,允許潛在的災難性結果

構建AI測謊儀Apr 28, 2025 am 11:11 AM

構建AI測謊儀Apr 28, 2025 am 11:11 AM傳統測謊儀已經過時了。依靠腕帶連接的指針,打印出受試者生命體徵和身體反應的測謊儀,在識破謊言方面並不精確。這就是為什麼測謊結果通常不被法庭採納的原因,儘管它曾導致許多無辜者入獄。 相比之下,人工智能是一個強大的數據引擎,其工作原理是全方位觀察。這意味著科學家可以通過多種途徑將人工智能應用於尋求真相的應用中。 一種方法是像測謊儀一樣分析被審問者的生命體徵反應,但採用更詳細、更精確的比較分析。 另一種方法是利用語言標記來分析人們實際所說的話,並運用邏輯和推理。 俗話說,一個謊言會滋生另一個謊言,最終

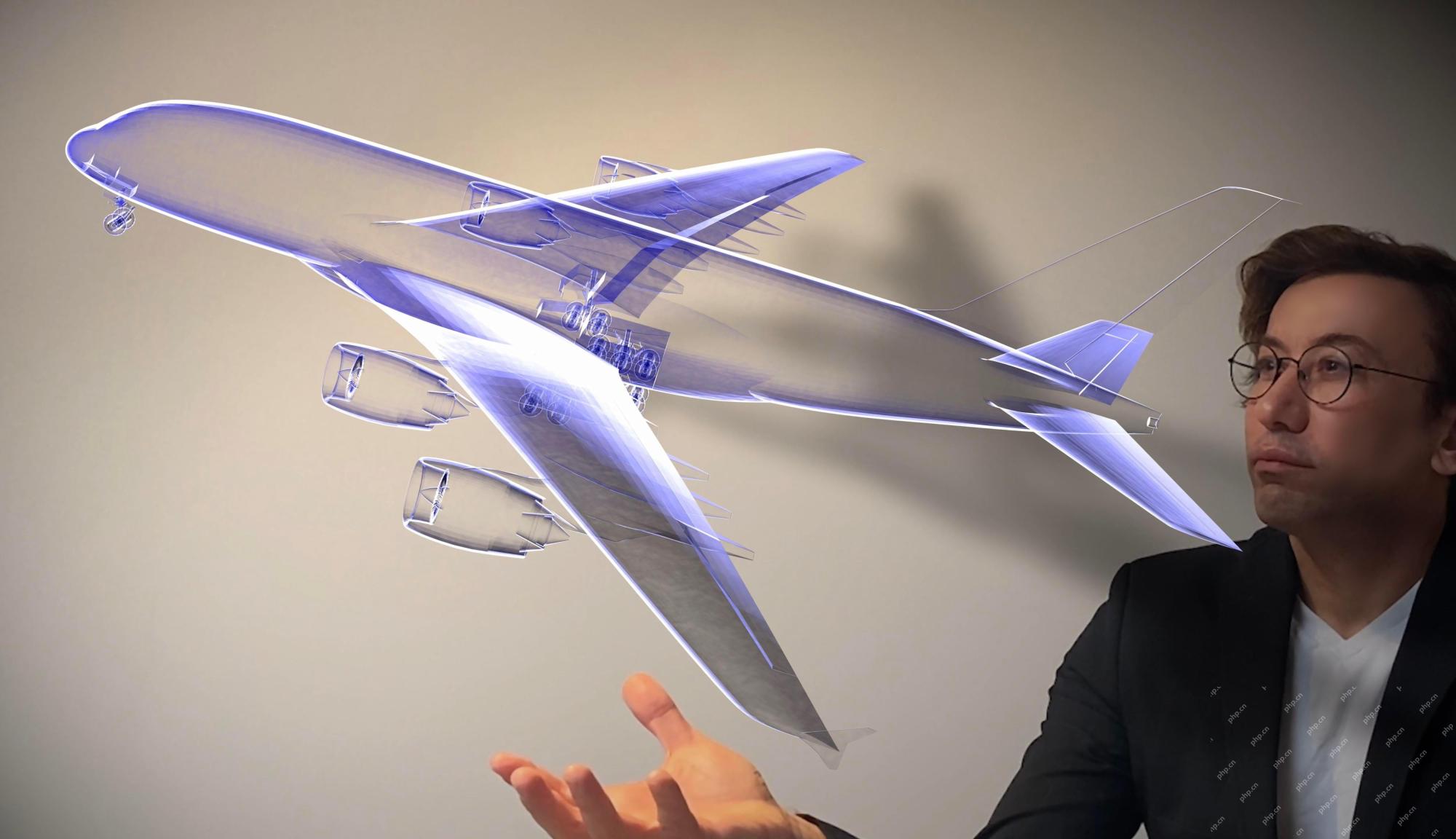

AI是否已清除航空航天行業的起飛?Apr 28, 2025 am 11:10 AM

AI是否已清除航空航天行業的起飛?Apr 28, 2025 am 11:10 AM航空航天業是創新的先驅,它利用AI應對其最複雜的挑戰。 現代航空的越來越複雜性需要AI的自動化和實時智能功能,以提高安全性,降低操作

觀看北京的春季機器人比賽Apr 28, 2025 am 11:09 AM

觀看北京的春季機器人比賽Apr 28, 2025 am 11:09 AM機器人技術的飛速發展為我們帶來了一個引人入勝的案例研究。 來自Noetix的N2機器人重達40多磅,身高3英尺,據說可以後空翻。 Unitree公司推出的G1機器人重量約為N2的兩倍,身高約4英尺。比賽中還有許多體型更小的類人機器人參賽,甚至還有一款由風扇驅動前進的機器人。 數據解讀 這場半程馬拉松吸引了超過12,000名觀眾,但只有21台類人機器人參賽。儘管政府指出參賽機器人賽前進行了“強化訓練”,但並非所有機器人均完成了全程比賽。 冠軍——由北京類人機器人創新中心研發的Tiangong Ult

鏡子陷阱:人工智能倫理和人類想像力的崩潰Apr 28, 2025 am 11:08 AM

鏡子陷阱:人工智能倫理和人類想像力的崩潰Apr 28, 2025 am 11:08 AM人工智能以目前的形式並不是真正智能的。它擅長模仿和完善現有數據。 我們不是在創造人工智能,而是人工推斷 - 處理信息的機器,而人類則

新的Google洩漏揭示了方便的Google照片功能更新Apr 28, 2025 am 11:07 AM

新的Google洩漏揭示了方便的Google照片功能更新Apr 28, 2025 am 11:07 AM一份報告發現,在谷歌相冊Android版7.26版本的代碼中隱藏了一個更新的界面,每次查看照片時,都會在屏幕底部顯示一行新檢測到的面孔縮略圖。 新的面部縮略圖缺少姓名標籤,所以我懷疑您需要單獨點擊它們才能查看有關每個檢測到的人員的更多信息。就目前而言,此功能除了谷歌相冊已在您的圖像中找到這些人之外,不提供任何其他信息。 此功能尚未上線,因此我們不知道谷歌將如何準確地使用它。谷歌可以使用縮略圖來加快查找所選人員的更多照片的速度,或者可能用於其他目的,例如選擇要編輯的個人。我們拭目以待。 就目前而言

加固芬特的指南 - 分析VidhyaApr 28, 2025 am 09:30 AM

加固芬特的指南 - 分析VidhyaApr 28, 2025 am 09:30 AM增強者通過教授模型根據人類反饋進行調整來震撼AI的開發。它將監督的學習基金會與基於獎勵的更新融合在一起,使其更安全,更準確,真正地幫助

讓我們跳舞:結構化運動以微調我們的人類神經網Apr 27, 2025 am 11:09 AM

讓我們跳舞:結構化運動以微調我們的人類神經網Apr 27, 2025 am 11:09 AM科學家已經廣泛研究了人類和更簡單的神經網絡(如秀麗隱桿線蟲中的神經網絡),以了解其功能。 但是,出現了一個關鍵問題:我們如何使自己的神經網絡與新穎的AI一起有效地工作

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

mPDF

mPDF是一個PHP庫,可以從UTF-8編碼的HTML產生PDF檔案。原作者Ian Back編寫mPDF以從他的網站上「即時」輸出PDF文件,並處理不同的語言。與原始腳本如HTML2FPDF相比,它的速度較慢,並且在使用Unicode字體時產生的檔案較大,但支援CSS樣式等,並進行了大量增強。支援幾乎所有語言,包括RTL(阿拉伯語和希伯來語)和CJK(中日韓)。支援嵌套的區塊級元素(如P、DIV),

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

SAP NetWeaver Server Adapter for Eclipse

將Eclipse與SAP NetWeaver應用伺服器整合。

VSCode Windows 64位元 下載

微軟推出的免費、功能強大的一款IDE編輯器