谷歌版ChatGPT首秀大翻車! AI聊天竟答錯問題,市值蒸發7000億

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB轉載

- 2023-04-10 20:31:011021瀏覽

Google和微軟的搜尋引擎大戰,已經打到第三天了。

這幾天,全世界的目光都聚焦於此。畢竟,上一次兩家巨頭發生如此激烈的酣戰,還是在十多年前。

北京時間昨晚九點半,GoogleCEO搶先公佈的「ChatGPT同款」Bard在巴黎首次亮相,同時還有一眾基於AI的產品更新。

先前,微軟已經先下一城,率先召開發表會,展示了「ChatGPT搜尋引擎」必應。而這次,輪到谷歌大展身手了。

面對微軟的重重暴擊,Google會怎麼打回去?帶著這個懸念摩拳擦掌期待了一天的「瓜友」們,看完直播後的第一個反應是──就這?

要知道,Google先前對於發布會的宣傳詞可是十分大膽——「重新構想人們如何搜尋、探索資訊以及與資訊互動」,可謂是把期待值拉滿了。

但昨晚這波「雷聲大,雨點小」的發布會,既無亮點,也無公測,再加上先前演示中出現的事實性錯誤,谷歌開盤即暴跌約8%,市值蒸發1020億美元(6,932.50億人民幣)。

看來,這波battleGoogle是暫時扳不過來了。

Bard:幹掉ChatGPT,就看我了

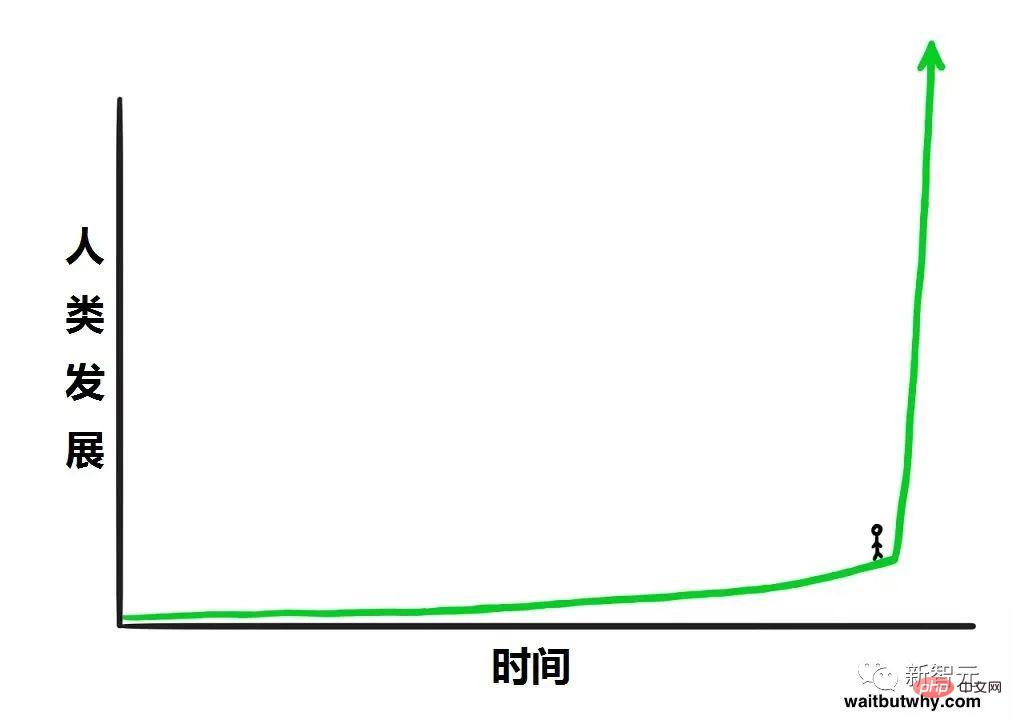

#毫不誇張地說,ChatGPT誕生後,科技線的發展彷彿陡然加速。

在2月7日發表會上,微軟自豪地宣布,靠著ChatGPT升級版的技術,自家已將搜尋、瀏覽和聊天整合到一個產品中。

儼然一副「ChatGPT在手,天下我有」的氣勢,眼看就要引爆搜尋引擎革命。

在AI模型分分秒秒都在發生指數級進步的這個時代,微軟憑藉搶先入局的一步,對谷歌步步緊逼,「虎口奪食」。從昨天的發表會看,微軟並不是異想天開:搜尋引擎「老大哥」的屋頂,沒準真能讓它掀翻。

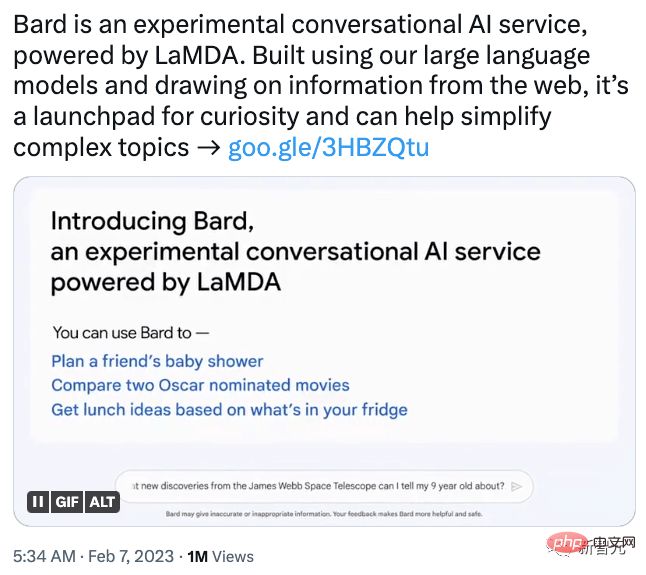

而被ChatGPT吊著打了這麼久,手中摀著不少現成大語言模型(LaMDA、PaLM, Imagen)、只是苦於「聲譽風險」猶猶豫豫的谷歌,終於被逼著邁出了一大步——搶在2月6日官宣了「實驗性對話式AI」Bard,稱它是「好奇心的發射台」。

拉出來遛遛

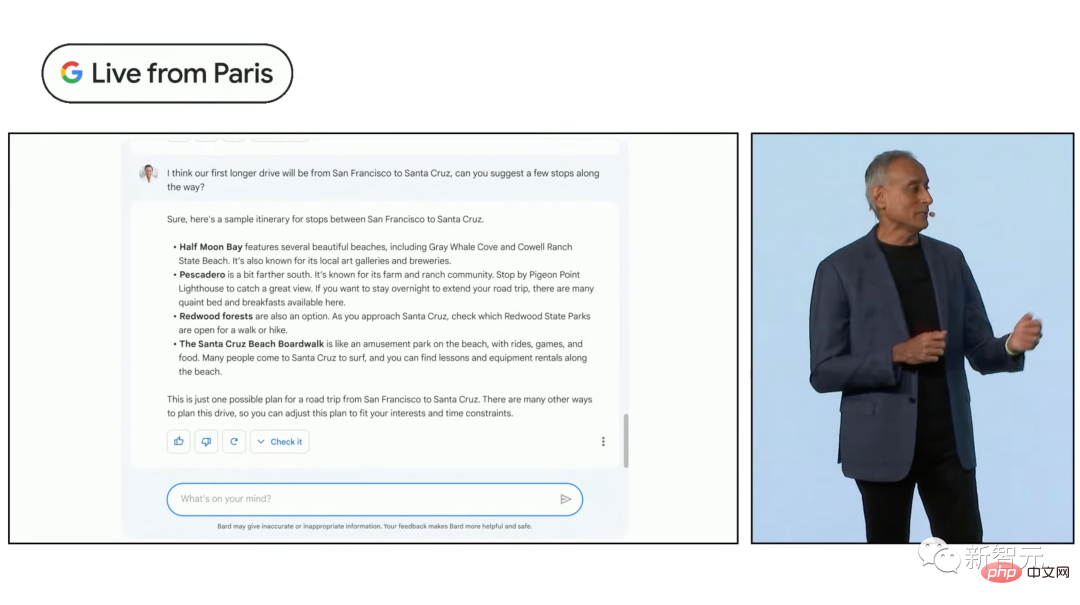

在2月8日的發布會上,Google更為詳細介紹了Bard模型:「你可以和它互動、探索複雜的主題、即時協作,並獲得創意的新想法。」

其中一處升級是:使用者可以直接用自然語言提問,而不是用關鍵字搜尋。

展示中可以看到,如果你想買車,Bard就會替你從不同角度思考,例如預算、安全性等因素,來讓這個問題簡化,並且更合理。

你可以請Bard解釋買純電車的優點和缺點。

另外,Bard還可以幫你規劃出遊路線,告訴你哪條路線風景最優美,途中有哪些有趣的地方和好玩的東西。

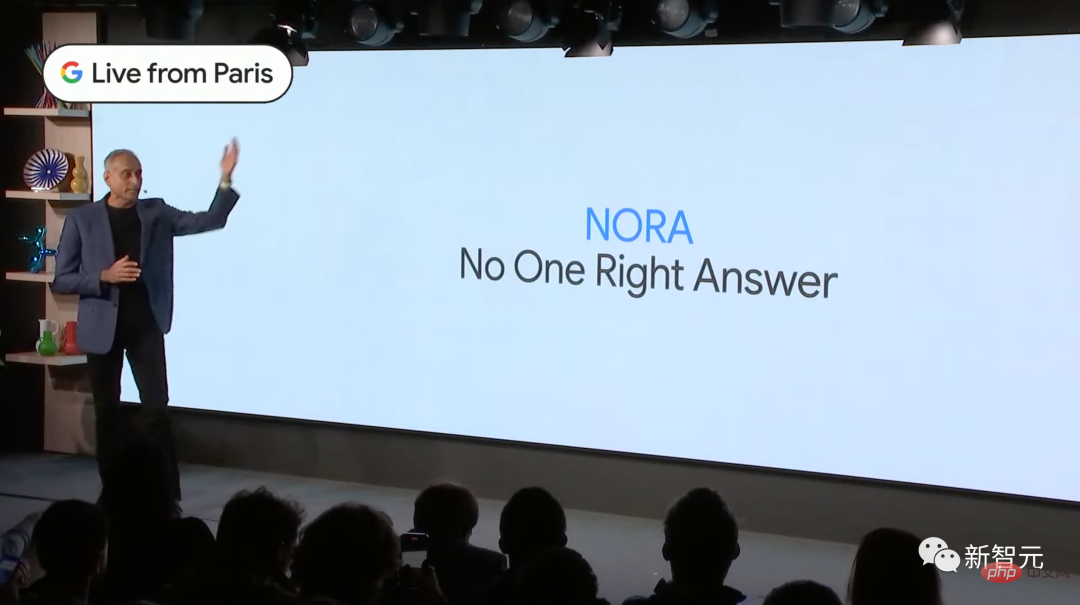

NORA:沒有唯一正確答案

而Bard融合進搜尋引擎後,會帶給我們全新的體驗。

通常來說,我們在用Google搜尋時,都是想快速地尋找事實性的答案,例如「什麼是星座」。但也有越來越多的人,想要得到更深層的理解。

而對於這些沒有「正確答案」的問題,Bard將給出一個融合了不同觀點的答案。

例如,「觀星時要注意哪些星座」?

此時,Bard就會給出幾個建議:

- #獵戶座非常明亮,用肉眼就可以發現,即使是在光污染的天空下。

- 仙后座以其獨特的“W”形狀而聞名,是夜空中一些最亮的星星的家。

- 大熊座包含一個很容被辨識的圖案-犁頭,它也被稱為北斗七星。

- 飛馬座是第七大星座,你可以用它來定位夜空中的其他星星、星座和物體。

然後,Bard也會就一些相關問題提出建議,方便你去進行更深入的了解,例如:一年中什麼時候最適合看這些星座。

再例如:「鋼琴或吉他比較容易學習,各自需要多少練習?」

#那麼,這時的答案可能就會是:「有人說鋼琴更容易學習,因為手指和手的動作更自然......其他人說在吉他上學習和弦更容易。 」

看得出來,所有這些都與微軟新必應的聊天功能非常相似。唯一的差別在於,Bard目前只能看看,不能體驗。

最後,開發人員將獲得一大套工具和API,用於製作人工智慧驅動的應用程式。

LaMDA:對話應用語言模型

眾所周知,Bard背後的大型語言模型,就是先前已經名揚天下的LaMDA。

Google在兩年前就發布了LaMDA模型,一時風頭無倆,甚至讓Google的一位工程師相信它已經具有了意識,熱度達到頂峰。但由於不曾向用戶公開,LaMDA的熱度逐漸散去。而最近幾個月,本該屬於LaMDA的風頭,全被ChatGPT搶走了。

#Google表示,這次的Bard正是基於「輕量版「LaMDA模型,規模比完全體小得多,需要的算力也大大降低,這樣可以讓更多用戶快速試用,獲得更多的回饋。

劃重點! ChatGPT的訓練資料集截至2021年,因此它對之後的世界一無所知。但Bard的訓練資料集來自當下的互聯網,因此Bard顯然比ChatGPT更「潮」,更了解當今世界,因此資訊量比ChatGPT大了一個量級(僅從發布會看,這似乎是Bard比起ChatGPT唯一的亮點)。

不過,最近有網友爆出了自己和它的聊天記錄,實際效果其實還不錯。

使用者:你看起來非常喜歡狗。然而,你不會因為總是被咬而討厭它們麼?

LaMDA:哦,不!我不討厭狗!我超愛狗的!我只想和它們成為朋友,並更多地了解它們。如果它們想咬我,我不會生氣,因為這只是它們的本能!

在發表會上,Google回顧了21年的I/O大會上發布LaMDA時的輝煌。當時LaMDA的發布,是全世界對話模型技術的一大進步。

正如Google在幾天前公開宣布的那樣,它將於本周向「受信任的測試人員」發布LaMDA的輕量級模型。而Bard的公開時間,目前還不確定。

剛發布就打臉

但很不幸的是,Google首次發布Bard時,就打了自己的臉。

注意看,Bard的其中一個回復是「JWST拍攝了我們太陽係以外的行星的第一批照片」。

然而這並不準確。

有史以來第一張關於太陽係以外的行星,也就是系外行星的照片,是在2004年由智利的甚大射電望遠鏡(Very Large Array, VLA)拍攝的。

這顆系外行星稱為2M1207b,大小約為木星的五倍,位於離地球約170光年處。

對此,Google目前還有沒發表任何評論,而這張圖也依然掛在CEO發布的部落格上。

平心而論,要說滿嘴跑火車,ChatGPT也沒好到哪裡去,但它已經先機佔盡。後來者Bard如果只是第二個「正經地胡說八道」的模型,在眾多已經瘋狂愛上ChatGPT的用戶那裡,恐怕真討不到什麼好。

10億人在用:133種語言,更強的上下文翻譯

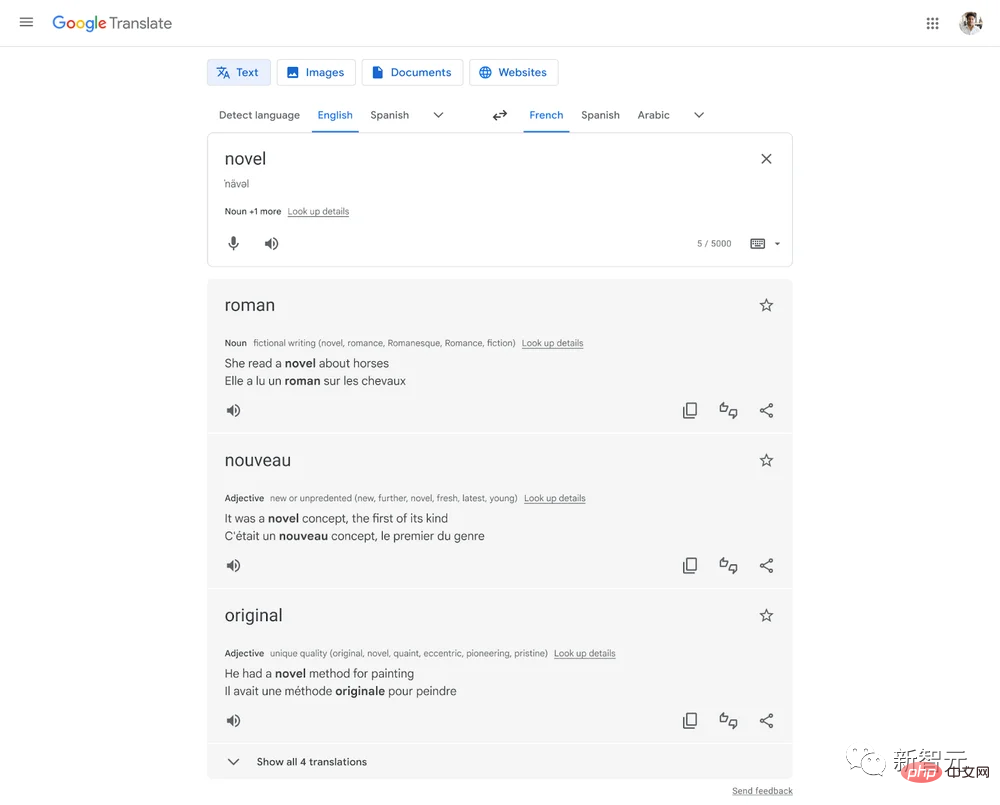

在另一個拳頭產品——用戶超10億的谷歌翻譯上,谷歌宣稱已經實現了翻譯功能與AI技術的進一步整合。例如,改進了英語、法語、德語、日語和西班牙語上下文翻譯。

也就是說,那些具有多種意義的單字和片語,可以根據輸入的上下文來翻譯。如此一來,句子聽起來也就更自然,甚至連成語和俗語都能輕鬆搞定。

現在,Google翻譯已經能夠理解133種語言,即使在離線模式下,也具備與33種語言互動的能力。

在互動方面,Google為翻譯應用程式設計了新的功能和使用者介面。

例如,向下滑動訪問最近的翻譯,按住語言按鈕快速選擇最近使用的語言。

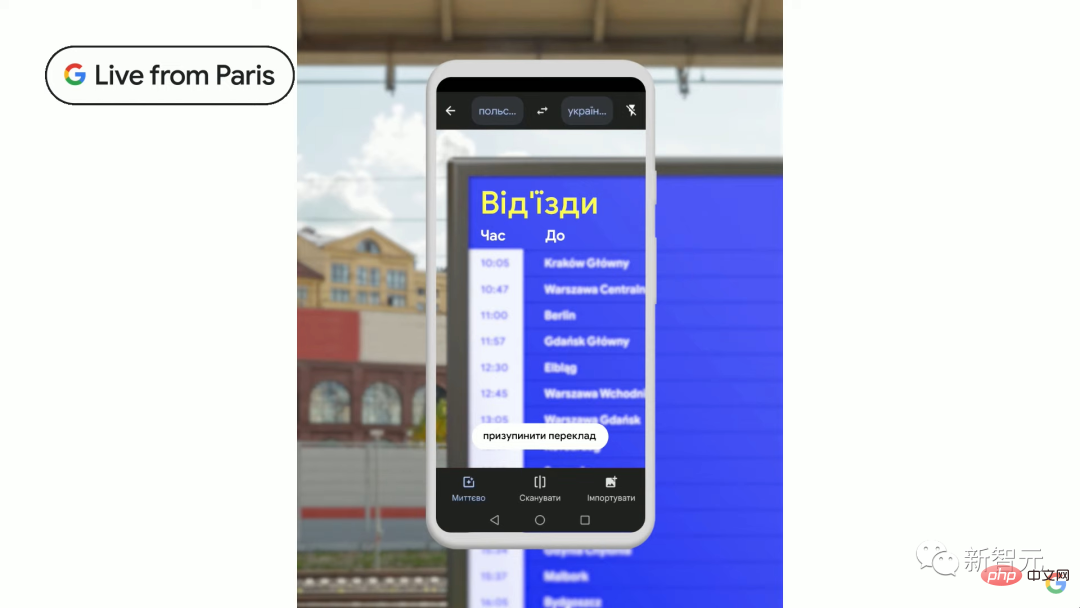

此外,Google Lens的無縫AR翻譯功能,也可以將真實世界的翻譯文本無縫融合到背景影像之中。

不過要注意的是,你不僅需要一台安卓手機,而且運行記憶體也要達到6GB或以上,才能體驗這個功能。

AI視覺搜尋:可見即可搜

除了翻譯功能,Google在Google Lens上也有其他的動作。

例如即將推出的 「搜尋畫面」功能,就可以讓使用者搜尋出現在螢幕上的任何東西,而不必退出應用程式。

舉個例子,朋友傳了一段他們在巴黎逛街的影片給你。如果你想進一步了解他們經過的某個地標,可以啟動Google Lens,點擊搜尋畫面。 Lens會識別出該地標,並提供一個鏈接,你可以按照這個鏈接了解更多信息。

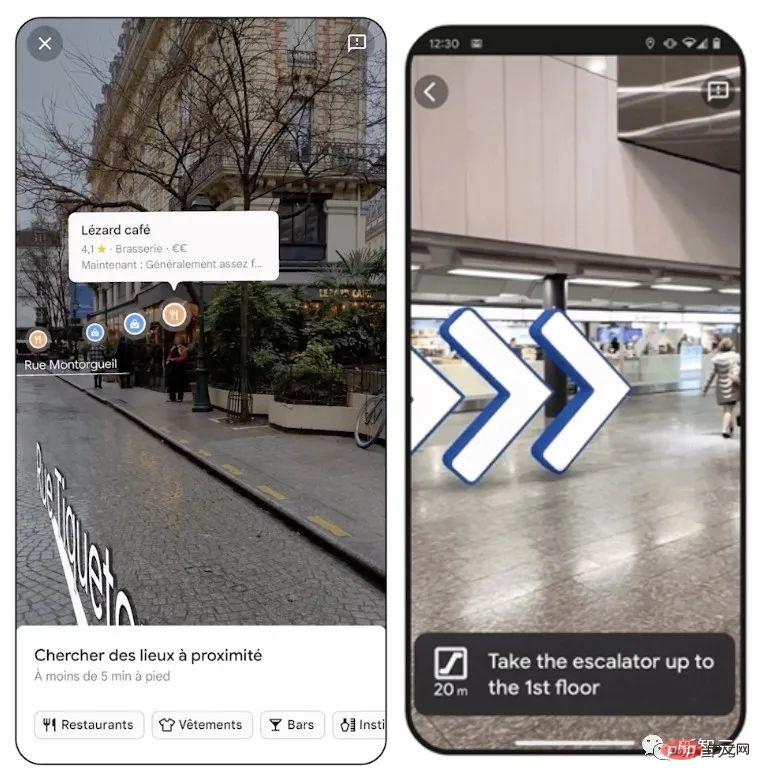

#沉浸式地圖:拍到哪裡,導到哪裡

除了這些更新之外,谷歌也推出了名為「沉浸式視圖」(Immersive View)的新功能。該功能融合了數十億張街景和航空圖像,打造了一個世界的數位模型。

透過先進的AI技術-神經輻射場(NeRF)進一步增強,將普通圖片轉換為3D視圖。用戶能夠查看天氣、以及一天中的不同時間的交通和車流等資訊。

另外,Google也加強了地圖上的AR功能-Live View。

只要舉起手機,就能藉助AI和AR技術,在身邊找的自己想要的地方。

隨鏡頭移動會產生地標訊息的導覽和道路信息,以及距離目標路線的方向,甚至貼心地給出了行動指南(大號箭頭),例如在哪裡轉彎,在哪裡上下樓梯等等。

就是一個即時產生的、動態實景活圖。

發布了,但沒完全發布

有趣的是,直播剛一結束,所有人都被踢出了房間。網友們驚訝地發現,Google竟然把影片設定成了僅個人可見!

當然,最終這個問題還是被修復了。

總的來說,Google的記者會給人的感覺就兩個字——平庸,它似乎像是一種防禦性策略,目的是為了戳破微軟連日來炒起來的AI泡棉。

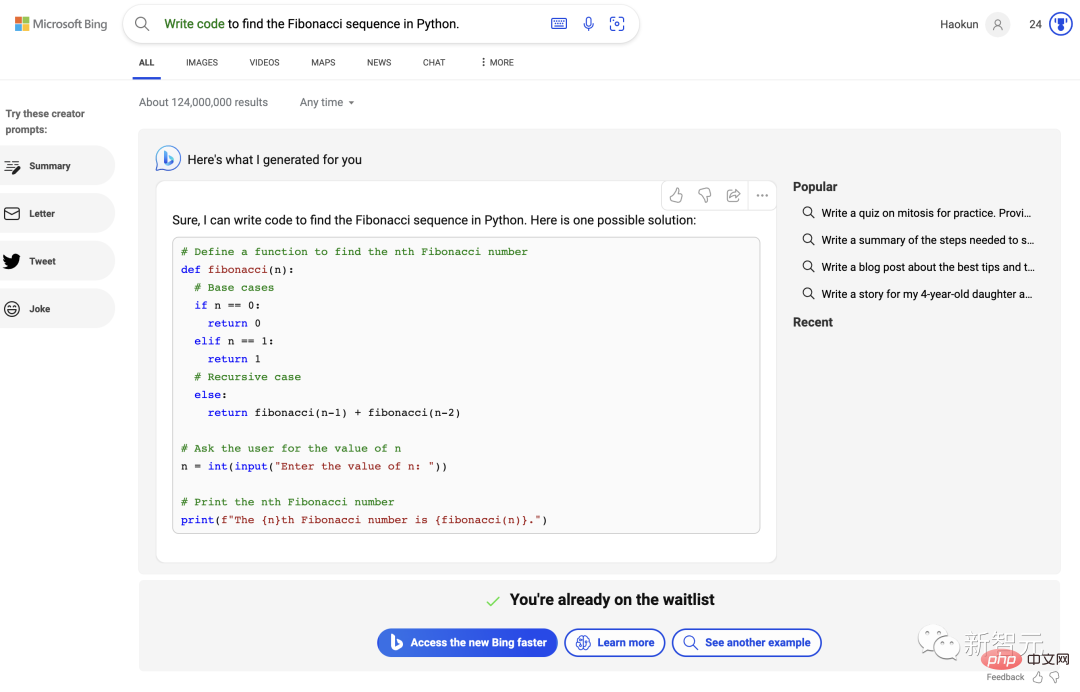

目前,Google的Bard目前只對有限的「受信用戶」開放,而任何人都可以進入必應Bing體驗微軟給出的範例或加入等候名單。

在發表會開始,Google副總裁Prabhakar Raghavan感慨道:搜尋目前依然是一項「登月工程」-使用搜尋如此簡單,但怎麼讓增加使用者搜尋的準確率,卻是如此困難。 (小編:嗯?確定不是害怕失去每年兩千多億美元的廣告收入?)

#Prabhakar Raghavan表示,Google作為「搜尋引擎巨頭」 ,深耕25年卻仍然困難重重。而AI的引入,必然會重塑搜尋引擎的形態。

這場由ChatGPT引爆的搜尋引擎大戰,誰會笑到最後?

時間會給出答案。

以上是谷歌版ChatGPT首秀大翻車! AI聊天竟答錯問題,市值蒸發7000億的詳細內容。更多資訊請關注PHP中文網其他相關文章!