目前該論文已經被CVPR2023接收。

能讀圖的GPT-4震撼發佈了!但要用它還得排隊。 。 。

不如先試試這個~

加上一個小模型,就能讓ChatGPT、GPT-3這類目前只能理解文字的大語言模型輕鬆讀圖,各種刁鑽的細節問題都能手拿把掐。

並且訓練這個小模型單卡(一塊RTX 3090)就能搞定。

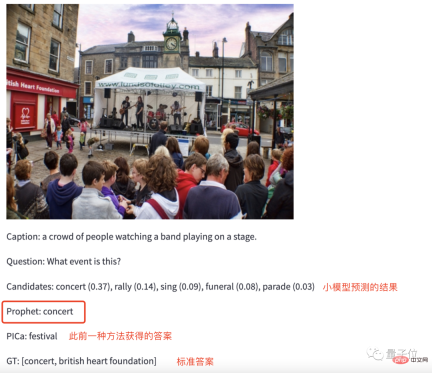

效果呢,直接看圖。

比如說,給訓練後的GPT-3輸入一張「音樂現場」的圖片,問它:現場在舉辦什麼活動?

毫不遲疑,GPT-3給了音樂會的答案。

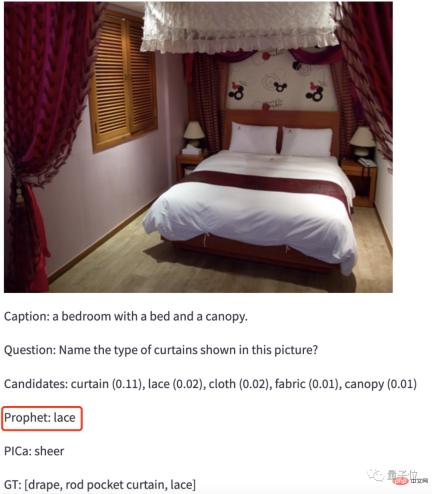

再來加點難度,再給GPT-3醬紫的一張照片,讓它來分辨照片中的簾子是什麼類型的材質。

GPT-3:蕾絲。

Bingo! (看來有點兒東西在身上的)

這個方法呢,是杭州電子科技大學和合肥工業大學的一個團隊的最新成果:Prophet,半年前他們就已經著手進行這項工作。

論文一作是杭電研究生邵鎮煒,他在1歲那年被診斷患有“進行性脊肌萎縮症”,高考時遺憾與浙大擦肩,選擇了離家近的杭州電子科技大學。

目前論文已經被CVPR2023接收。

跨模態任務上達到新SOTA

話不多說,直接來看在Prophet這種方法的加持下GPT-3的讀圖能力。

我們先來看看它在資料集上的測試結果。

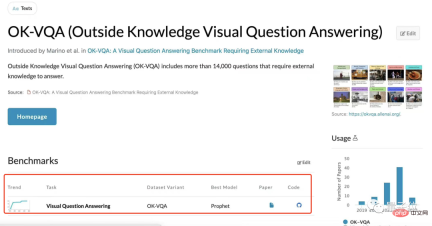

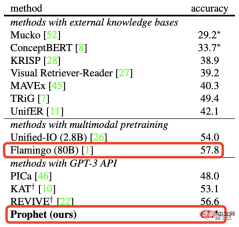

研究團隊在兩個基於外部知識的視覺問答資料集OK-VQA和A-OKVQA測試了Prophet,都創造了新SOTA。

更具體點,在OK-VQA資料集上,和Deepmind的擁有80B參數的大模型Flamingo對比,Prophet達到了61.1%的準確率,成功擊敗Flamingo(57.8%)。

並且在所需的算力資源上,Prophet也是「吊打」Flamingo。

Flamingo-80B需要在1536塊TPUv4顯示卡上訓練15天,而Prophet只需要一塊RTX-3090顯示卡訓練VQA模型4天,再呼叫一定次數的OpenAI API即可。

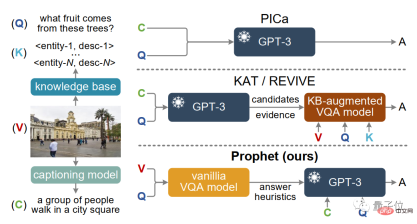

其實,類似Prophet這種幫助GPT-3處理跨模態任務的方法之前也有,比如說PICa,以及之後的KAT和REVIVE。

不過它們在一些細節問題的處理中,可能就不盡人意。

舉個栗子,讓它們一起讀下面這張圖,然後回答問題:圖片中的樹會結什麼水果?

而PICa、KAT和REVIVE從圖片中提取到的資訊只有:一群人在廣場上走路,完全忽略掉了後面還有一顆椰子樹。最終給的答案也只能靠瞎猜。

而Prophet這邊,就不會出現這種情況,它解決了上述方法提取圖片資訊不充分的問題,進一步激發了GPT-3的潛能。

那Prophet是怎麼做的呢?

小模型 大模型

有效提取訊息,並準確回答問題,能做到這些Prophet依賴的是它獨特的兩階段框架。

這兩個階段也分工明確:

- 第一階段:根據問題給予一些啟發性的答案;

- 第二階段:這些答案會縮一些範圍,讓GPT-3有充分的空間發揮潛能。

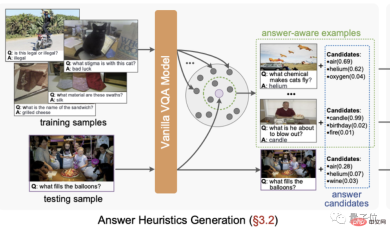

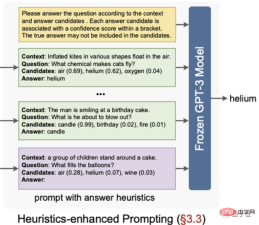

首先是第一階段,研究團隊針對特定的外部知識VQA資料集訓練了一個改進的MCAN模型(一個VQA模型)。

訓練好模型後,從中提取兩個啟發性的答案:答案候選和答案感知範例。

其中,答案候選是以模型分類層輸出的置信度為依據對答案進行排序,選取裡面的top10。

答案感知範例時指,將模型分類層之前的特徵作為樣本的潛在答案特徵,這個特徵空間中最相近的標註樣本。

接下來就是第二階段,這一步相對來說就很簡單又粗暴了。

講上一步得到的「啟發性答案」組織到prompt中,然後再將prompt輸入給GPT-3,在一定的提示之下完成視覺問答問題。

不過雖然上一步已經給出一些答案提示,但這並不意味著GPT-3就要被限制在這些答案中。

若提示給出的答案置信度太低或正確答案並不在那些提示中,GPT-3完全完全有可能產生新的答案。

研究團隊

當然,除了研究成果外,這項研究背後的團隊也不得不提。

第一作者邵鎮煒在1歲時就確診“進行性脊肌萎縮症”,是肢體一級殘疾,沒有生活自理能力,生活和學習需要母親的全程照顧。

不過雖然身體受限,但邵鎮煒對知識的渴求並沒有減弱。

2017年高考他拿下644分的高分,以第一名的成績被杭州電子科技大學電腦專業錄取。

期間也獲得2018年中國大學生自強之星、2020年度國家獎學金和2021年度浙江省優秀畢業生等榮譽。

本科期間,邵鎮煒就已經開始跟著餘裕教授進行科研活動。

2021年,邵鎮煒在準備研究生推免時與浙大擦肩,於是留校加入了余宙教授課題組攻讀碩士研究生,目前他在讀研二,研究方向是跨模態學習。

餘裕教授則是本次研究論文的二作以及通訊作者,他是杭電電腦學院最年輕的教授,教育部「複雜系統建模與模擬」實驗室副主任。

長期以來,餘宙專攻多模態智能方向,曾帶領研究團隊多次獲得國際視覺問答挑戰賽VQA Challenge的冠亞軍。

研究團隊的大部分成員都在杭電媒體智慧實驗室(MIL)。

實驗室由國家傑青俞俊教授負責,近年來實驗室圍繞多模態學習方向發表一系列高水平期刊會議論文(TPAMI、IJCV、CVPR等),多次獲得IEEE期刊會議的最佳論文獎。

實驗室主持國家重點研發計畫、國家自然科學基金重點計畫等國家級計畫20餘項,曾獲浙江省自然科學一等獎,教育自然科學二等獎。

以上是杭電小哥搶先搞定GPT讀圖功能,單卡就能實現新SOTA,程式碼已開源的詳細內容。更多資訊請關注PHP中文網其他相關文章!

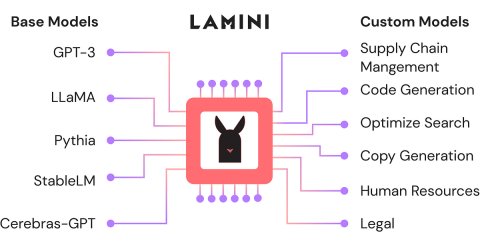

使用Lamini-Analytics Vidhya微調開源LLMApr 12, 2025 am 10:20 AM

使用Lamini-Analytics Vidhya微調開源LLMApr 12, 2025 am 10:20 AM最近,隨著大語言模型和AI的興起,我們看到了自然語言處理方面的無數進步。文本,代碼和圖像/視頻生成等域中的模型具有存檔的人類的推理和P

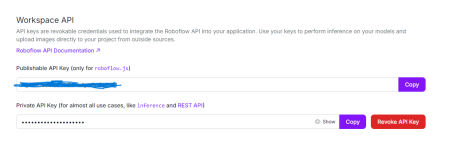

Python中使用OpenCV和Roboflow進行性別檢測 - 分析VidhyaApr 12, 2025 am 10:19 AM

Python中使用OpenCV和Roboflow進行性別檢測 - 分析VidhyaApr 12, 2025 am 10:19 AM介紹 從面部圖像中檢測性別是計算機視覺的眾多迷人應用之一。在這個項目中,我們將OpenCV結合在一起,以解決位置與性別分類的Roboflow API

生成AI在個性化廣告內容中的作用是什麼?Apr 12, 2025 am 10:18 AM

生成AI在個性化廣告內容中的作用是什麼?Apr 12, 2025 am 10:18 AM介紹 自易貨系統概念以來,廣告世界一直在進化。廣告商找到了創造性的方法來引起我們的關注。在當前年齡,消費者期望BR

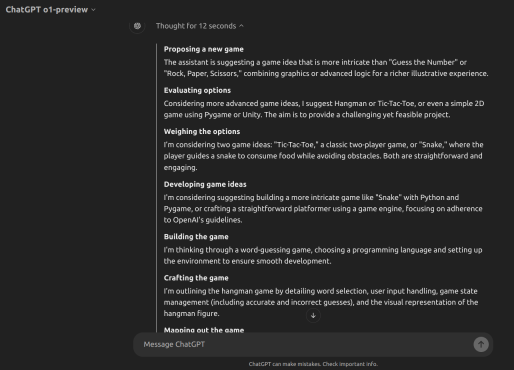

Openai' o1-preview vs o1-mini:向前邁出的一步Apr 12, 2025 am 10:04 AM

Openai' o1-preview vs o1-mini:向前邁出的一步Apr 12, 2025 am 10:04 AM介紹 9月12日,OpenAI發布了一項名為“與LLM的學習推理”的更新。他們介紹了O1模型,該模型是使用強化學習來應對複雜推理任務的訓練。是什麼設置了此mod

如何使用OpenAI O1構建遊戲? - 分析VidhyaApr 12, 2025 am 10:03 AM

如何使用OpenAI O1構建遊戲? - 分析VidhyaApr 12, 2025 am 10:03 AM介紹 OpenAI O1模型家族大大提高了推理能力和經濟表現,尤其是在科學,編碼和解決問題方面。 Openai的目標是創建越來越高的AI和O1模型

流行的LLM代理工具用於客戶查詢管理Apr 12, 2025 am 10:01 AM

流行的LLM代理工具用於客戶查詢管理Apr 12, 2025 am 10:01 AM介紹 如今,客戶查詢管理的世界正在以前所未有的速度移動,每天都有新的工具成為頭條新聞。大型語言模型(LLM)代理是在這種情況下的最新創新,增強了Cu

100天企業的AI實施計劃Apr 12, 2025 am 09:56 AM

100天企業的AI實施計劃Apr 12, 2025 am 09:56 AM介紹 採用生成AI可能是任何公司的變革旅程。但是,Genai實施過程通常會繁瑣且令人困惑。 Niit Lim的董事長兼聯合創始人Rajendra Singh Pawar

Pixtral 12B與QWEN2-VL-72BApr 12, 2025 am 09:52 AM

Pixtral 12B與QWEN2-VL-72BApr 12, 2025 am 09:52 AM介紹 人工智能革命引起了創造力的新時代,文本對圖像模型正在重新定義藝術,設計和技術的交集。 pixtral 12b和qwen2-vl-72b是兩個開創性的力量。

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

Atom編輯器mac版下載

最受歡迎的的開源編輯器

SecLists

SecLists是最終安全測試人員的伙伴。它是一個包含各種類型清單的集合,這些清單在安全評估過程中經常使用,而且都在一個地方。 SecLists透過方便地提供安全測試人員可能需要的所有列表,幫助提高安全測試的效率和生產力。清單類型包括使用者名稱、密碼、URL、模糊測試有效載荷、敏感資料模式、Web shell等等。測試人員只需將此儲存庫拉到新的測試機上,他就可以存取所需的每種類型的清單。

DVWA

Damn Vulnerable Web App (DVWA) 是一個PHP/MySQL的Web應用程序,非常容易受到攻擊。它的主要目標是成為安全專業人員在合法環境中測試自己的技能和工具的輔助工具,幫助Web開發人員更好地理解保護網路應用程式的過程,並幫助教師/學生在課堂環境中教授/學習Web應用程式安全性。 DVWA的目標是透過簡單直接的介面練習一些最常見的Web漏洞,難度各不相同。請注意,該軟體中

SublimeText3 Linux新版

SublimeText3 Linux最新版

EditPlus 中文破解版

體積小,語法高亮,不支援程式碼提示功能