Peranti teknologi

Peranti teknologi AI

AI Model penyebaran gaya 'matryoshka' Apple mengurangkan bilangan langkah latihan sebanyak 70%!

Model penyebaran gaya 'matryoshka' Apple mengurangkan bilangan langkah latihan sebanyak 70%!Model penyebaran gaya 'matryoshka' Apple mengurangkan bilangan langkah latihan sebanyak 70%!

Satu penyelidikan terbaharu oleh Apple telah meningkatkan prestasi model resapan pada imej resolusi tinggi.

Menggunakan kaedah ini, bilangan langkah latihan untuk imej dengan resolusi yang sama dikurangkan lebih daripada 70%.

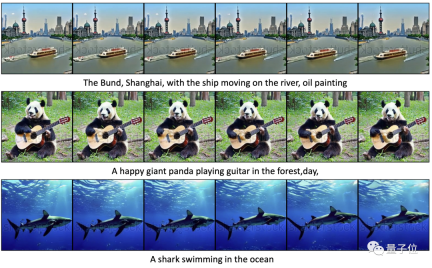

Pada resolusi 1024×1024, kualiti gambar langsung penuh, dan butirannya jelas kelihatan.

Apple menamakan pencapaian ini sebagai MDM, DM ialah singkatan dari Diffusion Model, dan M pertama ialah Matryoshka.

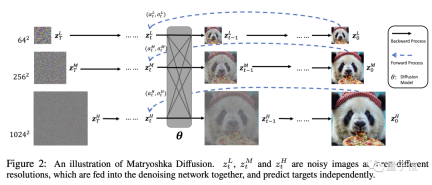

Sama seperti anak patung matryoshka sebenar, MDM menyusun proses peleraian rendah dalam proses resolusi tinggi, dan ia bersarang dalam berbilang lapisan.

Proses resapan resolusi tinggi dan rendah dijalankan serentak, yang sangat mengurangkan penggunaan sumber model resapan tradisional dalam proses resolusi tinggi.

Untuk imej resolusi 256×256, dalam persekitaran dengan saiz kelompok 1024, model resapan tradisional memerlukan 1.5 juta langkah latihan, manakala MDM hanya memerlukan 390,000 langkah, iaitu pengurangan lebih daripada 70% .

Selain itu, MDM menggunakan latihan hujung ke hujung dan tidak bergantung pada set data khusus dan model pra-latihan Ia meningkatkan kelajuan sambil tetap memastikan kualiti penjanaan dan fleksibel untuk digunakan.

Bukan sahaja anda boleh melukis imej beresolusi tinggi, tetapi anda juga boleh mensintesis video 16×256².

Beberapa netizen mengulas bahawa Apple akhirnya menyambungkan teks kepada imej.

Jadi, bagaimana sebenarnya teknologi "matryoshka" MDM berfungsi?

Menggabungkan keseluruhan dan progresif

Sebelum memulakan latihan, data perlu dipraproses imej akan disampel semula menggunakan algoritma tertentu untuk mendapatkan versi resolusi yang berbeza.

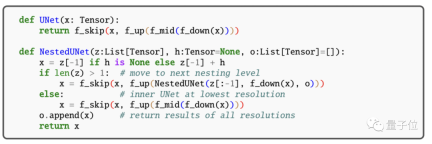

Kemudian kami menggunakan data resolusi berbeza ini untuk pemodelan UNet bersama UNet kecil mengendalikan resolusi rendah dan disarangkan ke dalam UNet besar yang mengendalikan resolusi tinggi.

Melalui sambungan resolusi silang, ciri dan parameter boleh dikongsi antara UNet dengan saiz yang berbeza.

Latihan MDM adalah proses langkah demi langkah.

Walaupun pemodelan dilakukan secara bersama, proses latihan tidak akan dilakukan untuk resolusi tinggi pada permulaan, tetapi akan berkembang secara beransur-ansur dari resolusi rendah.

Ini boleh mengelakkan sejumlah besar pengiraan, dan juga membolehkan pra-latihan UNet resolusi rendah untuk mempercepatkan proses latihan resolusi tinggi.

Semasa proses latihan, data latihan beresolusi tinggi akan ditambah secara beransur-ansur pada keseluruhan proses, membolehkan model menyesuaikan diri dengan resolusi yang semakin meningkat dan beralih dengan lancar kepada proses resolusi tinggi terakhir.

Namun, secara keseluruhan, selepas proses resolusi tinggi ditambah secara beransur-ansur, latihan MDM masih merupakan proses bersama hujung ke hujung.

Dalam latihan bersama pada resolusi berbeza, fungsi kehilangan pada resolusi berbilang mengambil bahagian dalam kemas kini parameter bersama-sama, mengelakkan pengumpulan ralat yang disebabkan oleh latihan pelbagai peringkat.

Setiap resolusi mempunyai kehilangan pembinaan semula yang sepadan bagi item data Kehilangan resolusi yang berbeza ditimbang dan digabungkan untuk memastikan kualiti penjanaan, kehilangan resolusi rendah mempunyai berat yang lebih besar.

Dalam fasa inferens, MDM juga menggunakan strategi yang menggabungkan keselarian dan kemajuan.

Selain itu, MDM juga menggunakan model klasifikasi imej terlatih (CFG) untuk membimbing pengoptimuman sampel yang dijana ke arah yang lebih munasabah, dan menambah hingar pada sampel resolusi rendah untuk menjadikannya lebih dekat dengan pengedaran resolusi tinggi sampel.

Jadi, apakah kesan MDM?

Parameter yang lebih sedikit menyaingi SOTA

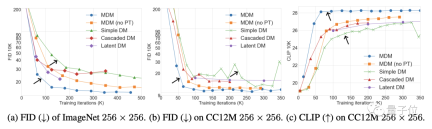

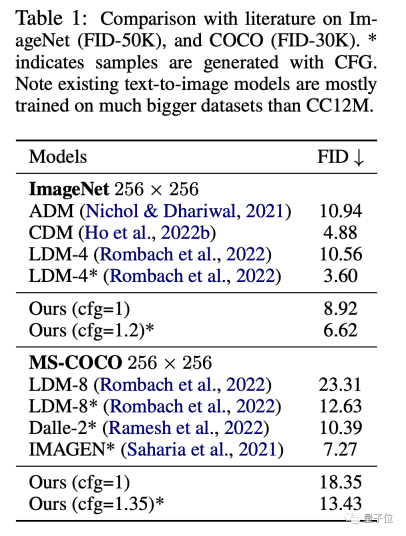

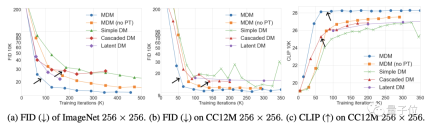

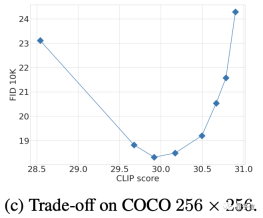

Dari segi imej, pada set data ImageNet dan CC12M, FID MDM (semakin rendah nilai, semakin baik kesannya) dan prestasi CLIP adalah jauh lebih baik daripada model resapan biasa.

Antaranya, FID digunakan untuk menilai kualiti imej itu sendiri, dan CLIP menggambarkan tahap pemadanan antara imej dan arahan teks.

Berbanding dengan model SOTA seperti DALL E dan IMAGEN, prestasi MDM juga sangat hampir, tetapi parameter latihan MDM jauh lebih rendah daripada model ini.

Bukan sahaja ia lebih baik daripada model resapan biasa, prestasi MDM juga melebihi model resapan lata yang lain.

Hasil percubaan ablasi menunjukkan bahawa semakin banyak langkah latihan resolusi rendah, semakin jelas peningkatan kesan MDM sebaliknya, semakin banyak tahap bersarang, semakin sedikit bilangan langkah latihan yang diperlukan untuk mencapai CLIP yang sama skor .

Pemilihan parameter CFG adalah hasil pertukaran antara FID dan CLIP selepas beberapa ujian (skor CLIP yang tinggi sepadan dengan peningkatan kekuatan CFG).

Atas ialah kandungan terperinci Model penyebaran gaya 'matryoshka' Apple mengurangkan bilangan langkah latihan sebanyak 70%!. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Cara Membina Pembantu AI Peribadi Anda Dengan Huggingface SmollmApr 18, 2025 am 11:52 AM

Cara Membina Pembantu AI Peribadi Anda Dengan Huggingface SmollmApr 18, 2025 am 11:52 AMMemanfaatkan kuasa AI di peranti: Membina CLI Chatbot Peribadi Pada masa lalu, konsep pembantu AI peribadi kelihatan seperti fiksyen sains. Bayangkan Alex, seorang peminat teknologi, bermimpi seorang sahabat AI yang pintar, yang tidak bergantung

AI untuk Kesihatan Mental dianalisis dengan penuh perhatian melalui inisiatif baru yang menarik di Stanford UniversityApr 18, 2025 am 11:49 AM

AI untuk Kesihatan Mental dianalisis dengan penuh perhatian melalui inisiatif baru yang menarik di Stanford UniversityApr 18, 2025 am 11:49 AMPelancaran AI4MH mereka berlaku pada 15 April, 2025, dan Luminary Dr. Tom Insel, M.D., pakar psikiatri yang terkenal dan pakar neurosains, berkhidmat sebagai penceramah kick-off. Dr. Insel terkenal dengan kerja cemerlangnya dalam penyelidikan kesihatan mental dan techno

Kelas Draf WNBA 2025 memasuki liga yang semakin meningkat dan melawan gangguan dalam talianApr 18, 2025 am 11:44 AM

Kelas Draf WNBA 2025 memasuki liga yang semakin meningkat dan melawan gangguan dalam talianApr 18, 2025 am 11:44 AM"Kami mahu memastikan bahawa WNBA kekal sebagai ruang di mana semua orang, pemain, peminat dan rakan kongsi korporat, berasa selamat, dihargai dan diberi kuasa," kata Engelbert, menangani apa yang telah menjadi salah satu cabaran sukan wanita yang paling merosakkan. Anno

Panduan Komprehensif untuk Struktur Data Terbina Python - Analytics VidhyaApr 18, 2025 am 11:43 AM

Panduan Komprehensif untuk Struktur Data Terbina Python - Analytics VidhyaApr 18, 2025 am 11:43 AMPengenalan Python cemerlang sebagai bahasa pengaturcaraan, terutamanya dalam sains data dan AI generatif. Manipulasi data yang cekap (penyimpanan, pengurusan, dan akses) adalah penting apabila berurusan dengan dataset yang besar. Kami pernah meliputi nombor dan st

Tayangan pertama dari model baru Openai berbanding dengan alternatifApr 18, 2025 am 11:41 AM

Tayangan pertama dari model baru Openai berbanding dengan alternatifApr 18, 2025 am 11:41 AMSebelum menyelam, kaveat penting: Prestasi AI adalah spesifik yang tidak ditentukan dan sangat digunakan. Dalam istilah yang lebih mudah, perbatuan anda mungkin berbeza -beza. Jangan ambil artikel ini (atau lain -lain) sebagai perkataan akhir -sebaliknya, uji model ini pada senario anda sendiri

AI Portfolio | Bagaimana untuk membina portfolio untuk kerjaya AI?Apr 18, 2025 am 11:40 AM

AI Portfolio | Bagaimana untuk membina portfolio untuk kerjaya AI?Apr 18, 2025 am 11:40 AMMembina portfolio AI/ML yang menonjol: Panduan untuk Pemula dan Profesional Mewujudkan portfolio yang menarik adalah penting untuk mendapatkan peranan dalam kecerdasan buatan (AI) dan pembelajaran mesin (ML). Panduan ini memberi nasihat untuk membina portfolio

AI AI apa yang boleh dimaksudkan untuk operasi keselamatanApr 18, 2025 am 11:36 AM

AI AI apa yang boleh dimaksudkan untuk operasi keselamatanApr 18, 2025 am 11:36 AMHasilnya? Pembakaran, ketidakcekapan, dan jurang yang melebar antara pengesanan dan tindakan. Tak satu pun dari ini harus datang sebagai kejutan kepada sesiapa yang bekerja dalam keselamatan siber. Janji Agentic AI telah muncul sebagai titik perubahan yang berpotensi. Kelas baru ini

Google Versus Openai: AI berjuang untuk pelajarApr 18, 2025 am 11:31 AM

Google Versus Openai: AI berjuang untuk pelajarApr 18, 2025 am 11:31 AMImpak segera berbanding perkongsian jangka panjang? Dua minggu yang lalu Openai melangkah ke hadapan dengan tawaran jangka pendek yang kuat, memberikan akses kepada pelajar A.S. dan Kanada.

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

SecLists

SecLists ialah rakan penguji keselamatan muktamad. Ia ialah koleksi pelbagai jenis senarai yang kerap digunakan semasa penilaian keselamatan, semuanya di satu tempat. SecLists membantu menjadikan ujian keselamatan lebih cekap dan produktif dengan menyediakan semua senarai yang mungkin diperlukan oleh penguji keselamatan dengan mudah. Jenis senarai termasuk nama pengguna, kata laluan, URL, muatan kabur, corak data sensitif, cangkerang web dan banyak lagi. Penguji hanya boleh menarik repositori ini ke mesin ujian baharu dan dia akan mempunyai akses kepada setiap jenis senarai yang dia perlukan.

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Muat turun versi mac editor Atom

Editor sumber terbuka yang paling popular

MinGW - GNU Minimalis untuk Windows

Projek ini dalam proses untuk dipindahkan ke osdn.net/projects/mingw, anda boleh terus mengikuti kami di sana. MinGW: Port Windows asli bagi GNU Compiler Collection (GCC), perpustakaan import yang boleh diedarkan secara bebas dan fail pengepala untuk membina aplikasi Windows asli termasuk sambungan kepada masa jalan MSVC untuk menyokong fungsi C99. Semua perisian MinGW boleh dijalankan pada platform Windows 64-bit.