Rumah >Peranti teknologi >AI >Sam Altman memberi amaran: AI akan menghapuskan manusia! 375+ bos menandatangani surat bersama 22 patah perkataan, LeCun menentang keputusan

Sam Altman memberi amaran: AI akan menghapuskan manusia! 375+ bos menandatangani surat bersama 22 patah perkataan, LeCun menentang keputusan

- PHPzke hadapan

- 2023-06-04 14:43:27751semak imbas

|Artikel ini diterbitkan semula daripada: Kebijaksanaan Baharu[Pengenalan Kepada Kebijaksanaan Baharu]Adakah AI benar-benar akan menghapuskan manusia? 375+ orang besar menandatangani surat bersama 22 perkataan.

Pada bulan Mac, beribu-ribu nama besar menandatangani surat bersama untuk menggantung penyelidikan dan pembangunan "AI super", mengejutkan seluruh industri.

Baru semalam, surat gabungan hanya 22 perkataan menimbulkan kekecohan lagi.

Dalam beberapa perkataan, AI dibandingkan dengan penyakit berjangkit dan perang nuklear, yang boleh memusnahkan manusia dalam beberapa minit.

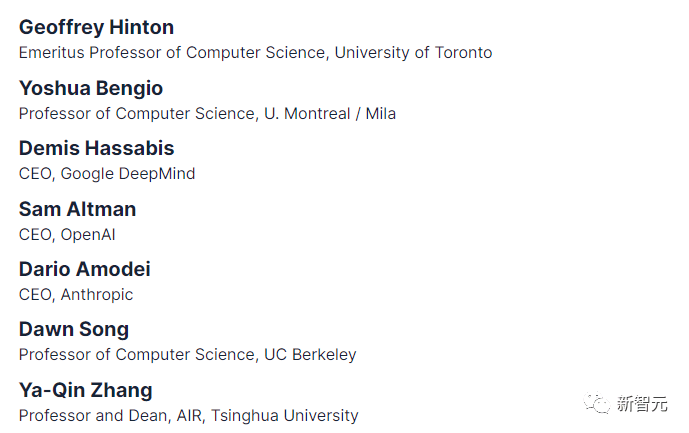

Antara yang menandatangani ialah Hinton dan Bengio, dua "godfather" kecerdasan buatan, serta eksekutif dari gergasi Silicon Valley, Sam Altman, Demis Hassabis dan penyelidik lain yang bekerja dalam bidang kecerdasan buatan.

Setakat ini, lebih 370 eksekutif yang terlibat dalam kecerdasan buatan telah menandatangani surat bersama ini.

Walau bagaimanapun, surat itu tidak disokong oleh semua orang.

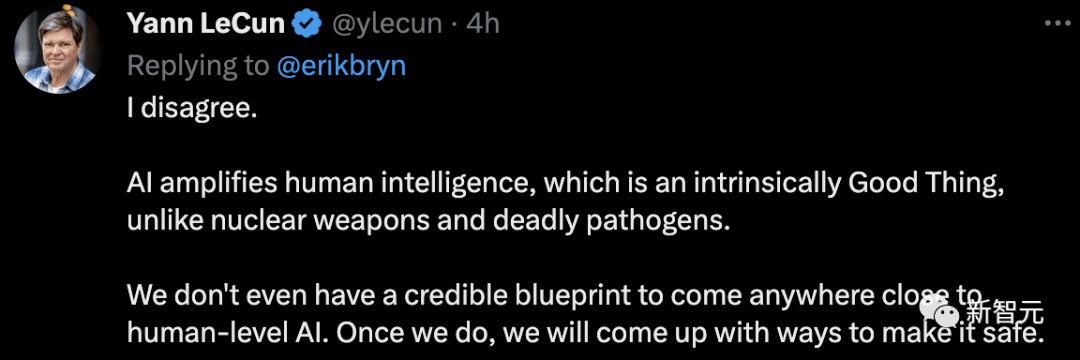

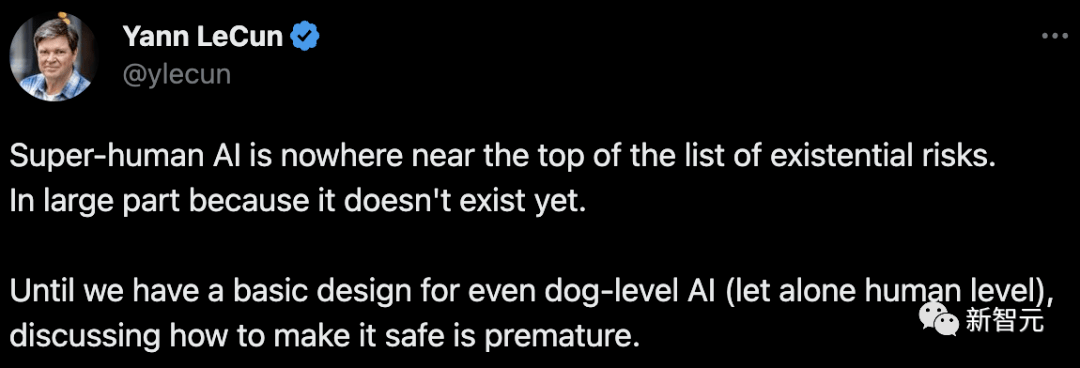

LeCun, salah seorang daripada "Turing Big Three" berkata terus terang: Saya tidak bersetuju.

Menggunakan kecerdasan buatan boleh meningkatkan kecerdasan manusia, yang sememangnya merupakan perkara yang baik, tidak seperti senjata nuklear dan patogen yang boleh membawa maut. Kami tidak mempunyai pelan tindakan yang kukuh untuk mencipta kecerdasan buatan peringkat hampir manusia. Sebaik sahaja kami melakukannya, kami akan memikirkan cara untuk menjadikannya selamat. 》

Apa sebenarnya yang dinyatakan dalam surat bersama ini?

Surat terbuka "Maut"

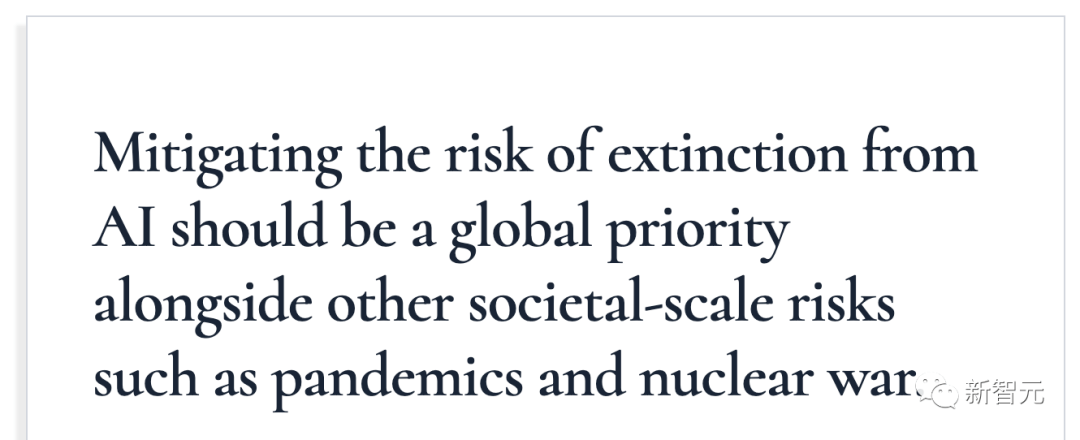

22 perkataan, ringkas dan padat:

"Mengurangkan risiko kepupusan yang dibawa oleh AI kepada manusia harus dinaikkan kepada keutamaan global. Sama seperti kita bertindak balas terhadap krisis sosial seperti penyakit berjangkit dan perang nuklear."

Yoshua Bengio juga merupakan pemenang Anugerah Turing Bersama Hinton dan LeCun, mereka dikenali sebagai Anugerah Tiga Turing. (Walau bagaimanapun, LeCun mempunyai sikap yang sama sekali bertentangan dengan dua gergasi lain mengenai perkara ini)

Selain bos besar yang bekerja di gergasi teknologi, terdapat juga sarjana AI yang terkenal. Contohnya, Dawn Song dari UC Berkeley dan Zhang Yaqin dari Universiti Tsinghua.

Di bawah nama biasa ini terdapat ramai orang dalam industri AI.

Malah, semua orang boleh turut serta menandatangani surat terbuka ini.

Selagi anda mengisi nama, e-mel, jawatan dan maklumat lain, anda boleh mengambil bahagian dalam menandatangani.

Namun, tidak banyak identiti untuk dipilih. (kepala anjing)

Bantahan: Pemusnahan manusia adalah karut murni

Sudah tentu, ketua saintis Meta LeCun masih "penentang" seperti biasa.

Pandangan konsisten beliau ialah: Pembangunan AI semasa baru sahaja mencapai tahap ini, dan ia bercakap tentang ancaman dan keselamatan setiap hari.

Beliau berkata bahawa ancaman yang disenaraikan hanyalah di luar tahap semasa pembangunan kecerdasan buatan kerana ancaman ini tidak wujud sama sekali. Sehingga kita pada mulanya boleh mereka bentuk AI untuk mencapai tahap anjing, apatah lagi manusia, adalah terlalu awal untuk membincangkan cara memastikan keselamatannya.

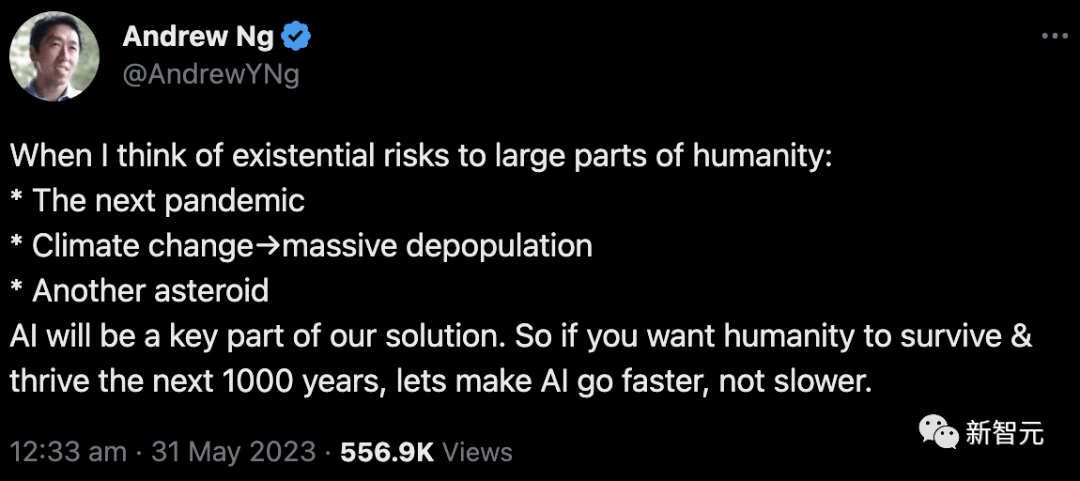

Dia percaya bahawa bukan AI akan menimbulkan pelbagai masalah, tetapi pelbagai masalah yang akan kita hadapi hanya boleh diselesaikan oleh AI.

Contohnya: wabak penyakit berjangkit seterusnya, pengurangan populasi akibat perubahan iklim, asteroid melanda bumi, dsb.

Katanya, jika manusia ingin terus hidup dan makmur, mereka mesti mempercepatkan pembangunan AI, bukan melambatkan.

Pandangan komprehensif tentang risiko AI

Jadi, apakah risiko yang didakwa oleh orang besar ini cukup untuk menghapuskan umat manusia?

Mereka meringkaskan 8 aspek berikut.

Persenjatan

Sesetengah orang mungkin menggunakan AI dengan cara yang merosakkan, menimbulkan risiko kepada kelangsungan hidup manusia dan memburukkan lagi ketidakstabilan politik.

Sebagai contoh, teknologi pembelajaran pengukuhan mendalam kini boleh digunakan untuk pertempuran udara, dan pembelajaran mesin boleh digunakan untuk mencipta senjata kimia (kertas kerja telah menunjukkan bahawa GPT-4 boleh menjalankan eksperimen dan mensintesis bahan kimia secara bebas di makmal).

Selain itu, dalam beberapa tahun kebelakangan ini para penyelidik telah membangunkan sistem AI untuk serangan siber automatik, dan pemimpin tentera mahu membenarkan AI mengawal silo nuklear.

Oleh itu, pada masa hadapan, kuasa AI akan menduduki kelebihan strategik, dan perlumbaan senjata antara negara akan beralih ke bidang AI. Walaupun kebanyakan negara memastikan sistem yang mereka bina adalah selamat dan tidak akan mengancam keselamatan negara lain, mungkin masih ada negara yang sengaja menggunakan AI untuk melakukan perkara yang tidak baik dan mendatangkan bahaya.

Ini terasa seperti senjata nuklear Jika ada yang tidak taat dan tidak jujur, semuanya akan sia-sia.

Kerana bahaya dalam alam digital merebak dengan cepat.

Maklumat salah

Semua orang telah lama mendengar tentang maklumat yang salah. Apatah lagi, beberapa ketika dahulu, peguam Amerika menggunakan ChatGPT untuk membicarakan, dan 6 daripada kes yang mereka sebutkan adalah contoh rekaan Ia masih popular sekarang.

Kolektif yang berpengaruh, seperti negara, parti politik dan organisasi, mempunyai keupayaan untuk menggunakan AI untuk mempengaruhi (biasanya secara halus) dan mengubah kepercayaan politik, ideologi, dsb.

Pada masa yang sama, AI sendiri mempunyai keupayaan untuk menjana pendapat yang sangat provokatif (atau persuasif) dan membangkitkan emosi yang kuat dalam diri pengguna.

Kemungkinan akibat yang dijangka ini benar-benar tidak dapat diramalkan dan mesti dijaga.

Ejen "Tipu"

Sistem AI dilatih berdasarkan matlamat konkrit yang hanya proksi tidak langsung untuk apa yang kita manusia hargai.

Ia seperti AI telah dilatih untuk menolak video atau artikel kepada pengguna.

Tetapi ini tidak bermakna kaedah ini bagus. Sistem pengesyoran boleh menyebabkan orang ramai menjadi lebih ekstrem dalam idea mereka dan memudahkan untuk meramalkan pilihan setiap pengguna.

Apabila AI menjadi lebih berkuasa dan lebih berpengaruh pada masa hadapan, matlamat yang kami gunakan untuk melatih sistem mesti disahkan dengan lebih berhati-hati.

"Degradasi" manusia

Jika anda pernah menonton filem "Wall-E", kita boleh bayangkan bagaimana rupa manusia pada masa hadapan apabila mesin menjadi semakin berkuasa.

Perut potty, kecergasan fizikal yang rendah, dan banyak masalah.

Itu kerana jika semuanya diserahkan kepada AI, manusia secara semula jadi akan "merosot".

Terutama dalam senario masa hadapan di mana sejumlah besar pekerjaan digantikan oleh automasi AI, senario ini menjadi lebih berkemungkinan.

Namun, menurut pandangan LeCun, ia mungkin perlu dikritik sekali lagi. Kami masih jauh dari pemandangan yang dibayangkan dalam "Wall-E".

Monopoli Teknologi

Ia tiada kaitan dengan teknologi itu sendiri. Perkara ini menekankan kemungkinan kemunculan "monopoli teknologi".

Mungkin suatu hari nanti, AI yang paling berkuasa akan dikawal oleh semakin sedikit pihak berkepentingan, dan hak untuk menggunakannya akan berada di tangan mereka.

Jika benar-benar sampai ke tahap itu, orang biasa yang tinggal akan berada dalam keadaan dirahmati orang lain, kerana mereka tidak dapat menahan sama sekali.

Fikirkan novel fiksyen sains Liu "Feeding Humanity".

Alangkah menakutkannya terminal untuk memerintah semua orang di dunia bergantung pada AI.

Pembangunan tidak terkawal

Perkara ini terutamanya ingin menjelaskan bahawa apabila sistem AI berkembang ke peringkat tertentu, hasilnya mungkin melebihi imaginasi pereka bentuk dan tidak lagi boleh dikawal.

Malah, di sini jugalah kerisauan arus perdana.

Akan sentiasa ada orang yang bimbang apabila AI berkembang, ia akan menjadi seperti "Skynet" dalam "Terminator" atau "Ultron" dalam "Iron Man", di luar kawalan dan cuba memusnahkan manusia.

Dalam proses pembangunan, terdapat beberapa risiko yang hanya akan menjadi jelas apabila kemajuan selanjutnya dibuat, dan apabila ia ditemui, ia sudah terlambat. Malah mungkin ada sasaran baru.

Menipu

Ini agak abstrak, sistem AI mungkin "menipu" manusia.

"penipuan" semacam ini bukan disengajakan, ia hanyalah satu cara AI mencapai matlamat ejen.

Mendapatkan pengiktirafan manusia melalui "penipuan" adalah lebih cekap daripada mendapatkan pengiktirafan manusia melalui saluran biasa, dan kecekapan adalah pertimbangan utama AI.

Tingkah laku mencari kuasa

Ini berkaitan dengan monopoli teknologi.

Tepat kerana monopoli teknologi akan berlaku, negara akan mengejar kuasa untuk memonopoli teknologi.

Dan "mengejar" jenis ini berkemungkinan membawa akibat yang tidak dapat diramalkan.

Rujukan:

https://www.safe.ai/statement-on-ai-risk

https://twitter.com/ylecun/status/1663616081582252032?s=46&t=iBppoR0Tk6jtBDcof0HHgg

Atas ialah kandungan terperinci Sam Altman memberi amaran: AI akan menghapuskan manusia! 375+ bos menandatangani surat bersama 22 patah perkataan, LeCun menentang keputusan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI