Rumah >pembangunan bahagian belakang >Tutorial Python >Latihan praktikal pengaturcaraan pengesanan gerakan Python

Latihan praktikal pengaturcaraan pengesanan gerakan Python

- PHPzke hadapan

- 2023-04-25 13:10:061541semak imbas

Penterjemah |. Zhu Xianzhong

Penyemak|. Sun Shujuan

Ikhtisar

Memandangkan bahasa pengaturcaraan Python menghadapi berbilang perpustakaan sumber terbuka tersedia; oleh itu, memilih bahasa Python untuk pembangunan pengesanan gerakan adalah mudah. Pada masa ini, pengesanan gerakan mempunyai banyak aplikasi komersial. Contohnya, ia boleh digunakan untuk mengawasi peperiksaan dalam talian dan untuk tujuan keselamatan di kedai, bank, dsb.

Bahasa pengaturcaraan Python ialah bahasa sumber terbuka dengan perpustakaan sokongan yang sangat kaya Hari ini, sejumlah besar aplikasi telah dibangunkan untuk pengguna berdasarkan bahasa ini dan mempunyai sejumlah besar pengguna. Oleh sebab itu, bahasa Python berkembang pesat di pasaran. Kelebihan bahasa Python adalah banyak, bukan sahaja kerana sintaksnya yang ringkas dan ralat yang mudah dicari, tetapi juga kerana proses penyahpepijatannya yang sangat pantas, yang menjadikannya lebih mesra pengguna.

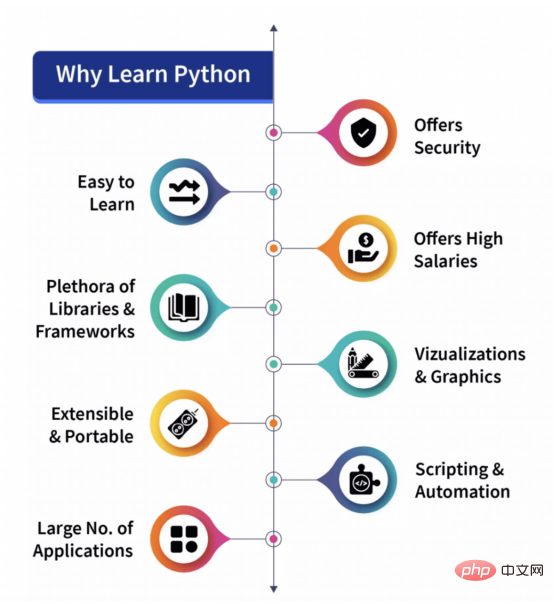

Mengapa anda disyorkan untuk mempelajari Python? Kita boleh menggunakan rajah berikut untuk menerangkan secara ringkas:

Python telah direka pada tahun 1991 dan dibangunkan oleh Yayasan Perisian Python. Banyak versi telah dikeluarkan hari ini. Antaranya, Python2 dan Python3 adalah yang paling terkenal. Pada masa ini, Python3 telah digunakan secara meluas, dan bilangan pengguna juga berkembang pesat. Dalam projek ini, kami akan menggunakan Python3 sebagai bahasa pembangunan.

Apakah pengesanan gerakan?

Mengikut prinsip fizik, apabila objek pegun dan tidak mempunyai kelajuan, ia dianggap dalam keadaan pegun dan sebaliknya, apabila objek tidak sepenuhnya pegun dan bergerak ke arah tertentu (sama ada Apabila terdapat pergerakan atau kelajuan tertentu (kiri atau kanan, depan dan belakang atau atas dan bawah), ia dianggap bergerak. Dalam artikel ini, kami akan cuba mengesan kelakuan objek.

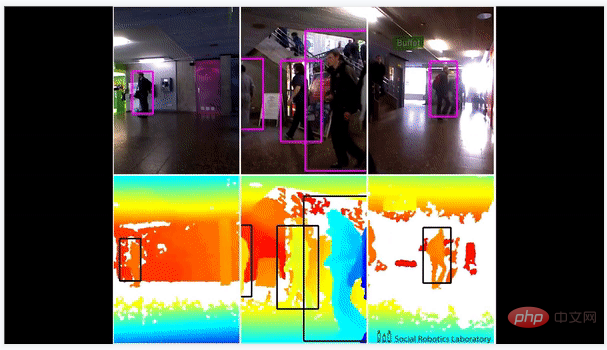

Pada masa ini, terdapat sejumlah besar pelaksanaan atau aplikasi pengesanan gerakan dalam kehidupan sebenar, yang membuktikan sepenuhnya nilai aplikasinya yang besar. Antaranya, menggunakan kamera web (yang akan kami laksanakan dalam artikel ini) sebagai pengawal keselamatan untuk pengawasan peperiksaan dalam talian, dan lain-lain adalah aplikasi yang paling tipikal.

Dalam artikel ini, kami akan cuba melaksanakan skrip. Dengan skrip ini, kami akan menggunakan kamera web yang dipasang pada desktop atau komputer riba untuk mengesan gerakan objek. Ideanya ialah kami akan mengambil dua bingkai video dan cuba mencari perbezaan di antara mereka. Jika terdapat beberapa jenis perbezaan antara kedua-dua bingkai, maka jelas terdapat beberapa jenis pergerakan objek di hadapan kamera, yang membuat perbezaan.

Perpustakaan Rujukan Utama

Sebelum mula melaksanakan kod, mari kita lihat beberapa modul atau perpustakaan yang akan kami gunakan dalam kod untuk mengendalikan kamera web untuk pengesanan gerakan. Seperti yang kita bincangkan, perpustakaan sumber terbuka ini memainkan peranan penting dalam menyebarkan reputasi Python. Mari kita lihat perpustakaan sumber terbuka yang diperlukan dalam projek contoh artikel ini:

- OpenCV

- Panda

Dua perpustakaan di atas OpenCV dan Panda adalah semata-mata berdasarkan perpustakaan percuma dan sumber terbuka untuk Python, kami akan menggunakannya melalui versi Python3 bahasa Python.

1. OpenCV

OpenCV ialah perpustakaan sumber terbuka yang sangat terkenal yang boleh digunakan dengan banyak bahasa pengaturcaraan (seperti C++, Python, dll.) dan digunakan khas untuk pemprosesan imej dan pembangunan program video. Dengan menyepadukan aplikasi dengan perpustakaan sumber terbuka Python, Pandas atau perpustakaan NumPy, kami boleh mengeksploitasi sepenuhnya fungsi OpenCV.

2.Panda

Panda ialah perpustakaan Python sumber terbuka yang menyediakan alatan terbina dalam yang kaya untuk analisis data, oleh itu, ia telah digunakan secara meluas dalam bidang sains data dan analisis data. Pandas menyediakan bentuk struktur data DataFrame, yang menyediakan sokongan yang sangat mudah untuk mengendalikan dan menyimpan data jadual ke dalam struktur data dua dimensi.

Kedua-dua modul di atas tidak terbina dalam Python, kita mesti memasangnya sebelum menggunakannya. Selain daripada ini, kami juga akan menggunakan dua modul lain dalam projek kami.

- Modul tarikh dan masa Python (DateTime)

- Modul masa (Masa) Python

Kedua-dua modul dibina ke dalam Python dan tidak perlu dipasang pada masa hadapan. Modul ini digunakan untuk mengendalikan fungsi berkaitan tarikh dan masa masing-masing.

Pelaksanaan Kod

Setakat ini kami telah melihat perpustakaan yang akan kami gunakan dalam kod kami. Seterusnya, mari kita mulakan dengan andaian bahawa video hanyalah gabungan banyak imej pegun atau bingkai, dan kemudian gunakan gabungan semua bingkai tersebut untuk mencipta video.

Import perpustakaan yang diperlukan

Dalam bahagian ini, kami akan mengimport semua perpustakaan seperti Pandas dan OpenCV dahulu. Kemudian, kami mengimport masa dan fungsi DateTime daripada modul DateTime.

#导入Pandas库 import Pandas as panda # 导入OpenCV库 import cv2 #导入时间模块 import time #从datetime 模块导入datetime 函数 from datetime import datetime

Memulakan pembolehubah data

Dalam bahagian ini, kita akan memulakan beberapa pembolehubah dan akan Ini pembolehubah digunakan lebih lanjut dalam kod. Mula-mula, kami mentakrifkan keadaan awal sebagai "Tiada", dan kemudian menyimpan gerakan yang dijejaki melalui motionTrackList pembolehubah lain.

此外,我们还定义了一个列表“motionTime”,用于存储发现运动的时间,并使用Panda的模块初始化数据帧列表。

# 对于初始帧,以变量initialState的形式将初始状态指定为None initialState = None # 帧中检测到任何运动时存储所有轨迹的列表 motionTrackList= [ None, None ] # 一个新的“时间”列表,用于存储检测到移动时的时间 motionTime = [] # 使用带有初始列和最终列的Panda库初始化数据帧变量“DataFrame” dataFrame = panda.DataFrame(columns = ["Initial", "Final"])

关键帧捕获过程

在本节中,我们将实现本文示例项目中最关键的运动检测步骤。下面,让我们分步骤进行解说:

- 首先,我们将开始使用cv2模块捕获视频,并将其存储在视频变量中。

- 然后,我们将使用无限while循环从视频中捕获每一帧。

- 接下来,将使用read()方法读取每个帧,并将它们存储到各自的变量中。

- 我们定义了一个变量var_motion,并将其初始化为零。

- 我们使用cv2函数cvtColor和GaussianBlur创建另外两个变量grayImage和grayFrame,以找到运动中的变化。

- 如果我们的initialState为None,则我们将当前grayFrame指定为initialState;否则,使用“continue”关键字跳过后面代码的执行。

- 在后面代码中,我们计算在当前迭代中创建的初始帧和灰度帧grayscale之间的差异。

- 然后,我们将使用cv2阈值和dilate函数突出显示初始帧和当前帧之间的变化。

- 我们将从当前图像或帧中的运动对象中找到轮廓,并通过使用rectangle函数在其周围创建绿色边界来指示运动对象。

- 在此之后,我们将把当前检测到的元素添加到列表变量motionTrackList。

- 到目前为止,我们已经通过使用imshow方法显示出如灰度和原始帧等所有的关键帧。

- 此外,我们还使用cv2模块的witkey()方法来结束进程。程序中,我们选择使用按下键盘上的'm'键来结束我们的进程。

# 使用cv2模块启动网络摄像头以捕获视频

video = cv2.VideoCapture(0)

# 使用无限循环从视频中捕获帧

while True:

# 使用read功能从视频中读取每个图像或帧

check, cur_frame = video.read()

#将'motion'变量定义为等于零的初始帧

var_motion = 0

# 从彩色图像创建灰色帧

gray_image = cv2.cvtColor(cur_frame, cv2.COLOR_BGR2GRAY)

# 从灰度图像中使用GaussianBlur函数找到变化部分

gray_frame = cv2.GaussianBlur(gray_image, (21, 21), 0)

# 在第一次迭代时进行条件检查

# 如果为None,则把grayFrame赋值给变量initalState

if initialState is None:

initialState = gray_frame

continue

# 计算静态(或初始)帧与我们创建的灰色帧之间的差异

differ_frame = cv2.absdiff(initialState, gray_frame)

# 静态或初始背景与当前灰色帧之间的变化将突出显示

thresh_frame = cv2.threshold(differ_frame, 30, 255, cv2.THRESH_BINARY)[1]

thresh_frame = cv2.dilate(thresh_frame, None, iterations = 2)

#对于帧中的移动对象,查找轮廓

cont,_ = cv2.findContours(thresh_frame.copy(),

cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

for cur in cont:

if cv2.contourArea(cur) < 10000:

continue

var_motion = 1

(cur_x, cur_y,cur_w, cur_h) = cv2.boundingRect(cur)

# 在移动对象周围创建一个绿色矩形

cv2.rectangle(cur_frame, (cur_x, cur_y), (cur_x + cur_w, cur_y + cur_h), (0, 255, 0), 3)

# 从帧中添加运动状态

motionTrackList.append(var_motion)

motionTrackList = motionTrackList[-2:]

# 添加运动的开始时间

if motionTrackList[-1] == 1 and motionTrackList[-2] == 0:

motionTime.append(datetime.now())

# 添加运动的结束时间

if motionTrackList[-1] == 0 and motionTrackList[-2] == 1:

motionTime.append(datetime.now())

# 在显示捕获图像的灰度级中

cv2.imshow("The image captured in the Gray Frame is shown below: ", gray_frame)

# 显示初始静态帧和当前帧之间的差异

cv2.imshow("Difference between theinital static frame and the current frame: ", differ_frame)

# 在框架屏幕上显示视频中的黑白图像

cv2.imshow("Threshold Frame created from the PC or Laptop Webcam is: ", thresh_frame)

#通过彩色框显示物体的轮廓

cv2.imshow("From the PC or Laptop webcam, this is one example of the Colour Frame:", cur_frame)

# 创建处于等待状态的键盘按键

wait_key = cv2.waitKey(1)

# 按下'm'键时,结束整个进程执行

if wait_key == ord('m'):

# 当屏幕上有东西移动时,将运动变量值添加到motiontime列表中

if var_motion == 1:

motionTime.append(datetime.now())

break

代码收尾工作

在结束循环体执行后,我们将从dataFrame和motionTime列表中添加数据到CSV文件中,最后关闭视频。这一部分代码的实现如下所示:

# 最后,我们在数据帧中添加运动时间

for a in range(0, len(motionTime), 2):

dataFrame = dataFrame.append({"Initial" : time[a], "Final" : motionTime[a + 1]}, ignore_index = True)

# 创建CSV文件记录下所有运动信息

dataFrame.to_csv("EachMovement.csv")

# 释放视频内存

video.release()

#现在,在openCV的帮助下关闭或销毁所有打开的窗口

cv2.destroyAllWindows()至此,我们已经成功地创建完所有代码。现在,让我们再次归纳一下整个过程。

首先,我们使用设备的网络摄像头捕捉视频,然后将输入视频的初始帧作为参考,并不时检查下一帧。如果发现与第一帧不同的帧,则说明存在运动。该信息将被标记在绿色矩形中。

完整的代码

现在,让我们把上面所有代码片断连接到一起,如下所示:

#导入Pandas库

import Pandas as panda

# 导入OpenCV库

import cv2

#导入时间模块

import time

#从datetime 模块导入datetime 函数

from datetime import datetime

# 对于初始帧,以变量initialState的形式将初始状态指定为None

initialState = None

# 帧中检测到任何运动时存储所有轨迹的列表

motionTrackList= [ None, None ]

# 一个新的“时间”列表,用于存储检测到移动时的时间

motionTime = []

# 使用带有初始列和最终列的Panda库初始化数据帧变量“DataFrame”

dataFrame = panda.DataFrame(columns = ["Initial", "Final"])

# 使用cv2模块启动网络摄像头以捕获视频

video = cv2.VideoCapture(0)

# 使用无限循环从视频中捕获帧

while True:

# 使用read功能从视频中读取每个图像或帧

check, cur_frame = video.read()

#将'motion'变量定义为等于零的初始帧

var_motion = 0

# 从彩色图像创建灰色帧

gray_image = cv2.cvtColor(cur_frame, cv2.COLOR_BGR2GRAY)

# 从灰度图像中使用GaussianBlur函数找到变化部分

gray_frame = cv2.GaussianBlur(gray_image, (21, 21), 0)

# 在第一次迭代时进行条件检查

# 如果为None,则把grayFrame赋值给变量initalState

if initialState is None:

initialState = gray_frame

continue

# 计算静态(或初始)帧与我们创建的灰色帧之间的差异

differ_frame = cv2.absdiff(initialState, gray_frame)

# 静态或初始背景与当前灰色帧之间的变化将突出显示

thresh_frame = cv2.threshold(differ_frame, 30, 255, cv2.THRESH_BINARY)[1]

thresh_frame = cv2.dilate(thresh_frame, None, iterations = 2)

#对于帧中的移动对象,查找轮廓

cont,_ = cv2.findContours(thresh_frame.copy(),

cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

for cur in cont:

if cv2.contourArea(cur) < 10000:

continue

var_motion = 1

(cur_x, cur_y,cur_w, cur_h) = cv2.boundingRect(cur)

# 在移动对象周围创建一个绿色矩形

cv2.rectangle(cur_frame, (cur_x, cur_y), (cur_x + cur_w, cur_y + cur_h), (0, 255, 0), 3)

# 从帧中添加运动状态

motionTrackList.append(var_motion)

motionTrackList = motionTrackList[-2:]

# 添加运动的开始时间

if motionTrackList[-1] == 1 and motionTrackList[-2] == 0:

motionTime.append(datetime.now())

# 添加运动的结束时间

if motionTrackList[-1] == 0 and motionTrackList[-2] == 1:

motionTime.append(datetime.now())

# 在显示捕获图像的灰度级中

cv2.imshow("The image captured in the Gray Frame is shown below: ", gray_frame)

# 显示初始静态帧和当前帧之间的差异

cv2.imshow("Difference between theinital static frame and the current frame: ", differ_frame)

# 在框架屏幕上显示视频中的黑白图像

cv2.imshow("Threshold Frame created from the PC or Laptop Webcam is: ", thresh_frame)

#通过彩色框显示物体的轮廓

cv2.imshow("From the PC or Laptop webcam, this is one example of the Colour Frame:", cur_frame)

# 创建处于等待状态的键盘按键

wait_key = cv2.waitKey(1)

# 借助'm'键结束我们系统的整个进行

if wait_key == ord('m'):

# 当屏幕上有物体运行时把运动变量值添加到列表motiontime中

if var_motion == 1:

motionTime.append(datetime.now())

break

# 最后,我们在数据帧中添加运动时间

for a in range(0, len(motionTime), 2):

dataFrame = dataFrame.append({"Initial" : time[a], "Final" : motionTime[a + 1]}, ignore_index = True)

# 记录下所有运行,并创建到一个CSV文件中

dataFrame.to_csv("EachMovement.csv")

# 释放视频内存

video.release()

#现在,在openCV的帮助下关闭或销毁所有打开的窗口

cv2.destroyAllWindows()运行结果

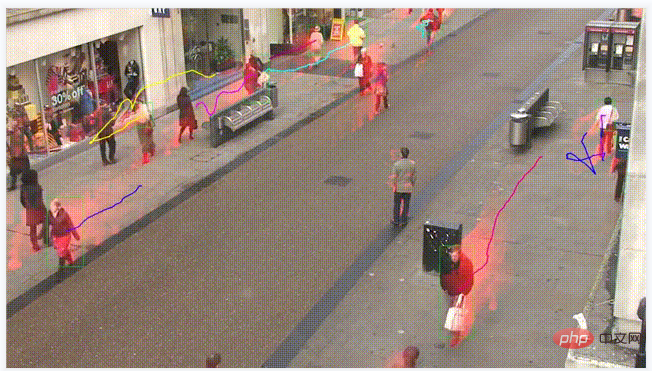

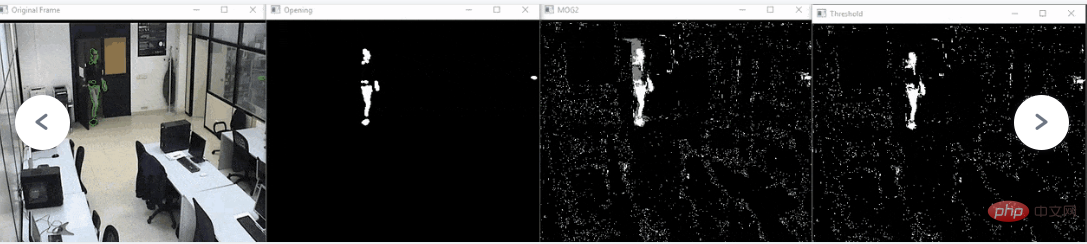

运行上述代码后得到的结果与下面看到的结果类似。

从这个动画中,我们可以看到该男子在视频中的动作已经被跟踪。因此,可以相应地看到输出结果。

然而,在这段代码中,跟踪是在移动对象周围的矩形框的帮助下完成,类似于下面动画中所示的。这里要注意的一件有趣的事情是,这段视频是一个实际的安全摄像头的镜头,已经对其进行了检测处理。

结论

- Python编程语言是一种开源的且有丰富的开源库支持的语言,目前已经为用户提供了许多现成的应用程序。

- 当一个物体静止不动且没有速度时,则认为它处于静止状态;反之,当一个对象未完全静止时,则视为它处于运动状态。

- OpenCV是一个开源库,可用于多种编程语言,通过将其与Python的Panda/NumPy库集成,我们可以充分发挥OpenCV的功能。

最后来归纳一下。本文中所介绍的运动检测的主要思想是,每个视频只是许多静态图像(称为帧)的组合,我们是通过判断帧之间的差异来实现运行检测的。

译者介绍

朱先忠,51CTO社区编辑,51CTO专家博客、讲师,潍坊一所高校计算机教师,自由编程界老兵一枚。早期专注各种微软技术(编著成ASP.NET AJX、Cocos 2d-X相关三本技术图书),近十多年投身于开源世界(熟悉流行全栈Web开发技术),了解基于OneNet/AliOS+Arduino/ESP32/树莓派等物联网开发技术与Scala+Hadoop+Spark+Flink等大数据开发技术。

原文标题:How to Perform Motion Detection Using Python,作者:Vaishnavi Amira Yada

Atas ialah kandungan terperinci Latihan praktikal pengaturcaraan pengesanan gerakan Python. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!