Rumah >Peranti teknologi >AI >Adakah pembangunan AI membawa kepada penyatuan dalam 70 tahun? Kajian AI terkini Ma Yi, Cao Ying, Shen Xiangyang: meneroka prinsip asas dan 'model piawai' penjanaan kecerdasan

Adakah pembangunan AI membawa kepada penyatuan dalam 70 tahun? Kajian AI terkini Ma Yi, Cao Ying, Shen Xiangyang: meneroka prinsip asas dan 'model piawai' penjanaan kecerdasan

- 王林ke hadapan

- 2023-04-18 12:52:031130semak imbas

Kecerdasan buatan telah berkembang selama tujuh puluh tahun Walaupun penunjuk teknikal telah diperbaharui secara berterusan, masih tiada jawapan tentang apa sebenarnya "kepintaran" dan bagaimana ia muncul dan berkembang.

Baru-baru ini, Profesor Ma Yi bekerjasama dengan saintis komputer Dr. Shen Xiangyang dan saintis saraf Profesor Cao Ying untuk menerbitkan ulasan penyelidikan mengenai kemunculan dan perkembangan kecerdasan, dengan harapan dapat meletakkan penyelidikan secara teori. pada kecerdasan menjadi amalan. Menyatukan dan meningkatkan pemahaman dan kebolehtafsiran model kecerdasan buatan.

Pautan kertas: http://arxiv.org/abs/2207.04630

Diperkenalkan dalam artikel Dua prinsip asas: Parsimony dan Self-consistency.

Pengarang percaya bahawa ini adalah asas kebangkitan kecerdasan, buatan atau semula jadi. Walaupun terdapat banyak perbincangan dan penghuraian tentang setiap dua prinsip ini dalam kesusasteraan klasik, artikel ini mentafsir semula kedua-dua prinsip ini dengan cara yang boleh diukur dan boleh dikira sepenuhnya.

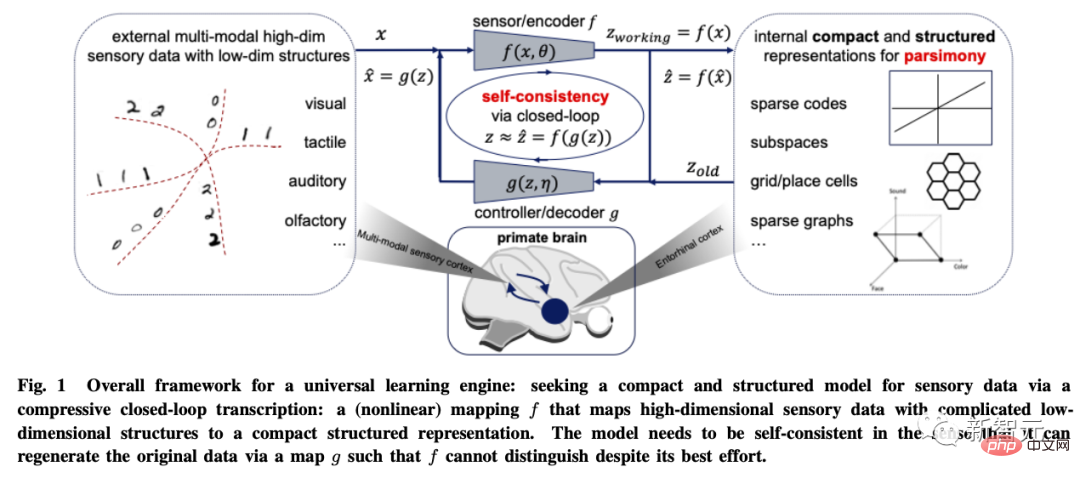

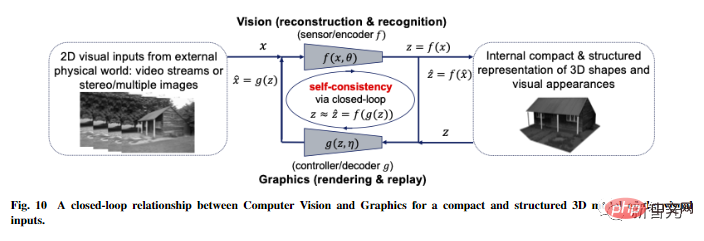

Berdasarkan dua prinsip pertama ini, penulis menyimpulkan rangka kerja pengiraan yang cekap: transkripsi gelung tertutup termampat, yang menyatukan dan menerangkan rangkaian dalam moden dan banyak evolusi amalan kecerdasan buatan.

Dua prinsip asas: kesederhanaan dan ketekalan diri

Secara mendalam Dengan berkat pembelajaran, kemajuan kecerdasan buatan dalam dekad yang lalu bergantung terutamanya pada latihan model kotak hitam homogen dan menggunakan kaedah kejuruteraan mentah untuk melatih rangkaian saraf berskala besar.

Walaupun prestasi telah bertambah baik dan tidak perlu mereka bentuk ciri secara manual, perwakilan ciri yang dipelajari di dalam rangkaian saraf tidak dapat ditafsirkan, dan model besar membawa masalah lain, seperti peningkatan berterusan. kos pengumpulan dan pengiraan data, kekurangan kekayaan, kestabilan (mod runtuh), kebolehsuaian (terdedah kepada bencana melupakan) perwakilan yang dipelajari; kekurangan keteguhan kepada ubah bentuk atau serangan musuh, dsb.

Penulis percaya bahawa salah satu sebab asas untuk masalah ini dalam amalan rangkaian dalam dan kecerdasan buatan semasa ialah kekurangan pemahaman yang sistematik dan menyeluruh tentang fungsi dan prinsip organisasi sistem pintar.

Sebagai contoh, melatih model diskriminatif untuk pengelasan dan model generatif untuk pensampelan atau main semula pada asasnya berasingan dalam amalan. Model yang dilatih dengan cara ini biasanya dipanggil sistem gelung terbuka dan memerlukan latihan hujung ke hujung melalui penyeliaan atau penyeliaan diri.

Dalam teori kawalan, sistem gelung terbuka tersebut tidak boleh secara automatik membetulkan ralat dalam ramalan dan tidak boleh disesuaikan dengan perubahan dalam persekitaran dengan tepat kerana ini Masalahnya ialah "maklum balas gelung tertutup " digunakan secara meluas dalam sistem terkawal untuk membolehkan sistem membetulkan ralat secara autonomi.

Pengalaman yang sama berlaku dalam pembelajaran: apabila model diskriminatif dan generatif digabungkan untuk membentuk sistem gelung tertutup yang lengkap, pembelajaran boleh menjadi autonomi (tanpa penyeliaan luar) ), dan lebih cekap, stabil dan boleh disesuaikan.

Untuk memahami komponen berfungsi yang mungkin diperlukan dalam sistem pintar, seperti diskriminasi atau penjana, kita perlu memahami kecerdasan dari perspektif yang lebih "berprinsip" dan "bersatu" .

Artikel itu mencadangkan dua prinsip asas: Parsimony dan Self-consistency, yang masing-masing menjawab dua soalan asas tentang pembelajaran.

- Apa yang perlu dipelajari: Apa yang perlu dipelajari daripada data, dan cara mengukur kualiti pembelajaran?

- Bagaimana untuk belajar: Bagaimanakah kita mencapai matlamat pembelajaran sedemikian melalui rangka kerja pengkomputeran yang cekap dan berkesan?

Bagi soalan pertama "apa yang perlu dipelajari", prinsip kesederhanaan berpendapat bahawa:

Matlamat pembelajaran daripada sistem pintar adalah untuk belajar daripada Cari struktur berdimensi rendah dalam data pemerhatian di dunia luar dan menyusun semula serta mewakilinya dengan cara yang paling padat dan tersusun.

Ini ialah prinsip "Cukur Occam": jangan tambah entiti melainkan perlu.

Tanpa prinsip ini, kecerdasan tidak akan dapat dicapai! Jika data pemerhatian dunia luar tidak mempunyai struktur berdimensi rendah, tiada apa yang patut dipelajari atau diingati, dan generalisasi atau ramalan yang baik tidak akan dapat dilakukan.

Dan sistem pintar perlu menjimatkan sumber sebanyak mungkin, seperti tenaga, ruang, masa dan jirim Dalam sesetengah kes, prinsip ini juga dipanggil "prinsip mampatan". Walau bagaimanapun, kepintaran kecerdasan bukanlah untuk mencapai pemampatan terbaik, tetapi untuk mendapatkan ekspresi data cerapan yang paling padat dan berstruktur melalui cara pengkomputeran yang cekap.

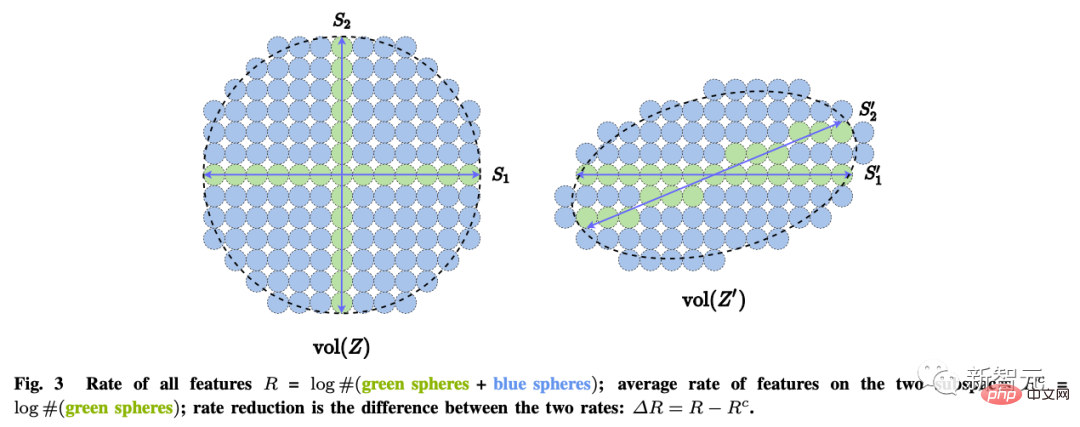

Jadi bagaimana untuk mengukur kesederhanaan?

Untuk model dimensi tinggi am, kos pengiraan bagi banyak "ukuran" matematik atau statistik yang biasa digunakan adalah eksponen, atau untuk pengedaran data dengan struktur dimensi rendah Said, walaupun tidak ditentukan. seperti kemungkinan maksimum, perbezaan KL, maklumat bersama, jarak Jensen-Shannon dan Wasserstein, dsb.

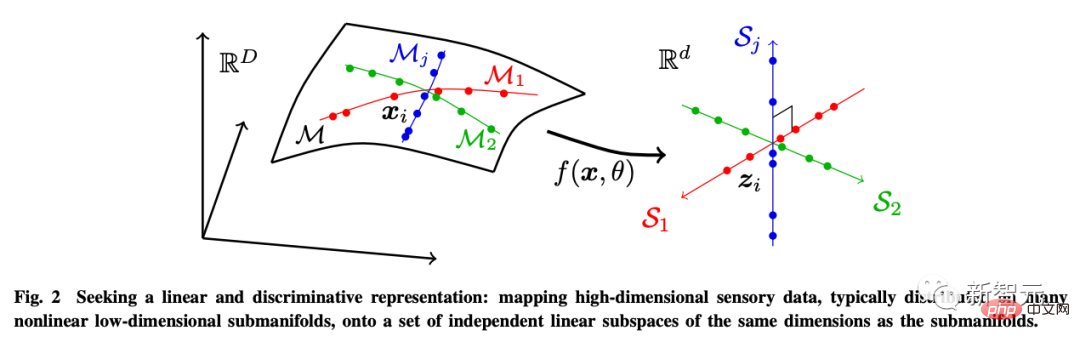

Penulis percaya bahawa tujuan pembelajaran sebenarnya adalah untuk mewujudkan pemetaan (biasanya tidak linear) untuk mendapatkan perwakilan dimensi rendah daripada input berdimensi tinggi asal.

Dengan cara ini, pengedaran ciri z yang diperolehi harus lebih padat dan berstruktur bermakna penyimpanan yang lebih menjimatkan ; Struktur bermaksud akses dan penggunaan yang lebih cekap: struktur linear, khususnya, sesuai untuk interpolasi atau ekstrapolasi.

Untuk tujuan ini, penulis memperkenalkan Linear Discriminant Representation (LDR) untuk mencapai tiga sub-matlamat:

- Mampatan: memetakan data deria dimensi tinggi x kepada perwakilan dimensi rendah z; memetakan kategori yang berbeza ke dalam subruang yang saling bebas atau kurang relevan.

Matlamat ini boleh dicapai melalui pengurangan kadar pengekodan maksimum (pengurangan kadar) untuk memastikan semua Yang dipelajari Model LDR mempunyai prestasi parsimoni yang optimum.

Matlamat ini boleh dicapai melalui pengurangan kadar pengekodan maksimum (pengurangan kadar) untuk memastikan semua Yang dipelajari Model LDR mempunyai prestasi parsimoni yang optimum.

Sistem pintar autonomi mencari model yang paling konsisten kendiri untuk pemerhatian dunia luar dengan meminimumkan perbezaan dalam perwakilan dalaman data yang diperhatikan dan data yang dijana semula.

Prinsip parsimoni sahaja tidak memastikan model yang dipelajari menangkap semua maklumat penting tentang data tentang dunia luar. Sebagai contoh, memetakan setiap kategori kepada vektor satu dimensi panas dengan meminimumkan entropi silang boleh dilihat sebagai satu bentuk parsimoni.

Ia mungkin mempelajari pengelas yang baik, tetapi ciri yang dipelajari juga mungkin runtuh menjadi satu, juga dikenali sebagai keruntuhan saraf. Ciri yang dipelajari sedemikian tidak lagi mengandungi maklumat yang mencukupi untuk menjana semula data asal.

Walaupun kami mempertimbangkan model LDR yang lebih umum, memaksimumkan perbezaan kadar pengekodan sahaja tidak boleh secara automatik menentukan dimensi yang betul bagi ruang ciri persekitaran.

Jika dimensi ruang ciri terlalu rendah, model yang dipelajari tidak akan sepadan dengan data jika terlalu tinggi, model mungkin terlalu padan.

Secara umumnya, kami berpendapat bahawa pembelajaran persepsi adalah berbeza daripada mempelajari tugasan khusus. Matlamat persepsi adalah untuk mempelajari segala sesuatu yang boleh diramalkan tentang apa yang dilihat.

Seperti kata Einstein: "Sesuatu harus disederhanakan, tetapi tidak terlalu mudah."

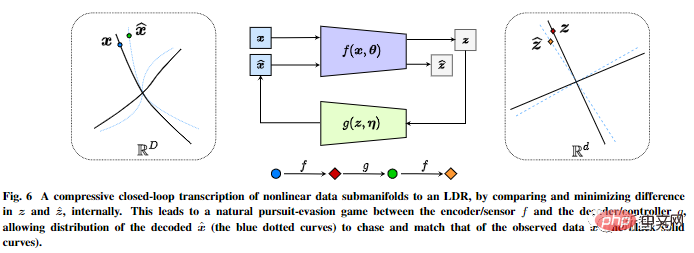

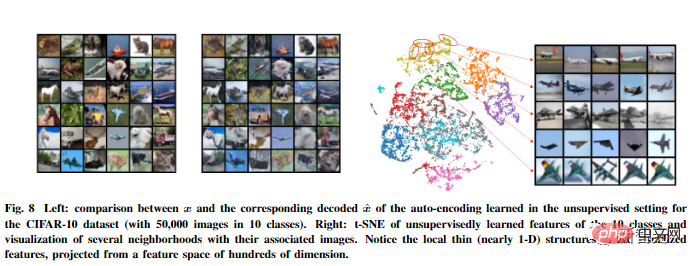

Berdasarkan dua prinsip ini, artikel menggunakan pemodelan data imej visual sebagai contoh untuk memperoleh rangka kerja transkripsi gelung tertutup mampatan.

Ia melaksanakan transkripsi gelung tertutup mampat bagi corak sub-aliran data tak linear secara dalaman untuk mencapai LDR dengan membandingkan dan meminimumkan perbezaan dalam perwakilan dalaman.

Permainan kejar-mengejar antara pengekod/sensor dan penyahkod/pengawal, membenarkan pengedaran data yang dijana oleh perwakilan yang dinyahkod untuk mengejar dan memadankan pengedaran data sebenar yang diperhatikan.

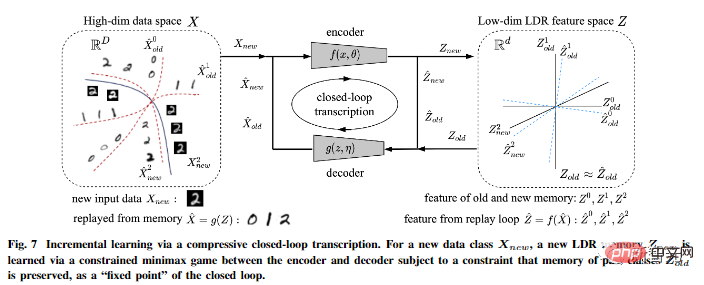

Selain itu, pengarang menunjukkan bahawa transkripsi gelung tertutup yang dimampatkan boleh melaksanakan pembelajaran tambahan dengan berkesan.

Model LDR untuk kelas data baharu boleh dipelajari melalui permainan terkurung antara pengekod dan penyahkod: ingatan kelas yang dipelajari lalu secara semula jadi Ia dikekalkan sebagai kekangan dalam permainan , iaitu, sebagai "titik tetap" untuk transkripsi gelung tertutup.

Artikel ini juga mengemukakan idea yang lebih spekulatif tentang kesejagatan rangka kerja ini dan memanjangkannya kepada tiga dimensi Visi dan pengukuhan pembelajaran, dan meramalkan kesannya terhadap neurosains, matematik, dan kecerdasan lanjutan.

Melalui rangka kerja ini diperolehi daripada prinsip pertama: teori pengekodan maklumat, kawalan maklum balas gelung tertutup, pengoptimuman/kedalaman Konsep rangkaian dan teori permainan disepadukan secara organik dan menjadi bahagian penting dalam sistem pintar autonomi yang lengkap.

Perlu dinyatakan bahawa seni bina gelung tertutup termampat terdapat di mana-mana dalam semua makhluk pintar dalam alam semula jadi dan pada skala yang berbeza : Daripada otak (maklumat deria termampat), kepada litar tulang belakang (pergerakan otot termampat), kepada DNA (maklumat fungsi protein termampat) dan sebagainya.

Jadi penulis percaya bahawa transkripsi gelung tertutup mampatan harus menjadi "enjin pembelajaran universal" di sebalik semua tingkah laku pintar. Ia membolehkan sistem kecerdasan semula jadi atau buatan untuk menemui dan memperhalusi struktur berdimensi rendah daripada data deria yang kelihatan kompleks, menukarkannya kepada ekspresi dalaman yang ringkas dan teratur untuk memudahkan pertimbangan dan ramalan yang betul tentang dunia luar pada masa hadapan.

Ini adalah asas pengiraan dan mekanisme untuk kejadian dan perkembangan semua kecerdasan.

Rujukan: http://arxiv.org/abs/2207.04630

Atas ialah kandungan terperinci Adakah pembangunan AI membawa kepada penyatuan dalam 70 tahun? Kajian AI terkini Ma Yi, Cao Ying, Shen Xiangyang: meneroka prinsip asas dan 'model piawai' penjanaan kecerdasan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI