Rumah >Peranti teknologi >AI >GPU menjalankan model volum ChatGPT dan ControlNet ialah satu lagi artifak untuk lukisan AI.

GPU menjalankan model volum ChatGPT dan ControlNet ialah satu lagi artifak untuk lukisan AI.

- 王林ke hadapan

- 2023-04-15 22:49:011785semak imbas

目录

- Model Transformer: pengenalan dan katalog

- Seluruh Inferens Generatif Model Bahasa Besar dengan GPU Tunggal

- Generalisasi Domain Tempoh dengan Rangkaian Neural Dinamik Drift-Aware

- Pemodelan tepat secara fizikal berskala besar sel bahan api membran pertukaran proton sebenar dengan pembelajaran mendalam

- Tinjauan Komprehensif mengenai Model Asas Pra-latihan: Sejarah dari BERT ke ChatGPT

- Menambah Bersyarat Kawalan kepada Model Resapan Teks-ke-Imej

- EVA3D: Penjanaan Manusia 3D Komposisi daripada Koleksi imej 2D

- Stesen Radio Mingguan ArXiv: NLP、CV、ML 更多精选论文(附音频)

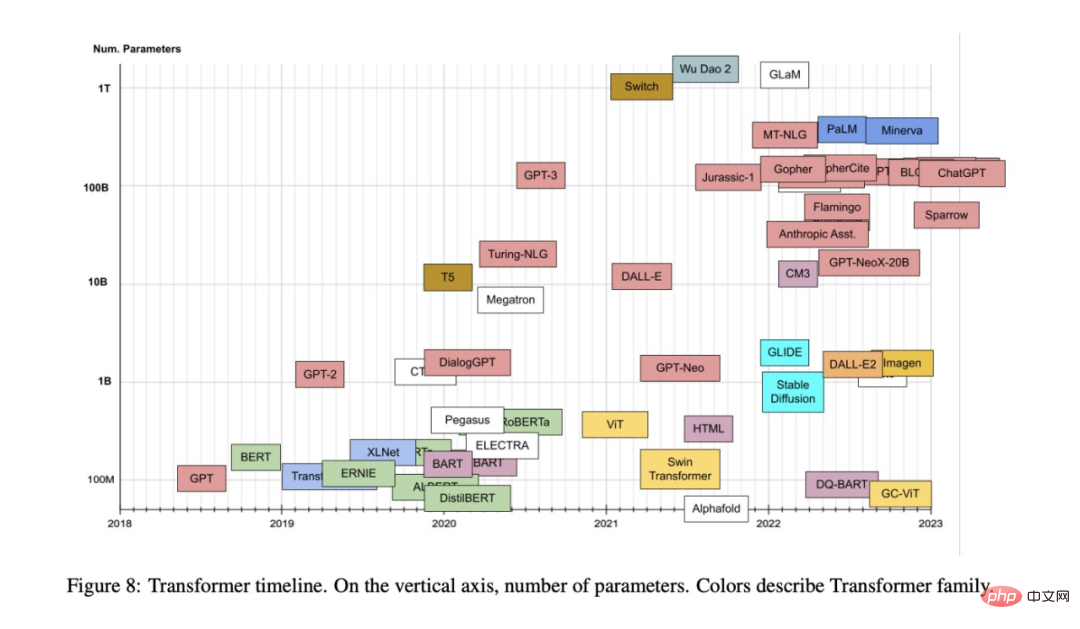

论文 1: introduction models and cat🎜: an introduction >

- 作者:Xavier Amatriain

- 论文地址:https://arxiv.org/pdf /2302.07730.doc理、计算机视觉等其他领域展现了前所未有的实力,并引发了 ChatGPT 这样的技术突破,人们也提出了各种各样基于原。 🎜>由于学界和业界不断提出基于 Transformer 注意力机制的新模型,我们有时很难对这一方向进行归纳总结。近日,领英 AI 产品战索界 in Avier 产品战略述性文章或许可以帮助我们解决这一问题。

推荐:

本文的目标是为最流行的 Transformer 模型怐个侪单的目录和分类,还介绍了 Transformer 模型中最重要的方面和创新。

论文 2:High-throughout Model Generatif🎜🎜 Model Bahasa🎜

作者:Ying Sheng 等

论文地址:https://github.com/FMInference /FlexGen/blob/main/docs/paper.pdf

- 摘要:传统上,大语言模型(摘要:传统上,大语言模型(摘要:传统上,大语言模型(樻缉计算和内存要求使人们必须使用多个高端 AI 加速器进行训练。本研究探索了将馂住索了将禂住低到一个消费级 GPU 并实现实用性能。、

- 近日,来自斯坦福大学、UC Berkeley、苏黎世联邦理工学院、Yandex、莫斯科国立高等国立高等经家基梅隆大学等机构的新研究提出了 FlexGen,这是一种用于运行有限 GPU 内存的 LLM 的高吞吐量生成引擎。下图为 FlexGen 的设计思路, 利用块调度来重用权重并将 I/O 与计所示,而其他基线系统使用低效的逐行调度,如下图 (a) 所示。

推荐:跑 ChatGPT 体量模型,从此只需一块此只需一块通推荐:跑 ChatGPT 体量模型,从此只需一块此只需一块此只需一块通是一一块通新。 🎜>

论文地址:https://arxiv.org/pdf/2205.10664.pdf

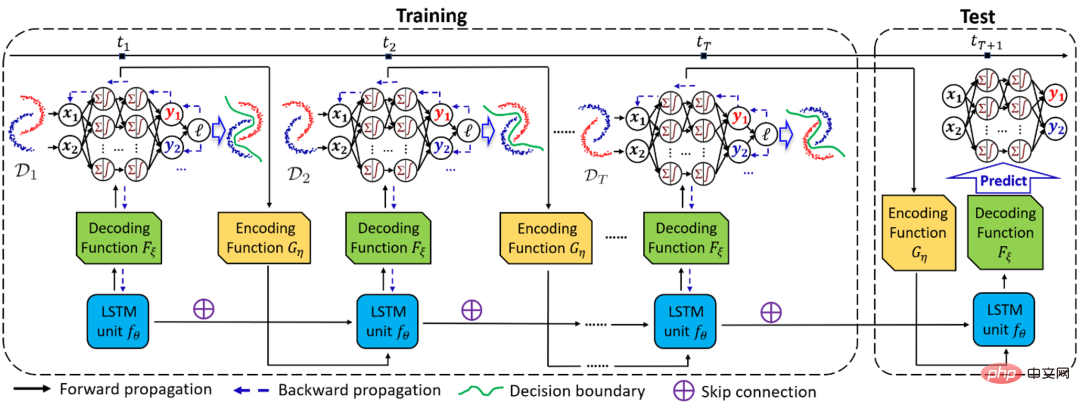

Untuk tujuan ini, pasukan Profesor Zhao Liang dari Universiti Emory mencadangkan rangka kerja generalisasi domain masa DRAIN berdasarkan teori Bayesian, yang menggunakan rangkaian rekursif untuk mempelajari hanyut pengedaran domain dimensi masa, dan juga menggunakan dinamik rangkaian saraf ke Dan gabungan teknologi penjanaan graf memaksimumkan keupayaan ekspresif model dan mencapai generalisasi dan ramalan model dalam bidang yang tidak diketahui pada masa hadapan.

Karya ini telah dipilih ke dalam ICLR 2023 Oral (5% teratas antara kertas yang diterima). Berikut ialah gambar rajah skema rangka kerja keseluruhan DRAIN.

Disyorkan: Berkat rangkaian neural dinamik yang sedar drift, rangka kerja baharu untuk generalisasi domain masa jauh melebihi kaedah generalisasi & penyesuaian domain.

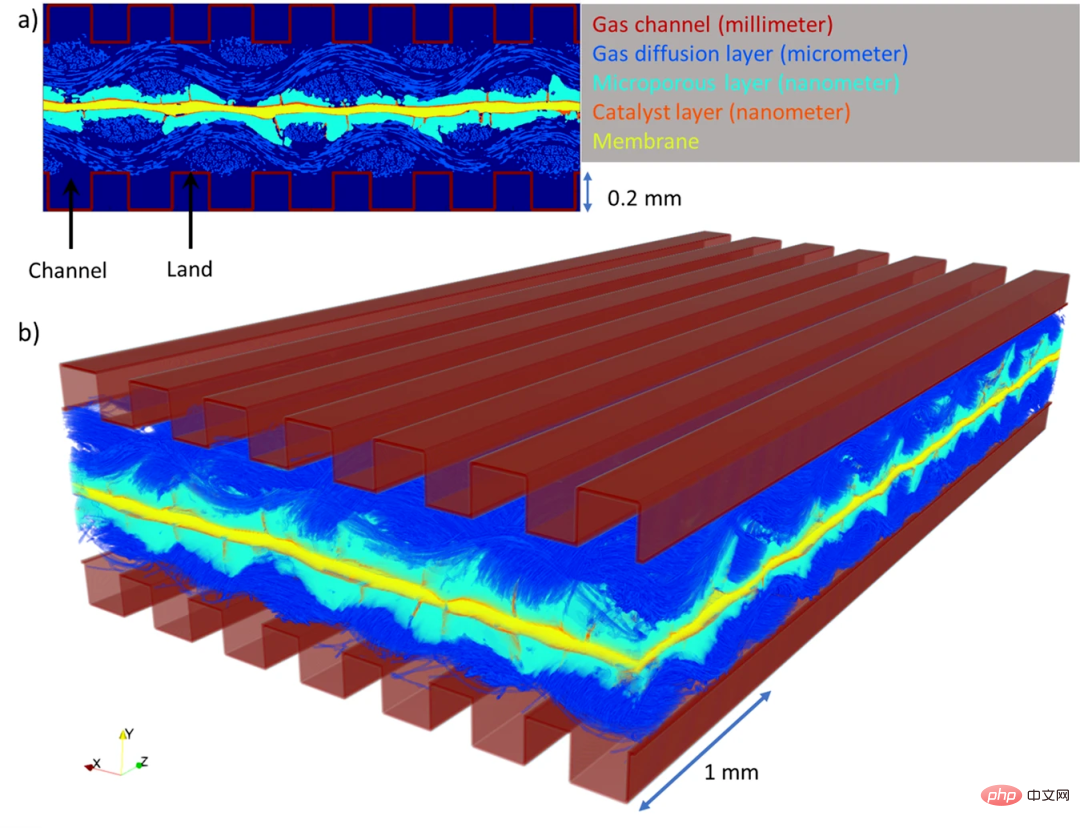

Kertas 4: Pemodelan tepat secara fizikal berskala besar bagi sel bahan api membran pertukaran proton sebenar dengan pembelajaran mendalam

- Pengarang: Ying Da Wang et al

- Alamat kertas: https://www.nature.com/articles/s41467-023-35973 - 8

Abstrak: Untuk memastikan bekalan tenaga dan memerangi perubahan iklim, tumpuan orang ramai telah beralih daripada bahan api fosil kepada bersih dan boleh diperbaharui tenaga, hidrogen Dengan ketumpatan tenaga yang tinggi dan sifat tenaga bersih dan rendah karbon, ia boleh memainkan peranan penting dalam transformasi tenaga. Sel bahan api hidrogen, terutamanya sel bahan api membran pertukaran proton (PEMFC), adalah kunci kepada revolusi hijau ini kerana kecekapan penukaran tenaga yang tinggi dan operasi sifar pelepasan.

PEMFC menukar hidrogen kepada elektrik melalui proses elektrokimia, dengan satu-satunya hasil sampingan tindak balas ialah air tulen. Walau bagaimanapun, PEMFC boleh menjadi tidak cekap jika air tidak dapat mengalir keluar dari sel dengan betul dan seterusnya "membanjiri" sistem. Sehingga kini, adalah sukar bagi jurutera untuk memahami cara yang tepat di mana air mengalir atau terkumpul di dalam sel bahan api kerana ia sangat kecil dan kompleks.

Baru-baru ini, pasukan penyelidik dari University of New South Wales di Sydney telah membangunkan algoritma pembelajaran mendalam (DualEDSR) untuk meningkatkan pemahaman tentang keadaan dalaman PEMFC, yang boleh diperolehi daripada resolusi rendah X Imej pemodelan resolusi tinggi yang dihasilkan daripada tomografi mikrokomputer radiografik. Proses ini telah diuji pada sel bahan api hidrogen tunggal, membolehkan bahagian dalamannya dimodelkan dengan tepat dan berpotensi meningkatkan kecekapannya. Rajah di bawah menunjukkan domain PEMFC yang dijana dalam kajian ini.

Disyorkan: Pembelajaran mendalam boleh memodelkan fizik berskala besar dengan tepat di dalam sel bahan api untuk membantu Prestasi bateri bertambah baik. | Pengarang: Ce Zhou et al

Alamat kertas: https://arxiv.org/pdf/2302.09419.pdf

-

Disyorkan: Dari BERT ke ChatGPT, semakan seratus halaman meringkaskan sejarah evolusi model besar yang telah dilatih.

- Kertas 6: Menambah Kawalan Bersyarat pada Model Resapan Teks-ke-Imej

Pengarang: Lvmin Zhang et al

Alamat kertas: https://arxiv.org/pdf/2302.05543.pdf

Disyorkan: Pengurangan dimensi AI menyerang pelukis manusia, graf Vincentian diperkenalkan ke ControlNet, dan maklumat kedalaman dan kelebihan digunakan semula sepenuhnya. Pengarang : Fangzhou Hong et al

Alamat kertas: https://arxiv.org/abs/2210.04888

- Abstrak: Di ICLR 2023, pasukan S-Lab Pusat Penyelidikan Bersama Universiti Teknologi Nanyang-SenseTime mencadangkan kaedah pertama untuk mempelajari penjanaan badan manusia 3D resolusi tinggi daripada koleksi imej 2D EVA3D. Terima kasih kepada pemaparan boleh beza yang disediakan oleh NeRF, model generatif 3D terkini telah mencapai hasil yang menakjubkan pada objek pegun. Walau bagaimanapun, dalam kategori yang lebih kompleks dan boleh berubah bentuk seperti tubuh manusia, generasi 3D masih menimbulkan cabaran yang hebat.

- Kertas kerja ini mencadangkan perwakilan NeRF gabungan yang cekap bagi tubuh manusia, mencapai penjanaan badan manusia 3D resolusi tinggi (512x256) tanpa menggunakan model resolusi super. EVA3D telah dengan ketara mengatasi penyelesaian sedia ada pada empat set data badan manusia berskala besar, dan kod tersebut adalah sumber terbuka.

Cadangan: ICLR 2023 Spotlight |

Stesen Radio Mingguan ArXiv

Heart of Machine bekerjasama dengan Stesen Radio Mingguan ArXiv yang dimulakan oleh Chu Hang, Luo Ruotian dan Mei Hongyuan, dan memilih artikel ini berdasarkan 7 Kertas Lagi kertas penting minggu ini, termasuk 10 kertas terpilih dalam setiap medan NLP, CV dan ML, dan pengenalan abstrak kertas dalam bentuk audio disediakan seperti berikut:

7 Kertas NLP

10 kertas kerja NLP yang ditampilkan minggu ini ialah:

1. Anjuran Aktif dengan Rantaian Pemikiran untuk Model Bahasa Besar (daripada Tong Zhang)2 >

3. ProsAudit, penanda aras prosodik untuk model pertuturan yang diselia sendiri (dari Emmanuel Dupoux)4 -19 Pesakit. ( daripada Jie Yang)

5. Memusingkan Teks Mentah kepada Istilah Lambda dengan Perhatian Graf (daripada Michael Moortgat)

7 Model Pengecaman Entiti Berasaskan Neural Span >

10 Kertas CV

10 CV yang dipilih kertas kerja minggu ini ialah:

1. Pemperibadian Cepat Model Teks-ke-Imej (daripada Daniel Cohen-Or)

3 🎜>4. Menilai Keberkesanan Produk Penjagaan Kulit: Simulasi Liang Wajah Jangka Pendek yang Realistik (dari Weisi Lin)

5 Tali Menggunakan Rangkaian Neural Konvolusi. (daripada Moncef Gabbouj)6 >

7. Penyebaran Sedar Wilayah untuk Penyuntingan Imej dipacu Teks Tangkapan Sifar. (dari Changsheng Xu)

8. Rangkaian Penyesuai Sisi untuk Segmentasi Semantik Perbendaharaan Kata Terbuka. (dari Xiang Bai)

9. VoxFormer: Transformer Voxel Jarang untuk Penyiapan Adegan Semantik 3D berasaskan Kamera. (daripada Sanja Fidler)

10. Ramalan Video Berpusatkan Objek melalui Penyahgandingan Dinamik dan Interaksi Objek. (daripada Sven Behnke)

10 ML Kertas

本周 10 篇 ML 精选论文是:

1. normflows: Pakej PyTorch untuk Menormalkan Aliran. (dari Bernhard Schölkopf)

2. Pembelajaran Konsep untuk Pembelajaran Pengukuhan Pelbagai Agen Boleh Ditafsir. (daripada Katia Sycara)

3. Guru Rawak adalah Guru yang Baik. (daripada Thomas Hofmann)

4. Menjajarkan Model Teks-ke-Imej menggunakan Maklum Balas Manusia. (daripada Craig Boutilier, Pieter Abbeel)

5. Perubahan Adalah Sukar: Pandangan Lebih Dekat pada Anjakan Subpopulasi. (dari Dina Katabi)

6. AlpaServe: Multiplexing Statistik dengan Model Paralelisme untuk Penyajian Pembelajaran Mendalam. (daripada Zhifeng Chen)

7. Pengoptimuman Dasar Pelbagai untuk Ruang Tindakan Berstruktur. (dari Hongyuan Zha)

8. Geometri Kebolehcampuran. (daripada Robert C. Williamson)

9. Adakah Pembelajaran Mendalam Belajar Abstrak? Rangka Kerja Penyiasatan Sistematik. (dari Nanning Zheng)

10. Pengurangan Risiko Counterfaktual Berurutan. (dari Julien Mairal)

Atas ialah kandungan terperinci GPU menjalankan model volum ChatGPT dan ControlNet ialah satu lagi artifak untuk lukisan AI.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI