Rumah >Peranti teknologi >AI >'Midjourney dalam bidang video'! Kerja beta dalaman generasi baru AI Gen-2 bocor, netizen berkata ia terlalu realistik

'Midjourney dalam bidang video'! Kerja beta dalaman generasi baru AI Gen-2 bocor, netizen berkata ia terlalu realistik

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-14 23:10:011682semak imbas

Gen-2, alat penjanaan video AI yang mendakwa boleh merakam filem blockbuster dalam satu ayat, telah mula mendedahkan warna sebenar.

Seorang blogger Twitter telah mendahului kelayakan untuk beta tertutup.

Ini adalah hasil yang dijananya menggunakan perkataan gesaan "seorang lelaki berbentuk baik atau simetri sedang ditemubual di bar":

Saya melihat seorang lelaki berbaju gelap memandang tepat ke arahnya Bercakap kepada orang lain, mata dan ekspresinya menunjukkan kesungguhan dan kejujuran, dan orang yang bertentangan dengannya mengangguk bersetuju dari semasa ke semasa.

Keseluruhan video sangat koheren dan kualiti gambarnya sangat jelas Pada pandangan pertama, rasanya seperti wawancara sebenar!

Versi lain penjanaan kata gesaan yang sama juga tidak buruk:

Kali ini kamera lebih dekat, latar belakang lebih realistik dan watak masih ekspresif.

Selepas membaca set karya ini, beberapa netizen berkata:

Sungguh luar biasa, hanya bergantung pada gesaan teks boleh menghasilkan keputusan sedemikian!

Sesetengah orang terus terang berkata:

Ini ialah ketibaan Midjourney dalam medan video.

Blogger sebenarnya telah menguji Gen-2

Blogger ini bernama Nick St. Pierre, yang pakar dalam berkongsi karyanya yang dibuat dengan AI di Twitter.

Selain gaya realistik yang dilihat pada mulanya, beliau turut mengeluarkan satu set karya fiksyen sains Gen-2.

Contohnya, "Angkasawan Mengembara Melalui Angkasa":

"Seorang askar bersenjata berlari di koridor kapal angkasa, bayang gelap memusnahkan dinding di belakang him" :

"Sekeluarga robot pemakan mikrocip di zoo manusia" :

"Sebuah tentera robot humanoid menjajah dataran beku" :

(Ia mempunyai momentum tentera White Walker yang menyerang Tembok Besar dalam Game of Thrones...)

“Lelaki terakhir di bumi memerhati kapal angkasa penceroboh mendarat di atas Tokyo ”:

…

Semua perkara di atas boleh dilakukan dengan hanya satu perkataan, tanpa perlu merujuk kepada. gambar dan video lain.

Walaupun kesan set sci-fi ini sedikit lebih rendah daripada kesan "Man in a Bar Being Interviewed", perkara ajaibnya ialah ia boleh menandingi rasa "huru-hara" zaman awal zaman itu. Model penjanaan imej AI hampir sama - nampaknya saya dapat melihat bayang AI seperti resapan stabil pada masa itu.

Seperti kata Nick St. Pierre:

Gen-2 masih di peringkat awal, dan ia pasti akan menjadi lebih baik pada masa hadapan.

Kami juga menemui beberapa keputusan di Internet yang diuji oleh orang lain yang telah layak untuk ujian dalaman:

Boleh dikatakan kecuali karya fiksyen sains yang lebih sukar, ia boleh mengendalikan segala-galanya Semua lelaki yang cukup baik.

Penjanaan video AI juga berkembang pesat

Gen-2, alat AI yang mengkhusus dalam penjanaan video, telah dikeluarkan pada 20 Mac (kertas 11 Mac).

Sebagai pendatang baru dalam bidang AIGC, kelajuan dan kualiti lelarannya juga agak pantas:

Versi Gen-1 baru sahaja dilahirkan pada bulan Februari, dan pada masa itu ia hanya boleh digunakan untuk Sudah mempunyai video untuk mengedit;

Kini Gen-2 boleh terus menjana video menggunakan teks dan imej sebagai kata-kata gesaan.

Secara rasmi memanggilnya "langkah seterusnya dalam AI generatif", dan slogan itu juga sangat mendominasi:

katakan, lihatlah. (Selagi anda boleh memberitahunya, saya boleh membiarkan anda melihatnya)

Kemas kini Gen-2 membawa lapan fungsi utama sekali gus:

Video Vincent, teks + rujukan imej Video mentah, menukar imej statik kepada video, pemindahan gaya video, papan cerita, topeng (seperti menukar anjing putih berjalan menjadi Dalmatian), rendering dan pemperibadian (seperti mengubah budak lelaki yang menggelengkan kepalanya menjadi kura-kura dalam beberapa saat) .

Penampilannya, seperti lukisan AI, membolehkan orang ramai melihat perubahan besar yang tersembunyi dalam bidang filem, televisyen, permainan dan pemasaran.

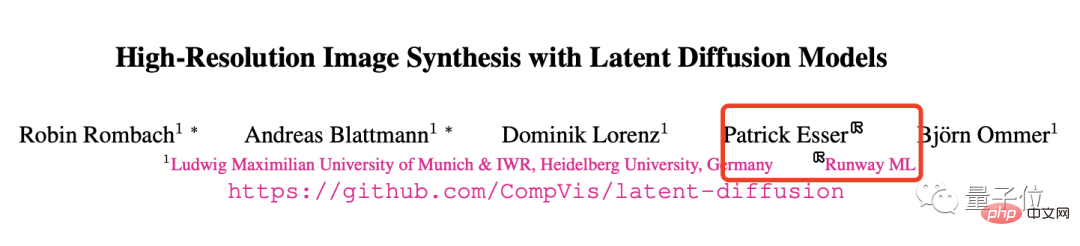

Syarikat pembangunan di belakangnya juga patut disebut, ia adalah Runway.

Landasan telah ditubuhkan pada 2018. Ia telah menyediakan sokongan teknikal untuk kesan khas "The Instant Universe" dan turut mengambil bahagian dalam pembangunan Stable Diffusion (stok yang menjanjikan).

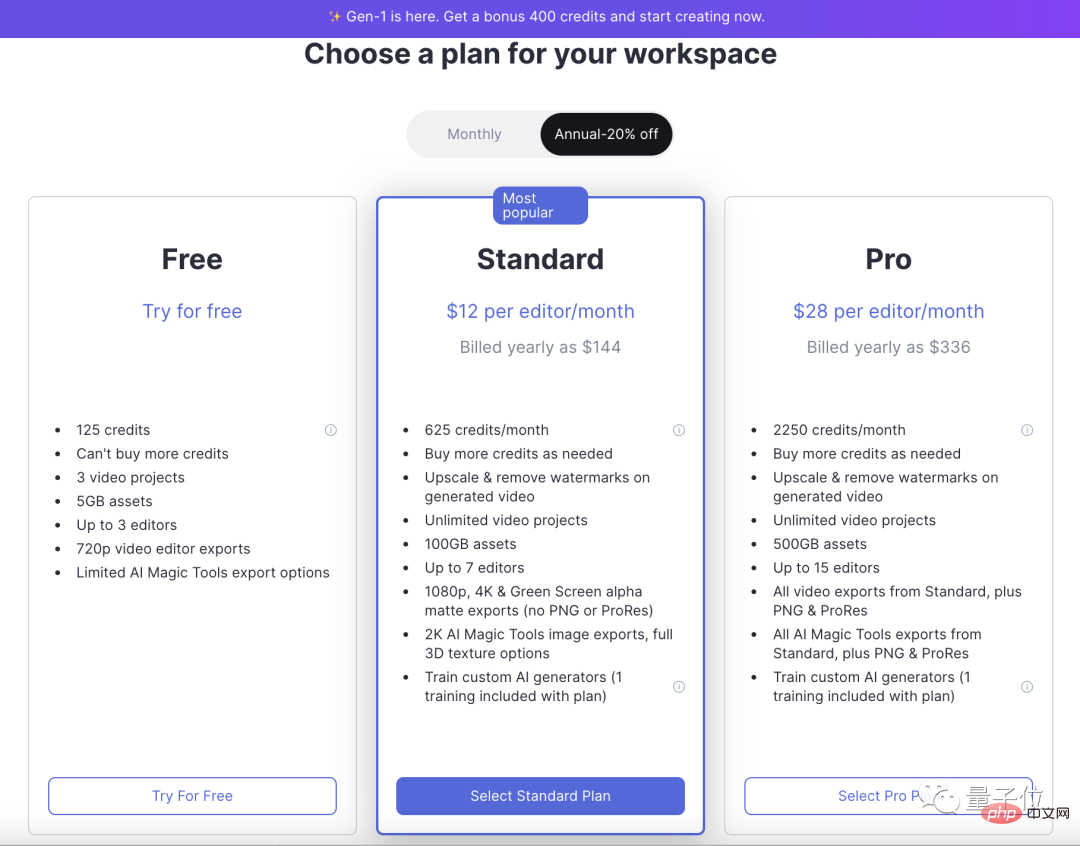

Petua: Gen-1 sudah boleh dimainkan (selepas 125 peluang habis, anda hanya boleh membayar setiap bulan), Gen-2 masih belum dikeluarkan secara rasmi kepada awam .

Selain siri Gen, Microsoft Asia Research Institute juga baru-baru ini mengeluarkan AI yang boleh menjana video ultra-panjang berdasarkan teks: NUWA-XL.

Dengan hanya 16 ayat mudah, ia boleh mendapat animasi selama 11 minit:

Maju ke hadapan sedikit Nak, di atas pada hari yang sama Gen-2 dikeluarkan, Alibaba Damo Academy juga membuka sumber AI teks-ke-video dengan 1.7 bilion parameter:

Kesannya ialah Mak Cik Jiang:

...

Adalah dijangka bukan sahaja penjanaan imej, malah medan video akan menjadi meriah.

Ahem, adakah ia akan menjadi gelombang karnival AI massa yang seterusnya?

Pautan rujukan:

[1]https://www.php.cn/link/4d7e0d72898ae7ea3593eb5ebf20c744

[2]https://www.php.cn/link/e00944d55e6432ccf20f9fda2492b6fd

[3]https://www.php.cn/link/ce653013fadbb2f275790dbb2f275790d [4]

https://www.php.cn/link/6e3adb1ae0e02c934766182313b6775d[5]

https://www .php .cn/link/b9b72b29352f3764ea4dec130772bd9d[6]

https://www.php.cn/link/79d37fb2893b428f7ea4ed3🎜>

Atas ialah kandungan terperinci 'Midjourney dalam bidang video'! Kerja beta dalaman generasi baru AI Gen-2 bocor, netizen berkata ia terlalu realistik. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI