Rumah >Peranti teknologi >AI >Melepasi SOTA sebanyak 3.27%, Shanghai Jiao Tong University dan lain-lain mencadangkan kaedah baharu pengagregatan tempatan adaptif

Melepasi SOTA sebanyak 3.27%, Shanghai Jiao Tong University dan lain-lain mencadangkan kaedah baharu pengagregatan tempatan adaptif

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-12 23:19:041307semak imbas

Artikel ini memperkenalkan kertas kerja yang disertakan dalam AAAI 2023. Kertas kerja itu ditulis oleh Hua Yang dan Louisian dari Makmal Kunci Shanghai bagi Pengkomputeran Skala dan Sistem di Universiti Jiao Tong Shanghai, Queen's University Belfast Teacher Wang Hao dari Negeri Nazhou Universiti bersama-sama menyiapkannya.

- Pautan kertas:https://arxiv.org/abs/2212.01197

- Pautan kod (termasuk arahan untuk menggunakan modul ALA): https://github.com/TsingZ0/FedALA

Kertas kerja ini mencadangkan kaedah pengagregatan tempatan adaptif untuk pembelajaran bersekutu bagi menangani masalah heterogeniti statistik dalam pembelajaran bersekutu dengan secara automatik menangkap maklumat yang diperlukan oleh pelanggan daripada model global. Penulis membandingkan 11 model SOTA dan mencapai prestasi cemerlang sebanyak 3.27% melebihi kaedah optimum. Penulis menggunakan modul pengagregatan tempatan adaptif kepada kaedah pembelajaran bersekutu yang lain dan mencapai peningkatan sehingga 24.19%.

1 Pengenalan

Pembelajaran Bersekutu (FL) membantu orang ramai memahami sepenuhnya keperluan privasi pengguna dengan mengekalkan data privasi pengguna secara setempat tanpa menyebarkannya data. Walau bagaimanapun, oleh kerana data antara pelanggan tidak dapat dilihat, kepelbagaian statistik data (data tidak bebas dan teragih sama (bukan IID) dan ketidakseimbangan volum data) telah menjadi salah satu cabaran besar FL. Kepelbagaian statistik data menyukarkan kaedah pembelajaran bersekutu tradisional (seperti FedAvg, dll.) untuk mendapatkan satu model global yang sesuai untuk setiap pelanggan melalui latihan proses FL.

Dalam beberapa tahun kebelakangan ini, kaedah pembelajaran bersekutu diperibadikan (pFL) telah mendapat perhatian yang semakin meningkat kerana keupayaannya untuk mengatasi kepelbagaian statistik data. Tidak seperti FL tradisional, yang mencari model global berkualiti tinggi, pendekatan pFL bertujuan untuk melatih model diperibadikan yang sesuai untuk setiap pelanggan dengan kuasa pengkomputeran kolaboratif pembelajaran bersekutu. Penyelidikan pFL sedia ada mengenai model pengagregatan pada pelayan boleh dibahagikan kepada tiga kategori berikut:

(1) Kaedah untuk mempelajari model global tunggal dan memperhalusinya, termasuk Per-FedAvg dan FedRep;

(2) Kaedah untuk mempelajari model pemperibadian tambahan, termasuk pFedMe dan Ditto; kaedah pengagregatan tempatan) untuk mempelajari model tempatan, termasuk FedAMP, FedPHP, FedFomo, APPLE dan PartialFed.

Kaedah pFL dalam kategori (1) dan (2) menggunakan semua maklumat dalam model global untuk pemulaan tempatan (merujuk kepada memulakan model tempatan sebelum latihan tempatan pada setiap lelaran). Walau bagaimanapun, dalam model global, hanya maklumat yang meningkatkan kualiti model tempatan (maklumat yang diperlukan oleh pelanggan yang memenuhi matlamat latihan tempatan) yang bermanfaat kepada pelanggan. Model global tidak digeneralisasikan dengan baik kerana ia mengandungi maklumat yang diperlukan dan tidak diperlukan oleh pelanggan tunggal. Oleh itu, penyelidik mencadangkan kaedah pFL dalam kategori (3) untuk menangkap maklumat yang diperlukan oleh setiap pelanggan dalam model global melalui pengagregatan diperibadikan. Walau bagaimanapun, kaedah pFL dalam kategori (3) masih wujud (a) tidak menganggap matlamat latihan tempatan pelanggan (seperti FedAMP dan FedPHP), (b) mempunyai kos pengiraan dan komunikasi yang tinggi (seperti FedFomo dan APPLE), (c ) privasi Isu seperti kebocoran (seperti FedFomo dan APPLE) dan (d) ketidakpadanan antara pengagregatan diperibadikan dan sasaran latihan tempatan (seperti PartialFed). Tambahan pula, memandangkan kaedah ini membuat pengubahsuaian yang besar pada proses FL, kaedah pengagregatan diperibadikan yang mereka gunakan tidak boleh digunakan secara langsung dalam kebanyakan kaedah FL sedia ada.

Untuk menangkap maklumat yang diperlukan oleh pelanggan dengan tepat daripada model global tanpa meningkatkan kos komunikasi dalam setiap lelaran berbanding FedAvg, penulis mencadangkan kaedah untuk pembelajaran persekutuan Adaptive Local Aggregation Kaedah (FedALA). Seperti yang ditunjukkan dalam Rajah 1, FedALA menangkap maklumat yang diperlukan dalam model global dengan mengagregat model global dengan model tempatan melalui modul pengagregatan tempatan adaptif (ALA) sebelum setiap latihan tempatan. Memandangkan FedALA hanya menggunakan ALA untuk mengubah suai proses pemulaan model tempatan dalam setiap lelaran berbanding dengan FedAvg, tanpa mengubah proses FL lain, ALA boleh digunakan secara langsung pada kebanyakan kaedah FL sedia ada yang lain untuk meningkatkan prestasi keperibadian mereka.

Rajah 1: Proses pembelajaran setempat pada klien dalam lelaran pertama

2 Kaedah

2.1 Adaptif Pengagregatan Setempat (ALA)

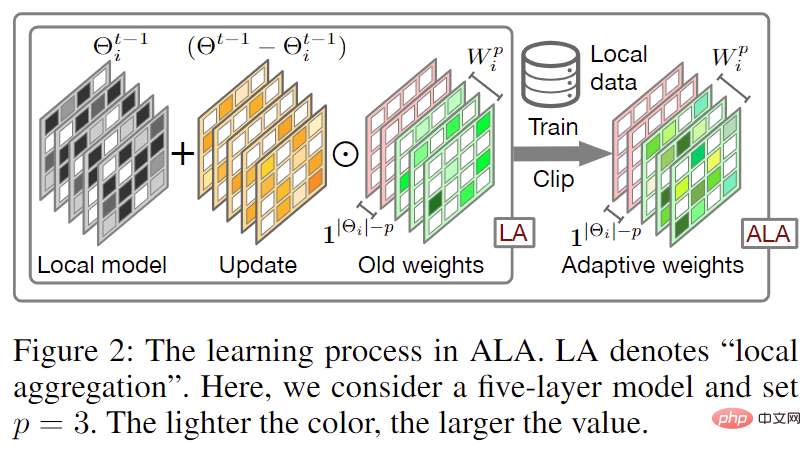

Rajah 2: Proses Pengagregatan Setempat Suai (ALA)

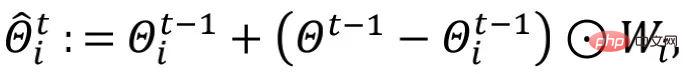

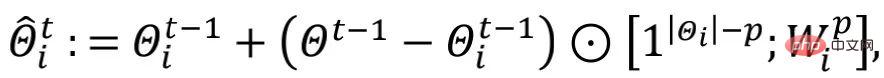

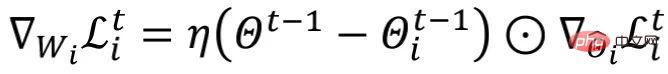

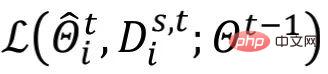

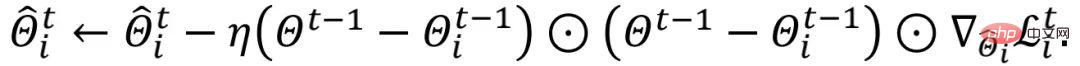

Proses pengagregatan tempatan adaptif (ALA) ditunjukkan dalam Rajah 2. Berbanding dengan pembelajaran bersekutu tradisional, model global yang dimuat turun ditimpa terus dengan model tempatan untuk mendapatkan model permulaan tempatan Dengan cara (iaitu, ), FedALA melaksanakan pengagregatan setempat adaptif dengan mempelajari pemberat pengagregatan setempat untuk setiap parameter.

Antaranya, penulis menyebut item tersebut  "renew" . Di samping itu, penulis melaksanakan penyelarasan melalui kaedah pemangkasan berat mengikut unsur

"renew" . Di samping itu, penulis melaksanakan penyelarasan melalui kaedah pemangkasan berat mengikut unsur  dan mengehadkan nilai dalam

dan mengehadkan nilai dalam  kepada [0,1].

kepada [0,1].

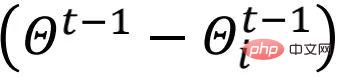

Oleh kerana rangkaian lapisan bawah rangkaian neural dalam (DNN) cenderung untuk mempelajari secara relatif maklumat umum daripada lapisan yang lebih tinggi, dan maklumat umum ialah maklumat yang diperlukan oleh setiap model tempatan, jadi Kebanyakan maklumat dalam rangkaian peringkat rendah dalam model global adalah konsisten dengan maklumat yang diperlukan dalam rangkaian peringkat rendah dalam model tempatan. Untuk mengurangkan kos pengiraan yang diperlukan untuk mempelajari berat pengagregatan tempatan, penulis memperkenalkan hiperparameter p untuk mengawal skop ALA, supaya parameter rangkaian lapisan bawah dalam model global secara langsung meliputi rangkaian lapisan bawah dalam model tempatan, dan hanya dalam lapisan yang lebih tinggi Dayakan ALA.

di mana,  mewakili bilangan lapisan rangkaian saraf dalam

mewakili bilangan lapisan rangkaian saraf dalam  ( atau bilangan blok rangkaian saraf),

( atau bilangan blok rangkaian saraf),  selaras dengan bentuk rangkaian peringkat rendah dalam

selaras dengan bentuk rangkaian peringkat rendah dalam  dan

dan  ialah konsisten dengan seluruh

ialah konsisten dengan seluruh  Rangkaian peringkat tinggi lapisan p mempunyai bentuk yang sama.

Rangkaian peringkat tinggi lapisan p mempunyai bentuk yang sama.

Pengarang memulakan semua nilai dalam  kepada 1 dan mengemas kini

kepada 1 dan mengemas kini  berdasarkan

berdasarkan  lama semasa setiap pusingan permulaan setempat. Untuk mengurangkan lagi kos pengiraan, penulis menggunakan pensampelan rawak s

lama semasa setiap pusingan permulaan setempat. Untuk mengurangkan lagi kos pengiraan, penulis menggunakan pensampelan rawak s

, di mana  adalah pembelajaran daripada kemas kini

adalah pembelajaran daripada kemas kini  Kadar. Dalam proses pembelajaran

Kadar. Dalam proses pembelajaran  , pengarang membekukan parameter lain yang boleh dilatih kecuali

, pengarang membekukan parameter lain yang boleh dilatih kecuali  .

.

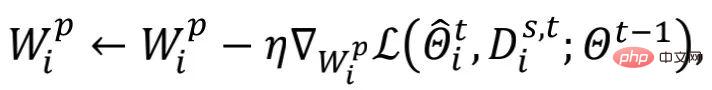

Rajah 3: Lengkung pembelajaran klien 8 pada set data MNIST dan Cifar10

Dengan memilih nilai p yang lebih kecil, parameter yang diperlukan untuk latihan dalam ALA boleh dikurangkan dengan banyak tanpa menjejaskan prestasi FedALA. Tambahan pula, seperti yang ditunjukkan dalam Rajah 3, penulis memerhatikan bahawa sebaik sahaja ia dilatih untuk menumpu dalam latihan pertama  , ia tidak memberi kesan yang besar kepada kualiti model tempatan walaupun

, ia tidak memberi kesan yang besar kepada kualiti model tempatan walaupun  dilatih dalam lelaran berikutnya. Iaitu, setiap pelanggan boleh menggunakan semula

dilatih dalam lelaran berikutnya. Iaitu, setiap pelanggan boleh menggunakan semula  lama untuk menangkap maklumat yang diperlukan. Penulis menggunakan kaedah penalaan halus

lama untuk menangkap maklumat yang diperlukan. Penulis menggunakan kaedah penalaan halus  dalam lelaran berikutnya untuk mengurangkan kos pengiraan.

dalam lelaran berikutnya untuk mengurangkan kos pengiraan.

2.2 Analisis ALA

Tanpa menjejaskan analisis, demi kesederhanaan, penulis mengabaikan  dan menganggap

dan menganggap  . Mengikut formula di atas, kita boleh mendapatkan

. Mengikut formula di atas, kita boleh mendapatkan  , dengan

, dengan  mewakili

mewakili  . Pengarang boleh memikirkan untuk mengemas kini

. Pengarang boleh memikirkan untuk mengemas kini  dalam ALA sebagai mengemas kini

dalam ALA sebagai mengemas kini  .

.

Istilah kecerunan  ialah unsur berskala demi unsur dalam setiap pusingan. Berbeza daripada kaedah latihan model tempatan (atau penalaan halus), proses kemas kini

ialah unsur berskala demi unsur dalam setiap pusingan. Berbeza daripada kaedah latihan model tempatan (atau penalaan halus), proses kemas kini  di atas boleh melihat maklumat biasa dalam model global. Di antara pusingan lelaran yang berbeza,

di atas boleh melihat maklumat biasa dalam model global. Di antara pusingan lelaran yang berbeza,  yang berubah secara dinamik memperkenalkan maklumat dinamik ke dalam modul ALA, menjadikannya mudah untuk FedALA menyesuaikan diri dengan persekitaran yang kompleks.

yang berubah secara dinamik memperkenalkan maklumat dinamik ke dalam modul ALA, menjadikannya mudah untuk FedALA menyesuaikan diri dengan persekitaran yang kompleks.

3 Eksperimen

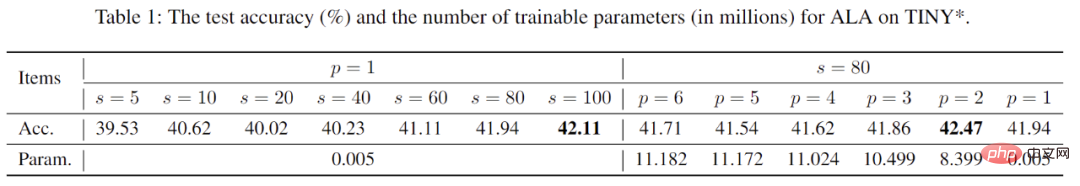

Pengarang menggunakan ResNet-18 pada set data Tiny-ImageNet dalam persekitaran heterogen data praktikal untuk membandingkan hiperparameter s dan p Penyelidikan mengenai kesan FedALA ditunjukkan dalam Jadual 1. Untuk s, menggunakan lebih banyak sampel data latihan tempatan secara rawak untuk pembelajaran modul ALA boleh menjadikan model diperibadikan berprestasi lebih baik, tetapi ia juga meningkatkan kos pengiraan. Apabila menggunakan ALA, saiz s boleh dilaraskan berdasarkan kuasa pengkomputeran setiap pelanggan. Seperti yang dapat dilihat daripada jadual, FedALA masih mempunyai prestasi cemerlang walaupun menggunakan s yang sangat kecil (seperti s=5). Untuk p, nilai p yang berbeza hampir tidak memberi kesan ke atas prestasi model yang diperibadikan, tetapi terdapat perbezaan besar dalam kos pengiraan. Fenomena ini juga menunjukkan dari satu aspek keberkesanan kaedah seperti FedRep, yang membahagikan model dan mengekalkan lapisan rangkaian saraf dekat dengan output tanpa memuat naiknya kepada klien. Apabila menggunakan ALA, kita boleh menggunakan nilai p yang lebih kecil dan sesuai untuk mengurangkan lagi kos pengiraan sambil memastikan keupayaan prestasi model diperibadikan.

Jadual 1: Penyelidikan tentang hiperparameter dan kesannya terhadap FedALA

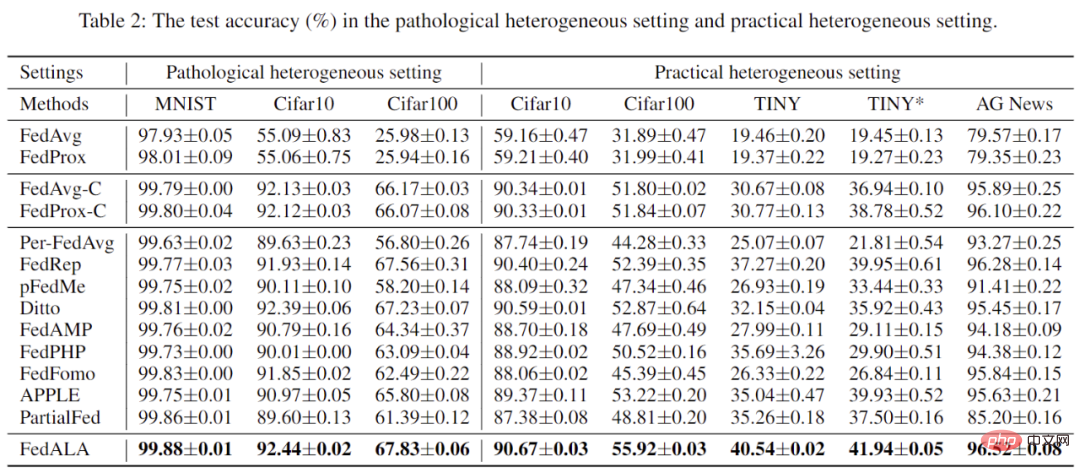

Penulis membandingkan dan menganalisis secara terperinci FedALA dengan 11 kaedah SOTA dalam persekitaran heterogen data patologi dan persekitaran heterogen data praktikal. Seperti yang ditunjukkan dalam Jadual 2, data menunjukkan bahawa FedALA mengatasi 11 kaedah SOTA ini dalam kes ini, di mana "TINY" bermaksud menggunakan CNN 4 lapisan pada Tiny-ImageNet. Contohnya, FedALA mengatasi garis dasar optimum sebanyak 3.27% dalam kes TINY.

Jadual 2: Keputusan eksperimen di bawah persekitaran heterogen data patologi dan sebenar

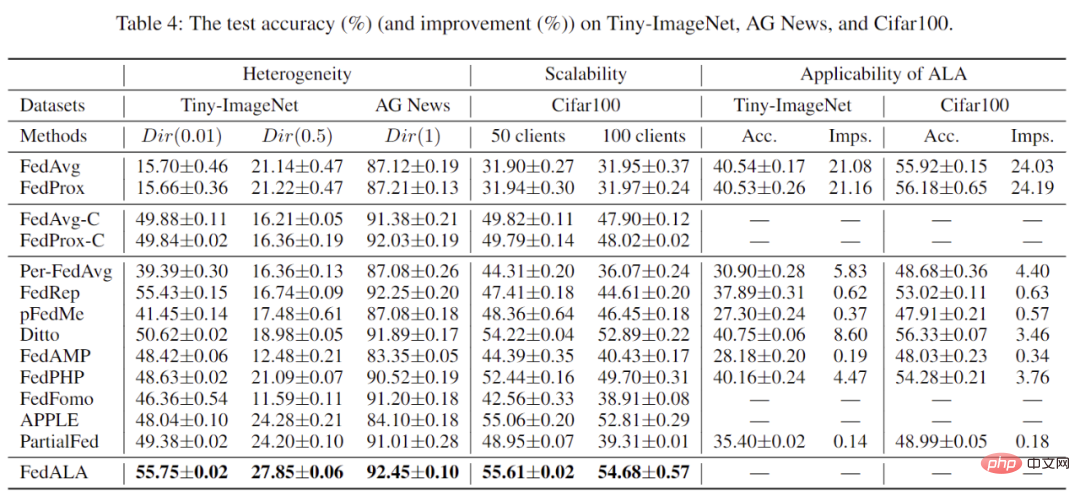

Selain itu, pengarang Prestasi FedALA juga dinilai di bawah persekitaran heterogen yang berbeza dan jumlah bilangan pelanggan. Seperti yang ditunjukkan dalam Jadual 3, FedALA masih mengekalkan prestasi cemerlang di bawah keadaan ini.

Jadual 3: Keputusan eksperimen lain

Eksperimen berdasarkan Jadual 3 Akibatnya, menggunakan modul ALA kepada kaedah lain boleh mencapai peningkatan sehingga 24.19%.

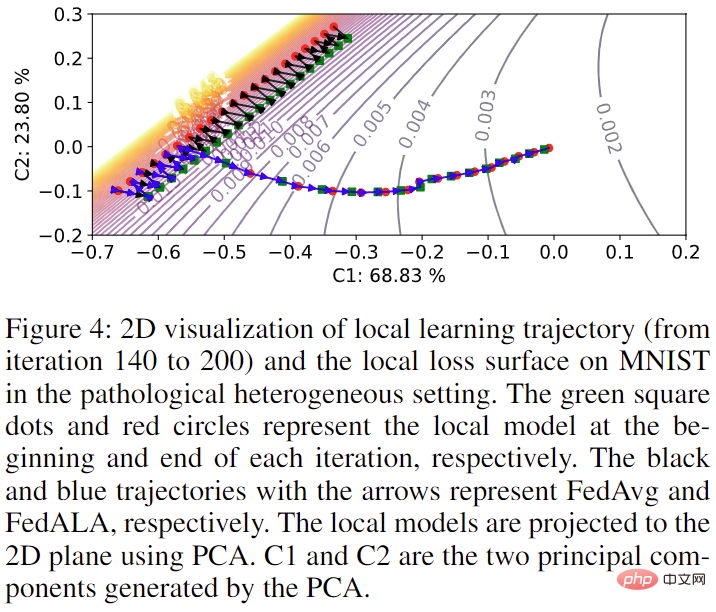

Akhir sekali, penulis juga menggambarkan kesan penambahan modul ALA pada latihan model dalam proses FL asal pada MNIST, seperti yang ditunjukkan dalam Rajah 4. Apabila ALA tidak diaktifkan, trajektori latihan model adalah konsisten dengan menggunakan FedAvg. Sebaik sahaja ALA diaktifkan, model boleh mengoptimumkan terus ke arah matlamat optimum dengan maklumat yang diperlukan untuk latihannya ditangkap dalam model global.

Rajah 4: Visualisasi trajektori latihan model pada klien 4

Atas ialah kandungan terperinci Melepasi SOTA sebanyak 3.27%, Shanghai Jiao Tong University dan lain-lain mencadangkan kaedah baharu pengagregatan tempatan adaptif. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI