Rumah >Peranti teknologi >AI >Perlindungan Privasi: AI Menganonimkan Data Klinikal Penjagaan Kesihatan

Perlindungan Privasi: AI Menganonimkan Data Klinikal Penjagaan Kesihatan

- 王林ke hadapan

- 2023-04-12 15:19:081155semak imbas

Dalam menghadapi wabak COVID-19 yang mendadak, kami telah menyaksikan pelanggaran data yang memecahkan rekod. Laporan IBM baru-baru ini mendapati bahawa kos pelanggaran data juga meningkat secara mendadak.

Penjagaan kesihatan sudah pasti salah satu industri yang paling terjejas oleh pelanggaran data, dengan purata kerugian $9.2 juta setiap pelanggaran. Dalam pelanggaran sedemikian, jenis maklumat yang paling kerap terdedah ialah data pelanggan yang sensitif.

Syarikat farmaseutikal dan penjagaan kesihatan dikehendaki mengatur dan beroperasi mengikut panduan yang ketat sambil melindungi data pesakit. Oleh itu, sebarang pelanggaran boleh menyebabkan kos yang tinggi. Sebagai contoh, syarikat dikehendaki mengumpul, memproses dan menyimpan maklumat pengenalan diri (PII) sepanjang fasa penemuan ubat, dan apabila ujian selesai dan permohonan klinikal diserahkan, penjagaan mesti diambil untuk melindungi privasi pesakit dalam hasil yang diterbitkan.

Peraturan Agensi Ubat Eropah (EMA) No. 0070 dan peraturan "Keluaran Awam Maklumat Klinikal" yang dikeluarkan oleh Health Canada kedua-duanya mengemukakan cadangan khusus tentang penanoamaan data, dengan harapan dapat meminimumkan penggunaan keputusan untuk memulihkan pesakit maklumat identiti.

Selain menyokong privasi data, peraturan ini juga memerlukan perkongsian data percubaan, memastikan komuniti dapat membinanya. Tetapi ini sudah pasti meletakkan syarikat dalam dilema.

Jadi, bagaimanakah syarikat farmaseutikal mencapai keseimbangan antara privasi data dan ketelusan, sambil menerbitkan hasil penyelidikan dengan cara yang tepat pada masanya, kos efektif dan cekap? Fakta telah membuktikan bahawa teknologi AI boleh memikul lebih daripada 97% beban kerja dalam proses penyerahan, sekali gus mengurangkan beban operasi perusahaan.

Mengapa sukar untuk menamakan keputusan penyelidikan klinikal (CSR)?

Dalam proses melaksanakan penyerahan klinikal tanpa nama, syarikat terutamanya menghadapi tiga cabaran teras:

Data tidak berstruktur sukar diproses: Antara data percubaan klinikal, terdapat banyak Kebanyakannya adalah data tidak berstruktur. Hasil penyelidikan mengandungi sejumlah besar data teks, imej dan jadual yang diimbas, menjadikan pemprosesan tidak cekap. Laporan penyelidikan selalunya masuk ke dalam beribu-ribu halaman, dan mengenal pasti maklumat sensitif di dalamnya adalah seperti mencari jarum dalam timbunan jerami. Tambahan pula, tiada penyelesaian latihan teknikal piawai yang boleh mengautomasikan pemprosesan jenis ini.

Proses manual menyusahkan dan terdedah kepada ralat: Hari ini, syarikat farmaseutikal menggaji ratusan pekerja untuk menamakan penyerahan kajian klinikal. Seluruh pasukan perlu melalui lebih daripada 25 langkah yang kompleks dan dokumen ringkasan biasa mungkin mengambil masa sehingga 45 hari untuk diproses. Dan apabila menyemak beribu-ribu halaman bahan secara manual, proses yang membosankan sering membawa kepada ralat.

Tafsiran terbuka garis panduan kawal selia: Walaupun terdapat banyak cadangan terperinci dalam peraturan, butirannya masih tidak lengkap. Contohnya, peraturan "Keluaran Awam Maklumat Klinikal" Health Canada menghendaki risiko pemulihan maklumat identiti hendaklah kurang daripada 9%, tetapi tidak memperincikan kaedah pengiraan risiko khusus.

Di bawah, kami akan membayangkan penyelesaian khusus yang boleh mengendalikan keperluan anonimasi sedemikian dari perspektif penyelesaian masalah.

Gunakan analitis tambahan untuk mengenal pasti maklumat sensitif dalam bahasa manusia

Tiga elemen berikut membantu membina penyelesaian anonimasi dipacu teknologi:

Untuk model bahasa AI bahasa semula jadi untuk pemprosesan (NLP )

Hari ini, AI boleh mencipta seperti artis dan mendiagnosis seperti doktor. Teknologi pembelajaran mendalam telah mempromosikan banyak kemajuan dalam AI, dan model bahasa AI adalah salah satu tulang belakang. Sebagai cabang algoritma yang direka bentuk untuk memproses bahasa manusia, model bahasa AI amat baik untuk mengesan entiti yang dinamakan, seperti nama pesakit, nombor keselamatan sosial dan kod pos.

Secara tidak sedar, model AI yang berkuasa ini telah menembusi setiap sudut domain awam dan telah dilatih secara besar-besaran menggunakan dokumen awam. Sebagai tambahan kepada Wikipedia yang terkenal, pangkalan data MIMIC-III v1.4 yang mengandungi data penyahpekaan 40,000 pesakit juga telah menjadi sumber yang berharga untuk melatih model AI. Sudah tentu, untuk meningkatkan prestasi model, pakar domain juga perlu menjalankan latihan semula model seterusnya berdasarkan laporan percubaan klinikal dalaman.

Meningkatkan ketepatan melalui reka bentuk gelung manusia-mesin

Piawaian ambang risiko 9% yang dicadangkan oleh Health Canada secara kasar boleh ditukar kepada keperluan ketepatan model kira-kira 95% (biasanya menggunakan kadar ingat semula atau diukur mengikut ketepatan). Algoritma AI dapat melihat sejumlah besar data dan menjalankan berbilang kitaran latihan untuk meningkatkan ketepatannya. Walau bagaimanapun, penambahbaikan teknologi sahaja tidak mencukupi untuk menyediakannya untuk penggunaan klinikal model ini juga memerlukan bimbingan dan sokongan manusia.

Untuk menangani subjektiviti data percubaan klinikal dan meningkatkan hasil, penyelesaian analitik direka bentuk untuk berfungsi bersama manusia – ini dipanggil kecerdasan tambahan. Maksudnya, manusia dianggap sebagai sebahagian daripada gelung manusia-mesin Mereka bukan sahaja bertanggungjawab untuk pelabelan data dan latihan model, tetapi juga memberikan maklum balas tetap selepas penyelesaian itu berkesan. Dengan cara ini, ketepatan dan prestasi output model akan dipertingkatkan.

Menyelesaikan Masalah dalam Pendekatan Kolaboratif

Mari kita andaikan kajian melibatkan 1,000 pesakit, 980 daripadanya adalah dari benua Amerika Syarikat dan baki 20 dari Amerika Selatan. Jadi, adakah data 20 pesakit ini perlu disunting (digelapkan) atau dianonimkan? Adakah perlu memilih sampel pesakit dalam negara atau benua yang sama? Dalam cara apakah penyerang boleh menggabungkan maklumat tanpa nama ini dengan umur, poskod dan data lain untuk memulihkan identiti pesakit akhirnya?

Malangnya, tiada jawapan standard untuk soalan ini. Untuk mentafsir dengan lebih jelas panduan penyerahan klinikal, pengilang farmaseutikal, organisasi penyelidikan klinikal (CRO), penyedia penyelesaian teknologi dan penyelidik dari akademia perlu bergabung tenaga dan bekerjasama.

Kaedah anonimasi dipacu AI

Dengan idea asas di atas, langkah seterusnya ialah menggabungkannya menjadi satu proses penyelesaian yang lengkap. Pelbagai teknologi dalam keseluruhan penyelesaian anonim hendaklah berdasarkan kaedah sebenar yang telah kami gunakan dalam kerja kami.

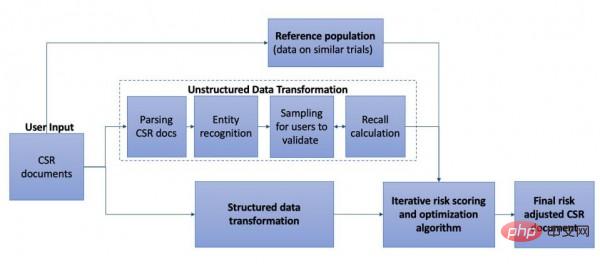

Laporan kajian klinikal mengandungi pelbagai data berstruktur (entiti nombor dan identiti, seperti maklumat demografi dan entri alamat), serta pelbagai elemen data tidak berstruktur yang kami bincangkan sebelum ini. Ini mesti dikendalikan dengan betul untuk mengelakkan penggodam berniat jahat daripada memulihkannya kepada entiti bernama sensitif. Data berstruktur agak mudah untuk diproses, tetapi algoritma AI masih perlu mengatasi kesukaran data tidak berstruktur.

Jadi, data tidak berstruktur (biasanya dalam format seperti imej yang diimbas atau PDF) mula-mula ditukar kepada bentuk yang boleh dibaca menggunakan teknologi seperti pengecaman aksara optik (OCR) atau penglihatan komputer. Selepas itu, algoritma AI digunakan pada dokumen untuk mengesan maklumat yang boleh dikenal pasti secara peribadi. Untuk meningkatkan prestasi algoritma, pengguna boleh berkongsi maklum balas tentang hasil sampel untuk membantu sistem memahami cara mengendalikan analisis keyakinan rendah ini.

Kaedah anonim dipacu AI

Selepas penanomaan selesai, risiko pemulihan identiti yang sepadan juga mesti dinilai. Kerja ini biasanya memerlukan rujukan kepada latar belakang populasi dan digabungkan dengan data daripada ujian lain yang serupa. Penilaian risiko memberi tumpuan kepada mengenal pasti tiga senario risiko utama - pendakwa, wartawan dan pemasar - melalui satu set elemen. Ketiga-tiga kumpulan ini akan cuba memulihkan maklumat pesakit berdasarkan keperluan mereka sendiri.

Sebelum tahap risiko mencapai 9% daripada pengesyoran yang ditetapkan, proses anonimasi akan terus memperkenalkan lebih banyak peraturan perniagaan dan penambahbaikan algoritma, cuba meningkatkan kecekapan dalam kitaran berulang. Kemudian dengan menyepadukan dengan aplikasi teknologi lain dan mewujudkan proses operasi pembelajaran mesin (ML Ops), keseluruhan penyelesaian anonim boleh dimasukkan ke dalam aliran kerja sebenar.

Cabaran yang lebih sukar daripada algoritma—kualiti data

Bagi syarikat farmaseutikal, penyelesaian anonimasi sedemikian boleh memendekkan kitaran penyerahan sehingga 97%. Lebih penting lagi, aliran kerja separa automatik ini meningkatkan kecekapan sambil memastikan penglibatan manusia. Tetapi apakah cabaran terbesar dalam membina penyelesaian anonimasi dikuasakan AI?

Malah, seperti kebanyakan amalan sains data, halangan terbesar kepada kerja ini bukanlah algoritma AI yang digunakan untuk mengenal pasti entiti yang dinamakan, tetapi cara menukar laporan penyelidikan kepada data berkualiti tinggi yang boleh diproses oleh AI. Untuk dokumen dengan format, gaya dan struktur yang berbeza, saluran paip pengingesan kandungan yang sepadan sering mengalami kerugian.

Oleh itu, penyelesaian anonimasi AI perlu sentiasa diperhalusi untuk menyesuaikan diri dengan format pengekodan dokumen baharu atau untuk mengesan kedudukan mula dan tamat dengan tepat dalam imbasan imej/jadual. Jelas sekali, aspek kerja ini adalah kawasan yang paling memakan masa dan memakan tenaga untuk anonimisasi AI.

Cabaran baharu tanpa nama dalam penyelidikan klinikal

Dengan kemajuan teknologi yang pesat, adakah penanoamaan penyelidikan klinikal akan menjadi lebih sukar dan lebih cekap? Walaupun penyelesaian dipacu AI sememangnya mengagumkan, akan ada cabaran baharu yang memerlukan perhatian.

Pertama, data pengguna yang dikumpul melalui media sosial, penggunaan peranti dan penjejakan dalam talian meningkatkan risiko pemulihan identiti. Penyerang boleh menggabungkan maklumat awam ini dengan data penyelidikan klinikal untuk mengenal pasti pesakit dengan tepat. Apa yang lebih membimbangkan ialah penggodam berniat jahat sangat aktif dalam menggunakan keputusan AI dan mungkin mendahului syarikat farmaseutikal.

Akhirnya, peraturan terus berkembang untuk menampung amalan khusus negara. Mungkin tidak lama lagi sesetengah negara akan mengumumkan peraturan khusus untuk pennamaan penyerahan klinikal, yang pastinya akan meningkatkan kerumitan dan beban kos bagi syarikat untuk mengekalkan pematuhan. Tetapi seperti kata pepatah, masa depan cerah tetapi jalannya berliku-liku Perkembangan teknologi AI yang matang sekurang-kurangnya membawa harapan kepada seluruh industri untuk mengatasi masalah.

Atas ialah kandungan terperinci Perlindungan Privasi: AI Menganonimkan Data Klinikal Penjagaan Kesihatan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI