Rumah >Peranti teknologi >AI >Memecahkan inovasi penyepaduan NLP dan CV: mengambil stok pembelajaran mendalam pelbagai mod dalam beberapa tahun kebelakangan ini

Memecahkan inovasi penyepaduan NLP dan CV: mengambil stok pembelajaran mendalam pelbagai mod dalam beberapa tahun kebelakangan ini

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-11 16:25:031352semak imbas

Dalam beberapa tahun kebelakangan ini, bidang NLP dan CV telah membuat penemuan berterusan dalam kaedah. Bukan sahaja model mod tunggal telah mencapai kemajuan, tetapi kaedah berbilang modal berskala besar juga telah menjadi bidang penyelidikan yang sangat popular.

- Alamat kertas: https://arxiv.org/pdf/2301.04856v1.pdf

- Alamat projek: https://github.com/slds-lmu/seminar_multimodal_dl

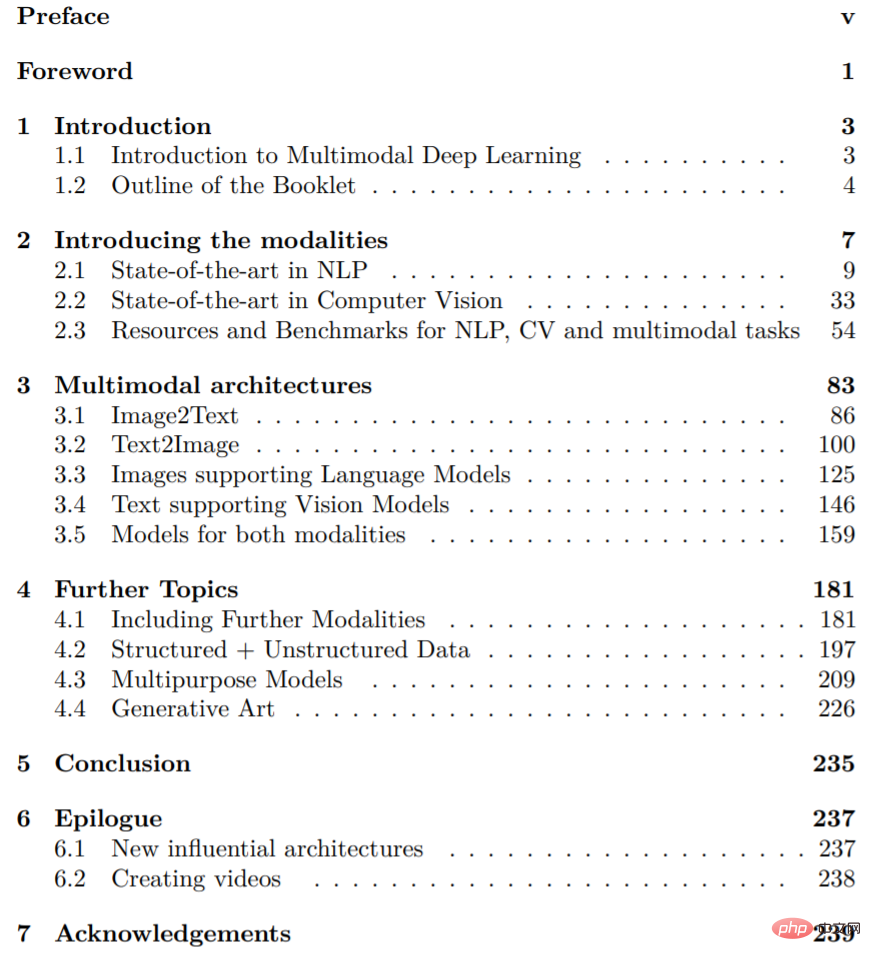

Dalam kertas kerja baru-baru ini, penyelidik Matthias Aßenmacher menyemak kaedah penyelidikan paling maju dalam dua subbidang pembelajaran mendalam dan cuba memberikan gambaran menyeluruh. Di samping itu, rangka kerja pemodelan untuk menukar satu modaliti kepada modaliti yang lain dibincangkan (Bab 3.1 dan 3.2), serta model pembelajaran perwakilan yang mengeksploitasi satu modaliti untuk meningkatkan modaliti yang lain (Bab 3.3 dan Bab 3.4). Para penyelidik menyimpulkan bahagian kedua dengan memperkenalkan seni bina yang tertumpu pada pemprosesan kedua-dua modaliti secara serentak (Bab 3.5). Akhir sekali, kertas kerja ini juga merangkumi modaliti lain (Bab 4.1 dan 4.2) serta model multimodal am (Bab 4.3) yang mampu mengendalikan tugas berbeza pada modaliti berbeza dalam seni bina bersatu. Aplikasi yang menarik ("Seni Generatif", Bab 4.4) akhirnya menjadi icing pada kek ulasan ini.

Jadual kandungan bab-bab tesis adalah seperti berikut:

Multimodaliti Pengenalan kepada Pembelajaran Mendalam

Manusia mempunyai lima deria asas: pendengaran, sentuhan, bau, rasa dan penglihatan. Melalui lima mod ini, kita melihat dan memahami dunia di sekeliling kita. "Multimodaliti" bermaksud menggunakan gabungan pelbagai saluran maklumat untuk memahami persekitaran sekeliling pada masa yang sama. Sebagai contoh, apabila kanak-kanak kecil mempelajari perkataan "kucing", mereka menyebut perkataan itu dengan kuat dengan cara yang berbeza, menunjuk ke arah kucing dan mengeluarkan bunyi seperti "meow." Penyelidik AI menggunakan proses pembelajaran manusia sebagai paradigma dan menggabungkan modaliti yang berbeza untuk melatih model pembelajaran mendalam.

Di permukaan, algoritma pembelajaran mendalam mengoptimumkan fungsi objektif yang ditentukan dengan melatih rangkaian saraf untuk mengoptimumkan fungsi kehilangan. Pengoptimuman, iaitu meminimumkan kerugian, dicapai melalui prosedur pengoptimuman berangka yang dipanggil keturunan kecerunan. Oleh itu, model pembelajaran mendalam hanya boleh memproses input berangka dan hanya boleh menghasilkan output berangka. Walau bagaimanapun, dalam tugas multimodal, kita sering menghadapi data tidak berstruktur seperti imej atau teks. Oleh itu, soalan pertama tentang tugas multimodal ialah cara mewakili input secara numerik;

Sebagai contoh, melatih model pembelajaran mendalam untuk menjana gambar kucing mungkin merupakan tugas biasa. Pertama, komputer perlu memahami input teks "kucing" dan kemudian entah bagaimana menukar maklumat tersebut kepada imej tertentu. Oleh itu, adalah perlu untuk menentukan hubungan kontekstual antara perkataan dalam teks input dan hubungan ruang antara piksel dalam imej output. Perkara yang mungkin mudah untuk kanak-kanak kecil boleh menjadi cabaran besar untuk komputer. Kedua-duanya mesti mempunyai pemahaman tertentu tentang perkataan "kucing", termasuk konotasi dan rupa haiwan itu.

Pendekatan biasa dalam bidang pembelajaran mendalam semasa ialah menjana pembenaman yang mewakili kucing secara berangka sebagai vektor dalam beberapa ruang terpendam. Untuk mencapai matlamat ini, pelbagai kaedah dan seni bina algoritma telah dibangunkan dalam beberapa tahun kebelakangan ini. Artikel ini memberikan gambaran keseluruhan tentang pelbagai kaedah yang digunakan dalam pembelajaran mendalam multimodal tercanggih (SOTA) untuk mengatasi cabaran yang ditimbulkan oleh data tidak berstruktur dan gabungan input modal yang berbeza.

Pengenalan Bab

Oleh kerana model multi-modal biasanya mengambil teks dan imej sebagai input atau output, Bab 2 memfokuskan pada pemprosesan bahasa semula jadi (NLP) dan Computer Vision (CV). ) Kaedah. Kaedah dalam bidang NLP tertumpu terutamanya pada pemprosesan data teks, manakala CV kebanyakannya berkaitan dengan pemprosesan imej.

Konsep yang sangat penting tentang NLP (bahagian 2.1) dipanggil pembenaman perkataan, yang merupakan bahagian penting dalam hampir semua seni bina pembelajaran mendalam pelbagai mod sekarang. Konsep ini juga meletakkan asas untuk model berasaskan Transformer seperti BERT, yang telah mencapai kemajuan yang ketara dalam beberapa tugas NLP. Khususnya, mekanisme perhatian kendiri Transformer telah mengubah sepenuhnya model NLP, itulah sebabnya kebanyakan model NLP menggunakan Transformer sebagai teras.

Dalam visi komputer (bahagian 2.2), penulis memperkenalkan seni bina rangkaian yang berbeza, iaitu ResNet, EfficientNet, SimCLR dan BYOL. Dalam kedua-dua bidang, adalah sangat menarik untuk membandingkan pendekatan yang berbeza dan cara mereka berprestasi pada penanda aras yang mencabar. Oleh itu, subseksyen 2.3 pada penghujung Bab 2 menyediakan gambaran keseluruhan yang komprehensif tentang set data yang berbeza, tugas pra-latihan dan penanda aras untuk CV dan NLP.

Bab 3 memfokuskan pada seni bina berbilang modal yang berbeza, meliputi pelbagai kombinasi teks dan imej Model yang dicadangkan menggabungkan dan memajukan penyelidikan kaedah NLP dan CV yang berbeza. Kami mula-mula memperkenalkan tugas Img2Text (bahagian 3.1), set data Microsoft COCO untuk pengecaman objek dan Transformer Meshed-Memory untuk menangkap imej.

Selain itu, penyelidik membangunkan kaedah untuk menjana imej berdasarkan gesaan teks pendek (bahagian 3.2). Model pertama untuk menyelesaikan tugas ini ialah Generative Adversarial Networks (GAN) dan Variational Autoencoders (VAEs). Dalam beberapa tahun kebelakangan ini, kaedah ini telah dipertingkatkan secara berterusan, dan seni bina SOTA Transformer hari ini dan model penyebaran berpandukan teks seperti DALL-E dan GLIDE telah mencapai hasil yang luar biasa. Satu lagi soalan yang menarik ialah bagaimana untuk memanfaatkan imej untuk menyokong model bahasa (Bahagian 3.3). Ini boleh dicapai melalui pembenaman berurutan, pembenaman sebenar yang lebih maju, atau terus di dalam Transformer.

Juga lihat pada model CV yang didayakan teks seperti CLIP, ALIGN dan Florence (bahagian 3.4). Penggunaan model asas membayangkan penggunaan semula model (cth. CLIP dalam DALL-E 2), serta kehilangan kontrastif teks kepada sambungan imej. Selain itu, tangkapan sifar menjadikan pengelasan data baharu dan tidak kelihatan menjadi mudah dengan penalaan halus. Khususnya, CLIP, seni bina sumber terbuka untuk klasifikasi dan penjanaan imej, menarik banyak perhatian tahun lepas. Beberapa seni bina lain untuk memproses teks dan imej secara serentak diperkenalkan pada penghujung Bab 3 (Bahagian 3.5).

Sebagai contoh, Data2Sec menggunakan kaedah pembelajaran yang sama untuk memproses pertuturan, penglihatan dan bahasa serta cuba mencari kaedah umum untuk mengendalikan modaliti yang berbeza dalam satu seni bina. Tambahan pula, VilBert memperluaskan seni bina BERT yang popular untuk mengendalikan input imej dan teks dengan melaksanakan perhatian bersama. Pendekatan ini juga digunakan dalam Deepmind Flamingo Google. Tambahan pula, Flamingo berhasrat untuk mengendalikan pelbagai tugas dengan model bahasa visual tunggal melalui pembelajaran beberapa pukulan dan pembekuan model penglihatan dan bahasa yang telah dilatih.

Bab terakhir (Bab 4) memperkenalkan kaedah yang boleh mengendalikan modaliti selain daripada teks dan imej, seperti video, pertuturan atau data jadual. Matlamat keseluruhan adalah untuk meneroka seni bina multimodal universal yang bukan modal demi modaliti, tetapi untuk menangani cabaran dengan mudah. Oleh itu, ia juga perlu untuk menangani masalah gabungan dan penjajaran pelbagai mod, dan memutuskan sama ada untuk menggunakan perwakilan bersama atau diselaraskan (bahagian 4.1). Tambahan pula, gabungan tepat data berstruktur dan tidak berstruktur akan diterangkan dengan lebih terperinci (bahagian 4.2).

Pengarang juga mencadangkan strategi penyepaduan berbeza yang telah dibentuk sejak beberapa tahun kebelakangan ini, yang mana artikel ini menggambarkan melalui dua kes penggunaan dalam analisis kelangsungan hidup dan ekonomi. Selain daripada ini, satu lagi persoalan kajian yang menarik ialah cara mengendalikan tugasan yang berbeza dalam apa yang dipanggil model pelbagai guna (bahagian 4.3), seperti yang dibuat oleh penyelidik Google dalam model "Pathway" mereka. Akhir sekali, artikel itu akan menunjukkan aplikasi tipikal pembelajaran mendalam pelbagai mod dalam persada seni, menggunakan model penjanaan imej seperti DALL-E untuk mencipta karya seni dalam bidang seni generatif (bahagian 4.4).

Untuk maklumat lanjut, sila rujuk kertas asal.

Atas ialah kandungan terperinci Memecahkan inovasi penyepaduan NLP dan CV: mengambil stok pembelajaran mendalam pelbagai mod dalam beberapa tahun kebelakangan ini. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI