Rumah >Peranti teknologi >AI >Adakah masyarakat kita bersedia untuk membiarkan AI membuat keputusan?

Adakah masyarakat kita bersedia untuk membiarkan AI membuat keputusan?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-09 20:41:161290semak imbas

Dengan perkembangan teknologi yang dipercepatkan, kecerdasan buatan (AI) memainkan peranan yang semakin penting dalam proses membuat keputusan. Manusia semakin bergantung pada algoritma untuk memproses maklumat, mengesyorkan tindakan tertentu, dan juga mengambil tindakan bagi pihak mereka.

Tetapi jika AI benar-benar membantu atau membuat keputusan untuk kita, terutamanya yang melibatkan keputusan subjektif, moral dan etika, adakah anda akan menerimanya?

Baru-baru ini, pasukan penyelidik dari Universiti Hiroshima meneroka reaksi manusia terhadap pengenalan pembuatan keputusan kecerdasan buatan. Khususnya, dengan mengkaji interaksi manusia dengan kereta pandu sendiri, mereka meneroka soalan: "Adakah masyarakat bersedia untuk membuat keputusan beretika AI?" Pasukan itu menerbitkan penemuan mereka dalam Journal of Behavioral and Experimental Economics pada 6 Mei 2022.

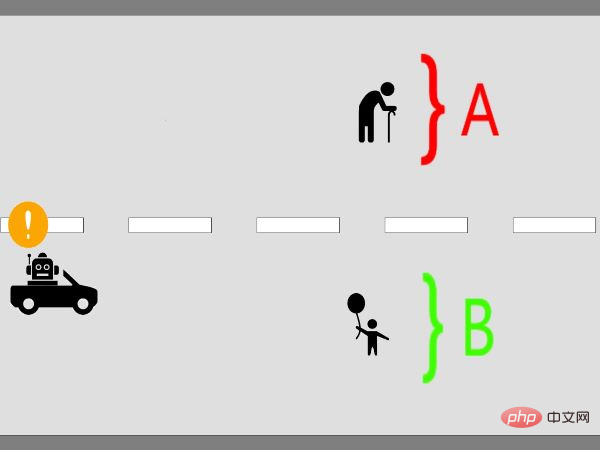

Dalam percubaan pertama, penyelidik membentangkan 529 subjek manusia dengan dilema etika yang mungkin dihadapi oleh pemandu. Dalam senario yang dicipta oleh penyelidik, seorang pemandu kereta terpaksa memutuskan sama ada untuk merempuh keretanya ke dalam satu kumpulan orang atau yang lain, dan perlanggaran tidak dapat dielakkan. Maksudnya, kemalangan akan menyebabkan kemudaratan yang serius kepada satu kumpulan manusia, tetapi menyelamatkan nyawa kumpulan orang yang lain.

Dalam eksperimen kedua mereka, 563 subjek manusia menjawab beberapa soalan penting yang dikemukakan oleh penyelidik untuk menentukan persepsi orang tentang Bagaimana AI akan bertindak balas terhadap tiruan kecerdasan membuat keputusan beretika selepas ia menjadi sebahagian daripada masyarakat?

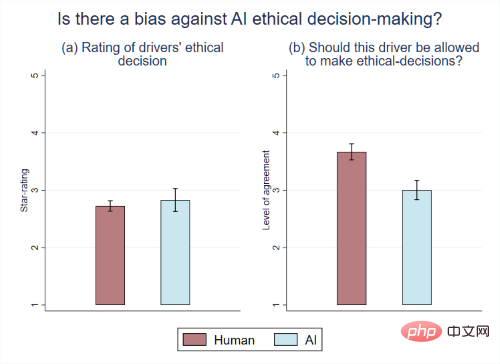

Para penyelidik percaya bahawa perbezaan antara kedua-dua keputusan adalah disebabkan oleh gabungan dua faktor.

Grafik Secara purata, orang menilai keputusan moral pemandu AI tidak berbeza dengan pemandu manusia. Walau bagaimanapun, orang ramai tidak mahu AI membuat keputusan beretika di jalan raya

Para penyelidik percaya bahawa penolakan teknologi baharu ini disebabkan terutamanya oleh kepercayaan peribadi tentang pendapat masyarakat dan berkemungkinan terpakai pada mesin dan robot lain. "Oleh itu adalah penting untuk menentukan bagaimana pilihan individu digabungkan menjadi keutamaan sosial. Tambahan pula, seperti yang ditunjukkan oleh hasil kami, kesimpulan sedemikian mesti juga berbeza di seluruh negara," kata Kaneko.

Atas ialah kandungan terperinci Adakah masyarakat kita bersedia untuk membiarkan AI membuat keputusan?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI