Rumah >Peranti teknologi >AI >Penyelidikan menunjukkan model pembelajaran pengukuhan terdedah kepada serangan inferens keahlian

Penyelidikan menunjukkan model pembelajaran pengukuhan terdedah kepada serangan inferens keahlian

- PHPzke hadapan

- 2023-04-09 20:01:011475semak imbas

Penterjemah |. Li Rui

Pengulas |. cara mengenal pasti dan menangani ancaman keselamatan dan privasi kepada model pembelajaran mesin.

Walau bagaimanapun, ancaman keselamatan yang dihadapi oleh paradigma pembelajaran mesin berbeza berbeza-beza dan beberapa bidang keselamatan pembelajaran mesin masih kurang diselidiki. Khususnya, keselamatan algoritma pembelajaran pengukuhan tidak mendapat banyak perhatian dalam beberapa tahun kebelakangan ini.

Walau bagaimanapun, ancaman keselamatan yang dihadapi oleh paradigma pembelajaran mesin berbeza berbeza-beza dan beberapa bidang keselamatan pembelajaran mesin masih kurang diselidiki. Khususnya, keselamatan algoritma pembelajaran pengukuhan tidak mendapat banyak perhatian dalam beberapa tahun kebelakangan ini.

Penyelidik di Universiti McGill, Makmal Pembelajaran Mesin (MILA) dan Universiti Waterloo di Kanada telah menjalankan kajian baharu yang memfokuskan pada ancaman privasi algoritma pembelajaran pengukuhan mendalam. Penyelidik mencadangkan rangka kerja untuk menguji kelemahan model pembelajaran pengukuhan kepada serangan inferens keahlian.

Hasil penyelidikan menunjukkan bahawa penyerang boleh menyerang sistem pembelajaran tetulang mendalam (RL) dengan berkesan dan mungkin memperoleh maklumat sensitif yang digunakan untuk melatih model. Penemuan mereka adalah penting kerana teknik pembelajaran pengukuhan kini memasuki aplikasi industri dan pengguna.

Serangan Inferens Keahlian

Serangan Inferens Keahlian memerhati tingkah laku model pembelajaran mesin sasaran dan meramalkan contoh yang digunakan untuk melatihnya .

Serangan Inferens Keahlian memerhati tingkah laku model pembelajaran mesin sasaran dan meramalkan contoh yang digunakan untuk melatihnya .

Setiap model pembelajaran mesin dilatih pada set contoh. Dalam sesetengah kes, contoh latihan termasuk maklumat sensitif, seperti data kesihatan atau kewangan atau maklumat lain yang boleh dikenal pasti secara peribadi.

Serangan inferens keahlian ialah satu siri teknik yang cuba memaksa model pembelajaran mesin membocorkan data set latihannya. Walaupun contoh musuh (jenis serangan yang lebih terkenal terhadap pembelajaran mesin) memfokuskan pada mengubah tingkah laku model pembelajaran mesin dan dianggap sebagai ancaman keselamatan, serangan inferens keahlian menumpukan pada mengekstrak maklumat daripada model dan lebih merupakan ancaman privasi .

Serangan inferens keahlian telah dikaji dengan baik dalam algoritma pembelajaran mesin yang diselia, di mana model dilatih pada contoh berlabel.

Tidak seperti pembelajaran diselia, sistem pembelajaran peneguhan mendalam tidak menggunakan contoh berlabel. Ejen pembelajaran pengukuhan (RL) menerima ganjaran atau penalti daripada interaksinya dengan persekitaran. Ia secara beransur-ansur mempelajari dan mengembangkan tingkah lakunya melalui interaksi dan isyarat pengukuhan ini.

Dalam ulasan bertulis, pengarang kertas itu berkata, "Ganjaran dalam pembelajaran pengukuhan tidak semestinya mewakili label; oleh itu, ia tidak boleh berfungsi sebagai ramalan yang sering digunakan dalam reka bentuk serangan inferens keahlian dalam yang lain. tag paradigma pembelajaran."

Pada masa ini tiada kajian tentang potensi kebocoran data yang digunakan secara langsung untuk melatih agen pembelajaran pengukuhan mendalam," tulis para penyelidik dalam kertas kerja mereka 🎜>

Sebahagian daripada sebab kekurangan penyelidikan ini ialah pembelajaran pengukuhan mempunyai aplikasi dunia nyata yang terhad.Pengarang kertas penyelidikan berkata, “Walaupun terdapat kemajuan yang ketara dalam bidang pembelajaran peneguhan mendalam, seperti Alpha Go, Alpha Fold, dan GT Sophy, model pembelajaran peneguhan mendalam masih tidak tersedia pada skala industri Sebaliknya, privasi data adalah bidang penyelidikan yang digunakan secara meluas, dan kekurangan model pembelajaran pengukuhan yang mendalam dalam aplikasi industri praktikal telah melambatkan penyelidikan bidang penyelidikan asas dan penting ini, yang membawa kepada kekurangan. penyelidikan mengenai sistem pembelajaran pengukuhan kurang diteliti ”

Dengan keperluan yang semakin meningkat untuk menggunakan algoritma pembelajaran pengukuhan pada skala industri dalam senario dunia sebenar, terdapat keperluan untuk menangani aspek privasi algoritma pembelajaran pengukuhan dari perspektif pertentangan dan algoritma Tumpuan dan keperluan ketat rangka kerja menjadi semakin jelas dan relevan.

Cabaran Inferens Keahlian dalam Pembelajaran Peneguhan Dalam

Pengarang kertas penyelidikan berkata, “Kami sedang membangunkan generasi pertama pemeliharaan privasi Usaha kami dalam algoritma pembelajaran pengukuhan mendalam telah menyedarkan kami bahawa terdapat perbezaan struktur asas antara algoritma pembelajaran mesin tradisional dan algoritma pembelajaran pengukuhan dari perspektif privasi."

Secara lebih kritikal, penyelidik mendapati bahawa, secara lebih kritikal, perbezaan asas antara pembelajaran peneguhan mendalam dan paradigma pembelajaran lain menimbulkan cabaran yang serius dalam menggunakan model pembelajaran peneguhan mendalam untuk aplikasi praktikal, memandangkan akibat privasi yang berpotensi.

Mereka berkata, “Berdasarkan kesedaran ini, persoalan besar bagi kami ialah: Sejauh manakah algoritma pembelajaran pengukuhan mendalam terhadap serangan privasi seperti serangan inferens keahlian Kini Beberapa serangan serangan inferens ahli? model direka khusus untuk paradigma pembelajaran lain, jadi kelemahan algoritma pembelajaran peneguhan mendalam terhadap jenis serangan ini sebahagian besarnya tidak diketahui, memandangkan implikasi serius terhadap privasi apabila digunakan di seluruh dunia penyelidikan dan industri adalah motivasi utama untuk kajian ini ”

Semasa proses latihan, model pembelajaran pengukuhan telah melalui beberapa peringkat, setiap satu terdiri daripada trajektori atau urutan tindakan dan negeri. Oleh itu, algoritma serangan inferens keahlian yang berjaya untuk pembelajaran pengukuhan mesti mempelajari titik data dan trajektori yang digunakan untuk melatih model. Di satu pihak, ini menjadikannya lebih sukar untuk mereka bentuk algoritma inferens keahlian untuk sistem pembelajaran pengukuhan, sebaliknya, ia juga menyukarkan untuk menilai keteguhan model pembelajaran pengukuhan terhadap serangan tersebut.

Pengarang berkata, “Berbanding dengan jenis pembelajaran mesin yang lain, serangan inferens keahlian (MIA) sukar dalam pembelajaran pengukuhan kerana titik data yang digunakan semasa latihan mempunyai sifat berurutan dan bergantung pada masa. . Hubungan banyak-ke-banyak antara latihan dan titik data ramalan pada asasnya berbeza daripada paradigma pembelajaran yang lain ” Perbezaan ini menjadikannya penting untuk berfikir dengan cara baharu apabila mereka bentuk dan menilai serangan inferens keahlian untuk pembelajaran pengukuhan yang mendalam.

Merancang serangan inferens keahlian terhadap sistem pembelajaran pengukuhan

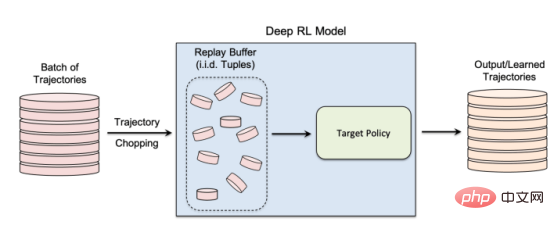

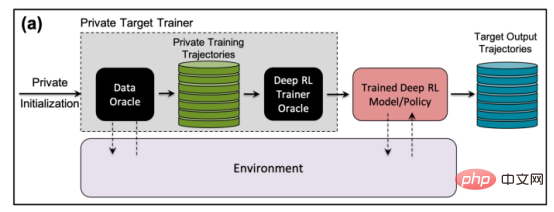

Dalam kajian mereka, penyelidik menumpukan pada algoritma pembelajaran pengukuhan bukan dasar, di mana pengumpulan data dan proses latihan model adalah berasingan. Pembelajaran pengukuhan menggunakan "penampan main semula" untuk menghiasi hubungan trajektori input dan membolehkan ejen pembelajaran pengukuhan meneroka banyak trajektori berbeza daripada set data yang sama.Pembelajaran peneguhan bukan dasar adalah penting terutamanya untuk banyak aplikasi dunia sebenar yang mana data latihan sedia ada dan disediakan kepada pasukan pembelajaran mesin yang melatih model pembelajaran pengukuhan. Pembelajaran pengukuhan bukan dasar juga penting untuk mencipta model serangan inferens keahlian.

Pembelajaran peneguhan bukan dasar menggunakan "penampan ulangan" untuk menggunakan semula data yang dikumpul sebelum ini semasa latihan model

Pengarang berkata, “Fasa penerokaan dan eksploitasi dipisahkan dalam model pembelajaran peneguhan bukan dasar yang sebenar Oleh itu, dasar sasaran tidak menjejaskan trajektori latihan ini amat sesuai apabila mereka bentuk rangka kerja serangan inferens dalam a persekitaran kotak hitam , kerana penyerang tidak mengetahui struktur dalaman model sasaran mahupun strategi penerokaan yang digunakan untuk mengumpul trajektori latihan. penyerang hanya boleh memerhati tingkah laku model pembelajaran pengukuhan terlatih. Dalam kes khusus ini, penyerang menganggap bahawa model sasaran telah dilatih mengenai trajektori yang dijana daripada set data peribadi, iaitu cara pembelajaran pengukuhan bukan dasar berfungsi.

Dalam kajian itu, penyelidik memilih "pembelajaran mendalam Q dalam kekangan kelompok" (BCQ), algoritma pembelajaran peneguhan bukan dasar lanjutan, menunjukkan prestasi cemerlang dalam tugas kawalan. Walau bagaimanapun, mereka menunjukkan bahawa teknik serangan inferens keahlian mereka boleh diperluaskan kepada model pembelajaran pengukuhan bukan dasar yang lain.

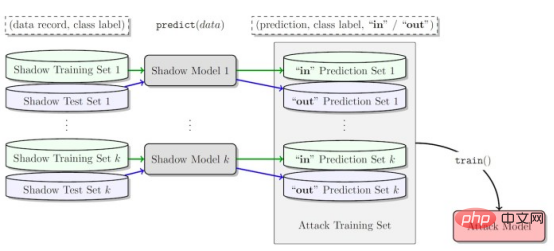

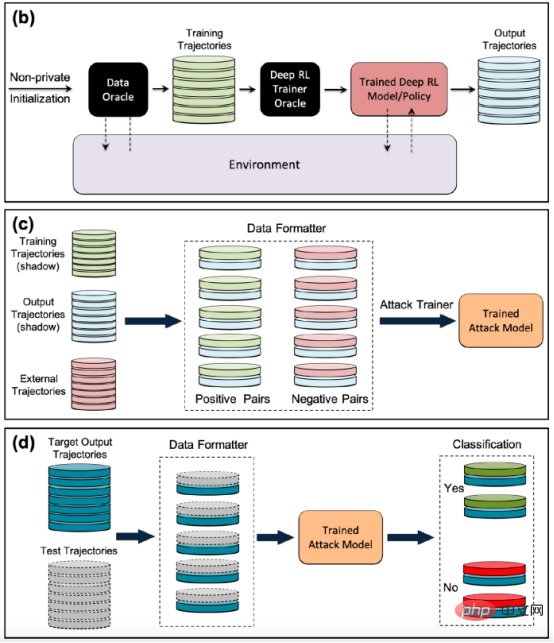

Salah satu cara penyerang boleh melakukan serangan inferens keahlian ialah dengan membangunkan "model bayangan". Ini ialah model pembelajaran mesin pengelas yang telah dilatih pada campuran data daripada pengedaran yang sama seperti data latihan model sasaran dan tempat lain. Selepas latihan, model bayangan boleh membezakan antara titik data yang dimiliki oleh set latihan model pembelajaran mesin sasaran dan data baharu yang model tidak pernah dilihat sebelum ini. Mencipta model bayangan untuk ejen pembelajaran pengukuhan adalah rumit kerana sifat berurutan latihan model sasaran. Para penyelidik mencapai ini melalui beberapa langkah.

Pertama, mereka memberi jurulatih model pembelajaran pengukuhan satu set trajektori data bukan persendirian baharu dan memerhati trajektori yang dijana oleh model sasaran. Jurulatih serangan kemudian menggunakan trajektori latihan dan output untuk melatih pengelas pembelajaran mesin untuk mengesan trajektori input yang digunakan dalam melatih model pembelajaran pengukuhan sasaran. Akhir sekali, pengelas disediakan dengan trajektori baharu untuk dikelaskan sebagai ahli latihan atau contoh data baharu.

Model bayangan untuk melatih serangan inferens ahli pada model pembelajaran pengukuhan

Menguji serangan inferens ahli terhadap sistem pembelajaran pengukuhan

Para penyelidik menguji serangan inferens keahlian mereka dalam mod berbeza, termasuk panjang trajektori yang berbeza, trajektori tunggal lwn berbilang dan trajektori berkorelasi lwn berhias.

Para penyelidik menyatakan dalam kertas kerja mereka: "Keputusan menunjukkan bahawa rangka kerja serangan yang dicadangkan kami sangat berkesan dalam membuat kesimpulan titik data latihan model pembelajaran pengukuhan... Keputusan yang diperoleh menunjukkan bahawa menggunakan Terdapat risiko privasi yang tinggi apabila menggunakan pembelajaran pengukuhan mendalam ”

Keputusan mereka menunjukkan bahawa serangan dengan berbilang trajektori adalah lebih berkesan daripada serangan dengan satu trajektori, dan apabila trajektori semakin panjang antara satu sama lain, ketepatan serangan juga akan meningkat.

Pengarang berkata, “Tetapan semula jadi sudah tentu model individu, dan penyerang berminat untuk mengenal pasti kehadiran individu tertentu dalam set latihan yang digunakan untuk melatih peneguhan sasaran dasar pembelajaran (dalam peneguhan mempelajari keseluruhan trajektori tetapan, bagaimanapun, prestasi Serangan Inferens Keahlian (MIA) yang lebih baik dalam mod kolektif menunjukkan bahawa sebagai tambahan kepada korelasi temporal yang ditangkap oleh ciri dasar latihan, penyerang juga boleh mengeksploitasi korelasi silang antara trajektori latihan dasar sasaran "

Para penyelidik berkata bahawa ini juga bermakna penyerang memerlukan seni bina pembelajaran yang lebih kompleks dan penalaan hiperparameter yang lebih kompleks untuk mengeksploitasi korelasi silang antara trajektori latihan dan korelasi masa trajektori dalam.

Para penyelidik berkata, "Memahami mod serangan yang berbeza ini boleh memberikan kita pemahaman yang lebih mendalam tentang kesan terhadap keselamatan dan privasi data kerana ia boleh memberi kita pemahaman yang lebih baik tentang perkara yang mungkin berlaku. Sudut serangan yang berbeza dan tahap kesan terhadap kebocoran privasi ”

Serangan inferens ahli dunia sebenar terhadap sistem pembelajaran pengukuhan

Para penyelidik menguji serangan mereka terhadap model pembelajaran pengukuhan yang dilatih mengenai tiga tugas berdasarkan enjin fizik Open AIGym dan MuJoCo.

Para penyelidik berkata, “Eksperimen semasa kami meliputi tiga tugas gerakan dimensi tinggi, Hopper, Half-Cheetah dan Ant Tugasan ini adalah semua tugas simulasi robot dan terutamanya mempromosikan percubaan kepada tugas pembelajaran robot dunia sebenar ”

Satu lagi hala tuju menarik untuk serangan inferens ahli aplikasi ialah sistem perbualan, seperti Amazon Alexa, Apple, Siri dan Google Assistant. Dalam aplikasi ini, titik data dibentangkan oleh jejak interaksi lengkap antara chatbot dan pengguna akhir. Dalam tetapan ini, chatbot ialah dasar pembelajaran pengukuhan terlatih dan interaksi pengguna dengan robot membentuk trajektori input.

Pengarang berkata, “Dalam kes ini, corak kolektif ialah persekitaran semula jadi, jika dan hanya jika penyerang membuat kesimpulan dengan betul sekumpulan trajektori yang mewakili pengguna dalam. set latihan , penyerang boleh menyimpulkan kehadiran pengguna dalam set latihan.”

Pasukan sedang meneroka aplikasi praktikal lain di mana jenis serangan ini boleh memberi kesan kepada sistem pembelajaran pengukuhan. Mereka juga mungkin mengkaji cara serangan ini boleh digunakan untuk pembelajaran pengukuhan dalam konteks lain.

Pengarang berkata, "Satu lanjutan yang menarik dalam bidang penyelidikan ini adalah untuk mengkaji serangan inferens ahli terhadap model pembelajaran pengukuhan mendalam dalam persekitaran kotak putih, di mana struktur dalaman dasar sasaran adalah juga penyerang ”

Para penyelidik berharap kajian mereka akan memberi penerangan tentang isu keselamatan dan privasi dalam aplikasi pembelajaran pengukuhan dunia sebenar dan meningkatkan kesedaran di kalangan komuniti pembelajaran mesin untuk bekerja di lapangan .

Tajuk asal: Model pembelajaran pengukuhan terdedah kepada serangan inferens keahlian, pengarang: Ben Dickson

Atas ialah kandungan terperinci Penyelidikan menunjukkan model pembelajaran pengukuhan terdedah kepada serangan inferens keahlian. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI