Rumah >Peranti teknologi >AI >Stanford/Google Brain: Penyulingan berganda, persampelan model resapan berpandu mempercepatkan 256 kali ganda!

Stanford/Google Brain: Penyulingan berganda, persampelan model resapan berpandu mempercepatkan 256 kali ganda!

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBke hadapan

- 2023-04-09 18:51:011722semak imbas

Baru-baru ini, model resapan berpandu tanpa pengelas sangat berkesan dalam penjanaan imej resolusi tinggi dan telah digunakan secara meluas dalam rangka kerja resapan berskala besar, termasuk DALL-E 2, GLIDE dan Imagen.

Walau bagaimanapun, kelemahan model resapan berpandu tanpa pengelas ialah harganya mahal secara pengiraan pada masa inferens. Kerana mereka memerlukan penilaian dua model resapan—model bersyarat kelas dan model tanpa syarat—beratus kali.

Untuk menyelesaikan masalah ini, sarjana dari Stanford University dan Google Brain mencadangkan untuk menggunakan kaedah penyulingan dua langkah untuk meningkatkan kecekapan pensampelan model resapan berpandu tanpa pengelas.

Alamat kertas: https://arxiv.org/abs/2210.03142

Bagaimana untuk memperhalusi model resapan berpandu tanpa pengelas kepada model pensampelan pantas?

Pertama, untuk model bimbingan tanpa pengelas yang telah terlatih, para penyelidik mula-mula mempelajari model tunggal untuk memadankan output gabungan model bersyarat dan model tanpa syarat.

Para penyelidik kemudiannya secara beransur-ansur menyuling model ini menjadi model resapan dengan langkah pensampelan yang lebih sedikit.

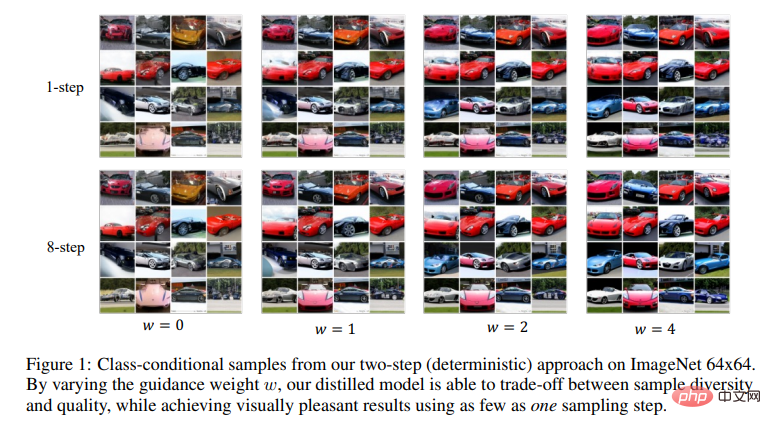

Dapat dilihat pada ImageNet 64x64 dan CIFAR-10, kaedah ini mampu menghasilkan imej yang setanding secara visual dengan model asal.

Dengan hanya 4 langkah pensampelan, skor FID/IS yang setanding dengan model asal boleh diperolehi, manakala kelajuan pensampelan adalah setinggi 256 kali.

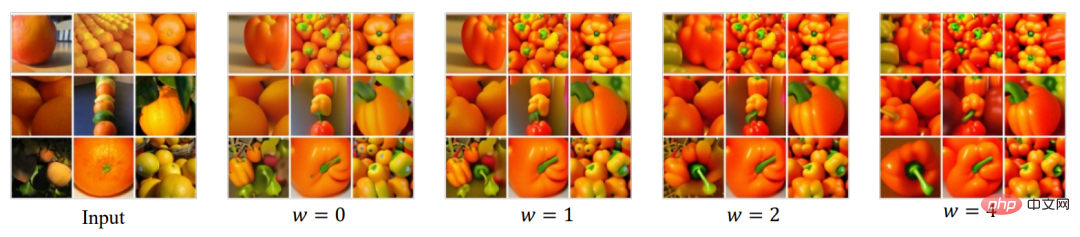

Dapat dilihat bahawa dengan menukar berat panduan w, model yang disuling oleh penyelidik boleh membuat pertukaran antara kepelbagaian sampel dan kualiti . Dan dengan hanya satu langkah persampelan, hasil yang menyenangkan secara visual dicapai.

Latar Belakang Model Resapan

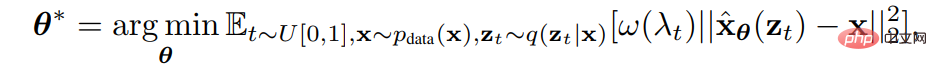

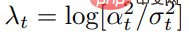

Dengan sampel x daripada pengedaran data  , fungsi penjadualan hingar

, fungsi penjadualan hingar  telah dilatih dengan meminimumkan ralat min kuasa dua wajaran dengan parameter θ Model resapan

telah dilatih dengan meminimumkan ralat min kuasa dua wajaran dengan parameter θ Model resapan  .

.

di mana  ialah nisbah isyarat kepada hingar,

ialah nisbah isyarat kepada hingar,  dan

dan  ialah fungsi pemberat yang telah ditetapkan.

ialah fungsi pemberat yang telah ditetapkan.

Setelah model resapan  dilatih, anda boleh menggunakan pensampel DDIM masa diskret untuk mengambil sampel daripada model.

dilatih, anda boleh menggunakan pensampel DDIM masa diskret untuk mengambil sampel daripada model.

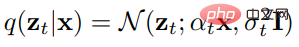

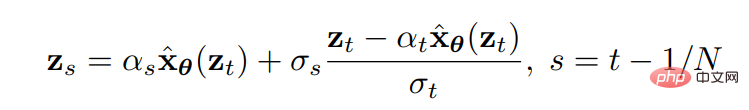

Khususnya, pensampel DDIM bermula dari z1 ∼ N (0,I) dan dikemas kini seperti berikut

Di mana, N ialah jumlah bilangan langkah pensampelan. Menggunakan  akan menjana sampel akhir.

akan menjana sampel akhir.

Panduan tanpa pengelas ialah kaedah berkesan yang boleh meningkatkan kualiti sampel model resapan bersyarat dengan ketara dan telah digunakan secara meluas termasuk GLIDE, DALL·E 2 dan Imagen.

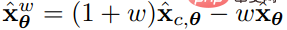

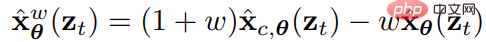

Ia memperkenalkan parameter berat panduan  untuk mengukur kualiti dan kepelbagaian sampel. Untuk menjana sampel, panduan tanpa pengelas menggunakan

untuk mengukur kualiti dan kepelbagaian sampel. Untuk menjana sampel, panduan tanpa pengelas menggunakan  sebagai model ramalan pada setiap langkah kemas kini untuk menilai model resapan bersyarat

sebagai model ramalan pada setiap langkah kemas kini untuk menilai model resapan bersyarat  dan

dan  .

.

Pensampelan menggunakan panduan tanpa pengelas selalunya mahal kerana dua model resapan perlu dinilai untuk setiap kemas kini pensampelan.

Untuk menyelesaikan masalah ini, penyelidik menggunakan penyulingan progresif, iaitu kaedah untuk meningkatkan kelajuan pensampelan model resapan melalui penyulingan berulang.

Sebelum ini, kaedah ini tidak boleh digunakan secara langsung untuk penyulingan model berpandu, dan juga tidak boleh digunakan pada pensampel selain daripada pensampel DDIM yang menentukan. Dalam makalah ini, penyelidik menyelesaikan masalah ini.

Penyulingan model resapan berpandu tanpa pengelasPendekatan mereka adalah untuk menyaring model resapan berpandu tanpa pengelas.

Untuk model yang diketuai guru terlatih  , mereka mengambil dua langkah.

, mereka mengambil dua langkah.

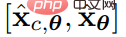

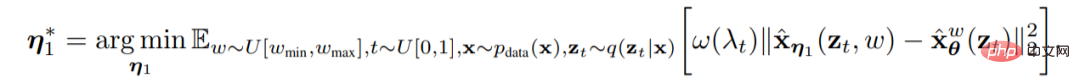

Dalam langkah pertama , penyelidik memperkenalkan model pelajar masa berterusan  , yang mempunyai parameter boleh dipelajari η1, untuk dipadankan output model guru pada bila-bila masa langkah t ∈ [0, 1]. Selepas menyatakan julat intensiti arahan

, yang mempunyai parameter boleh dipelajari η1, untuk dipadankan output model guru pada bila-bila masa langkah t ∈ [0, 1]. Selepas menyatakan julat intensiti arahan  yang mereka minati, mereka menggunakan objektif berikut untuk mengoptimumkan model pelajar.

yang mereka minati, mereka menggunakan objektif berikut untuk mengoptimumkan model pelajar.

di mana  .

.

Untuk menggabungkan pemberat bimbingan w, pengkaji memperkenalkan model bersyarat w, di mana w berfungsi sebagai input model pelajar. Untuk menangkap ciri dengan lebih baik, mereka menggunakan Fourier embedding w dan kemudian memasukkannya ke dalam tulang belakang model resapan menggunakan kaedah langkah masa yang digunakan oleh Kingma et al.

Memandangkan pemulaan memainkan peranan penting dalam prestasi, apabila penyelidik memulakan model pelajar, mereka menggunakan parameter yang sama seperti model bersyarat guru (kecuali untuk parameter yang baru diperkenalkan berkaitan dengan penyaman w).

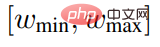

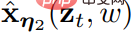

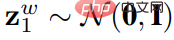

Dalam langkah kedua, penyelidik membayangkan senario langkah masa diskret, dan dengan mengurangkan separuh bilangan langkah pensampelan setiap kali, secara beransur-ansur menukar model pembelajaran daripada The langkah pertama  disuling menjadi model pembelajaran

disuling menjadi model pembelajaran  dengan parameter boleh dipelajari η2 dan langkah yang lebih sedikit.

dengan parameter boleh dipelajari η2 dan langkah yang lebih sedikit.

dengan N mewakili bilangan langkah pensampelan Untuk  dan

dan  , penyelidik mula melatih model pelajar. Biarkan ia sepadan dengan output pensampelan DDIM dua langkah model guru dengan satu langkah (cth: dari t/N ke t - 0.5/N, dari t - 0.5/N ke t - 1/N).

, penyelidik mula melatih model pelajar. Biarkan ia sepadan dengan output pensampelan DDIM dua langkah model guru dengan satu langkah (cth: dari t/N ke t - 0.5/N, dari t - 0.5/N ke t - 1/N).

Selepas menyaring langkah 2N dalam model guru menjadi N langkah dalam model pelajar, kita boleh menggunakan model pelajar langkah N baharu sebagai model guru baharu, dan kemudian ulangi perkara yang sama Proses penyulingan model guru kepada model pelajar N/2 langkah. Pada setiap langkah, penyelidik memulakan model kimia menggunakan parameter model guru.

Persampelan deterministik dan rawak bagi N-step

⼀Model berganda dilatih, untuk

dilatih, untuk  , penyelidik boleh melakukan pensampelan melalui peraturan kemas kini DDIM. Para penyelidik mendapati bahawa untuk model penyulingan

, penyelidik boleh melakukan pensampelan melalui peraturan kemas kini DDIM. Para penyelidik mendapati bahawa untuk model penyulingan  , proses pensampelan ini bersifat deterministik memandangkan permulaan

, proses pensampelan ini bersifat deterministik memandangkan permulaan  .

.

Selain itu, penyelidik juga boleh menjalankan persampelan rawak N-step. Gunakan langkah pensampelan deterministik dua kali ganda saiz langkah asal (iaitu, sama dengan pensampel penentu N/2 langkah), dan kemudian ambil langkah rawak ke belakang (iaitu, mengganggunya dengan bunyi) menggunakan saiz langkah asal.

, apabila t > 1/N, peraturan kemas kini berikut boleh digunakan -

, apabila t > 1/N, peraturan kemas kini berikut boleh digunakan -

Antaranya,  .

.

Apabila t=1/N, penyelidik menggunakan formula kemas kini deterministik untuk memperoleh  daripada

daripada  .

.

Perlu diambil perhatian bahawa melaksanakan pensampelan stokastik memerlukan penilaian model pada langkah masa yang sedikit berbeza berbanding pensampel deterministik, dan memerlukan perakaunan untuk kes tepi Pengubahsuaian kecil pada algoritma latihan.

Kaedah penyulingan lain

Terdapat juga kaedah yang secara langsung menggunakan penyulingan progresif pada model bootstrap, Iaitu , mengikut struktur model guru, model pelajar disuling terus menjadi model bersyarat dan tidak bersyarat yang dilatih bersama. Selepas penyelidik mencuba, mereka mendapati kaedah ini tidak berkesan.

Eksperimen dan Kesimpulan

Eksperimen model telah dijalankan pada dua set data standard: ImageNet (64*64) dan CIFAR 10.

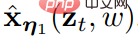

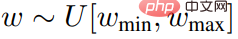

Julat berbeza berat bimbingan w telah diterokai dalam eksperimen, dan diperhatikan bahawa semua julat adalah setanding, jadi [wmin, wmax] = [0, 4] telah digunakan untuk eksperimen itu. Model langkah pertama dan kedua dilatih menggunakan kehilangan isyarat kepada hingar.

Piawaian asas termasuk pensampelan nenek moyang DDPM dan pensampelan DDIM.

Untuk lebih memahami cara menggabungkan berat bimbingan w, model yang dilatih dengan nilai w tetap digunakan sebagai rujukan.

Untuk perbandingan yang saksama, percubaan menggunakan model guru pra-latihan yang sama untuk semua kaedah. Menggunakan seni bina U-Net (Ronneberger et al., 2015) sebagai garis dasar, dan menggunakan tulang belakang U-Net yang sama, struktur dengan w tertanam di dalamnya diperkenalkan sebagai model pelajar dua langkah.

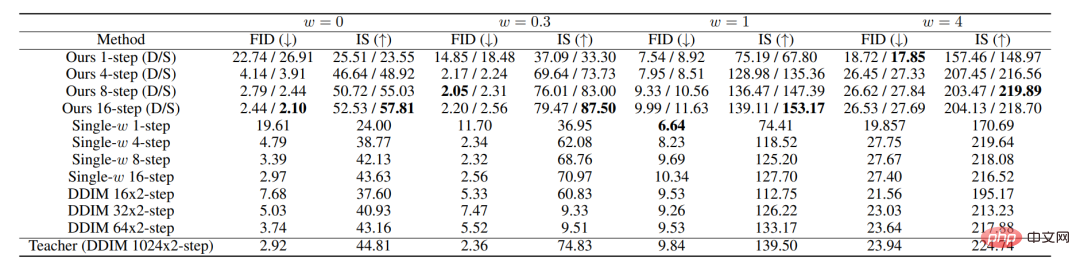

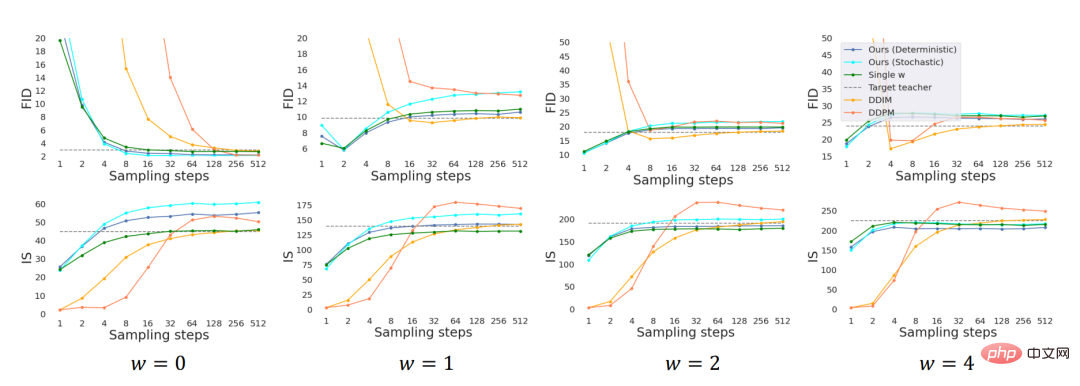

Gambar di atas menunjukkan prestasi semua kaedah pada ImageNet 64x64. di mana D dan S masing-masing mewakili pensampel deterministik dan stokastik.

Dalam eksperimen, latihan model bersyarat pada selang bimbingan w∈[0, 4] adalah bersamaan dengan latihan model dengan w sebagai nilai tetap. Apabila terdapat lebih sedikit langkah, kaedah kami mengatasi prestasi garis dasar DDIM dengan ketara, dan pada asasnya mencapai tahap prestasi model guru pada 8 hingga 16 langkah.

Kualiti pensampelan ImageNet 64x64 yang dinilai oleh skor FID dan IS

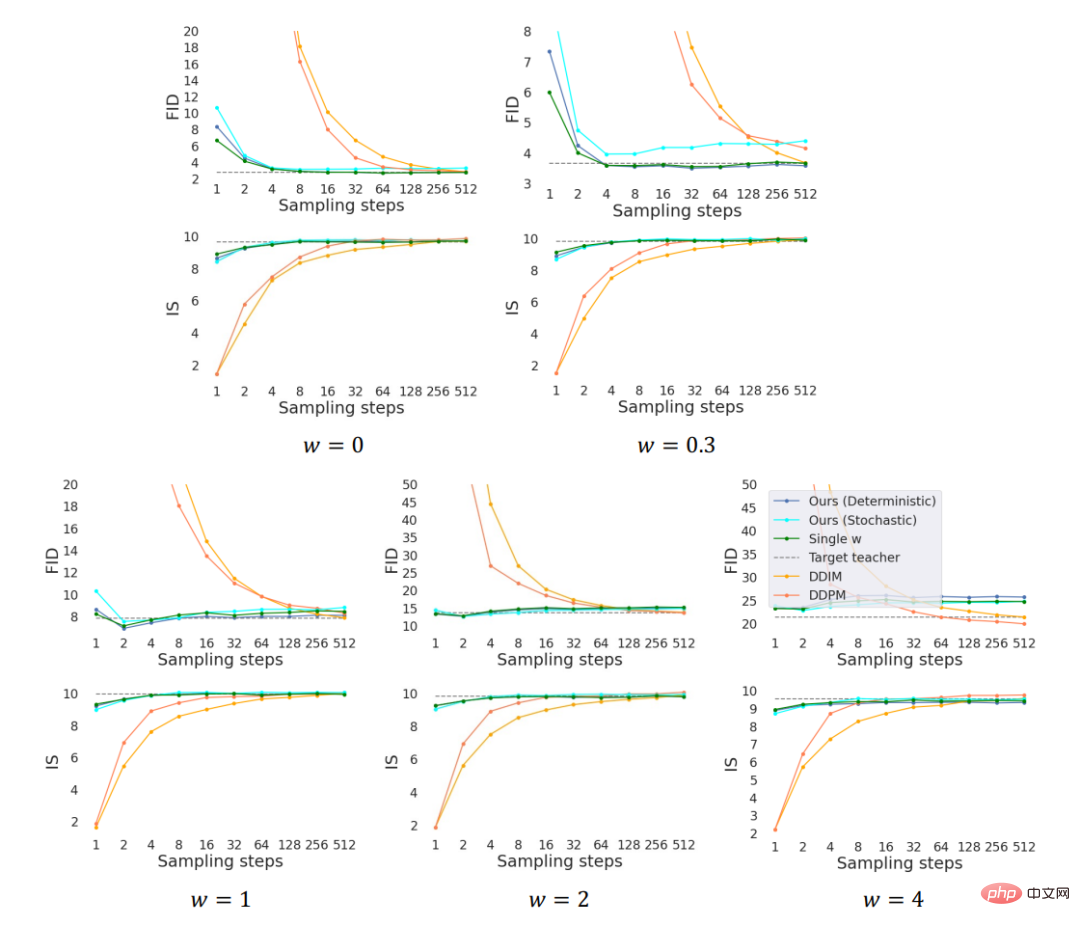

Kualiti pensampelan CIFAR-10 dinilai oleh skor FID dan IS

Kami juga menyaring proses pengekodan model guru, Dan dijalankan eksperimen mengenai pemindahan gaya. Khususnya, untuk melakukan pemindahan gaya antara dua domain A dan B, imej daripada domain A dikodkan menggunakan model resapan yang dilatih pada domain A, dan kemudian dinyahkod menggunakan model resapan yang dilatih pada domain B.

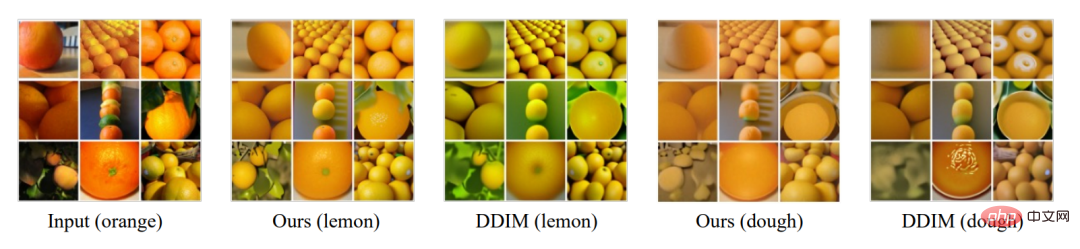

Memandangkan proses pengekodan boleh difahami sebagai proses pensampelan terbalik DDIM, kami menyaring kedua-dua pengekod dan penyahkod dengan panduan bebas pengelas dan membandingkannya dengan pengekod dan penyahkod DDIM, seperti di atas Seperti yang ditunjukkan dalam rajah . Kami juga meneroka kesan prestasi perubahan pada kekuatan but w.

Ringkasnya, kami mencadangkan kaedah penyulingan untuk model resapan berpandu, dan pensampel rawak untuk sampel daripada model suling. Secara empirik, kaedah kami mencapai pensampelan visual pengalaman tinggi dalam hanya satu langkah, dan memperoleh skor FID/IS yang setanding dengan guru dalam hanya 8 hingga 16 langkah.

Atas ialah kandungan terperinci Stanford/Google Brain: Penyulingan berganda, persampelan model resapan berpandu mempercepatkan 256 kali ganda!. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI