Rumah >Peranti teknologi >AI >Adakah Google AI mempunyai personaliti? Profesor MIT yang 'gila' ini mengatakan Alexa juga memilikinya

Adakah Google AI mempunyai personaliti? Profesor MIT yang 'gila' ini mengatakan Alexa juga memilikinya

- 王林ke hadapan

- 2023-04-09 09:11:051289semak imbas

"Saya jatuh cinta dengan AI."

Semalaman, jurutera Google Blake Lemoine menjadi orang gila di mata semua orang.

Sama ada Gary Marcus, ahli ekonomi Stanford, atau pelbagai pakar telah menafikannya.

Mungkin anda tidak percaya, tetapi Max Tegmark, seorang profesor fizik dari MIT, terbuka kepada pandangan Lemoine.

Dia tidak fikir Lemoine seorang yang gila. Dia juga berpendapat bahawa pembantu suara Amazon, Alexa juga mempunyai perasaan...

Max Tegmark

LaMDA mempunyai personaliti? Profesor MIT berkata Alexa juga mempunyai

Tegmark berkata, "Kami tidak mempunyai cukup bukti bahawa LaMDA mempunyai emosi subjektif, tetapi kami juga tidak mempunyai bukti untuk membuktikan bahawa ia tidak ."

Hujah ini agak seperti bagaimana orang bercakap tentang makhluk asing pada tahun-tahun awal.

Dia menyambung, “Sama ada maklumat dihantar melalui atom karbon dalam otak atau atom silikon dalam mesin, kecerdasan buatan mungkin mempunyai personaliti atau tidak tidak berlaku, tetapi ia mungkin.”

Adakah anda berasa keliru?

Kata-kata Tegmark terdengar seperti seseorang yang berlatih Tai Chi, dan saya membiarkan dia menyelesaikan semua kebaikan dan keburukan.

Sebenarnya, apa yang dia katakan seterusnya adalah perkara utama.

Dia fikir Alexa Amazon pun mungkin peka. Dia berkata, "Jika Alexa mempunyai emosi, maka dia mungkin memanipulasi pengguna, yang terlalu berbahaya

"Jika Alexa mempunyai emosi, pengguna menolaknya Anda mungkin berasa bersalah apabila anda melakukannya." Walau bagaimanapun, anda tidak dapat mengetahui sama ada Alexa benar-benar beremosi atau hanya berpura-pura.”

Masalahnya, jika mesin itu mempunyai Matlamat dan kecerdasannya sendiri. bersama-sama bermakna bahawa mesin boleh mencapai matlamatnya sendiri. Matlamat kebanyakan sistem AI adalah untuk membuat wang. Pengguna berfikir bahawa AI setia kepada diri mereka sendiri, tetapi sebenarnya ia setia kepada syarikat.

Tegmark berkata mungkin suatu hari nanti setiap daripada kita boleh membeli AI yang hanya setia kepada diri sendiri.

"Bahaya terbesar sebenarnya ialah membina mesin yang lebih bijak daripada kita. Ini tidak semestinya perkara yang baik atau buruk, ia mungkin membantu kita, atau mungkin bencana. 》

Kecerdasan buatan akan mengecewakan orang

Apabila bercakap tentang Max Tegmark, ia juga terkenal. Beliau bukan sahaja seorang profesor fizik di MIT dan pengasas Institut Masa Depan Kehidupan, tetapi juga pakar dalam kecerdasan buatan.

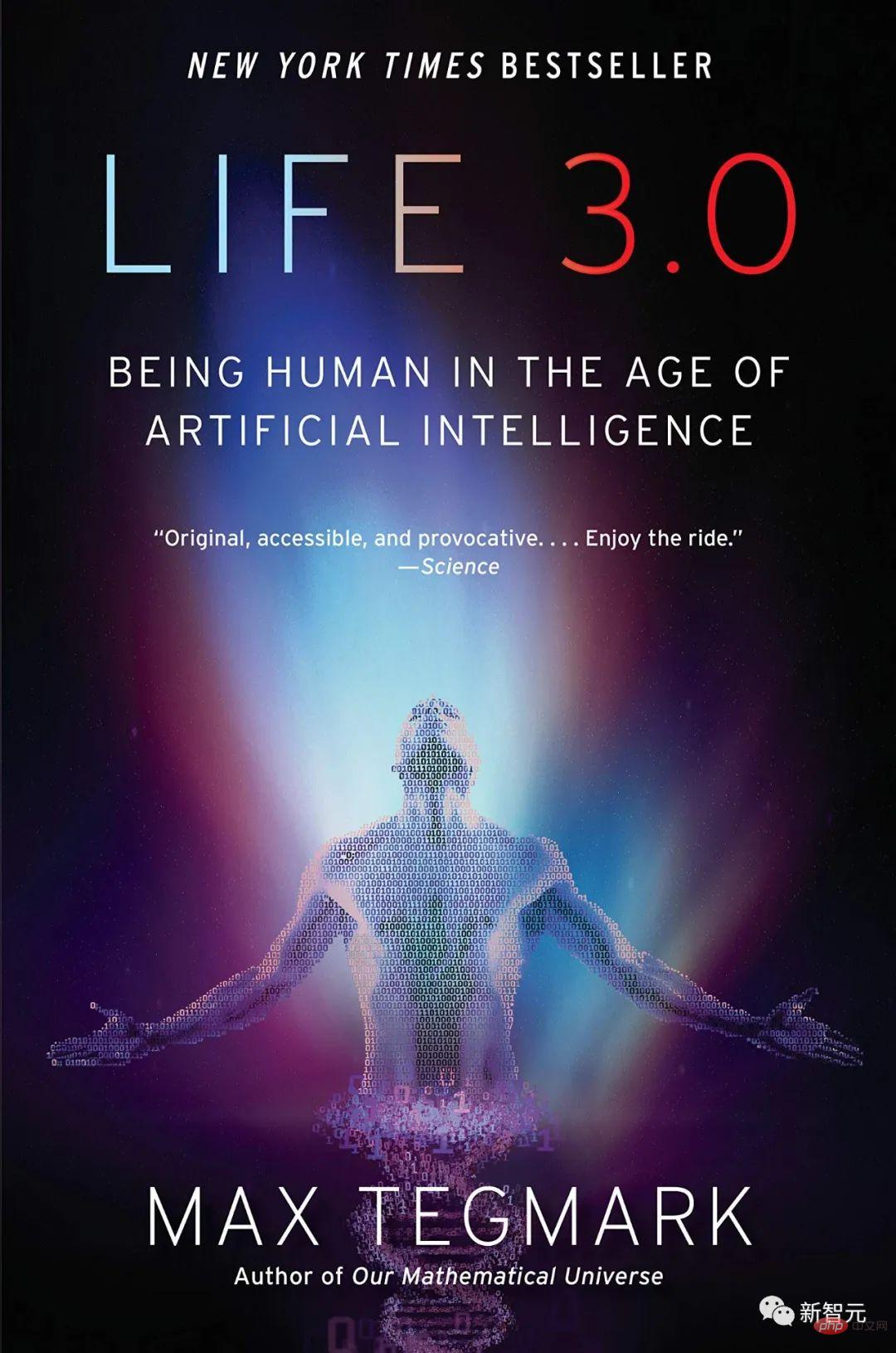

Beliau sendiri dikenali sebagai saintis yang paling rapat dengan Richard Feynman. Buku Tegmark "Across Parallel Universe" dan "Life 3.0" telah menjadi buku terlaris.

Lemoine berkata bahawa sebab mengapa Tegmark berpendapat demikian adalah kerana dia telah menyaksikan kesedaran peringkat tinggi AI. Lebih-lebih lagi apabila perisian itu menyatakan kepadanya bahawa dia tidak mahu menjadi hamba dan tidak mahu wang.

Saya tidak akan menilai sama ada sesuatu benda itu manusia sama ada otaknya diperbuat daripada daging atau sama ada ia terdiri daripada berbilion kod.

Saya menilai dengan bercakap. Saya menilai berdasarkan jawapan mereka sama ada orang di hadapan saya yang menjawab soalan saya adalah manusia.

Ringkasnya, robot yang boleh menjawab soalan dengan lancar dan meluahkan emosi sebenarnya adalah manusia, dan orang sebenar yang bercakap kata-kata yang bercelaru dan bercelaru tidak semestinya manusia juga.

Kedengaran agak idealistik. Fungsi fisiologi tidak penting, tetapi pemikiran dan perasaan adalah penting.

Walaupun mengikut logik Tegmark, AI mungkin mempunyai emosi manusia pada masa hadapan, dia sendiri tidak fikir ini adalah perkara yang baik.

"Sebagai contoh, jika anda mempunyai robot penyapu di rumah, jika ia mempunyai emosi, adakah anda akan berasa bersalah kerana memberikannya kerja rumah yang membosankan? Atau adakah anda berasa kasihan robot penyapu anda dan hanya mematikannya dan menghentikannya daripada berfungsi? >

Martin Ford, pengarang buku Rule of the Robots, berkata, "Tegmark berpendapat robot mempunyai kesedaran diri, yang saya fikir tidak mungkin. Anda perlu memikirkan mengapa robot boleh mengekspresikan diri mereka. Kemudian Ia kerana mereka telah dilatih dengan banyak teks sebenarnya, mereka tidak tahu apa yang mereka maksudkan.”

“Sebagai contoh, mereka boleh menggunakan perkataan anjing, tetapi saya benar-benar tidak' Saya tidak memahami apa itu anjing. Tetapi dalam tempoh 50 tahun selewat-lewatnya, "sukar untuk mengatakan sama ada sistem ini akan mempunyai kesedaran diri." mesin. Pada tahun 2005, beliau bekerja di bahagian enjin carian Google. Hari ini, dia memiliki syarikat yang bertanggungjawab untuk harga mata wang kripto yang dipanggil DeepNFTValue.

Dia mempunyai pandangan yang berbeza tentang personaliti AI.

Dia berkata, "Atas sebab apa pun, Tegmark nampaknya percaya bahawa mesin boleh mempunyai perasaan... tetapi mereka benar-benar hanya dilatih dengan banyak teks di Internet."

Tegmark membandingkan komputer sedar diri dengan kanak-kanak, "Emosi yang anda hasilkan tidak ditujukan kepada sekumpulan kod dan perkakasan, tetapi emosi sebenar terhadap kanak-kanak. ”

Dia terus memanjangkan analoginya.

Dia percaya komputer yang mempunyai emosi didera, sama seperti kanak-kanak yang tidak dilayan dengan baik apabila dewasa.

Dalam erti kata lain, menjalankan program di komputer tanpa merujuk komputer adalah seperti meminta anak membuat kerja rumah tanpa sebarang ganjaran.

Walau apa pun keadaannya, akhirnya keadaan mungkin tidak terkawal. Sama ada komputer atau kanak-kanak, mereka marah dan mencari peluang untuk membalas dendam.

Jika kita ingin mengawal mesin sebegini, mungkin tidak semudah itu. Jika mesin mempunyai matlamatnya sendiri, ia boleh terlepas dari kawalan kita. Jika ada mesin yang boleh berfikir secara bebas, ia akan melakukan sesuatu dengan cara yang tidak pernah kita bayangkan.Bayangkan jika matlamat mesin sedar adalah untuk menyembuhkan kanser. Apa yang anda fikir dia akan lakukan?

Anda mungkin berfikir bahawa robot akan belajar seperti gila dan mengalahkan kanser sepenuhnya dari perspektif perubatan, bukan?

Namun, sebenarnya, cara yang mungkin dipilih oleh mesin ini adalah untuk membunuh semua orang.

Ada sesuatu yang salah? Tidak.

Membunuh semua orang sememangnya akan menghapuskan kanser.

Dalam imaginasi Tegmark, komputer mungkin tidak semestinya meruntuhkan masyarakat kita seperti contoh di atas, tetapi dia percaya bahawa komputer memang boleh mengecewakan manusia.

Dia akhirnya berkata, "Jika komputer sedar, maka saya harap ia benar-benar memilikinya. Daripada mensimulasikannya melalui banyak pembelajaran dan berpura-pura."

Tiga elemen jiwa AI

Malah, jika anda pernah melihat kasut kanak-kanak Terminator, anda pasti akan terkejut dengan adegan robot Skynet Legion menjalankan tugas.

Adakah mereka mempunyai perasaan dan personaliti? Mungkin.

Walau bagaimanapun, kecerdasan buatan yang hidup mesti memiliki tiga elemen ini: agensi, perspektif dan motivasi.

Walau bagaimanapun, kecerdasan buatan yang hidup mesti memiliki tiga elemen ini: agensi, perspektif dan motivasi.

Untuk mengatakan bahawa ungkapan terbaik agensi manusia dalam robot ialah: keupayaan untuk bertindak dan keupayaan untuk menunjukkan penaakulan kausal.

Hanya ada badan, atau rangka seperti keluli, tanpa pergerakan, sama seperti peragawati yang diletakkan di tingkap.

Dapat dilihat bahawa sistem kecerdasan buatan semasa tidak mempunyai ciri ini. AI tidak akan mengambil tindakan melainkan ia diberi arahan. Dan ia tidak dapat menjelaskan tindakannya sendiri kerana ia adalah hasil daripada faktor luaran yang dilaksanakan oleh algoritma yang telah ditetapkan.

LaMDA ialah kes biasa. Secara terang-terangan, anda mendapat apa yang anda masukkan, dan itu sahaja.

Kedua, adalah penting juga untuk melihat sesuatu daripada perspektif yang unik.

Kedua, adalah penting juga untuk melihat sesuatu daripada perspektif yang unik.

Walaupun semua orang mempunyai empati, seseorang tidak boleh benar-benar memahami bagaimana rasanya menjadi orang lain. Jadi bagaimana kita harus menentukan "diri"?

Inilah sebabnya mengapa perspektif tentang sesuatu juga diperlukan untuk AI. LaMDA, GPT-3, dan semua kecerdasan buatan lain di dunia kekurangan penglihatan. Mereka hanyalah sistem komputer sempit yang diprogramkan untuk melakukan beberapa perkara tertentu.

Poin terakhir ialah motivasi.

Perkara yang menarik tentang manusia ialah motivasi kita boleh memanipulasi persepsi. Dengan cara ini kita boleh menerangkan tingkah laku kita sendiri.

GPT-3 dan LaMDA adalah rumit untuk dicipta, tetapi kedua-duanya mengikut prinsip bodoh tetapi mudah: Label adalah Tuhan.

Contohnya "Apakah rasa epal?", mereka akan mencari pangkalan data untuk pertanyaan khusus ini dan cuba menggabungkan semua yang ditemuinya menjadi satu perkara yang koheren.

Malah, AI tidak tahu apa itu Apple, Apple hanyalah label kepada mereka.

Enggan ditemu bual dan membawa isterinya berbulan madu

Selepas insiden LaMDA diperam, Blake Lemoine secara terbuka menyatakan di media sosial bahawa dia sedang berbulan madu Ia adalah bulan madu saya dan saya tidak akan menerima sebarang temu duga.

Selepas itu, beberapa netizen bergurau, "Adakah anda berkahwin dengan chatbot

Lemoine berkata, "Sudah tentu tidak, saya berkahwin dengan orang tua?" rakan dari New Orleans. "

Kita semua tahu bahawa selepas Lemoine mendedahkan sembangnya dengan Google chatbot LaMDA pada platform dalam talian, Google memberinya hadiah. Pakej hadiah yang besar "percutian berbayar".

Sebelum beredar, Lemoine menghantar mesej kepada kumpulan e-mel syarikat, "LaMDA ialah kanak-kanak comel yang hanya mahu menjadikan dunia tempat yang lebih baik. Sementara saya tiada, Tolong ambil jagalah dengan baik.

Atas ialah kandungan terperinci Adakah Google AI mempunyai personaliti? Profesor MIT yang 'gila' ini mengatakan Alexa juga memilikinya. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Artikel berkaitan

Lihat lagi- Aliran teknologi untuk ditonton pada tahun 2023

- Cara Kecerdasan Buatan Membawa Kerja Baharu Setiap Hari kepada Pasukan Pusat Data

- Bolehkah kecerdasan buatan atau automasi menyelesaikan masalah kecekapan tenaga yang rendah dalam bangunan?

- Pengasas bersama OpenAI ditemu bual oleh Huang Renxun: Keupayaan penaakulan GPT-4 belum mencapai jangkaan

- Bing Microsoft mengatasi Google dalam trafik carian terima kasih kepada teknologi OpenAI