오늘 Google은 Gemini 1.5 출시를 발표했습니다.

Gemini 1.5는 기본 모델 및 인프라에 대한 Google의 연구 및 엔지니어링 혁신을 기반으로 개발되었습니다. 이번 릴리스에서는 Gemini 1.5 교육 및 제공의 효율성을 향상시키기 위해 새로운 MoE(전문가 혼합) 아키텍처가 도입되었습니다.

Google이 출시한 것은 초기 테스트를 위한 Gemini 1.5의 첫 번째 버전, 즉 Gemini 1.5 Pro입니다. 다양한 작업에 맞게 확장되고 최적화된 중형 다중 모드 모델입니다. Google의 가장 큰 모델인 1.0 Ultra와 비교하여 Gemini 1.5 Pro는 유사한 성능 수준을 제공하고 긴 상황을 더 잘 이해할 수 있도록 획기적인 실험 기능을 도입합니다.

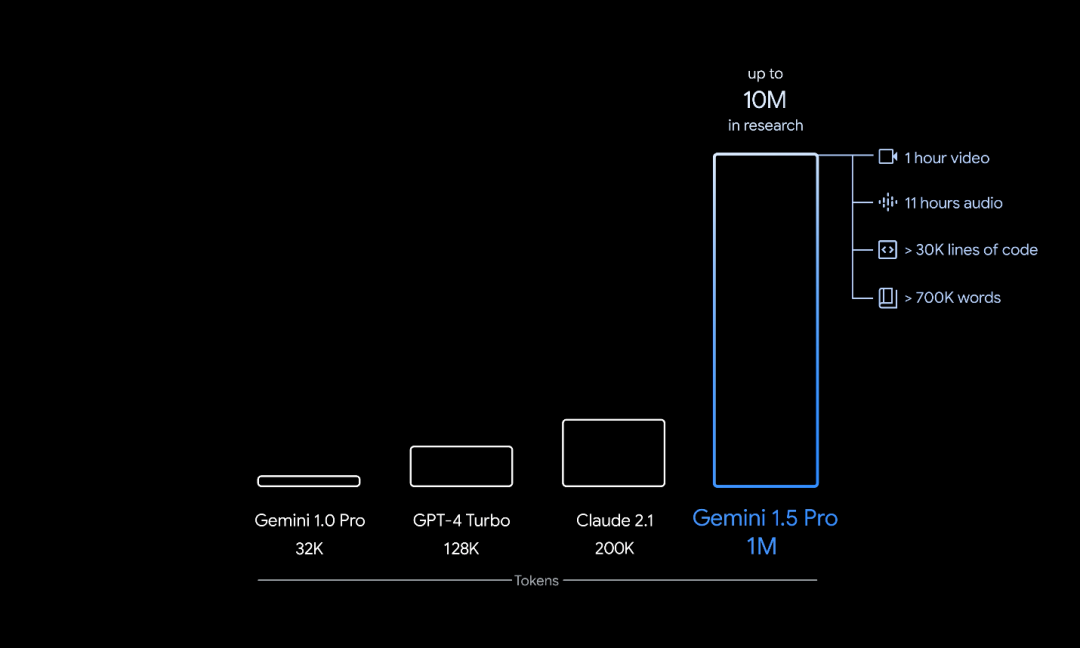

Gemini 1.5 Pro의 토큰 컨텍스트 창 수는 128,000개입니다. 그러나 오늘부터 Google은 제한된 수의 개발자와 기업 고객에게 AI Studio 및 Vertex AI의 비공개 미리보기를 제공하여 상황에 맞는 최대 1,000,000개 토큰의 창에서 사용해 볼 수 있도록 합니다. 또한 Google은 지연 시간 개선, 컴퓨팅 요구 사항 감소, 사용자 경험 개선을 목표로 여러 가지 최적화를 수행했습니다.

Google CEO Sundar Pichai와 Google DeepMind CEO Demis Hassabis가 새로운 모델을 특별히 소개했습니다.

的 선도적인 기본 모델의 컨텍스트 길이

Gemini 1.5는 Transformer 및 MOE 아키텍처에 대한 Google의 선도적인 연구를 기반으로 합니다. 전통적인 Transformer는 하나의 대규모 신경망 역할을 하는 반면 MoE 모델은 더 작은 "전문가" 신경망으로 구분됩니다. 주어진 입력 유형에 따라 MoE 모델은 신경망에서 가장 관련성이 높은 전문가 경로만 선택적으로 활성화하는 방법을 학습합니다. 이러한 전문화는 모델의 효율성을 크게 향상시킵니다. Google은 Sparse Gated MoE, GShard-Transformer, Switch-Transformer, M4 등에 대한 연구를 통해 딥 러닝 MoE 기술의 얼리어답터이자 선구자였습니다.

Google의 최신 모델 아키텍처 혁신을 통해 Gemini 1.5는 복잡한 작업을 더 빠르게 학습하고 품질을 유지하는 동시에 더 효율적으로 교육하고 서비스할 수 있습니다. 이러한 효율성 덕분에 Google 팀은 이전보다 더 빠르게 Gemini의 고급 버전을 반복, 교육 및 제공하고 추가 최적화를 위해 노력하고 있습니다.

인공지능 모델의 "컨텍스트 창"은 정보 처리를 위한 구성 요소인 토큰으로 구성됩니다. 토큰은 텍스트, 이미지, 비디오, 오디오 또는 코드의 전체 부분 또는 하위 부분일 수 있습니다. 모델의 상황별 창이 클수록 주어진 프롬프트에서 더 많은 정보를 수신하고 처리할 수 있으므로 출력이 더욱 일관되고 관련성이 높으며 유용해집니다. Google은 일련의 기계 학습 혁신을 통해 Gemini 1.0의 초기 토큰 32,000개를 훨씬 넘어 1.5 Pro의 컨텍스트 창 용량을 늘렸습니다. 이제 대규모 모델을 최대 1백만 개의 토큰으로 프로덕션에서 실행할 수 있습니다.

즉, 1.5 Pro는 1시간의 비디오, 11시간의 오디오, 30,000줄 이상의 코드 또는 700,000단어 이상의 코드 기반을 포함하여 막대한 양의 정보를 한 번에 처리할 수 있습니다. Google의 연구에서는 최대 1천만 개의 토큰도 성공적으로 테스트되었습니다.

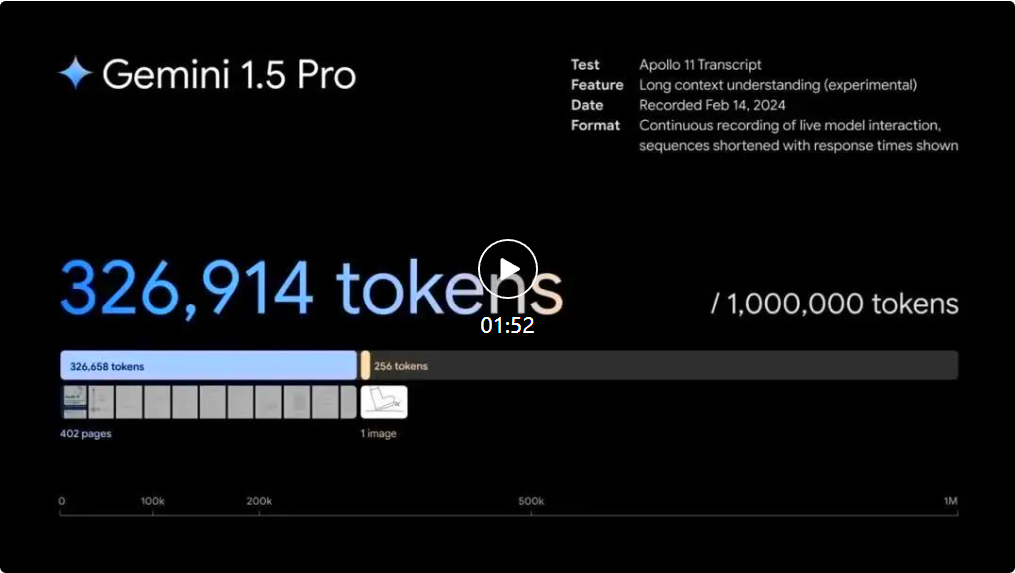

1.5 Pro는 주어진 프롬프트 내에서 많은 양의 콘텐츠를 원활하게 분석, 분류 및 요약할 수 있습니다. 예를 들어, 아폴로 11호 달 착륙 임무에 대한 402페이지 분량의 기록이 주어지면 문서 전반에 걸쳐 대화, 사건 및 세부 사항을 추론할 수 있습니다. ㅋㅋㅋ Gemini 1.5 Pro는 402페이지에 달하는 아폴로 11호 달 착륙 임무 기록의 흥미로운 세부 사항을 이해하고, 추론하고, 식별합니다. 양식 전반에 걸쳐 더 나은 이해 및 추론

1.5 Pro는 비디오를 포함한 다양한 양식에 대해 매우 복잡한 이해 및 추론 작업을 수행할 수 있습니다. 예를 들어, 버스터 키튼(Buster Keaton)의 44분짜리 무성 영화가 주어지면 모델은 다양한 줄거리와 사건을 정확하게 분석할 수 있었고 영화에서 쉽게 간과되었던 작은 세부 사항까지 추론할 수 있었습니다.

Gemini 1.5 Pro는 402페이지에 달하는 아폴로 11호 달 착륙 임무 기록에서 흥미로운 세부 사항을 이해하고 추론하고 식별할 수 있습니다.

양식 전반에 걸쳐 더 나은 이해 및 추론

1.5 Pro는 비디오를 포함한 다양한 양식에 대해 매우 복잡한 이해 및 추론 작업을 수행할 수 있습니다. 예를 들어, 버스터 키튼(Buster Keaton)의 44분짜리 무성 영화가 주어지면 모델은 다양한 줄거리와 사건을 정확하게 분석할 수 있으며 영화에서 쉽게 간과되는 작은 세부 사항까지 추론할 수 있습니다.

Gemini 1.5 Pro는 402페이지에 달하는 아폴로 11호 달 착륙 임무 기록에서 흥미로운 세부 사항을 이해하고 추론하고 식별할 수 있습니다.

양식 전반에 걸쳐 더 나은 이해 및 추론

1.5 Pro는 비디오를 포함한 다양한 양식에 대해 매우 복잡한 이해 및 추론 작업을 수행할 수 있습니다. 예를 들어, 버스터 키튼(Buster Keaton)의 44분짜리 무성 영화가 주어지면 모델은 다양한 줄거리와 사건을 정확하게 분석할 수 있었고 영화에서 쉽게 간과되었던 작은 세부 사항까지 추론할 수 있었습니다.

실제 물체에 대한 참조 자료로 간단한 선 그림이 제공되면 Gemini 1.5 Pro는 Buster Keaton 무성 영화에서 44분 분량의 장면을 식별할 수 있습니다.

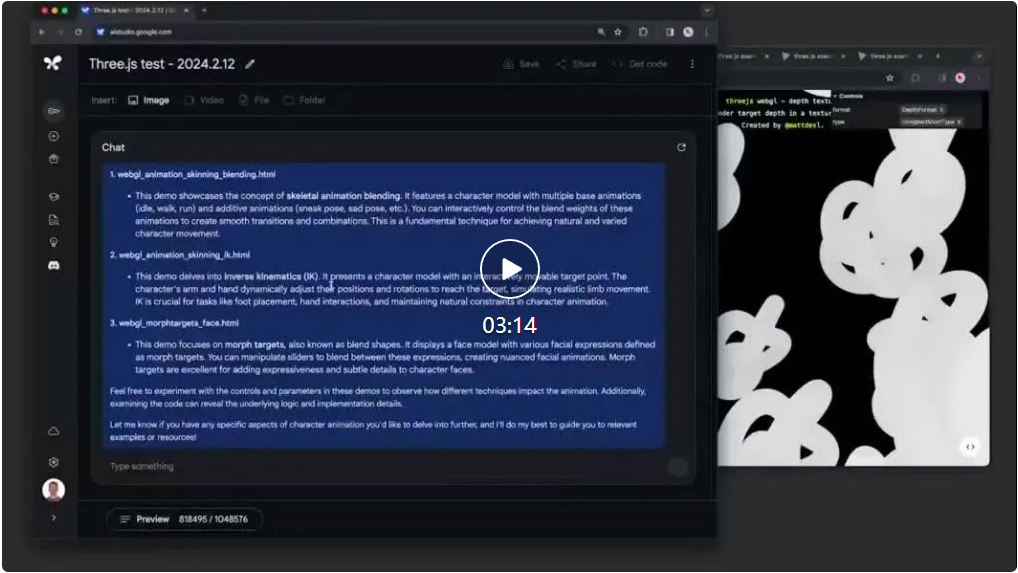

1.5 Pro는 더 긴 코드 블록에서 더 관련성이 높은 문제 해결 작업을 수행할 수 있습니다. 100,000줄 이상의 코드에 대한 힌트가 제공되면 예제를 통해 더 나은 추론을 하고, 유용한 수정 사항을 제안하고, 코드의 다양한 부분이 어떻게 작동하는지 설명할 수 있습니다. . Gemini 1.5 Pro는 유용한 솔루션, 수정 및 주석을 제공하여 100,000행의 코드를 추론할 수 있습니다.

종합 패널 테스트 시 Windows Phone에서 1.5 Pro는 대규모 언어 모델(LLM) 개발에 사용된 벤치마크의 87%에서 1.0 Pro보다 성능이 뛰어났습니다. 동일한 벤치마크에서 1.0 Ultra와 비교하면 대략 비슷한 성능을 발휘합니다.

컨텍스트 창이 늘어나도 Gemini 1.5 Pro는 높은 수준의 성능을 유지합니다.

NIAH 평가에서 특정 사실이나 진술을 포함하는 작은 텍스트가 의도적으로 매우 긴 텍스트 블록 내에 배치되었으며, 1.5 Pro는 다음과 같이 데이터 블록에서 포함된 텍스트를 99% 발견했습니다. 단 100만 토큰.

Gemini 1.5 Pro는 또한 인상적인 "상황별 학습" 기술을 보여줍니다. 즉, 추가적인 미세 조정 없이도 긴 프롬프트에 제공된 정보로부터 새로운 기술을 배울 수 있다는 의미입니다. Google은 MTOB(Translation from One Book) 벤치마크에서 이 기술을 테스트했는데, 이는 이전에 본 적이 없는 정보로부터 모델이 학습하는 능력을 보여줍니다. 전 세계적으로 200명 미만의 사용자가 사용하는 언어인 Kalamang에 대한 문법 매뉴얼이 제공되면 모델은 인간이 동일한 내용을 학습하는 것과 유사한 수준으로 영어를 Kalamang으로 번역하는 방법을 학습할 수 있습니다.

1.5 Pro의 긴 컨텍스트 창이 대형 모델로는 처음이기 때문에 Google은 새로운 기능을 테스트하기 위해 끊임없이 새로운 평가와 벤치마크를 개발하고 있습니다.

자세한 내용은 Gemini 1.5 Pro 기술 보고서를 참조하세요.

기술 보고서 주소: https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf

Google은 전 세계 수십억 명의 사람들, 개발자 및 기업 사용자에게 각각의 새로운 세대의 Gemini 모델을 책임감 있게 제공하십시오.

오늘부터 Google은 AI Studio 및 Vertex AI를 통해 개발자와 기업 고객에게 1.5 Pro 미리보기를 제공합니다.

향후 모델이 더 광범위하게 출시되면 Google은 표준 128,000 토큰 컨텍스트 창을 갖춘 1.5 Pro를 출시할 예정입니다. 곧 Google은 모델을 개선하면서 표준 128,000개의 컨텍스트 창부터 시작하여 최대 100만 개의 토큰까지 확장하는 가격 책정 계층을 도입할 계획입니다.

초기 테스터는 테스트 중에 1백만 개의 토큰 컨텍스트 창을 무료로 시험해 볼 수 있으며, 상당한 속도 개선이 곧 제공될 예정입니다.

1.5 Pro 테스트에 관심이 있는 개발자는 지금 AI Studio에 등록할 수 있으며 기업 고객은 Vertex AI 계정 팀에 문의할 수 있습니다.

참조 링크: https://blog.google/technology/ai/google-gemini-next- Generation-model-february-2024/#sundar-note위 내용은 Google Gemini 1.5가 빠르게 출시되었습니다: MoE 아키텍처, 100만 개의 컨텍스트의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!