iPhone은 300평방미터의 방을 실시간으로 렌더링하여 센티미터 수준의 정확도에 도달합니다! Google의 최신 연구: NeRF는 아직 파산하지 않았습니다

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2024-01-15 08:24:091181검색

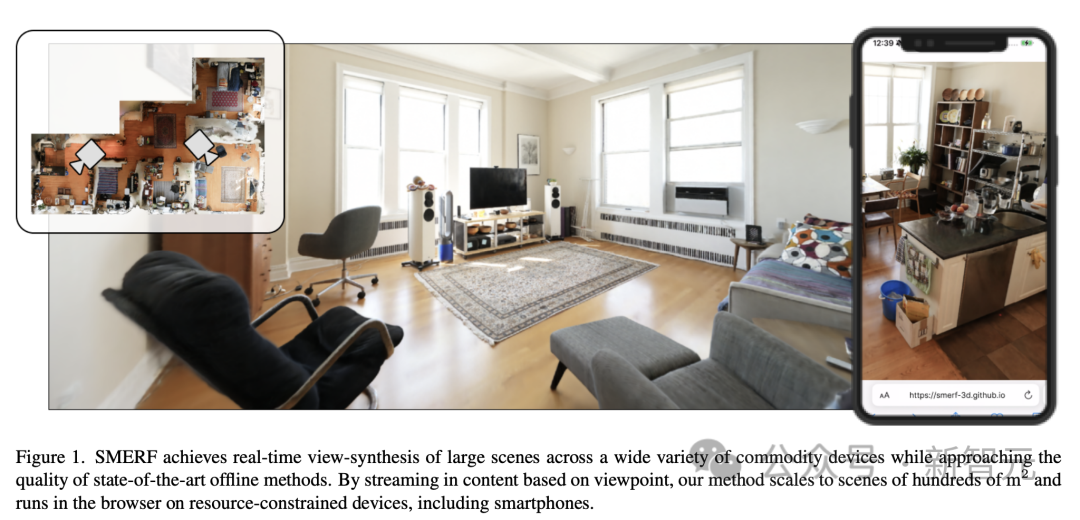

큰 장면의 3D 실시간 렌더링은 컴퓨터나 휴대폰으로도 완료할 수 있습니다.

거실부터 안방, 수납장, 주방, 욕실까지 막다른 구석구석까지 컴퓨터로 마치 실제 영상을 촬영하는 것처럼 실감나게 렌더링할 수 있습니다.

또한 iPhone에서 복잡한 장면 렌더링을 완료할 수도 있습니다.

Google, Google DeepMind 및 Tübingen 대학의 연구원들은 최근 새로운 기술 SMERF를 제안했습니다.

스마트폰, 노트북 등 다양한 기기에서 실시간으로 대규모 뷰 장면을 렌더링할 수 있습니다.

문서 주소: https://arxiv.org/pdf/2312.07541.pdf

본질적으로 SMERF는 메모리 효율성이 더 높은 MERF(Memory -Efficient Radiance)에 의존하는 NeRFs 기반 방법입니다. 필드).

NeRF는 죽었나요?

현재 Radiance 필드는 사실적인 실제 3D 장면을 재구성하고 다시 렌더링하기 위한 강력하고 쉽게 최적화된 표현으로 등장했습니다.

메시 및 포인트 클라우드와 같은 명시적인 표현과 달리 방사선장은 일반적으로 신경망으로 저장되고 체적 광선 행진을 사용하여 렌더링됩니다.

충분히 큰 계산 예산이 주어지면 신경망은 복잡한 기하학과 뷰 의존 효과를 간결하게 표현할 수 있습니다.

체적 표현으로서 이미지를 렌더링하는 데 필요한 작업 수는 기본 요소(예: 삼각형) 수가 아닌 픽셀 수로 측정되며, 최고 성능의 모델에는 수천만 개의 네트워크가 필요합니다. 평가.

따라서 방사선장에 대한 실시간 접근 방식은 품질, 속도 또는 표현 크기에서 타협을 초래하며, 그러한 표현이 Gaussian Splatting과 같은 대안과 경쟁할 수 있는지 여부는 여전히 열려 있는 질문으로 남아 있습니다.

최신 연구에서 저자는 이전보다 더 높은 충실도의 실시간 대규모 공간 렌더링을 달성할 수 있는 확장 가능한 방법을 제안합니다.

센티미터 수준의 정확도를 갖춘 SMERF 실시간 렌더링

SMERF는 주택 렌더링과 같은 대규모 3D 표현을 학습하기 위해 특별히 설계되었습니다.

Google과 다른 연구자들은 공간의 다양한 부분과 학습 매개변수가 다양한 MERF로 표현되는 계층적 모델 분할 방식을 결합했습니다.

이는 모델 용량을 늘릴 뿐만 아니라 계산 및 메모리 요구 사항도 제한합니다. 이와 같은 대규모 3D 표현은 클래식 NERF를 사용하여 실시간으로 렌더링할 수 없기 때문입니다.

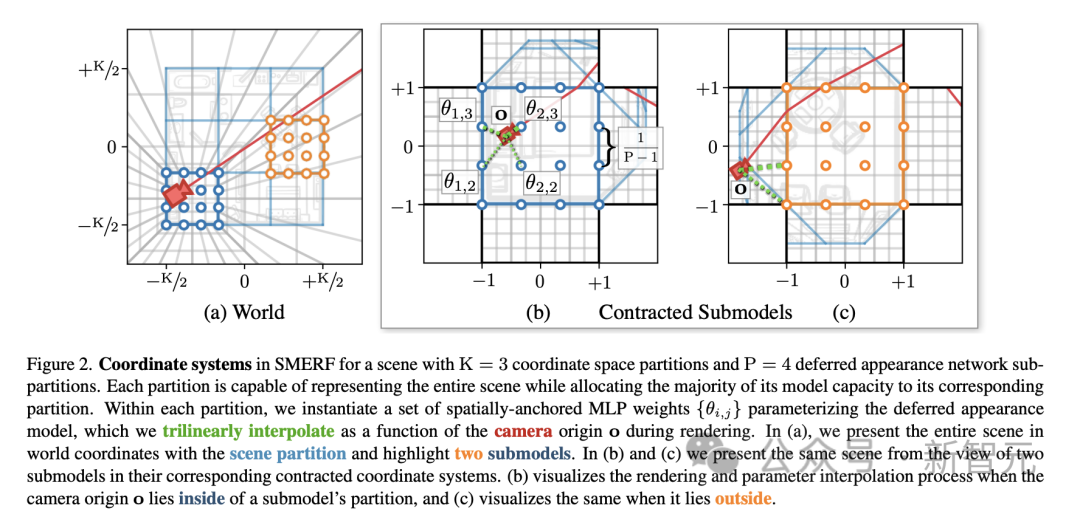

SMERF에서 K=3 좌표 공간 분할과 P=4 지연 출현 네트워크 하위 분할을 사용한 장면의 좌표계

SMERF의 렌더링 품질을 향상시키기 위해 연구팀은 또한 "교사"-학생" 증류 방법을 사용했습니다.

이 방법에서는 이미 훈련된 고품질 Zip-Nerf 모델(교사)을 사용하여 새로운 MERF 모델(학생)을 훈련합니다.

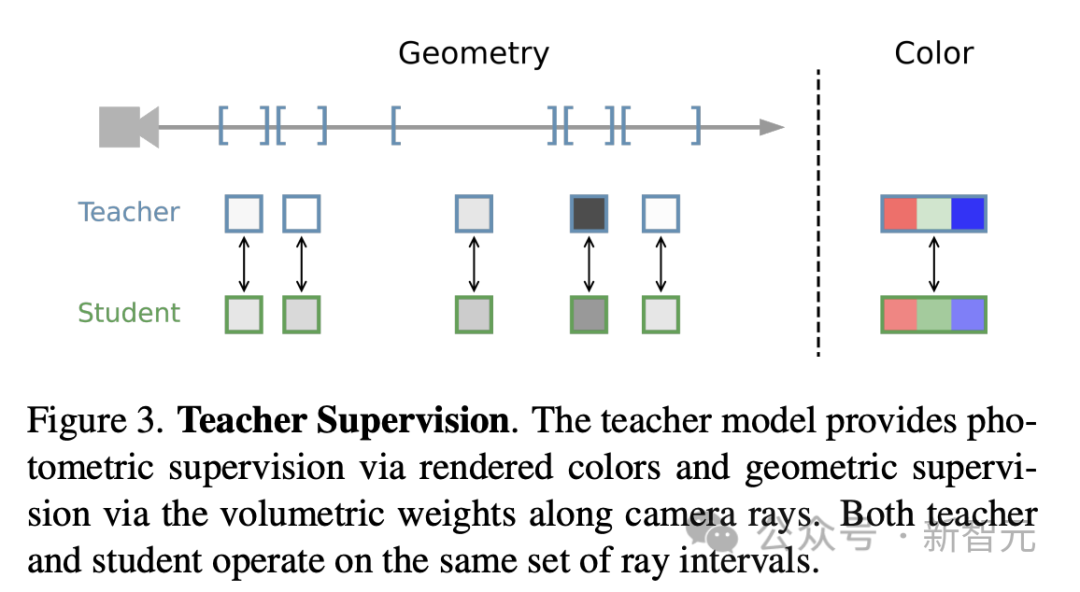

아래와 같이 "교사 감수"의 전반적인 과정을 보여줍니다. Teacher 모델은 색상을 렌더링하여 광도 측정 감독을 제공하고 카메라 광선을 따라 체적 가중치를 적용하여 기하학적 감독을 제공합니다. 교사와 학생 모두 동일한 조명 간격으로 작동합니다.

이 접근 방식을 통해 연구자들은 강력한 Zip-Nerf 모델의 디테일과 이미지 품질을 보다 효율적이고 빠른 구조로 전송할 수 있습니다.

이 기능은 스마트폰이나 노트북처럼 성능이 떨어지는 기기의 앱에 특히 유용합니다.

실험 평가

연구원들은 먼저 Zip-NeRF가 도입한 4가지 주요 시나리오(베를린, 알라메다, 런던, 뉴욕)에 대해 방법을 평가했습니다.

각 장면은 180° 어안 렌즈를 사용하여 1,000~2,000장의 사진으로 촬영되었습니다. 3DGS와의 포괄적인 비교를 위해 연구원들은 사진을 110°로 자르고 COLMAP을 사용하여 카메라 매개변수를 다시 추정했습니다.

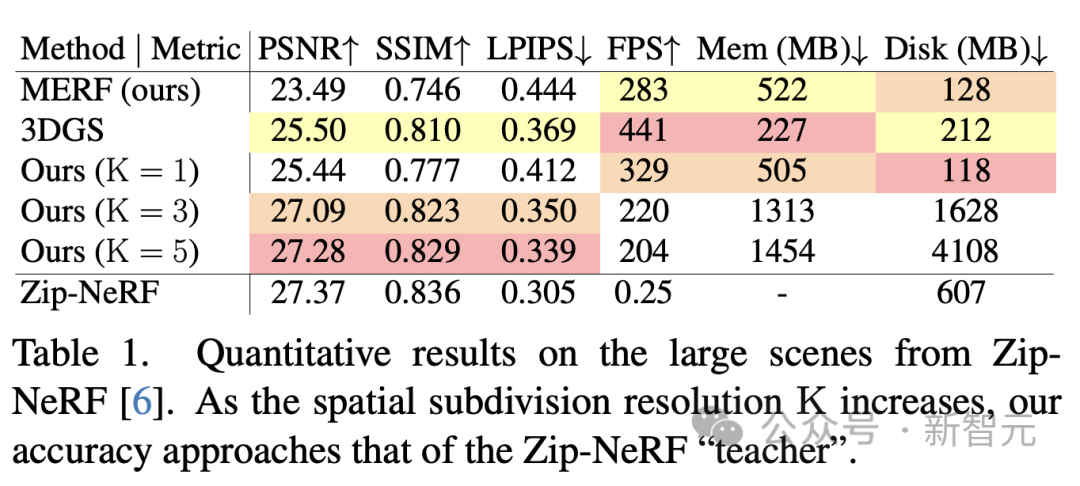

표 1에 표시된 결과는 적당한 공간 분할 K의 경우 최첨단 방법의 정확도가 MERF 및 3DGS를 크게 초과한다는 것을 보여줍니다.

K가 증가함에 따라 모델의 재구성 정확도가 향상되고 K=5일 때 차이는 0.1 PSNR 및 0.01 SSIM 미만입니다.

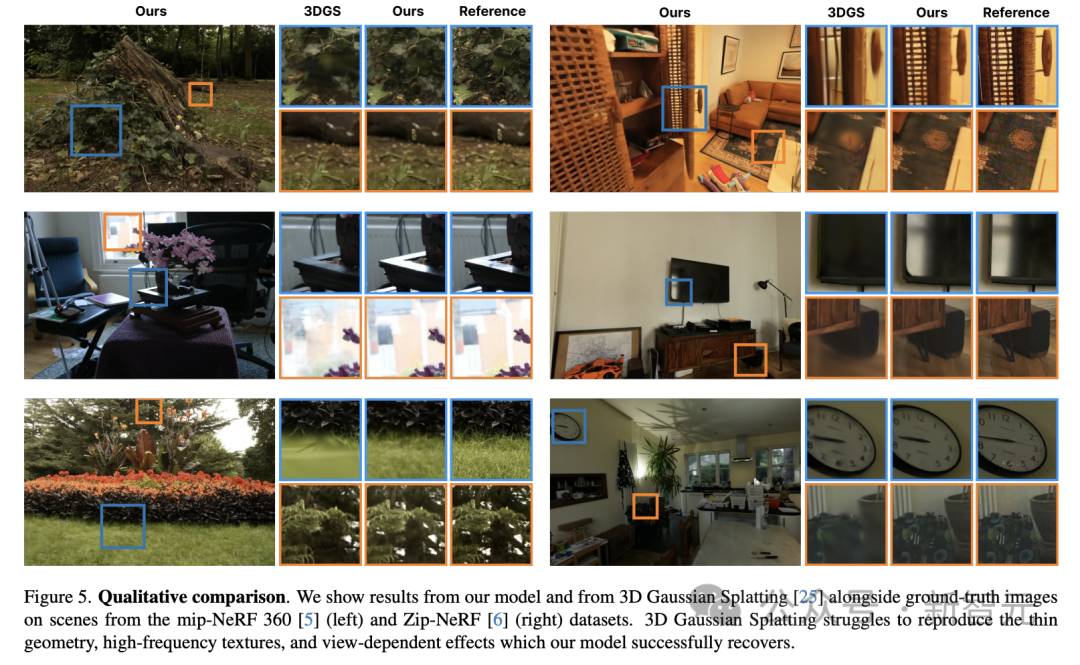

연구원들은 또한 그림 5에서 볼 수 있듯이 이러한 정량적 개선이 재구성 정확도의 질적 개선을 과소평가했다는 사실을 발견했습니다.

대규모 장면에서 SMERF 방법은 얇은 형상, 고주파수 텍스처, 반사 하이라이트 및 실시간 기준선 범위를 넘어서는 원거리 콘텐츠를 일관되게 모델링합니다.

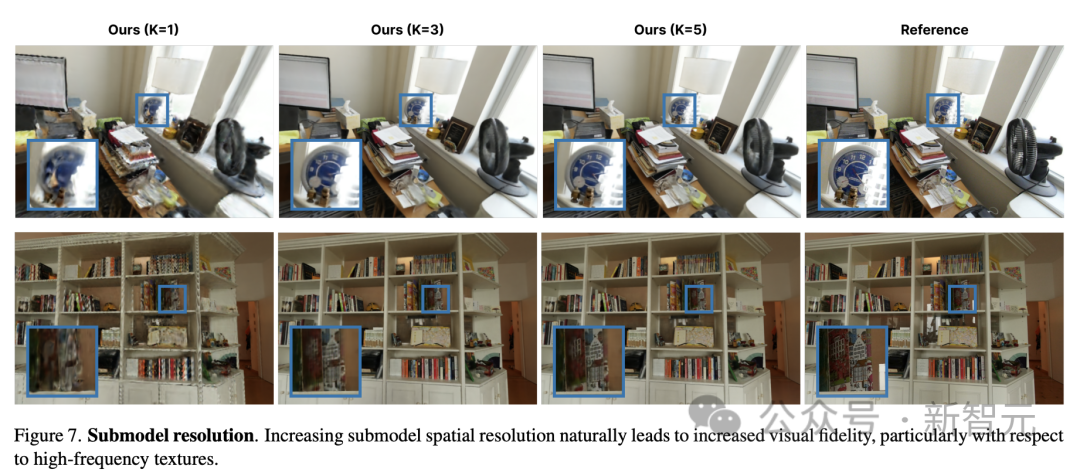

동시에 연구원들은 하위 모델 해상도를 높이면 특히 고주파 텍스처 측면에서 품질이 자연스럽게 향상된다는 사실을 발견했습니다.

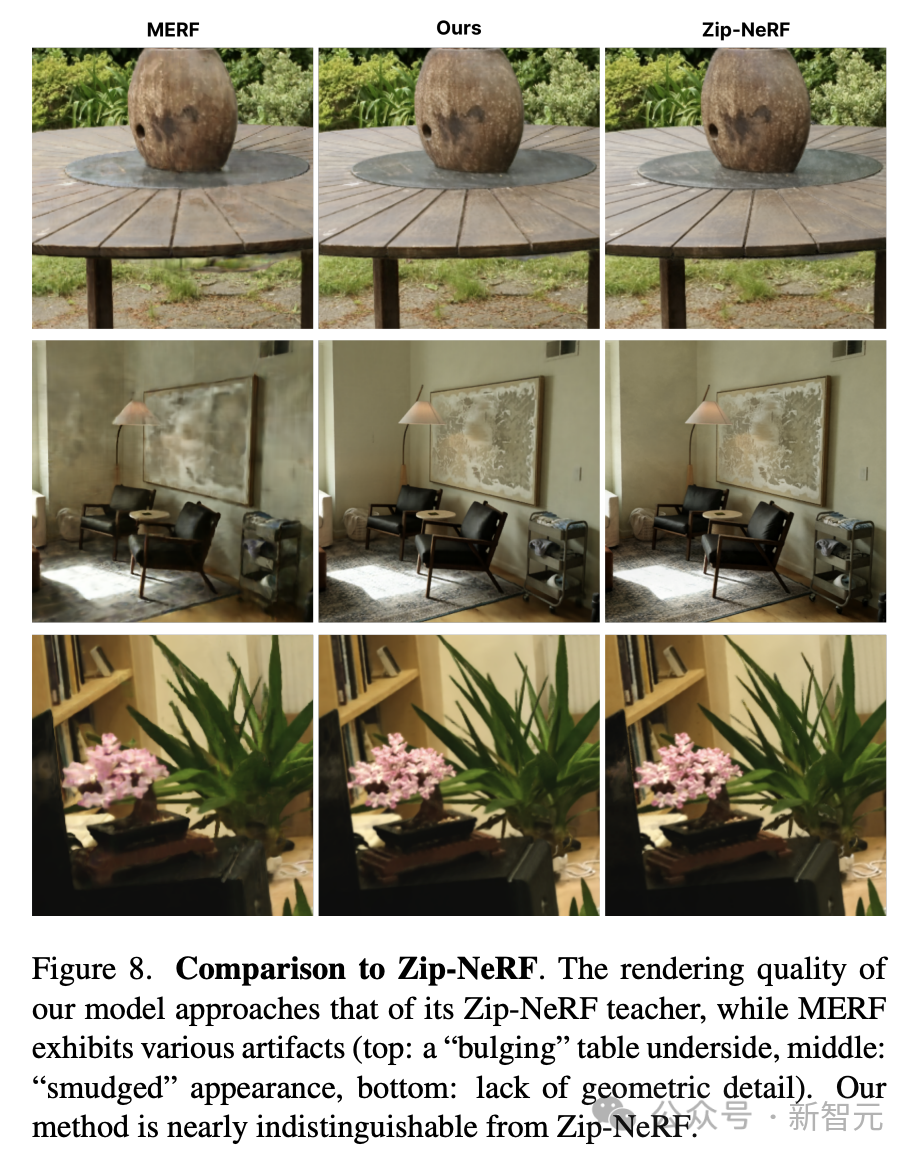

실제로 연구원들은 그림 8에서 볼 수 있듯이 최신 렌더링 방법이 Zip-NeRF와 거의 구별되지 않는다는 것을 발견했습니다.

또한 연구원들은 실내 및 실외 장면의 mip-NeRF 360 데이터 세트에 대한 최첨단 방법을 추가로 평가했습니다.

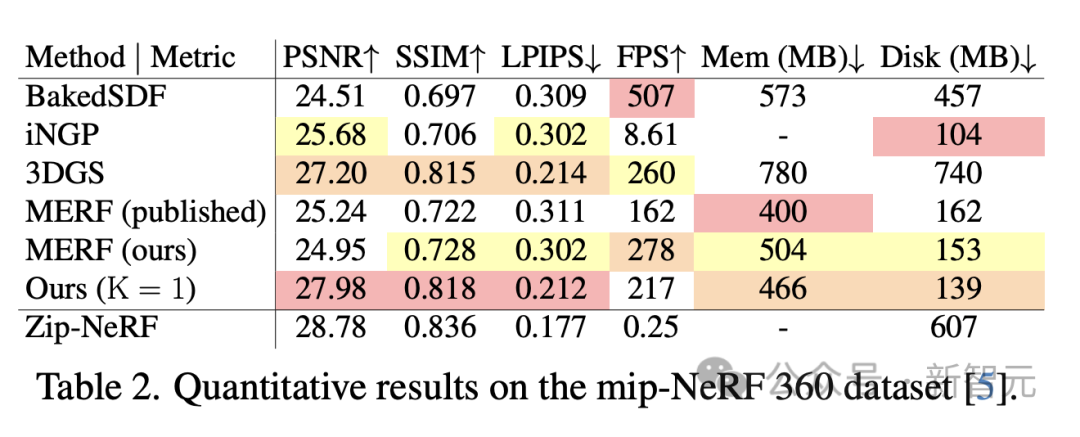

이러한 장면은 Zip-NeRF 데이터 세트의 장면보다 훨씬 작으므로 고품질 결과를 얻기 위해 공간 분할이 필요하지 않습니다. 표 2에서 볼 수 있듯이 모델의 K=1 버전은 이미지 품질 측면에서 이 벤치마크에서 이전의 모든 실시간 모델보다 성능이 뛰어나며 3DGS에 필적하는 속도로 렌더링됩니다.

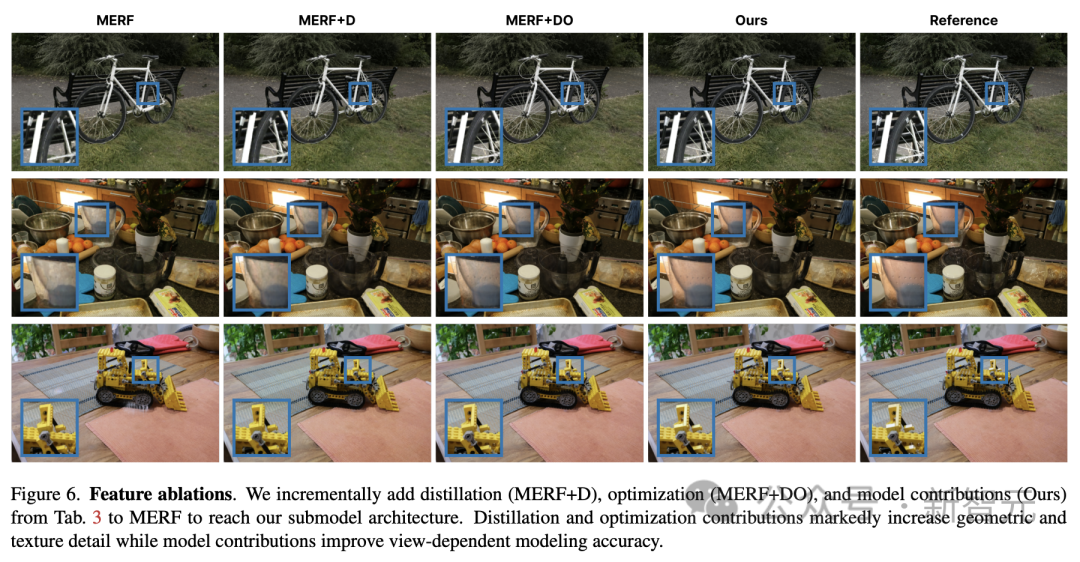

그림 6과 8은 이러한 개선 사항을 정성적으로 보여줍니다. 연구원이 제안한 방법은 방해가 되는 부유물과 안개를 제거하면서 고주파 기하학과 질감을 표현하는 데 훨씬 더 뛰어납니다.

웹 페이지는 사실적인 3D 공간을 전송할 수 있습니다

SMERF는 훈련을 받으면 브라우저에서 그리고 인기 있는 스마트폰과 노트북 렌더링에서 실시간으로 완전한 6도 자유도 탐색을 달성할 수 있습니다.

대형 3D 장면을 실시간으로 렌더링하는 능력이 비디오 게임, 가상 증강 현실, 전문 디자인 및 건축 애플리케이션을 포함한 다양한 애플리케이션에 중요하다는 것은 누구나 알고 있습니다.

예를 들어 Google Immersive Maps에서는 실시간 내비게이션이 가능합니다.

그러나 Google과 같은 팀에서 제안하는 최신 방법에도 일정한 제한이 있습니다. SMERF는 재구성 품질과 저장 효율성이 뛰어나지만 저장 비용이 높고 로딩 시간이 길며 훈련 작업량이 많습니다.

그러나 이 연구는 NeRF 및 유사한 방사선장이 3차원 가우스 스티칭 방법에 비해 앞으로도 여전히 장점이 있음을 보여줍니다.

위 내용은 iPhone은 300평방미터의 방을 실시간으로 렌더링하여 센티미터 수준의 정확도에 도달합니다! Google의 최신 연구: NeRF는 아직 파산하지 않았습니다의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!