AI는 뇌 신호를 실시간으로 해석하고 LeCun이 전달한 7배 속도로 이미지의 주요 시각적 특징을 복원합니다.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-10-19 14:13:01714검색

이제 AI가 뇌 신호를 실시간으로 해석할 수 있습니다!

특별한 내용은 아니지만, 뇌 신호를 기반으로 지금 보고 있는 사진을 0.5초 안에 추측하고 AI를 활용해 실시간으로 복원할 수 있다는 메타(Meta)의 새로운 연구입니다.

이전에는 AI가 뇌 신호로부터 이미지를 비교적 정확하게 복원할 수 있었지만 여전히 버그가 있습니다. 충분히 빠르지 않다는 것입니다.

이를 위해 Meta는 AI 이미지 검색 속도를 7배나 향상시키는 새로운 디코딩 모델을 개발했습니다. 사람들이 보고 있는 것을 거의 "즉시" 읽고 대략적인 추측을 할 수 있습니다.

서 있는 사람처럼 보임 .

Pictures

Pictures

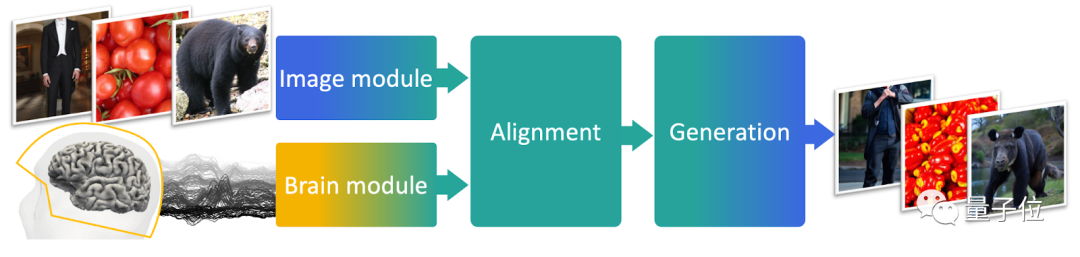

그렇다면 Meta는 어떻게 AI가 "두뇌를 빠르게 읽"도록 허용합니까?

뇌 활동 디코딩을 해석하는 방법은 무엇입니까?  현재 AI가 뇌 신호를 읽고 이미지를 복원하는 방법은 크게 두 가지가 있습니다.

현재 AI가 뇌 신호를 읽고 이미지를 복원하는 방법은 크게 두 가지가 있습니다.

훈련을 위해 연구원들은 THINGS-MEG라는 데이터 세트를 사용했습니다. 여기에는 4명의 젊은이(남성 2명, 여성 2명, 평균 연령 23.25세)가 이미지를 볼 때 기록된 MEG 데이터가 포함되어 있습니다.

이 청소년들은 총 22,448개의 이미지(1,854종)를 보았는데, 각 이미지는 0.5초 동안 표시되었으며, 그 중 0.8~1.2초의 간격이 반복적으로 표시되었습니다.

이 외에도 참가자들에게 공개되지 않았지만 이미지 검색에도 사용된 이미지가 3659개 있습니다.  그럼 이렇게 훈련된 AI는 어떤 효과가 있을까요?

그럼 이렇게 훈련된 AI는 어떤 효과가 있을까요?

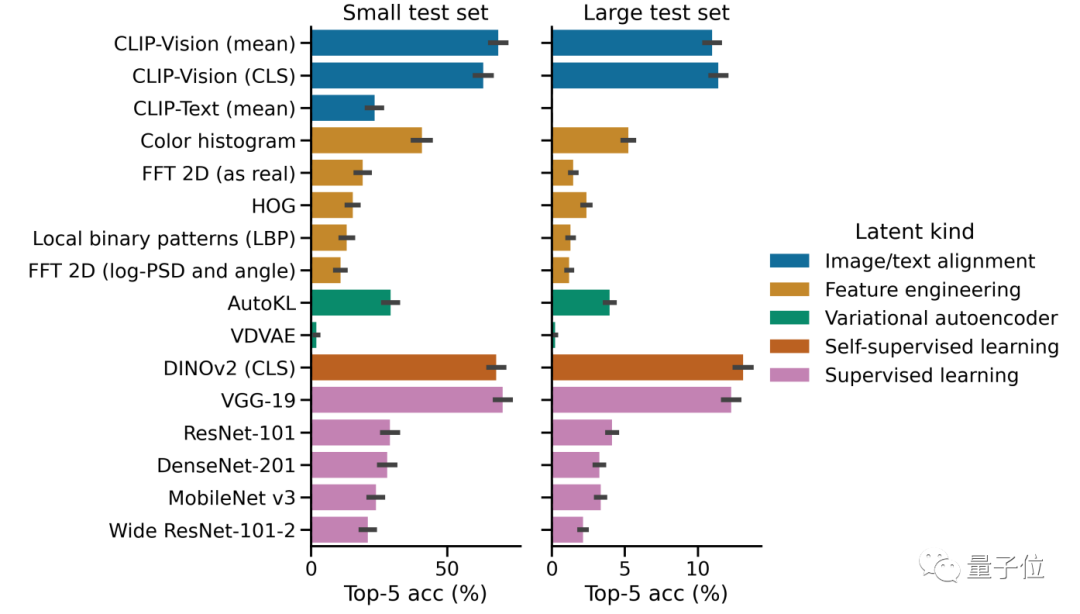

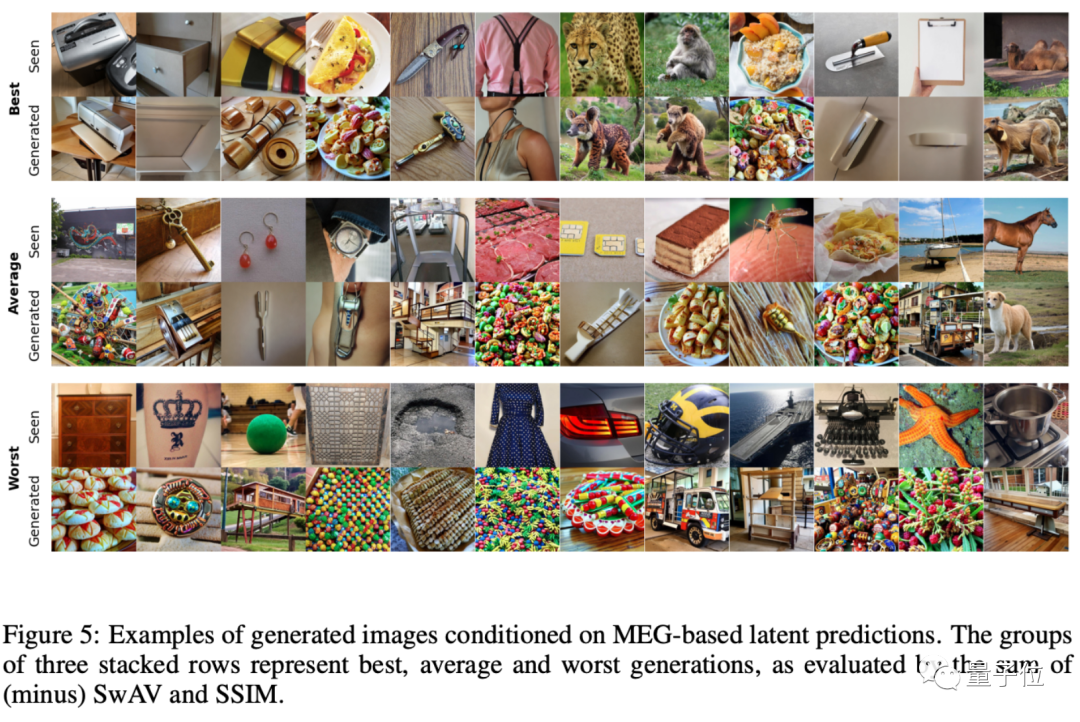

저자는 전체 생성된 이미지를 가장 높은 일치도, 중간 일치도 및 가장 낮은 일치도의 세 가지 주요 범주로 나누었습니다.

Pictures 그러나 생성된 예제에서 보면 , 이 AI에 의해 복원된 이미지 효과는 실제로 그다지 좋지 않습니다.

그러나 생성된 예제에서 보면 , 이 AI에 의해 복원된 이미지 효과는 실제로 그다지 좋지 않습니다.

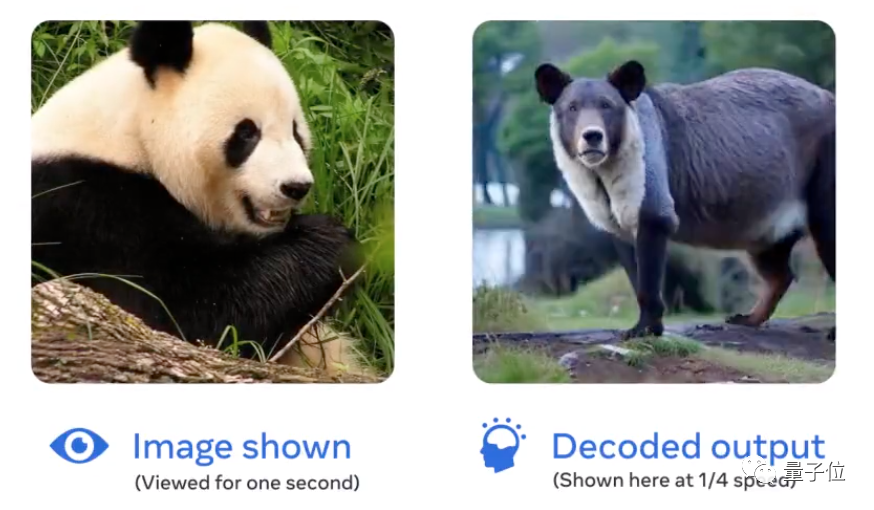

가장 복원된 이미지라도 일부 네티즌들은 여전히 의문을 제기하고 있습니다. 팬더는 왜 팬더처럼 보이지 않나요?

Pictures

Pictures

작가는 이렇게 말했습니다. 적어도 흑백 곰처럼요. (팬더가 화났어요!)

Pictures 물론 연구자들도 MEG 데이터에서 복원된 이미지 효과가 현재로서는 그다지 좋지 않으며 가장 큰 장점은 속도라는 점을 인정합니다.

물론 연구자들도 MEG 데이터에서 복원된 이미지 효과가 현재로서는 그다지 좋지 않으며 가장 큰 장점은 속도라는 점을 인정합니다.

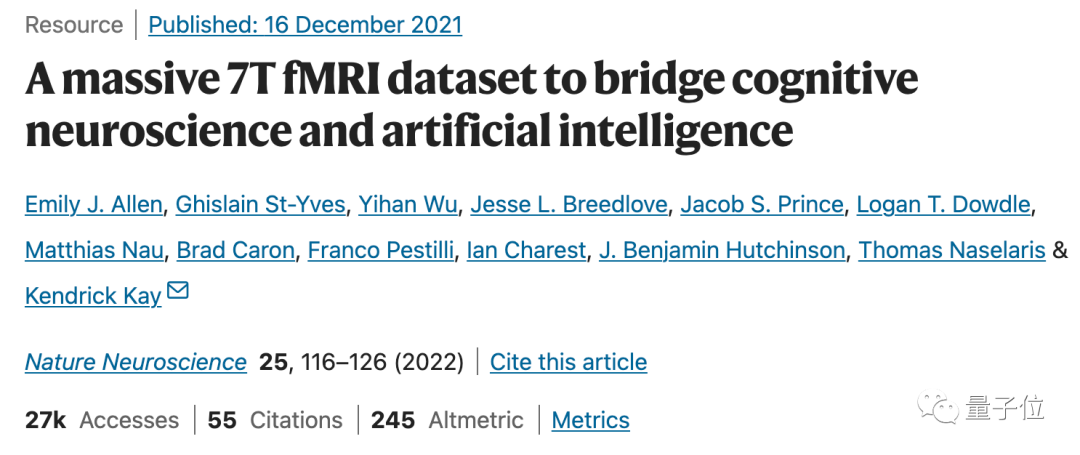

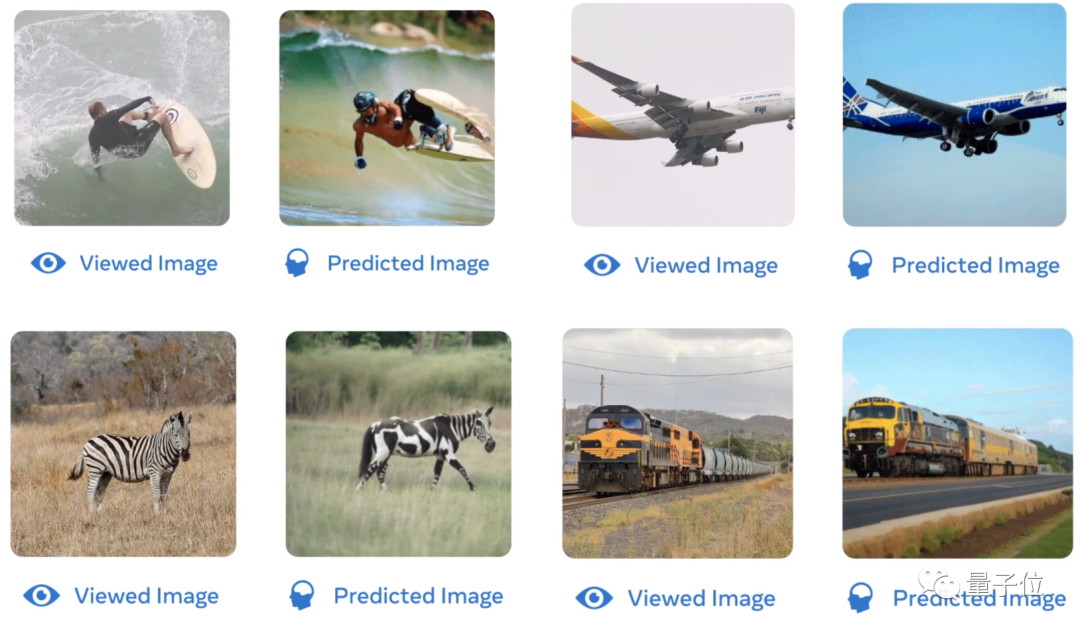

예를 들어 미네소타 대학 및 기타 기관의 7T fMRI라는 이전 연구에서는 fMRI 데이터에서 인간의 눈에 보이는 이미지를 높은 복구율로 복원할 수 있습니다.

사진

사진

인간의 서핑 움직임이든, 비행기의 모양, 얼룩말의 색깔, 기차의 배경이든 fMRI 데이터를 기반으로 훈련된 AI는 이미지를 더 잘 복원할 수 있습니다.

Pictures

Pictures

이에 대해서도 저자들은 MEG를 기반으로 AI가 복원한 시각적 특징이 상대적으로 발달했기 때문이라고 설명했다.

그러나 이에 비해 7T fMRI는 이미지에서 하위 수준의 시각적 특징을 추출하고 복원할 수 있으므로 생성된 이미지의 전체적인 복원률이 더 높습니다.

이런 유형의 연구가 어디에 사용될 수 있다고 생각하시나요?

논문 주소:

https://www.php.cn/link/f40723ed94042ea9ea36bfb5ad4157b2

위 내용은 AI는 뇌 신호를 실시간으로 해석하고 LeCun이 전달한 7배 속도로 이미지의 주요 시각적 특징을 복원합니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!