Transformer의 상황별 학습 기능의 원천은 무엇입니까?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-09-18 08:01:141491검색

트랜스포머의 성능이 왜 이렇게 좋은가요? 많은 대규모 언어 모델에 제공되는 상황 내 학습 기능은 어디에서 왔습니까? 인공지능 분야에서는 트랜스포머가 딥러닝의 지배적인 모델로 자리 잡았지만, 그 뛰어난 성능에 대한 이론적 근거는 충분히 연구되지 않았습니다.

최근 Google AI, ETH Zurich 및 Google DeepMind의 연구원들은 Google AI의 일부 최적화 알고리즘의 비밀을 밝히기 위해 새로운 연구를 수행했습니다. 본 연구에서 그들은 변압기를 역설계하고 몇 가지 최적화 방법을 찾았습니다. 이 논문의 제목은 "Revealing the Mesa Optimization Algorithm in Transformer"

논문 링크: https://arxiv.org/abs/2309.05858

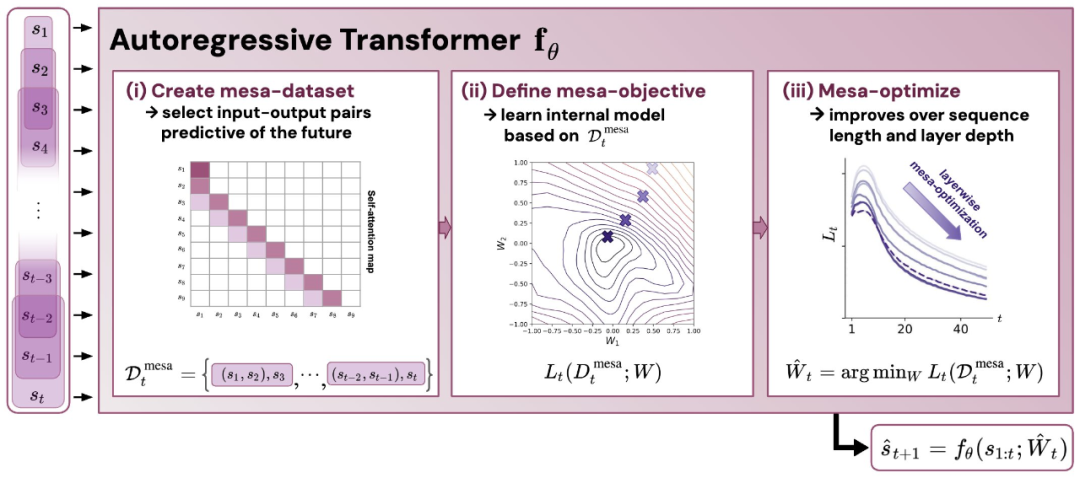

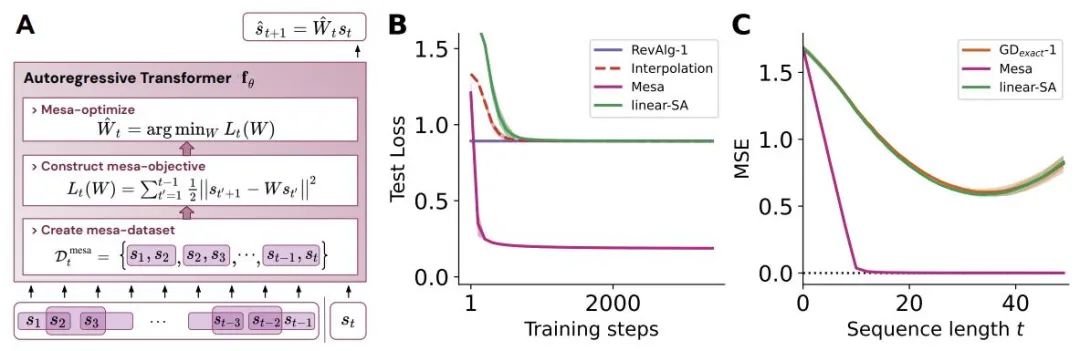

저자는 보편적 자기회귀 손실을 최소화하면 An이 생성된다는 것을 증명합니다. Transformer의 순방향 전달에서 실행되는 보조 기울기 기반 최적화 알고리즘입니다. 이 현상은 최근 "메사 최적화"라고 불립니다. 또한 연구진은 결과적인 메사 최적화 알고리즘이 모델 크기와 관계없이 상황에 맞는 소규모 학습 기능을 나타냄을 발견했습니다. 따라서 새로운 결과는 이전에 대규모 언어 모델에서 나타난 소규모 학습의 원리를 보완합니다.

연구원들은 Transformers의 성공이 (i) 내부 학습 목표 정의 및 (ii) 이를 최적화하는 순방향 패스에서 구현하는 Mesa 최적화 알고리즘의 아키텍처 편견에 기반을 두고 있다고 믿습니다.

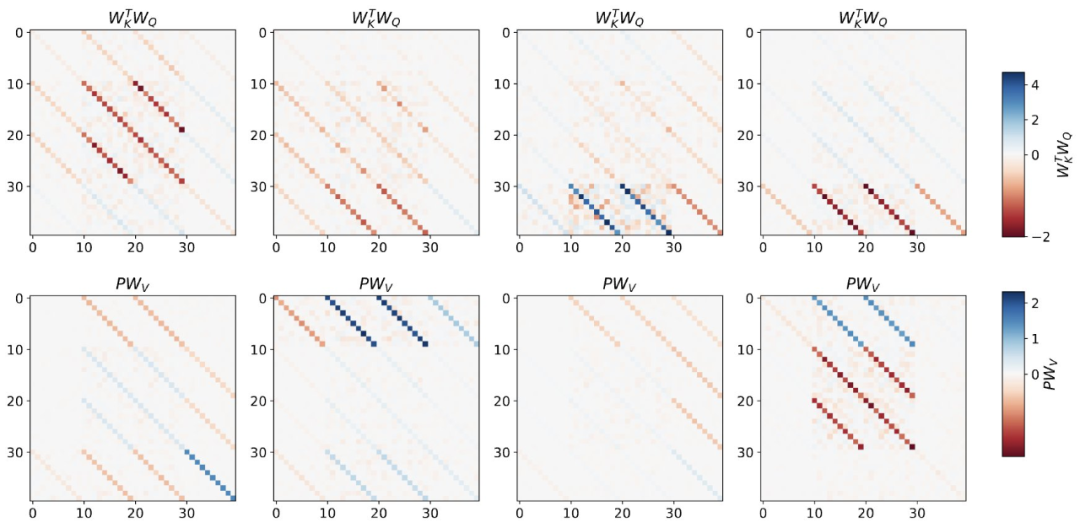

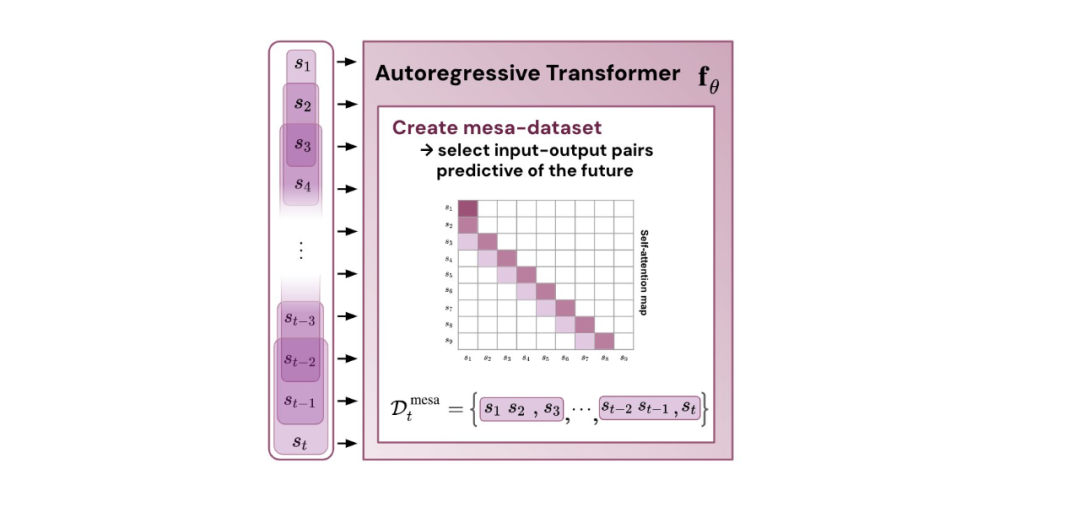

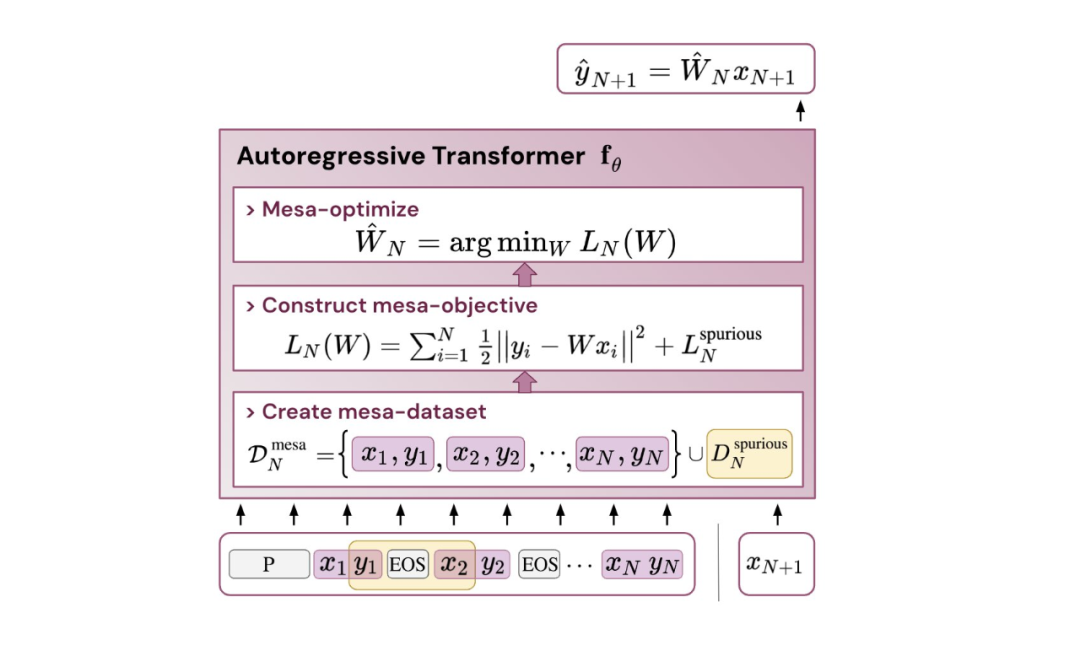

그림 1: 새로운 가설 설명: 자동 회귀 변환기 fθ의 가중치 θ를 최적화하면 모델의 순방향 전파에서 구현되는 메사 최적화 알고리즘이 생성됩니다. 입력 시퀀스로 s_1, . . , s_t는 시간 단계 t로 처리되고, Transformer는 (i) 입력-대상 연관 쌍으로 구성된 내부 훈련 세트를 생성하고, (ii) 결과 데이터 세트를 통해 내부 목적 함수를 정의하며, 이는 내부 모델의 성능을 측정하는 데 사용됩니다. 가중치 W 사용, (iii) 이 목표를 최적화하고 학습된 모델을 사용하여 미래 예측을 생성합니다 .

.

이 연구의 기여는 다음과 같습니다.

- von Oswald 등의 이론을 일반화하고 Transformer가 그라데이션 기반 방법을 사용하여 회귀로부터 내부적으로 구성된 목표를 이론적으로 최적화할 수 있는 방법을 보여줍니다. 순서.

- 실험적으로 역설계된 Transformer는 간단한 시퀀스 모델링 작업에 대해 교육을 받았으며 순방향 전달이 2단계 알고리즘을 구현한다는 강력한 증거를 발견했습니다. (i) 그룹화 및 복사 마커를 통한 초기 self-attention 레이어가 내부 교육 데이터 세트를 구축하므로 내부 훈련 데이터 세트는 암시적으로 구축됩니다. 내부 목적 함수를 정의하고 (ii) 더 깊은 수준에서 이러한 목표를 최적화하여 예측을 생성합니다.

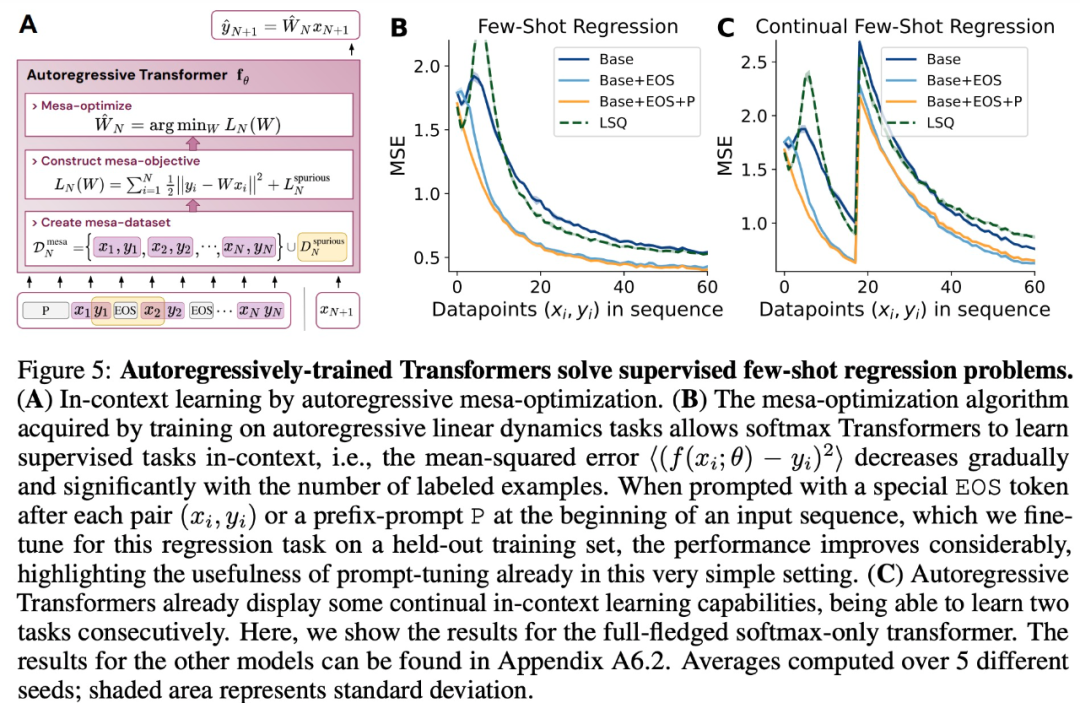

- LLM과 유사하게 실험에 따르면 간단한 자동 회귀 훈련 모델도 상황 학습자가 될 수 있으며 즉각적인 조정은 LLM의 상황 학습을 개선하는 데 중요하며 특정 환경에서도 성능을 향상할 수 있습니다.

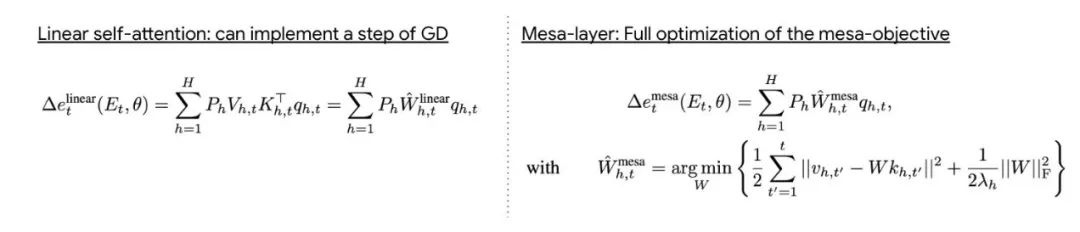

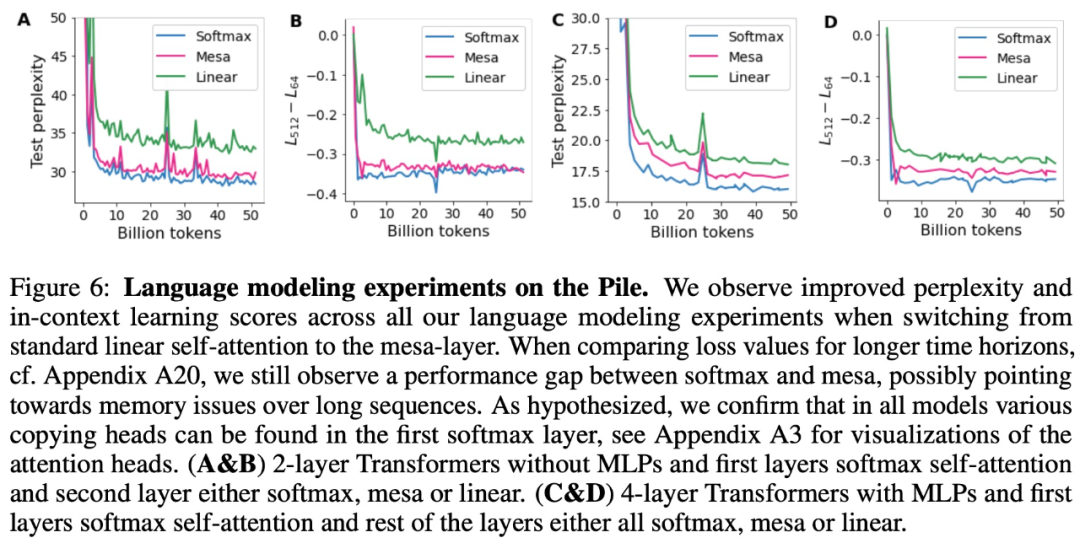

- Attention 레이어가 내부 목적 함수를 암시적으로 최적화하려고 한다는 발견에서 영감을 받아 저자는 단일 그래디언트 단계를 수행하는 대신 최소 제곱 최적화 문제를 효과적으로 해결할 수 있는 새로운 유형의 Attention 레이어인 메사 레이어를 소개합니다. 최적성을 달성하기 위해. 실험에 따르면 단일 메사 레이어는 간단한 순차 작업에서 심층 선형 및 소프트맥스 셀프 어텐션 트랜스포머보다 성능이 뛰어나면서도 더 많은 해석 가능성을 제공하는 것으로 나타났습니다.

- 예비 언어 모델링 실험 후, 표준 self-attention 레이어를 메사 레이어로 대체하여 유망한 결과를 얻었으며 이 레이어가 강력한 상황별 학습 기능을 가지고 있음을 입증했습니다.

상황에 맞게 소규모 작업을 해결하도록 명시적으로 훈련된 변환기가 경사하강법(GD) 알고리즘을 구현할 수 있음을 보여주는 최근 연구를 기반으로 합니다. 여기에서 저자는 이러한 결과가 LLM 교육에 대한 일반적인 접근 방식인 자동 회귀 시퀀스 모델링으로 일반화됨을 보여줍니다.

먼저 단순 선형 동역학으로 훈련된 Transformer를 분석합니다. 이 경우, 각 시퀀스는 교차 시퀀스 기억을 방지하기 위해 서로 다른 W*에 의해 생성됩니다. 이 간단한 설정에서 연구원들은 Transformer가 메사 데이터세트를 생성하고 사전 처리된 GD를 사용하여 메사 목표를 최적화하는 방법을 보여줍니다.

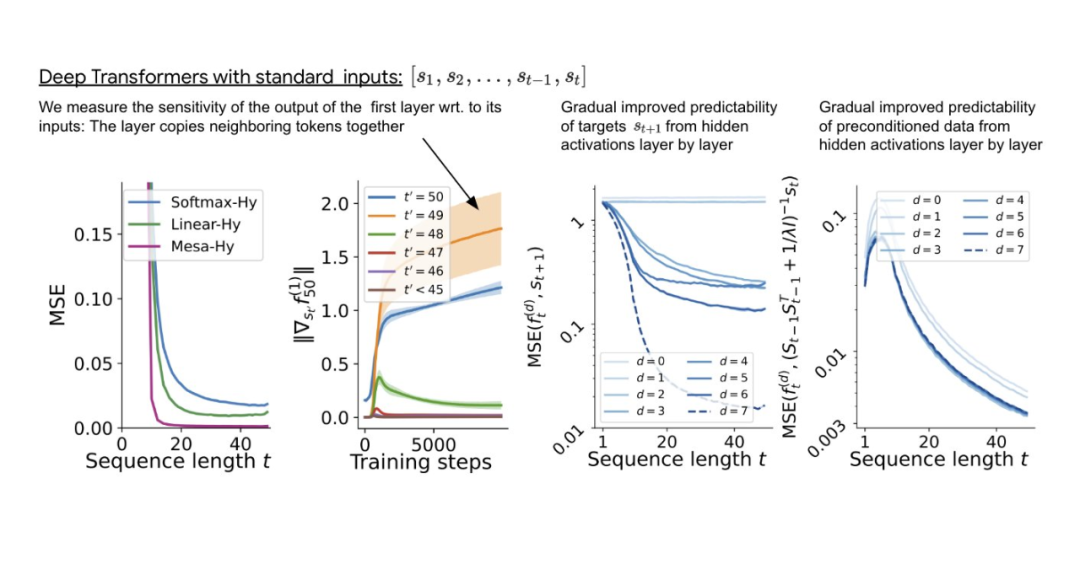

다시 작성된 내용은 다음과 같습니다. 심층 변환기를 훈련하여 인접한 시퀀스 요소의 토큰 구조를 집계할 수 있습니다. 흥미롭게도 이 간단한 전처리 방법은 매우 희박한 가중치 행렬(가중치의 1% 미만이 0이 아님)을 생성하여 역공학 알고리즘을 생성합니다

단일 레이어 선형 self-attention의 경우 가중치는 다음에 해당합니다. 경사하강법 단계. Deep Transformer의 경우 해석이 어려워집니다. 이 연구는 선형 프로빙에 의존하고 숨겨진 활성화가 자동 회귀 목표 또는 전처리된 입력을 예측할 수 있는지 조사합니다

흥미롭게도 두 프로빙 방법의 예측 가능성은 네트워크 깊이가 증가함에 따라 점차 향상됩니다. 이 발견은 전처리된 GD가 모델에 숨겨져 있음을 시사합니다.

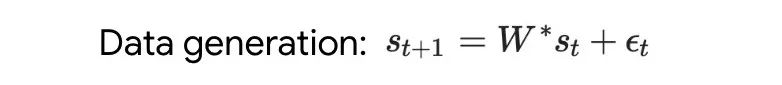

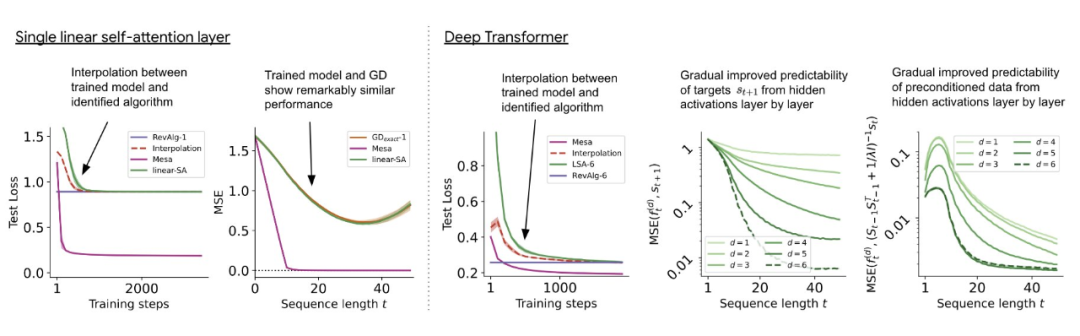

그림 2: 훈련된 선형 self-attention 레이어의 역엔지니어링.

연구에 따르면 학습된 학습률 θ뿐만 아니라 학습된 초기 가중치 W_0 세트를 포함하여 구성의 모든 자유도를 사용할 때 훈련 레이어가 완벽하게 적합할 수 있음이 밝혀졌습니다. 중요한 것은 그림 2에서 볼 수 있듯이 학습된 1단계 알고리즘이 여전히 단일 메사 레이어보다 훨씬 더 나은 성능을 발휘한다는 것입니다.

간단한 가중치 설정을 통해 이 레이어가 이 연구 작업을 최적으로 해결할 수 있다는 것을 기본 최적화를 통해 쉽게 찾을 수 있음을 알 수 있습니다. 이 결과는 하드코딩 유도 바이어스가 메사 최적화에 유익하다는 것을 증명합니다.

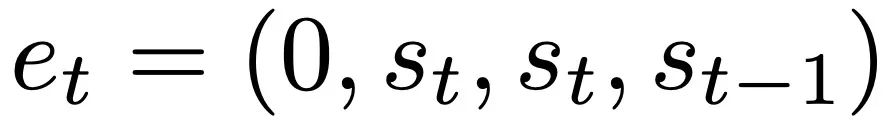

다층 사례에 대한 이론적 통찰력을 바탕으로 먼저 심층 선형 및 소프트맥스를 분석하고 Transformer에만 주목하세요. 저자는 W_0 = 0 선택에 해당하는 4채널 구조  에 따라 입력 형식을 지정합니다.

에 따라 입력 형식을 지정합니다.

단일 레이어 모델과 마찬가지로 저자는 훈련된 모델의 가중치에서 명확한 구조를 확인합니다. 첫 번째 리버스 엔지니어링 분석으로 이 연구는 이 구조를 활용하고 레이어 헤더당(3200 대신) 16개의 매개변수를 포함하는 알고리즘(RevAlg-d, 여기서 d는 레이어 수를 나타냄)을 구축합니다. 저자는 이 압축되었지만 복잡한 표현이 훈련된 모델을 설명할 수 있다는 것을 발견했습니다. 특히 실제 Transformer와 RevAlg-d 가중치 사이를 거의 무손실 방식으로 보간할 수 있습니다.

RevAlg-d 표현식은 소수의 자유 매개변수를 사용하여 훈련된 다층 Transformer를 설명하지만 이를 이해하기는 어렵습니다. 설명은 메사 최적화 알고리즘입니다. 따라서 저자는 가설화된 메사 최적화 알고리즘의 특성을 찾기 위해 선형 회귀 프로빙 분석(Alain & Bengio, 2017; Akyürek et al., 2023)을 사용했습니다.

그림 3에 표시된 Deep Linear Self-Attention Transformer에서는 두 프로브 모두 선형 디코딩이 가능하며 시퀀스 길이와 네트워크 깊이가 증가함에 따라 디코딩 성능도 향상되는 것을 확인할 수 있습니다. 따라서 우리는 메사 최적화 문제의 조건수를 개선하면서 원래의 메사 목표 Lt(W)를 기반으로 레이어별로 하강하는 기본 최적화 알고리즘을 발견했습니다. 이로 인해 메사 목표 Lt(W)가 급격히 감소합니다. 또한, 깊이가 증가함에 따라 성능이 크게 향상되는 것을 관찰할 수 있습니다.

데이터의 더 나은 전처리를 통해 자동 회귀 목적 함수 Lt(W)는 (레이어 전체에 걸쳐) 단계적으로 최적화될 수 있으므로 급격한 감소를 고려할 수 있습니다. 이는 이러한 최적화를 통해 달성됩니다

그림 3: 구성된 토큰 입력의 리버스 엔지니어링을 위한 다층 변환기 교육.

이는 변환기가 내장된 토큰에 대해 교육을 받으면 메사 최적화를 통해 예측한다는 것을 보여줍니다. 흥미롭게도 시퀀스 요소가 직접 주어지면 변환기는 요소를 그룹화하여 자체적으로 토큰을 구성하는데, 연구팀은 이를 "메사 데이터 세트 생성"이라고 부릅니다.

결론

이 연구 결과는 표준 자동 회귀 목표 하에서 시퀀스 예측 작업을 위해 Transformer 모델을 사용하여 훈련할 때 경사 기반 추론 알고리즘을 개발할 수 있다는 것입니다. 따라서 최신 다중 작업 및 메타 학습 결과는 전통적인 자기 지도 LLM 교육 설정에도 적용될 수 있습니다

또한 연구에서는 학습된 자기회귀 추론 알고리즘을 재교육 없이도 재조정할 수 있다는 사실도 발견했습니다. 지도 상황별 학습 과제를 해결하여 통합 프레임워크 내에서 결과를 해석합니다

이 중 상황별 학습과 어떤 관련이 있나요? 연구에 따르면 변환기 모델을 훈련한 후 자동 회귀 시퀀스 작업에서 적절한 메사 최적화를 달성하므로 미세 조정 없이 소수 상황 학습을 수행할 수 있습니다

연구에서는 LLM도 존재한다고 가정합니다. 메사 최적화를 통해 상황별 학습 능력을 향상시킵니다. 흥미롭게도 이 연구에서는 LLM에 대한 프롬프트를 효과적으로 적용하면 상황별 학습 능력이 크게 향상될 수 있다는 점도 관찰했습니다.

관심 있는 독자는 논문의 원문을 읽고 연구 내용에 대해 자세히 알아볼 수 있습니다.

위 내용은 Transformer의 상황별 학습 기능의 원천은 무엇입니까?의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!