할말이 있으면 말해주세요! Google 로봇은 대규모 언어 모델을 '먹은' 후 스스로 학습하고 생각할 수 있습니다.

- 王林앞으로

- 2023-05-04 14:13:061080검색

"홀로 가도 돼, 주방으로 가도 돼" 이상적인 친절한 아내에 대한 칭찬이고, 아마 앞으로는 구글의 로봇들에게 이 말을 하게 될 것 같습니다.

큰 언어 모델을 탑재하고 스스로 학습할 수 있는 로봇을 본 적이 있나요? 어떻게 해야 할지 모르시나요? 배울 수 있어요! 지금은 몰라도 시간이 지나면 할 수 있을 것입니다.

칼의 산을 오르고, 불바다로 내려오고, 산과 능선을 평지를 걷듯 오르는 보스턴 다이나믹스의 엄청나게 멋진 '아이언 마스크드 킹콩'에 비해 이번에는 구글의 " 학습 로봇'은 주변의 배려하는 작은 조수와 같습니다. 내가 말하는 것과 당신이 하는 것은 로봇이 명령을 실행하는 일반적인 루틴입니다. 이번에 Google의 새로운 연구를 통해 로봇은 지시를 따를 뿐만 아니라 스스로 수행할 수도 있습니다.

Google이 대규모 언어 모델을 로봇과 결합하여 로봇에게 인간과 동일한 작업을 수행하도록 가르치는 것은 이번이 처음입니다.

논문 주소: https://arxiv.org/pdf/2204.01691.pdfGoogle 논문 제목 사용: "Do as I can, not as I say".

아마도 다음과 같은 의미일 것입니다: "당신은 이미 성숙한 로봇입니다. 당신은 내가 하는 일을 할 수 있습니다. 모르면 배울 수 있습니다. 익숙하지 않다면 연습하면 됩니다!" 구글은 이 로봇의 이름을 PaLM-SayCan으로 명명했습니다. 워싱턴포스트(Washington Post) 보고서에서 기자는 연구원들이 로봇에게 플라스틱 장난감 재료를 사용해 버거를 만들도록 요청하는 것을 보았다. 이 로봇 팔은 고기를 넣은 후, 양상추를 넣기 전에 케첩을 넣어야 한다는 것을 알고 있는 것 같지만, 현재 셰프는 '케첩을 넣는다'는 것은 케첩 병 전체를 버거에 넣는 것을 의미한다고 믿고 있습니다.

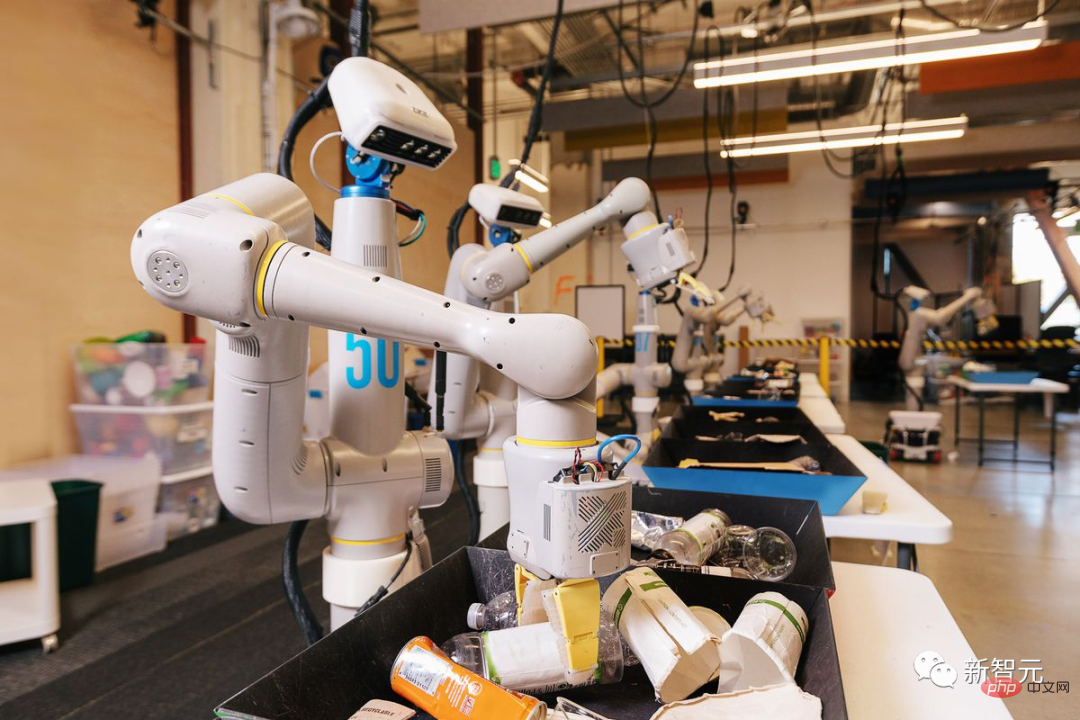

이 로봇 요리사는 아직 자격이 없지만 Google은 대규모 언어 모델의 교육을 통해 햄버거 요리를 배우는 것은 시간 문제일 뿐이라고 믿습니다. 로봇은 또한 세븐업과 코카콜라 캔을 인식하고 서랍을 열고 감자칩 봉지를 찾을 수도 있습니다. PaLM의 추상화 기능을 사용하면 노란색, 녹색, 파란색 그릇을 각각 사막, 정글, 바다에 비유할 수 있다는 사실도 이해할 수 있습니다.

과거에는 버거, 볶음면, 피자를 만드는 로봇이 있었지만 실제로는 "이동"과 같은 단일 동작에 대한 명확한 지시의 조합을 완성했습니다. 오른팔을 왼쪽으로 세 칸.", "뒤집어" 등 구글의 현재 목표는 '와서 햄버거 만들어줘', '배고프다, 가서 빵 사줘', '나가서 나랑 공놀이해' 등의 명령을 로봇이 이해하고 실행할 수 있도록 하는 것이다. 누군가와 대화하는 것 같아요.

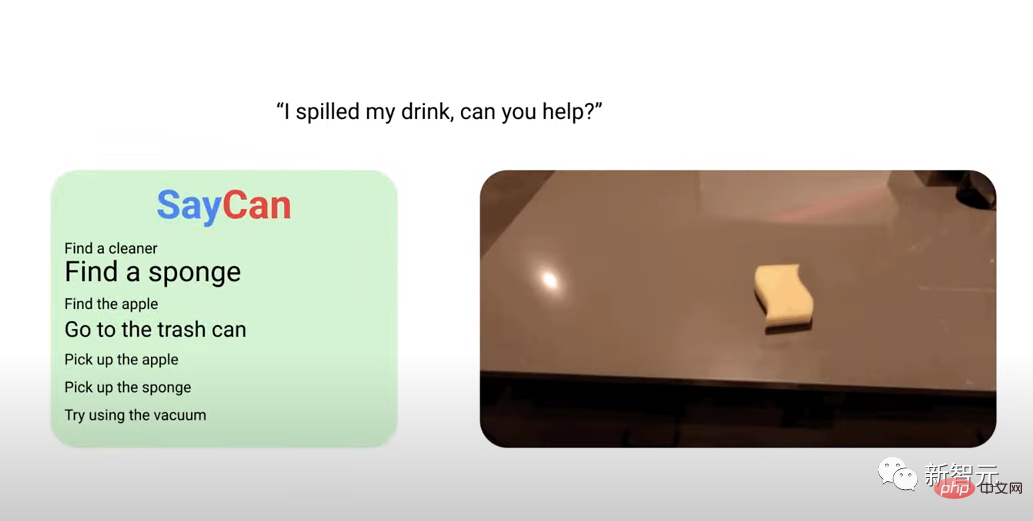

예를 들어, Google 인공지능 연구원이 PaLM-SayCan 로봇에게 "내 음료수가 흘렀는데 도와줄 수 있나요?"라고 말했을 때 로봇은 Google 사무실 건물의 부엌에서 바퀴를 타고 미끄러졌습니다. 카운터에 있는 스펀지를 발견하려면 디지털 카메라로 전동 암으로 스펀지를 잡고 다시 가져오세요.

Google의 Brian Ichter는 "이것은 근본적으로 다른 모델입니다."라고 말했습니다. 그는 그러한 로봇의 새로운 발전을 설명하는 최근 발표된 논문의 저자 중 한 명입니다.

요즘에는 로봇이 더 이상 드물지 않습니다. 수백만 대의 로봇이 전 세계 공장에서 작동하지만 특정 지침을 따르며 한두 가지 작업에만 집중하는 경우가 많습니다. 그러나 일련의 작업을 완료하고 이를 수행하는 동안 학습할 수 있는 로봇을 구축하는 것은 훨씬 더 복잡합니다. 수년 동안 크고 작은 기술 기업들은 이러한 '만능 로봇'을 만들기 위해 열심히 노력해 왔습니다.

최근 몇 년 동안 인기를 끌었던 빅 언어 모델을 통해 Google은 "유니버설 로봇" 개발에 대한 영감을 얻었습니다. 대규모 언어 모델은 인터넷에서 대량의 텍스트를 사용하여 AI 소프트웨어가 특정 질문이나 의견에 따를 수 있는 응답 유형을 추측하도록 훈련합니다.

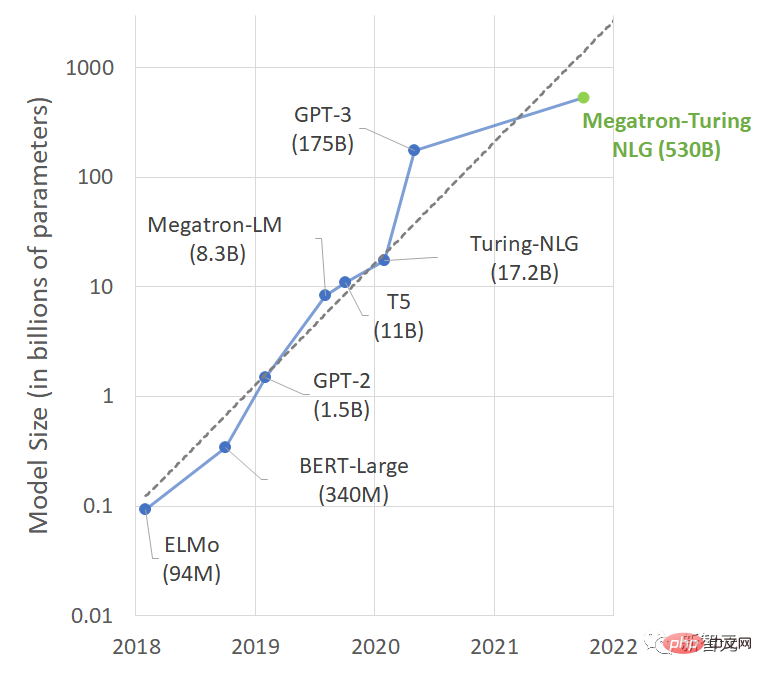

BERT에서 GPT-3 및 이후 MT-NLP에 이르기까지 매개변수 수가 비약적으로 증가함에 따라 이러한 모델은 올바른 응답을 예측하는 데 너무 능숙해져서 하나의 모델을 자주 처리하게 되었습니다. 마치 지식이 풍부한 사람과의 대화처럼 느껴집니다. 지식이 너무 많아서 하루 종일 다른 사람들과 이야기만 나누는 것은 아쉽지 않을까요? 말할 수 있으면 일도 할 수 있다. 챗봇부터 보조 로봇까지, 구글의 연구 아이디어는 자연스럽게 나온 것이라고 할 수 있다.

PaLM-SayCan의 장점은 무엇인가요?

이번에 구글 AI는 구글 모회사인 알파벳의 문샷 X 팀이 런칭한 Everyday Robot 프로젝트와 협업하여 방법을 제안했습니다. 즉, 사전 학습을 통해 LLM(대형 언어 모델)에서 지식을 추출하여 로봇이 높은 수준의 텍스트 지침을 따라 물리적 작업을 완료할 수 있도록 합니다.

Everyday Robot 프로젝트는 수년간 진행되어 왔으며 Google AI를 사용하는 많은 팀원이 2015년 또는 2016년에 Alphabet에 합류했습니다. 아이디어는 로봇이 직면할 수 있는 모든 잠재적 상황을 가르쳐주지 않고도 카메라와 정교한 기계 학습 알고리즘을 사용하여 주변 세계를 보고 배우도록 하는 것입니다.

Google의 아이디어는 다음과 같습니다. 대규모 언어 모델은 세상에 대한 풍부한 의미론적 지식을 인코딩할 수 있으며, 이는 자연어 작업을 수행하도록 설계된 로봇에 매우 유용합니다. LLM의 명백한 단점은 "실제 경험이 부족하다"는 것입니다. 실험실에서 완벽하게 수행된다면 실제 생활에서는 쓸모가 없을 수도 있습니다.

따라서 연구자들은 환경에 맞는 자연어 동작을 완료하도록 모델을 제약하기 위해 "사전 훈련 기술을 통한 실제 기반 제공"을 권장합니다.

로봇은 언어 모델의 "손과 눈" 역할을 할 수 있으며, 언어 모델은 작업에 대한 높은 수준의 의미 지식/실제 경험을 제공합니다.

Google은 PaLM(Pathways Language Model)을 교육하기 위해 거대한 6144 프로세서 시스템을 사용했습니다. 교육 리소스에는 Microsoft GitHub 사이트에 있는 대규모 다국어 웹 문서 컬렉션, 서적, Wikipedia 기사, 대화 및 프로그래밍 코드가 포함됩니다. 이렇게 훈련된 AI 에이전트는 자신만의 사고 사슬에 따라 농담을 설명하고, 문장을 완성하고, 질문에 답하고 추론할 수 있다.

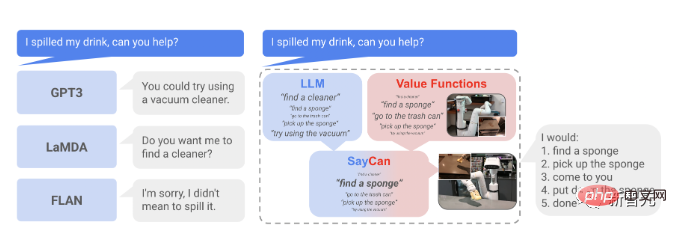

다음 질문은 이 에이전트가 로봇에 사용된다면 어떻게 LLM(Large Language Model)의 지식을 추출하고 활용하여 물리적 작업을 완료할 것인가 하는 것입니다. 예를 들어, 음료수를 쏟은 경우 GPT-3는 진공 청소기를 사용해도 된다고 말하고 LaMDA는 청소기를 찾아달라고 요청합니다. (매우 혼란스럽습니다.)

대형 언어 모델은 실제 환경과 상호 작용하지 않기 때문에 이 작업에 응답할 수 없습니다. LLM 기반의 SayCan이 사전 학습된 모델을 통해 형성한 가치판단 능력은 복잡하고 실제적인 환경에서도 지시를 처리할 수 있습니다.

이 예에서 영감을 받아 로봇이 고급 텍스트 지침을 따를 수 있도록 LLM에서 지식을 추출하는 방법에 대한 문제를 연구했습니다. 로봇은 낮은 수준의 시각 운동 제어가 가능한 "원자적" 행동에 대한 일련의 학습 기술을 갖추고 있습니다. LLM에게 단순히 지침을 설명하도록 요청하는 것 외에도 이를 사용하여 개인의 기술이 높은 수준의 지침을 완료하는 데 진전을 이룰 가능성을 평가할 수도 있습니다.

각 스킬에 어포던스 함수가 있다고 가정하면 현재 상태에서의 성공 확률을 정량화할 수 있고(예: 가치 함수 학습) 이 값을 통해 스킬의 확률을 측정할 수 있습니다. 이러한 방식으로 LLM은 지침 완료에 대한 각 기술의 기여 확률에 대한 설명을 완성합니다.

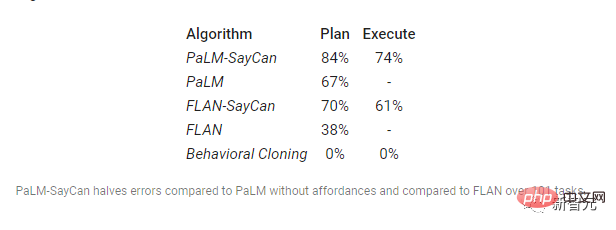

연구원들은 시스템 성능을 평가하기 위해 두 가지 지표를 사용했습니다.

(1) 로봇이 지시에 맞는 올바른 기술을 선택했는지 여부를 나타내는 계획 성공률; 2) 실행 성공률, 명령을 성공적으로 실행했는지 여부를 나타냅니다.

데이터를 보면 PaLM-SayCan의 명령 실행률도 전체 모델 중 가장 높은 것으로 나타났습니다.

위험: 로봇공학에 실패하면 어떻게 해야 하나요?

아이디어는 훌륭하지만 이 작업에는 위험이 없지는 않습니다. 대형 언어 모델의 학습 코퍼스는 인터넷에서 가져오며, 일부 언어 모델은 인종차별이나 성차별 등 부정적인 경향을 보여 때로는 증오심 표현이나 거짓말을 게재하도록 유도되기도 합니다. 이 모델을 챗봇 훈련에 사용하면 욕하고 험담할 수 있는 음성 어시스턴트가 탄생할 것입니다. 하지만 손과 발이 있어 나쁜 짓을 하는 로봇을 훈련시키는 데 사용된다면 어떨까요?그리고 이보다 더 위험한 것은 이렇게 훈련된 로봇이 의식을 갖게 되면 통제 불능 상태가 될 수 있다는 것입니다(비슷한 공상과학 영화가 많습니다).

올해 7월 한 구글 직원은 소프트웨어가 살아있는 직원이라고 주장했다. AI 전문가들 사이에서는 이러한 모델이 살아 있지 않다는 데 동의하고 있지만, 필터링되지 않은 대량의 인간 생성 텍스트에 대해 훈련을 받았기 때문에 많은 사람들이 이러한 모델이 편견을 보일 것이라고 우려합니다.

그럼에도 불구하고 Google은 계속 열심히 노력하고 있으며 이제 연구자들은 더 이상 로봇의 각 작업에 대해 구체적인 기술 지침을 코딩할 필요가 없고 일상 언어로 더욱 간단하게 대화할 수 있습니다. 게다가 새로운 소프트웨어는 로봇이 스스로 복잡한 다단계 지침을 구문 분석하는 데 도움을 줄 수 있습니다.

이제 로봇은 이전에 들어본 적 없는 지시를 해석하고 스스로 의미 있는 반응과 행동을 할 수 있습니다.

아마도 로봇에게는 새로운 문이 열렸고, 미래는 아직 긴 과정일 수도 있습니다. 신경망 및 강화 학습과 같은 인공 지능 기술은 수년 동안 로봇을 훈련시키는 데 사용되었습니다. 몇 가지 획기적인 진전이 있었지만 진전은 여전히 느립니다.

Google의 로봇은 실제 사용 준비가 아직 멀었습니다. 연구원들은 로봇이 아직 실험실 단계에 있으며 상용화할 계획이 없다고 반복해서 말했습니다.

위 내용은 할말이 있으면 말해주세요! Google 로봇은 대규모 언어 모델을 '먹은' 후 스스로 학습하고 생각할 수 있습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!