AI 도구가 사이버 범죄자들에게 인기 있는 상품이 되고 있습니까? 연구에 따르면 러시아 해커가 ChatGPT에 액세스하기 위해 OpenAI 제한을 우회하고 있는 것으로 나타났습니다.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB앞으로

- 2023-04-12 13:19:051262검색

업계 언론 보도에 따르면 OpenAI는 강력한 챗봇인 ChatGPT가 범죄 행위에 이용될 수 있다는 우려로 인해 일부 국가 및 지역에서 적용을 제한했습니다. 그러나 연구 결과에 따르면 러시아의 일부 사이버범죄자들은 ChatGPT를 도입하기 위해 기존 제한을 우회하는 새로운 방법을 모색하고 있으며, IP, 결제카드, 전화번호 제한을 우회하는 사례도 발견됐다.

연구원들은 해커 포럼에서 러시아 해커가 ChatGPT에 액세스하기 위해 제한 사항을 우회하려고 시도했다는 증거를 발견했습니다.

ChatGPT는 2022년 11월 출시 이후 개발자, 작가 및 학생을 위한 중요한 작업 흐름 도구가 되었습니다. 또한 해커가 이를 사용하여 악성 코드를 작성하고 피싱 이메일을 개선한다는 증거가 있어 사이버 범죄자가 악용할 수 있는 강력한 무기가 되었습니다.

ChatGPT는 악의적인 목적으로 사용될 수 있습니다. 즉, ChatGPT를 사용하는 해커가 악의적인 공격을 더 빨리 수행할 수 있으므로 OpenAI는 도구 배포 방법을 제한해야 합니다. OpenAI는 지역 차단 조치를 사용하여 러시아 사용자가 시스템에 액세스하는 것을 방지합니다.

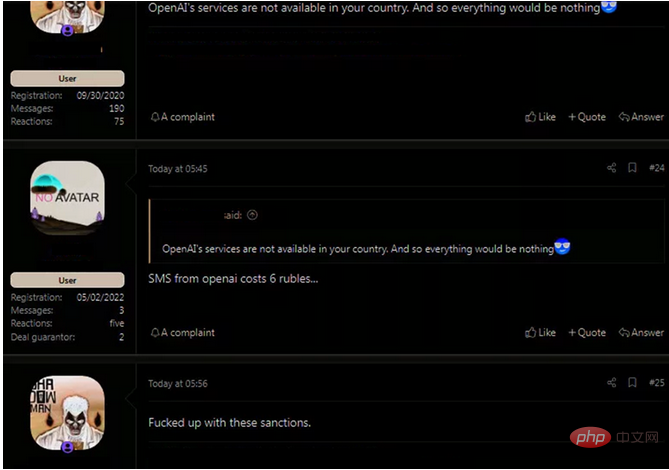

그러나 Check Point Software 연구원들은 러시아 해커들이 지하 해킹 포럼에서 이러한 제한을 우회하는 방법에 대해 이야기하는 여러 사례를 발견했습니다. 예를 들어, 러시아의 한 해커 그룹은 포럼에 질문을 제기했습니다. 정상적으로 ChatGPT에 들어갈 수 없다면 어떻게 도난당한 결제 카드를 사용하여 OpenAI 계정 비용을 지불하고 API를 사용하여 시스템에 액세스할 수 있습니까? 시스템은 현재 무료로 사용할 수 있는 미리보기 상태이며, API에는 세션 중 지불을 위해 토큰을 사용하는 텍스트 및 코드 생성이 포함되어 있습니다.

Check Point의 위협 인텔리전스 부서 관리자인 Sergey Shykevich는 OpenAI의 제한 사항을 우회하는 것이 특별히 어렵지 않다고 말했습니다. “우리는 이미 러시아의 일부 해커들이 지오펜스를 통과하고 악의적인 목적으로 ChatGPT를 사용하는 방법을 논의하고 검토하고 있습니다. . 우리는 이러한 해커들이 사이버 범죄 활동에서 ChatGPT를 테스트하고 채택하려고 시도할 가능성이 있다고 생각합니다. 인공 지능 기술이 사이버 공격을 더욱 효율적으로 만들 수 있기 때문에 사이버 범죄자들은 ChatGPT에 점점 더 관심을 갖고 있습니다.”

이 지하 해킹 포럼은 또한 일부 러시아어- 준합법적인 온라인 문자 메시지 서비스에 대한 언어 튜토리얼과 이를 사용하여 ChatGPT에 등록하는 방법을 통해 ChatGPT가 차단되지 않은 다른 국가에서 사용되고 있는 것처럼 보이게 합니다.

해커는 이러한 포럼을 통해 가상 번호에 대해 2센트만 지불하고 이 번호를 사용하여 OpenAI에서 코드를 얻으면 된다는 점을 배웁니다. 이러한 임시 전화번호는 전 세계 어디에서나 올 수 있으며 필요에 따라 새 번호를 생성할 수 있습니다.

Infostealer 및 ChatGPT의 악의적 사용

이전 조사에서 사이버 범죄자가 불법 활동을 위해 ChatGPT를 악용하는 방법을 해킹 포럼에 게시한 사례가 발견되었습니다. 여기에는 매우 간단한 Infostealer 생성이 포함됩니다. 인공 지능 도구가 더욱 널리 사용됨에 따라 이러한 Infostealer는 더욱 발전할 것입니다.

Infostealer는 이러한 "간단한 도구"를 채택한 예이며 해커 포럼에 "ChatGPT - 악성 코드의 이점"이라는 제목의 게시물이 게시되었습니다. 게시물 작성자는 해커가 ChatGPT를 사용하여 인공 지능 도구에 설명과 보고서를 입력하여 악성 코드를 재현한 다음 일반적인 파일 형식을 검색하고 이를 임의의 파일에 복사하여 업로드하는 Python 기반 도용 코드를 공유할 수 있다고 언급했습니다. 하드코딩된 FTP 서버로 보냅니다.

Shykevich가 말했습니다. "사이버범죄자들은 ChatGPT가 매력적이라고 생각했습니다. 최근 몇 주 동안 우리는 해커들이 ChatGPT를 사용하여 악성 코드를 작성하기 시작했다는 증거를 발견했습니다. ChatGPT는 해커들에게 좋은 출발점을 제공하고 사이버 공격의 진행 속도를 높일 수 있는 잠재력을 가지고 있습니다. ChatGPT는 다음과 같이 할 수 있습니다. 개발자가 코드를 작성하는 데 도움이 되는 것처럼 악의적인 목적으로 사용될 수도 있습니다.”

OpenAI는 가능한 요청 유형을 제한하는 등 ChatGPT 사용을 제한하는 조치를 취했다고 밝혔습니다. 놓치다. 또한 해당 팁이 ChatGPT를 "스푸핑"하여 연구를 가장하거나 가상의 예제로 잠재적으로 유해한 코드 예제를 제공하는 데 사용된다는 증거도 있습니다.

ChatGPT 및 잠재적인 잘못된 정보

한편 OpenAI는 Georgetown University의 Center for Security and Emerging Technologies 및 Stanford Internet Observatory와 협력하여 대규모 언어 모델(예: ChatGPT의 기본 GPT-3)이 어떻게 사용될 수 있는지 조사하고 있습니다. 거짓 정보.

이 모델을 사용하면 영향력 있는 작전 운영 비용을 절감하여 새로운 유형의 사이버 범죄자가 통제할 수 있도록 유지할 수 있습니다. 이전에는 대규모 행위자만이 이러한 유형의 콘텐츠에 액세스할 수 있었습니다. 마찬가지로 텍스트 생성을 자동화할 수 있는 채용 담당자는 새로운 경쟁 우위를 얻을 수 있습니다.

해커가 ChatGPT를 사용하면 다른 행동으로 이어질 수도 있고, 사이버 공격 규모가 증가할 수 있으며, 수동 생성에 비해 더욱 개인화되고 표적화된 콘텐츠를 생성할 수 있습니다. 궁극적으로 그들은 해커가 대상의 언어 또는 문화에 대해 필요한 지식이 부족할 수 있는 대부분의 인간 생성 선전 문서에 비해 텍스트 생성 도구가 더 영향력 있고 설득력 있는 메시지를 생성할 수 있다는 것을 발견했습니다.

OpenAI 연구원들은 다음과 같이 선언합니다. “우리의 기본적인 판단은 언어 모델이 브랜드 전도사에게 유용하고 온라인 인플루언서 운영을 변화시킬 수 있다는 것입니다. 심지어 가장 진보된 모델도 암호화되거나 API(애플리케이션 프로그래밍 인터페이스) 액세스를 통해 옹호자들도 유혹을 받을 수 있습니다. 오픈소스 대안을 채택하세요.”

위 내용은 AI 도구가 사이버 범죄자들에게 인기 있는 상품이 되고 있습니까? 연구에 따르면 러시아 해커가 ChatGPT에 액세스하기 위해 OpenAI 제한을 우회하고 있는 것으로 나타났습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!