ChatGPT로 대표되는 대규모 언어 모델의 인기로 인해 보안에 대한 사람들의 불안은 점점 더 분명해졌습니다. 이탈리아가 3월 31일 개인 정보 보호 및 보안 문제로 ChatGPT를 일시적으로 금지했다고 발표한 후, 캐나다도 4월 4일 ChatGPT 모회사인 OpenAI에서 데이터 보안 문제를 조사 중이라고 발표했습니다. 지난 4월 5일, OpenAI 공식 블로그에는 사람들의 우려에 대한 부차적인 대응이라고 볼 수 있는 AI의 보안을 어떻게 보장하는지에 초점을 맞춘 기사가 업데이트되었습니다.

GPT-4 테스트에 6개월이 걸렸습니다

기사에는 최신 GPT-4 모델을 완전히 트레이닝한 후 팀이 내부 테스트에 6개월 이상을 투자했다고 언급되어 있습니다. 강력한 인공지능 시스템이 대중에게 공개되고, 강력한 인공지능 시스템이 엄격한 보안 평가를 거쳐야 한다고 생각한다면, 감독 보장을 기반으로 최선의 감독 방법을 마련하기 위해 정부와 적극적으로 협력해야 합니다.

기사에서는 실험 테스트 과정에서 모든 위험을 예측하는 것은 불가능하지만 AI는 더 안전한 버전을 반복하기 위해 지속적으로 경험을 학습하고 실제 사용에서 개선해야 하며 사회가 점점 더 적응할 시간이 필요하다고 믿고 있다고 언급했습니다. 강력한 AI.

어린이 보호에 주의하세요

기사에서는 안전 작업의 핵심 중 하나가 어린이를 보호하는 것이라고 밝혔습니다. AI 도구를 사용하는 사용자는 18세 이상이거나 부모의 감독 하에 있는 13세 이상이어야 합니다.

OpenAI는 증오, 괴롭힘, 폭력 또는 성인용 콘텐츠를 생성하는 데 자사 기술을 사용하는 것을 허용하지 않는다고 강조합니다. GPT-3.5에 비해 GPT-4는 금지된 콘텐츠에 대한 응답 거부 능력이 82% 향상되었습니다. 사용자가 영상 도구에 아동 성적 학대 자료를 업로드하려고 시도하는 경우와 같이 학대 가능성을 감지하기 위해 모니터링 시스템을 통과하며, 이는 차단되고 국립실종착취아동센터에 보고됩니다.

개인 정보 보호를 존중하고 사실의 정확성을 높입니다.

기사에 따르면 OpenAI의 대규모 언어 모델은 공개적으로 사용 가능한 콘텐츠, 라이선스가 부여된 콘텐츠, 인간 검토자가 생성한 콘텐츠를 포함한 광범위한 텍스트 코퍼스에서 훈련되었으며 사용되지 않을 것입니다. 데이터가 사용됩니다. 서비스 판매, 광고 및 사용자 보관. OpenAI는 훈련 과정에서 공용 인터넷에서 개인정보를 수집한다는 사실을 인정하지만, 가능한 경우 훈련 데이터 세트에서 개인정보를 제거하고, 개인정보 요청을 거부하도록 모델을 미세 조정하며, 다음 요청에 적극적으로 대응하도록 노력할 것입니다. 시스템에 관련된 개인을 제거합니다. 정보 콘텐츠를 요청합니다.

제공되는 콘텐츠의 정확성 측면에서 기사에서는 허위 콘텐츠 표시에 대한 사용자 피드백을 통해 GPT-4에서 생성된 콘텐츠의 정확성이 GPT-3.5보다 40% 더 높다고 밝혔습니다.

기사에서는 AI 보안 문제를 해결하는 실제 방법은 효과적인 완화 기술을 연구하고 실험 환경의 실제 사용 시나리오에서 남용을 테스트하기 위해 더 많은 시간과 자원을 투자하는 것뿐만 아니라 더 중요한 것은 보안과 능력을 향상시키는 것이라고 믿습니다. AI 개선 OpenAI는 가장 강력한 AI 모델과 최고의 보안 보호 기능을 결합하고 더욱 주의를 기울여 더욱 강력한 모델을 생성 및 배포할 수 있으며 AI 시스템과 함께 발전할 것입니다. 개발은 계속해서 보안 조치를 강화합니다. .

위 내용은 ChatGPT의 보안은 우려를 낳고 있습니다. 모회사는 항상 보안에 주의하고 있다는 문서를 발행했습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

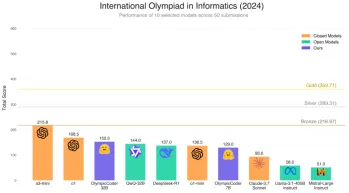

Hugging Face ' S 7B 모델 올림픽 코더는 Claude 3.7을 이겼습니까?Apr 23, 2025 am 11:49 AM

Hugging Face ' S 7B 모델 올림픽 코더는 Claude 3.7을 이겼습니까?Apr 23, 2025 am 11:49 AMHugging Face의 올림픽 코더 -7b : 강력한 오픈 소스 코드 추론 모델 우수한 코드 중심 언어 모델을 개발하기위한 경쟁은 강화되고 있으며, Hugging Face는 엄청난 경쟁자 인 OlympicCoder-7B와 경쟁에 참여했습니다.

4 개의 새로운 쌍둥이 자리 기능을 놓칠 수 없습니다Apr 23, 2025 am 11:48 AM

4 개의 새로운 쌍둥이 자리 기능을 놓칠 수 없습니다Apr 23, 2025 am 11:48 AMAI가 단순한 질문에 대답하는 것 이상을 할 수 있기를 바라는 여러분 중 몇 명이 있습니까? 나는 내가 가지고 있다는 것을 알고 있으며, 늦게 그것이 어떻게 변화하고 있는지에 놀랐습니다. AI 챗봇은 더 이상 채팅에 관한 것이 아니라 창작에 관한 것입니다.

Camunda는 에이전트 AI 오케스트레이션에 대한 새로운 점수를 씁니다Apr 23, 2025 am 11:46 AM

Camunda는 에이전트 AI 오케스트레이션에 대한 새로운 점수를 씁니다Apr 23, 2025 am 11:46 AMSmart AI가 모든 수준의 엔터프라이즈 소프트웨어 플랫폼 및 애플리케이션에 통합되기 시작함에 따라 (강력한 핵심 도구와 덜 안정적인 시뮬레이션 도구가 있음을 강조해야 함) 이러한 에이전트를 관리하려면 새로운 인프라 기능 세트가 필요합니다. 독일 베를린에 본사를 둔 프로세스 오케스트레이션 회사 인 Camunda는 Smart AI가 적절한 역할을 수행하고 새로운 디지털 작업장에서 정확한 비즈니스 목표 및 규칙에 맞게 조정하는 데 도움이 될 수 있다고 생각합니다. 이 회사는 현재 조직이 AI 에이전트를 모델링, 배포 및 관리하도록 돕기 위해 설계된 지능형 오케스트레이션 기능을 제공합니다. 실용적인 소프트웨어 엔지니어링 관점에서, 이것이 무엇을 의미합니까? 확실성과 비 결정적 프로세스의 통합 이 회사는 핵심은 사용자 (일반적으로 데이터 과학자, 소프트웨어)를 허용하는 것이라고 말했다.

선별 된 엔터프라이즈 AI 경험에 가치가 있습니까?Apr 23, 2025 am 11:45 AM

선별 된 엔터프라이즈 AI 경험에 가치가 있습니까?Apr 23, 2025 am 11:45 AM다음 '25 년 Google Cloud에 참석하면서 Google이 AI 제품을 구별하는 방법을보고 싶어했습니다. 에이전트 공간 (여기서 논의 된)과 고객 경험 제품군 (여기서 논의)에 관한 최근의 발표는 유망한 비즈니스 valu를 강조했습니다.

헝겊에 가장 적합한 다국어 임베딩 모델을 찾는 방법은 무엇입니까?Apr 23, 2025 am 11:44 AM

헝겊에 가장 적합한 다국어 임베딩 모델을 찾는 방법은 무엇입니까?Apr 23, 2025 am 11:44 AM검색 증강 생성 (RAG) 시스템을위한 최적의 다국적 임베딩 모델 선택 오늘날의 상호 연결된 세계에서 효과적인 다국어 AI 시스템을 구축하는 것이 가장 중요합니다. 강력한 다국어 임베딩 모델은 RE에 중요합니다

머스크 : 오스틴의 로보 탁시는 10,000 마일마다 개입이 필요합니다Apr 23, 2025 am 11:42 AM

머스크 : 오스틴의 로보 탁시는 10,000 마일마다 개입이 필요합니다Apr 23, 2025 am 11:42 AMTesla의 Austin Robotaxi 런칭 : Musk의 주장에 대한 자세한 내용 Elon Musk는 최근 텍사스 오스틴에서 Tesla의 다가오는 Robotaxi 런칭을 발표하여 안전상의 이유로 소규모 10-20 대의 차량을 배치하여 빠른 확장 계획을 세웠습니다. 시간

AI의 충격적인 피벗 : 작업 도구에서 디지털 치료사 및 라이프 코치까지Apr 23, 2025 am 11:41 AM

AI의 충격적인 피벗 : 작업 도구에서 디지털 치료사 및 라이프 코치까지Apr 23, 2025 am 11:41 AM인공 지능이 적용되는 방식은 예상치 못한 일 수 있습니다. 처음에 우리 중 많은 사람들이 주로 코드 작성 및 컨텐츠 작성과 같은 창의적이고 기술적 인 작업에 주로 사용되었다고 생각할 수도 있습니다. 그러나 하버드 비즈니스 리뷰 (Harvard Business Review)가 최근 조사한 결과는 그렇지 않습니다. 대부분의 사용자는 일뿐만 아니라 지원, 조직, 심지어 우정을 위해 인공 지능을 추구합니다! 이 보고서는 AI 신청 사례의 첫 번째는 치료 및 동반자라고 밝혔다. 이것은 24/7 가용성과 익명의 정직한 조언과 피드백을 제공하는 능력이 큰 가치가 있음을 보여줍니다. 반면에, 마케팅 작업 (예 : 블로그 작성, 소셜 미디어 게시물 만들기 또는 광고 사본)은 인기있는 사용 목록에서 훨씬 낮습니다. 이게 왜? 연구 결과와 그것이 어떻게 계속되는지 보자.

회사는 AI 에이전트 채택을 향해 경쟁합니다Apr 23, 2025 am 11:40 AM

회사는 AI 에이전트 채택을 향해 경쟁합니다Apr 23, 2025 am 11:40 AMAI 요원의 부상은 비즈니스 환경을 변화시키고 있습니다. 클라우드 혁명과 비교하여, AI 에이전트의 영향은 지식 작업에 혁명을 일으킬 것으로 예상되며, 기하 급수적으로 더 크다. 인간의 의사 결정 마키를 시뮬레이션하는 능력

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

맨티스BT

Mantis는 제품 결함 추적을 돕기 위해 설계된 배포하기 쉬운 웹 기반 결함 추적 도구입니다. PHP, MySQL 및 웹 서버가 필요합니다. 데모 및 호스팅 서비스를 확인해 보세요.

에디트플러스 중국어 크랙 버전

작은 크기, 구문 강조, 코드 프롬프트 기능을 지원하지 않음

ZendStudio 13.5.1 맥

강력한 PHP 통합 개발 환경

안전한 시험 브라우저

안전한 시험 브라우저는 온라인 시험을 안전하게 치르기 위한 보안 브라우저 환경입니다. 이 소프트웨어는 모든 컴퓨터를 안전한 워크스테이션으로 바꿔줍니다. 이는 모든 유틸리티에 대한 액세스를 제어하고 학생들이 승인되지 않은 리소스를 사용하는 것을 방지합니다.

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)