ホームページ >テクノロジー周辺機器 >AI >Champ は初のオープンソースです: 人体のビデオが新しい SOTA を生成し、5 日間で 1,000 個のスターを獲得し、デモはプレイ可能です

Champ は初のオープンソースです: 人体のビデオが新しい SOTA を生成し、5 日間で 1,000 個のスターを獲得し、デモはプレイ可能です

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2024-03-30 13:31:35964ブラウズ

写真とビデオで写真に生き生きとした印象を与えることができます。

最近、アリババ、復旦大学、南京大学が共同でリリースした制御可能な人間の視覚生成作品「Champ」がインターネット上で人気を集めています。このモデルはオープンソース化されてまだ 5 日ですが、GitHub で 1,000 個のスターを獲得しており、Twitter で人気を博し、多くのブロガーが新しいプロジェクトを作成するようになり、総閲覧数は 300,000 に達しました。

現在、Champ は推論コードと重みをオープンソース化しており、ユーザーはそれらを Github から直接ダウンロードして使用できます。公式の Hugging Face デモが開始され、カプセル化された Champ-ComfyUI も同時にプロモーションされています。 GitHub のホームページには、チームが近い将来トレーニング コードとデータ セットをオープンソース化する予定であることが示されており、興味のあるパートナーは引き続きプロジェクトの動向に注目してください。

プロジェクトのホームページ: https://fudan-generative-vision.github.io/champ/

紙のリンク: https ://arxiv.org/abs/2403.14781

Github リンク: https://github.com/fudan-generative-vision/champ

Hugging Face リンク: https://huggingface.co/fudan-generative-ai/champ

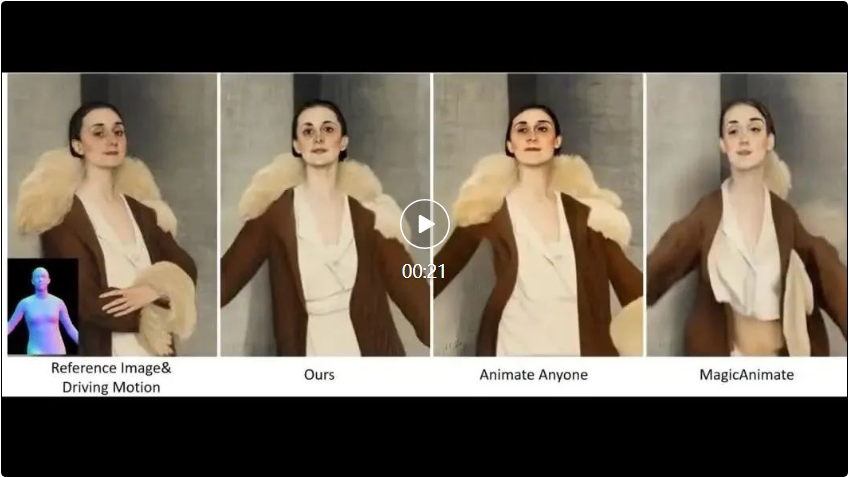

現実世界のポートレートに対するチャンプのビデオ効果により、さまざまなポートレートを「コピー」できます。 「同じアクション、左上隅のアングルからのアクションビデオが入力です。

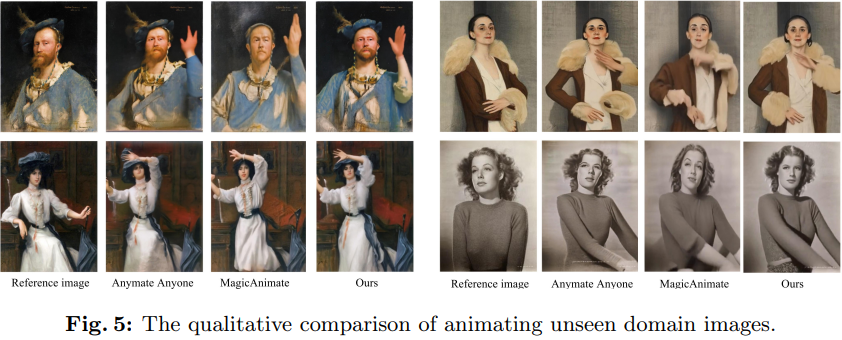

Champ は実際の人体のビデオのみでトレーニングされていますが、さまざまな種類の画像に対して強力な一般化機能を示します。

白黒写真、油絵、水彩画などの効果は抜群で、異なるヴィンセントグラフモデルによって生成されるリアルな画像や仮想キャラクターも言うまでもない:

技術概要

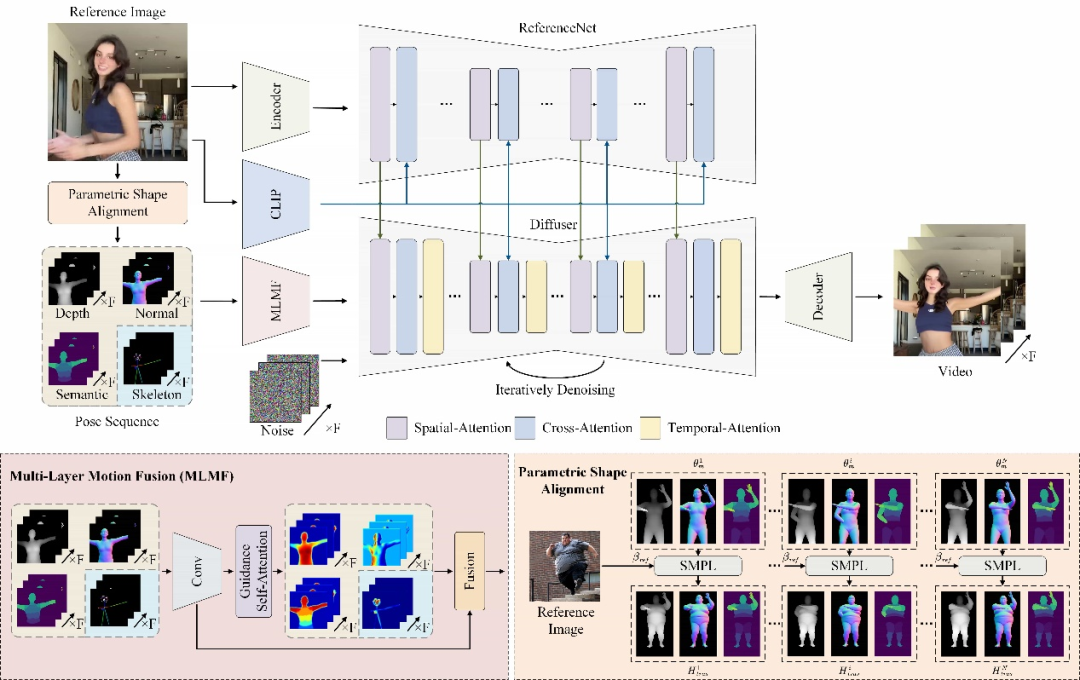

Champ は高度なヒューマン メッシュ回復モデルを使用して、入力ヒューマン ビデオから対応するパラメーター化された 3 次元ヒューマン メッシュ モデル SMPL シーケンス (スキン付きマルチパーソン線形モデル) を抽出します。 )、さらに、ビデオ生成をガイドするための対応するモーション制御条件として、対応する深度マップ、法線マップ、人間の姿勢、および人体のセマンティック マップをレンダリングし、アクションを入力参照ポートレートに移行することで、人間のモーションを大幅に改善できます。ビデオ品質、幾何学的および外観上の一貫性。

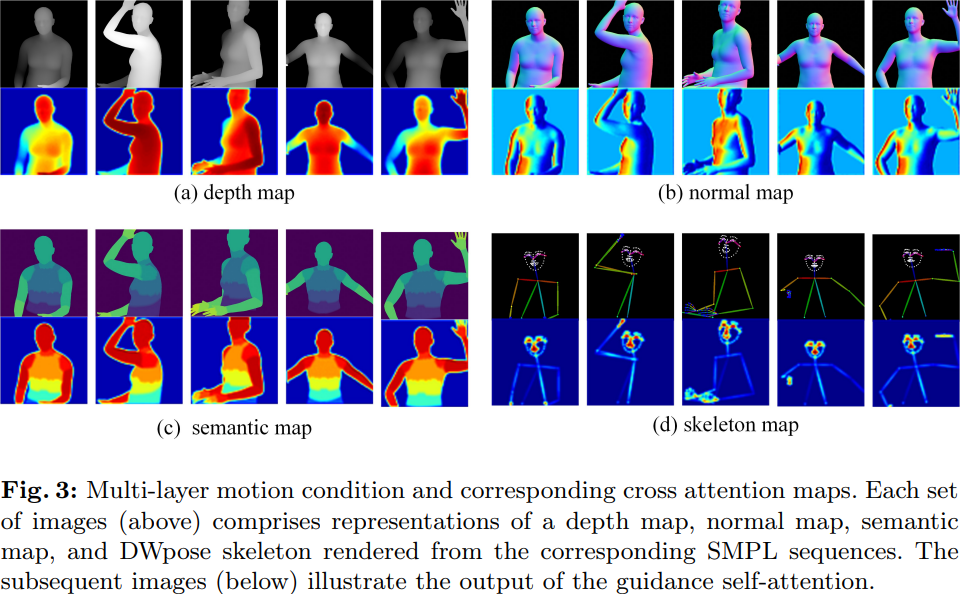

さまざまな動作条件に対して、Champ はマルチレイヤー モーション フュージョン モジュール (MLMF) を採用し、セルフ アテンション メカニズムを使用して異なる条件間の特性を完全に統合し、より多くのことを実現します。洗練されたモーションコントロールを実現します。次の図は、さまざまな条件下でのこのモジュールの注意の視覚化結果を示しています。深度マップは人体の幾何学的輪郭情報に焦点を当て、法線マップは人体の方向を示し、セマンティック マップはさまざまな部分の外観の対応を制御します。人体の構造と姿勢の骨格 顔と手の重要な部分のみに焦点を当てています。

#一方、チャンプは、人間のビデオ生成において無視されてきた身体形状の伝達の問題を発見し、解決しました。これまでの研究では、人間の骨格モデル、または入力ビデオから得られた他の幾何学的情報に基づいて人物の動きを駆動していましたが、これらの方法では動きを人体の形状から切り離すことができず、その結果、生成された結果は参照画像の人体と一致しません。体型の一致。

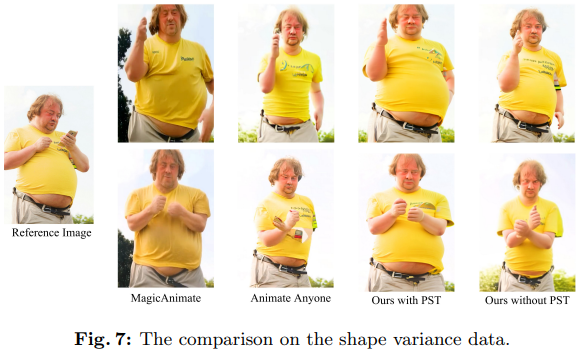

たとえば、参照画像として太った人を指定すると、図 7 に示す比較結果は次のようになります。

ご覧のとおり、 AnimateEveryone と MagicAnimate 生成された結果では、太ったお腹が滑らかになり、フレームも少し縮小されています。 Champ は、SMPL の体型パラメーターを使用して、パラメーター化された体型でビデオを駆動する SMPL シーケンスと位置を合わせます。これにより、体型とアクション (画像内の PST を含む) の最高の一貫性が実現されます。

実験結果

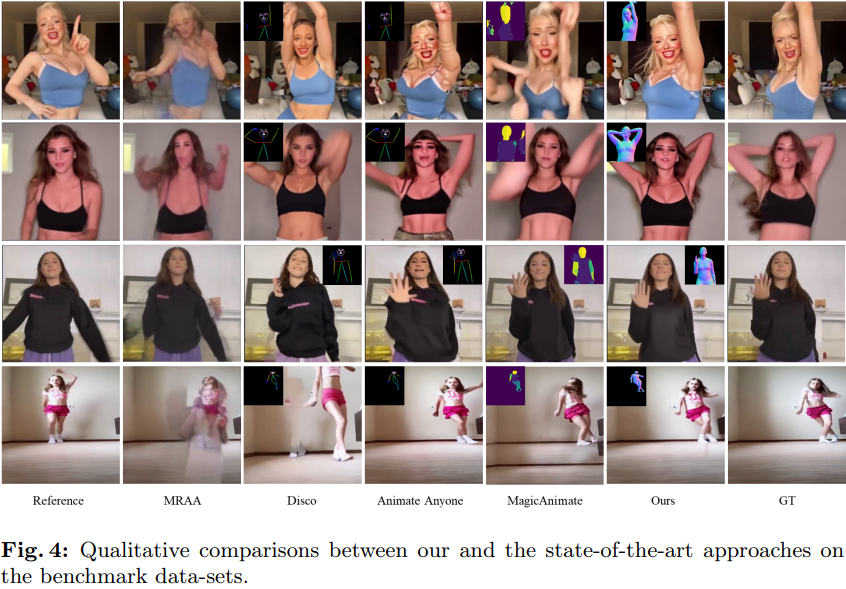

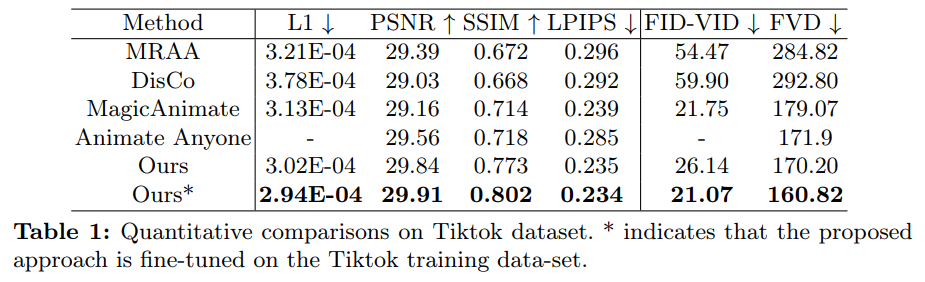

以下の表 4 に示すように、他の SOTA 作品と比較して、Champ はモーション コントロールが優れており、アーティファクトが少ないです。

同時に、Champ は外観マッチングにおける優れた汎化パフォーマンスと安定性も実証しました:

技術的な詳細と実験結果については、Champ のオリジナルの論文とコードを参照してください。また、HuggingFace にアクセスするか、公式ソース コードをダウンロードして実際に体験することもできます。

以上がChamp は初のオープンソースです: 人体のビデオが新しい SOTA を生成し、5 日間で 1,000 個のスターを獲得し、デモはプレイ可能ですの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。