ホームページ >テクノロジー周辺機器 >AI >新しいタイトル: 北京大学が新時代を開く: カテゴリレベルの 6D オブジェクト姿勢推定の新しいパラダイムが、NeurIPS 2023 で最新かつ最高の結果を達成

新しいタイトル: 北京大学が新時代を開く: カテゴリレベルの 6D オブジェクト姿勢推定の新しいパラダイムが、NeurIPS 2023 で最新かつ最高の結果を達成

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-12-04 18:41:411464ブラウズ

現在、広く使用されている 6D オブジェクトの姿勢推定方法は、2 つの主要なカテゴリに分類できます。1 つは直接回帰によるエンドツーエンドの方法、もう 1 つは次のような 2 段階の方法です。前のオブジェクト カテゴリ。ただし、これらの方法はすべて問題を回帰タスクとしてモデル化するため、対称オブジェクトや部分的に表示されているオブジェクトを扱う場合、複数解の問題に対処するには特別な設計が必要です。 北京大学の研究者らは、新しいカテゴリレベルの 6D 物体の姿勢推定方法を提案しました。これは基本的かつ重要な問題であり、ロボット工学、仮想現実、拡張現実などの分野で広く使用されています。彼らはこの論文で新たな SOTA 結果を達成し、機械学習分野のトップカンファレンスである NeurIPS 2023 でこの分野の重要なタスクとして 6D オブジェクトの姿勢推定に採択されました。コンピューター ビジョンは、ロボット工学、仮想現実、拡張現実などの分野で数多くの応用例があります。インスタンスレベルのオブジェクトの姿勢推定は大幅に進歩しましたが、オブジェクトの特性に関する事前の知識が必要なため、新しいオブジェクトに簡単に適用することができず、実際の応用が制限されます。この問題を解決するために、近年、カテゴリレベルの物体の姿勢推定に焦点を当てた研究がますます行われています。カテゴリ レベルの姿勢推定には、オブジェクトの CAD モデルに依存せず、トレーニング データ内のオブジェクトと同じカテゴリの新しいオブジェクトに直接適用できるアルゴリズムが必要です。

これらの課題を克服するために、北京の研究チームは大学が提案 新しいカテゴリレベルの 6D 物体姿勢推定パラダイムが開発され、問題を条件付き分布モデリング問題として再定義し、それによって最新の最適なパフォーマンスを達成します。彼らはまた、ビデオで示されているように、水を注ぐなどのロボット操作タスクにこの方法を適用することに成功しました。

論文を表示するには、次のリンクをクリックしてください: https://arxiv.org/abs/2306.10531

6D 物体姿勢推定のカテゴリレベルで、複数の解問題とは、存在する可能性のある問題を指します。同じ観察条件下での複数の合理的な姿勢推定。この状況は主に、図 1 に示す 2 つの要因によって引き起こされます。それは、対称オブジェクトと部分的な観測です。球形や円筒形の物体などの対称的な物体の場合、異なる方向から見てもまったく同じである可能性があるため、理論的には、それらの姿勢について考えられる真の値は無限にあります。同時に、単一の視点では、マグカップなどのオブジェクトを完全に観察することはできません。カップのハンドルを観察しなければ、姿勢の真の値は無限に多く存在します。

6D 物体姿勢推定のカテゴリレベルで、複数の解問題とは、存在する可能性のある問題を指します。同じ観察条件下での複数の合理的な姿勢推定。この状況は主に、図 1 に示す 2 つの要因によって引き起こされます。それは、対称オブジェクトと部分的な観測です。球形や円筒形の物体などの対称的な物体の場合、異なる方向から見てもまったく同じである可能性があるため、理論的には、それらの姿勢について考えられる真の値は無限にあります。同時に、単一の視点では、マグカップなどのオブジェクトを完全に観察することはできません。カップのハンドルを観察しなければ、姿勢の真の値は無限に多く存在します。  ##メソッドの紹介

##メソッドの紹介

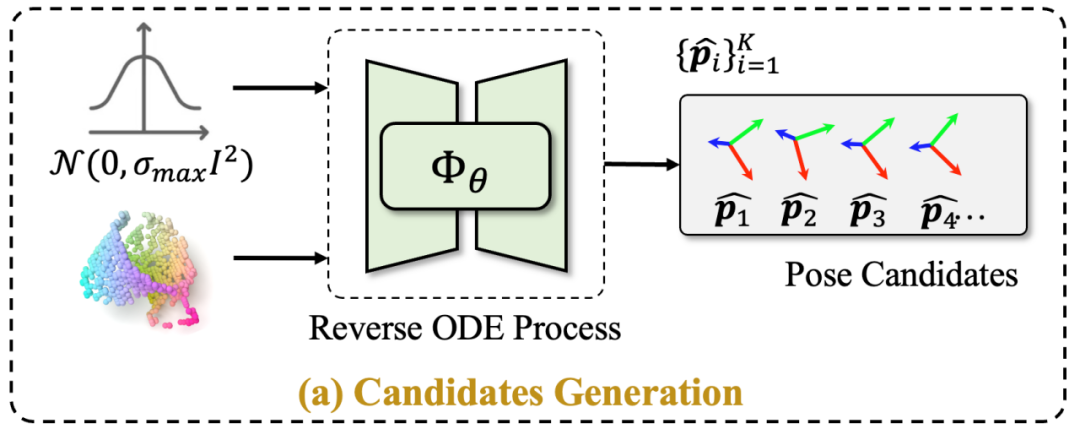

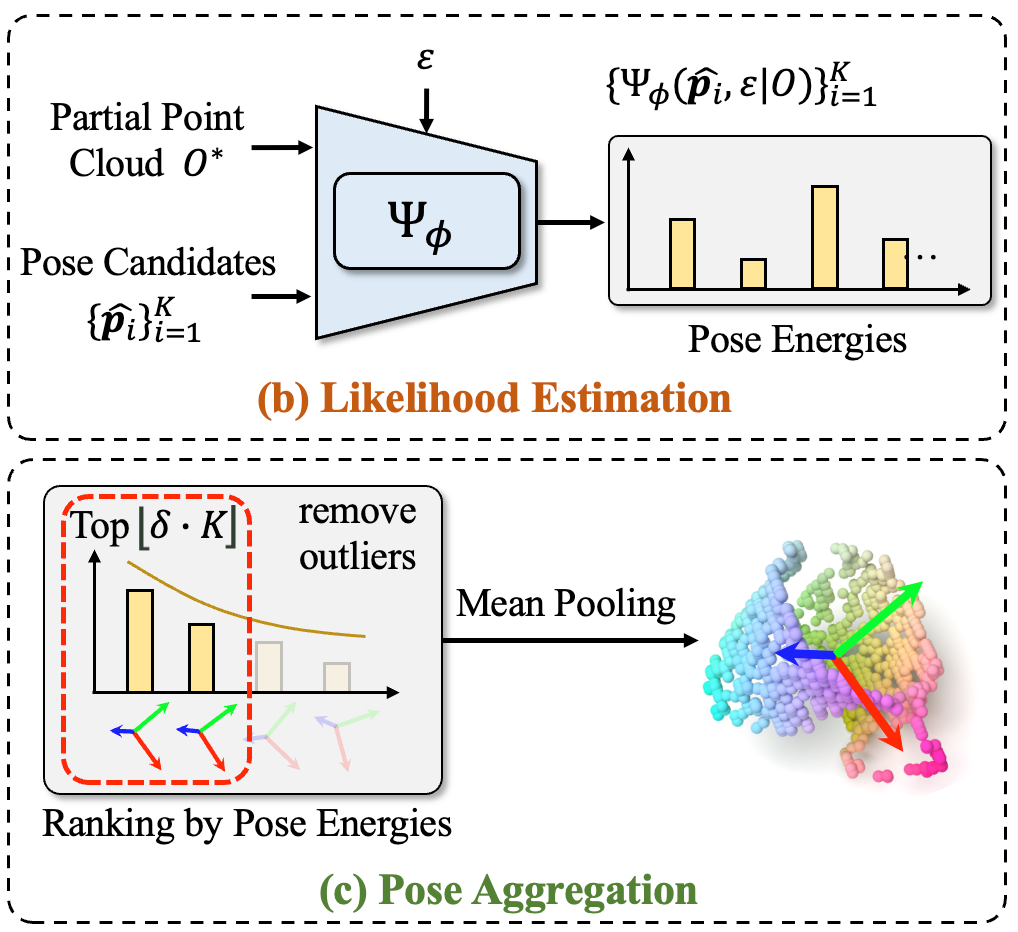

#上記の対処法 複数の問題を解決してみてはいかがでしょうか?著者らは、この問題を条件付き分布モデリングの問題として捉え、拡散モデルを利用して物体の姿勢の条件付き分布を推定する GenPose と呼ばれる手法を提案しています。この方法では、まずスコアベースの拡散モデルを使用してオブジェクトの姿勢候補を生成します。次に、候補は 2 つのステップで集約されます。まず、尤度推定によって外れ値が除外され、次に、平均プーリングによって残りの候補ポーズが集約されます。尤度を推定する際の面倒な積分計算の必要性を避けるために、研究著者らは、エンドツーエンドの尤度推定を達成するためのエネルギーベースの拡散モデルのトレーニング手法も導入しました。 #次のように再表現します: 図 2 は GenPose のフレームワーク構造を示しています

#スコアベースの拡散モデルを使用してオブジェクト ポーズ候補を生成します

書き直された内容: このステップの目的は、多重解問題を解決することなので、オブジェクトの姿勢の条件付き確率分布をモデル化する方法は?著者らは分数ベースの拡散モデルを採用し、VE SDE (変分オイラー確率微分方程式) を使用して連続拡散プロセスを構築しました。モデルのトレーニング プロセス中の目標は、摂動された条件付き姿勢分布の分数関数を推定し、最終的に確率フロー ODE (常微分方程式) を通じて条件付き分布から候補オブジェクトの姿勢をサンプリングすることです。

改善に適用します。オブジェクト認識の精度

トレーニングされた条件付き分布を通じて、無数のオブジェクトの姿勢候補を生成できます。これらの候補から、最終的なオブジェクトのポーズをどのように導き出すのでしょうか?最も簡単な方法はランダムサンプリングですが、この方法では予測結果の安定性が保証されない可能性があります。これらのポーズ候補を平均プーリングによって集約することは可能でしょうか?ただし、この集計方法ではポーズ候補の品質が考慮されていないため、外れ値の影響を受けやすくなります。著者は、ポーズ候補の品質を尤度推定によって考慮し、集約できると考えています。具体的には、尤度推定の結果に基づいて、物体姿勢候補をソートし、尤度推定値の低い外れ値をフィルタリングして取り除き、残りの姿勢候補を平均プールして、集約された姿勢推定結果を取得します。ただし、尤度推定に拡散モデルを使用するには複雑な積分計算が必要となり、推論速度に重大な影響を及ぼし、実用化が制限されます。この問題を解決するために、著者は、エンドツーエンドの尤度推定に直接使用されるエネルギーベースの拡散モデルをトレーニングすることを提案しました。これにより、候補の迅速な集約が可能になります。

図 4. 尤度推定と物体の姿勢候補の集約のためのエネルギーベースの拡散モデル

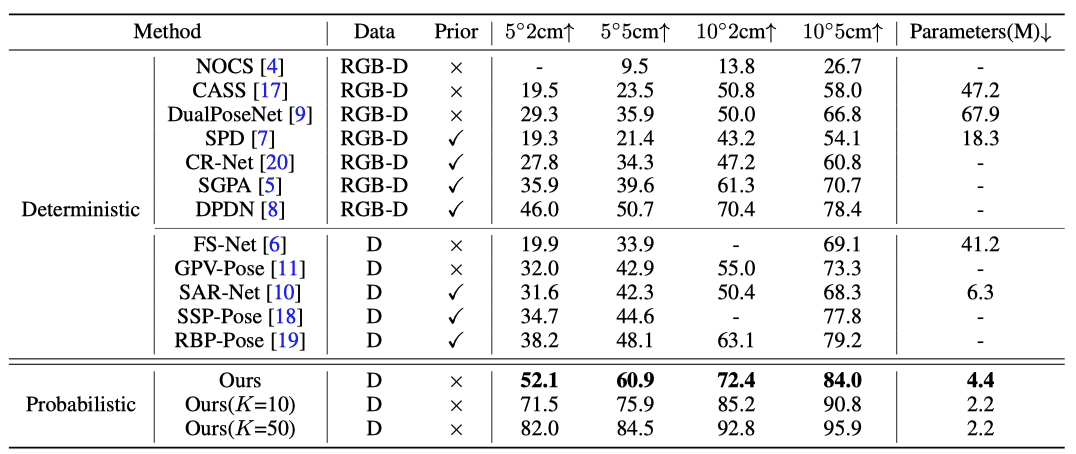

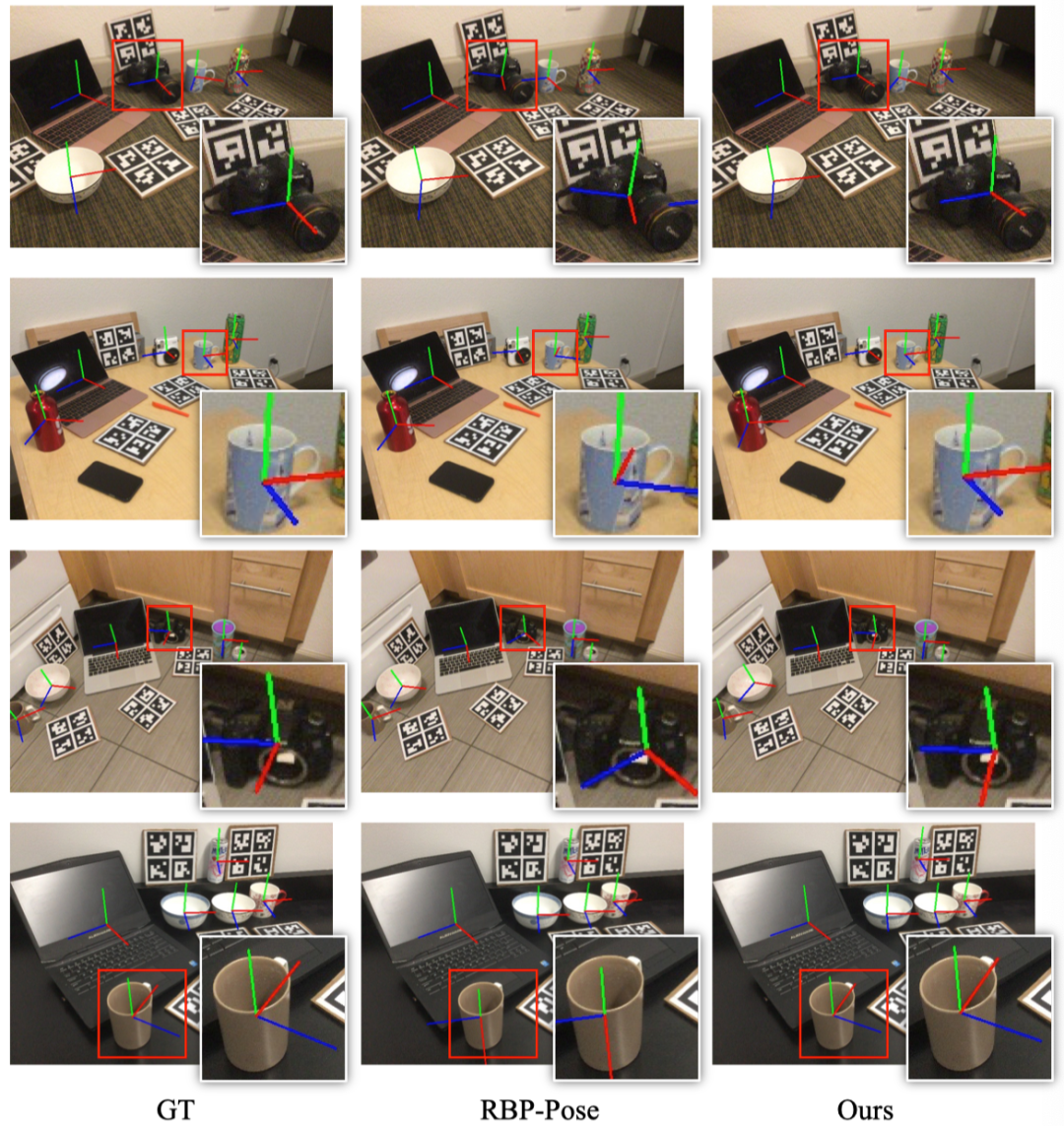

実験と結果The author is at GenPose のパフォーマンスは REAL275 データ セットで検証されました。GenPose はさまざまな指標で以前の方法よりも大幅に優れていることがわかります。より多くのモーダル情報を使用する方法と比較した場合でも、GenPose は依然として大きなリード。表 1 は、著者が提案した生成物体姿勢推定パラダイムの利点を示しています。図 5 は可視化結果です。

#書き直す必要がある内容は、他のメソッドとの比較です

5 番目の図は、さまざまな方法の予測視覚化効果を示しています

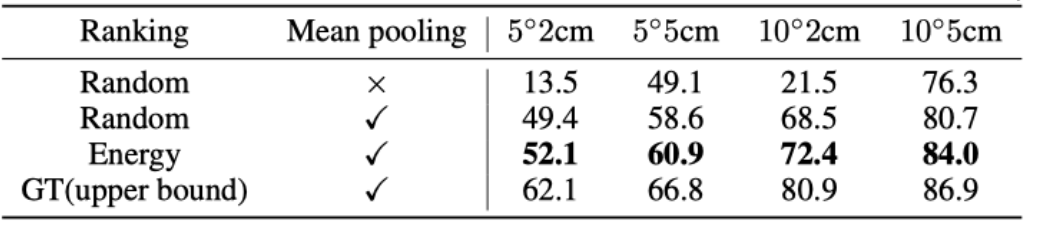

著者はさまざまな集計方法 (ランダム サンプリング、ランダム ソートと集計、エネルギー選別と事後集計、GT 選別と事後集計の影響に基づく)。結果は、エネルギー モデルを使用したランキングがランダム サンプリング方法よりも大幅に優れていることを示しています。さらに、オブジェクトのポーズ候補を集約するために著者が提案したエネルギーベースの拡散モデルも、ランダム サンプリングとランダム ソート後の平均プーリング法よりも大幅に優れています。

著者はさまざまな集計方法 (ランダム サンプリング、ランダム ソートと集計、エネルギー選別と事後集計、GT 選別と事後集計の影響に基づく)。結果は、エネルギー モデルを使用したランキングがランダム サンプリング方法よりも大幅に優れていることを示しています。さらに、オブジェクトのポーズ候補を集約するために著者が提案したエネルギーベースの拡散モデルも、ランダム サンプリングとランダム ソート後の平均プーリング法よりも大幅に優れています。

エネルギー モデルの影響をより適切に分析するために、著者は推定姿勢誤差と予測姿勢誤差の関係をさらに研究しました。エネルギー、相関関係。図 4 に示すように、予測された姿勢誤差とエネルギーの間には一般に負の相関関係があります。エネルギー モデルは、エラーが大きい姿勢を識別するとパフォーマンスが向上しますが、エラーが小さい姿勢を識別するとパフォーマンスが低下します。これは、最大のエネルギーを持つものを直接選択するのではなく、予測されたエネルギーを使用して外れ値を除去する理由を説明しています。

#図 6. エネルギーと予測誤差の相関分析

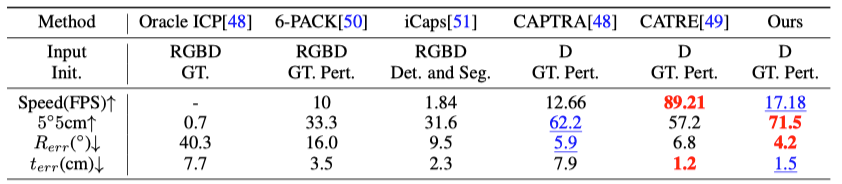

著者は、カテゴリ間の一般化の観点から、この方法も実証しましたこの方法はカテゴリの事前知識に依存せず、カテゴリ間の汎化におけるパフォーマンスも以前の方法より大幅に優れています

表 3 は、カテゴリ間の汎化効果を示しています。左側のスラッシュはテスト カテゴリがトレーニング データ セットに含まれている場合のパフォーマンスを表し、右側のスラッシュはトレーニング中にテスト カテゴリが削除された後のパフォーマンスを表します。同時に、拡散モデルの閉ループ生成プロセスにより、この記事の単一フレーム姿勢推定フレームワークは、特別な設計なしで 6D オブジェクトの姿勢追跡タスクに直接使用することもできます。この方法は、最先端の 6D よりも優れています。複数の指標における物体姿勢追跡方法の結果を表 4 に示します。

#表 4. カテゴリレベルの 6D オブジェクトの姿勢追跡パフォーマンスの比較

概要と見通し

この研究は、カテゴリレベルの 6D オブジェクトの姿勢推定のための新しいパラダイムを提案します。トレーニング プロセスには、対称オブジェクトと部分的な観測によって引き起こされる多重解問題に対する特別な設計は必要ありません。新たなSOTA性能を達成しました。今後の研究では、拡散モデルの最近の進歩を活用して推論プロセスを加速し、強化学習を組み込んでアクティブな 6D オブジェクトの姿勢推定を実現することを検討します。研究チームの紹介:

この研究の責任著者である Dong Hao は、助教授、博士指導教員、リベラルアーツの若手研究者、および知的財産分野の専門家です。北京大学の学者であり、北京大学の超平面研究室を設立し、指導しています。論文の共著者であるZhang Jiyao氏とWu Mingdong氏は北京大学博士課程の学生であり、指導教員はDong Hao教授です。詳細については、個人のホームページをご覧ください。 書き直す必要がある内容は、張継耀氏と呉明東氏は北京大学の博士課程の学生で、論文を共同執筆しており、東昊氏は指導教員である。具体的な情報については、個人のホームページを確認してください。

書き直す必要があるのは、https://jiyao06.github.io/- です。 https://aaronanima.github.io/

以上が新しいタイトル: 北京大学が新時代を開く: カテゴリレベルの 6D オブジェクト姿勢推定の新しいパラダイムが、NeurIPS 2023 で最新かつ最高の結果を達成の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。