ホームページ >バックエンド開発 >Python チュートリアル >Pythonを使用した回帰分析と最適直線

Pythonを使用した回帰分析と最適直線

- 王林転載

- 2023-08-28 09:33:051630ブラウズ

このチュートリアルでは、Python プログラミングを使用して回帰分析と最適な直線を実装します

###導入###回帰分析は、予測分析の最も基本的な形式です。

統計学における線形回帰は、スカラー値と 1 つ以上の説明変数の間の関係をモデル化する方法です。

機械学習では、線形回帰は教師ありアルゴリズムです。このアルゴリズムは、独立変数に基づいて目標値を予測します。

線形回帰と回帰分析の詳細について

線形回帰/分析では、ターゲットは給与、BMI などの実際の値または連続値です。従属変数と一連の独立変数の間の関係を予測するためによく使用されます。これらのモデルは通常、線形方程式に適合しますが、高次多項式など、他の種類の回帰もあります。

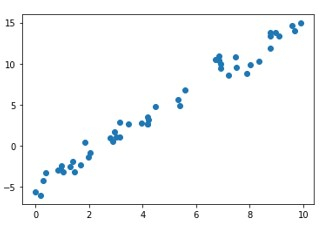

線形モデルをデータに当てはめる前に、データ点間に線形関係があるかどうかを確認する必要があります。これは散布図から明らかです。アルゴリズム/モデルの目的は、最も適合する線を見つけることです。

この記事では、線形回帰分析と C を使用したその実装について説明します。

線形回帰方程式の形式は Y = c mx です。ここで、Y はターゲット変数、X は独立変数または説明パラメータ/変数です。 m は回帰直線の傾き、c は切片です。これは 2D 回帰タスクであるため、モデルはトレーニング中に最適な線を見つけようとします。すべての点が正確に同じ線上に並ぶ必要はありません。一部のデータ ポイントは直線上に存在する場合もあれば、一部のデータ ポイントが直線上に分散している場合もあります。線とデータ点の間の垂直距離が残差です。値は、点が線の上か下かに応じて、負または正になります。残差は、線がデータにどの程度適合しているかを示す尺度です。アルゴリズムは継続的に総残差を最小限に抑えます。

各観測値の残差は、y の予測値 (従属変数) と y の観測値の差です。

$$\mathrm{残差\: =\:実際\:y\:値\:−\:予測\:y\:値}$$

$$\mathrm{ri\:=\:yi\:−\:y'i}$$

線形回帰モデルのパフォーマンスを評価するための最も一般的な指標は、二乗平均平方根誤差 (RMSE) と呼ばれます。基本的な考え方は、モデルの予測が実際の観測と比較してどの程度悪いか間違っているかを測定することです。

したがって、RMSE が高いと「悪い」ことになり、RMSE が低いと「良い」ことになります

RMSE エラーは

$$\mathrm{RMSE\:=\:\sqrt{\frac{\sum_i^n=1\:(this\:-\:this')^2}{n}}}$$

RMSE は、すべての残差の平均二乗根です。 p>

Python を使用して実装する

###例### リーリー ###出力###リーリー

###結論は###回帰分析は、機械学習や統計における予測分析に使用される、非常にシンプルかつ強力な手法です。このアイデアは、そのシンプルさと、独立変数とターゲット変数の間の基礎となる線形関係にあります。

以上がPythonを使用した回帰分析と最適直線の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。