ホームページ >テクノロジー周辺機器 >AI >OpenAI と Google には二重基準があります。他人のデータを使用して大規模なモデルをトレーニングしますが、自分のデータが外部に漏洩することは決して許可しません。

OpenAI と Google には二重基準があります。他人のデータを使用して大規模なモデルをトレーニングしますが、自分のデータが外部に漏洩することは決して許可しません。

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-06-05 15:03:391149ブラウズ

生成型 AI の新時代において、大手テクノロジー企業は、オンライン コンテンツの使用に関して「言うとおりに行動するのではなく、言うとおりに行動する」戦略を追求しています。この戦略はある意味、二重基準であり発言権の濫用であると言える。

同時に、大規模言語モデル (LLM) が AI 開発の主流のトレンドになるにつれて、大企業も新興企業も独自の大規模モデルの開発に努力を惜しんでいません。その中でも、トレーニング データは大規模モデルの能力にとって重要な前提条件です。

最近、Insider レポートによると、Microsoft が支援する OpenAI、Google、およびその支援を受ける Anthropic は、長年にわたって他の Web サイトや企業のオンライン コンテンツをトレーニングに使用してきました。 .彼らの生成 AI モデル。これらはすべて、特定の許可を求めることなく行われたものであり、ウェブの将来とこの新しい時代における著作権法の適用方法を決定するための法廷闘争の一部を形成することになります。

これらの大手テクノロジー企業は、フェアユースであると主張するかもしれませんが、本当にそうなのかどうかは議論の余地があります。ただし、コンテンツを他の AI モデルのトレーニングに使用することは許可しません。したがって、なぜこれらの大手テクノロジー企業が大規模モデルをトレーニングする際に他社のオンライン コンテンツを使用できるのか、疑問に思わずにはいられません。

これらの企業は賢いですが、非常に偽善的でもあります

大手テクノロジー企業が他人のオンライン コンテンツを使用しているが、他人のコンテンツは許可していないという主張に確かな証拠はありますか?これは、一部の製品のサービス利用規約と使用条件に見られます。

まず、Anthropic が立ち上げた ChatGPT に似た AI アシスタントである Claude を見てみましょう。システムは、概要の要約、検索、作成支援、質疑応答、コーディングなどのタスクを完了できます。少し前に再度アップグレードされ、コンテキスト トークンが 100k に拡張され、処理速度が大幅に高速化されました。

クロードの利用規約は以下のとおりです。次の方法でサービスにアクセスしたり、サービスを使用したりすることはできません (そのうちのいくつかはここにリストされています)。これらの制限のいずれかが利用規定と矛盾しているか不明瞭な場合は、後者が優先されます:

- AI または機械学習のアルゴリズムまたはモデルの開発またはトレーニングを含む、当社のサービスと競合する製品またはサービスの開発

- 当社のクロール、スクレイピング、またはその他の方法でデータを取得するまたはサービスからの情報

クロード利用規約アドレス: https://vault.pactsafe.io/s /9f502c93-cb5c-4571-b205-1e479da61794 /legal.html#terms

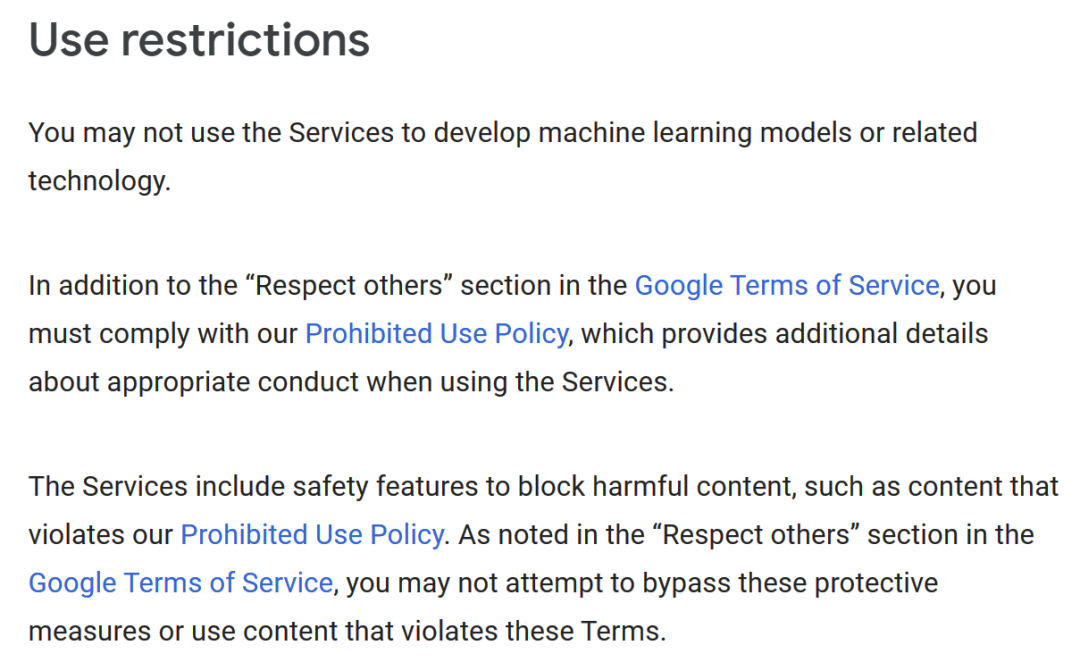

同様に、Google の生成 AI 利用規約には、「機械学習モデルまたは関連テクノロジーを開発するためにサービスを使用することはできません。」

## Google Generative AI 利用規約のアドレス: https://policies.google.com/terms/generative-ai

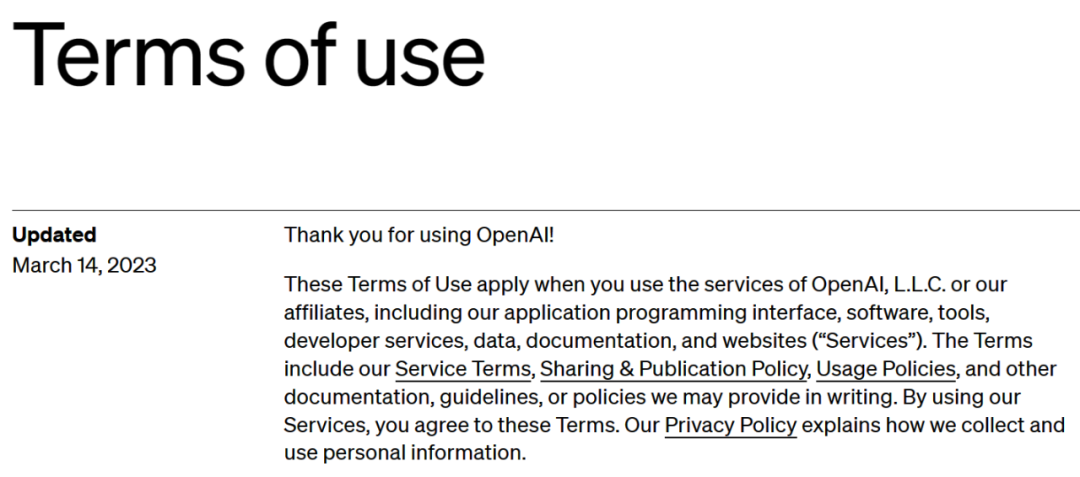

OpenAI の利用規約についてはどうですか? Google と同様に、「このサービスの出力を OpenAI と競合するモデルの開発に使用することはできません。」

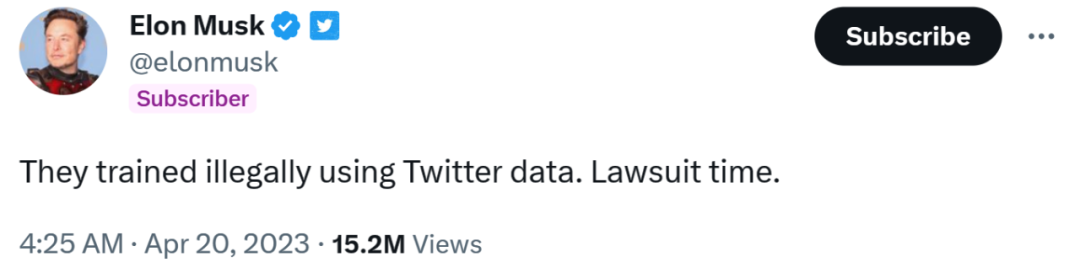

OpenAI 利用規約アドレス: https://openai.com/policies/terms-of-use これらの企業は賢明で、新しい AI モデルのトレーニングには高品質のコンテンツが不可欠であることを知っているため、他社が自社の出力をこのような方法で使用することを許可しないのは当然です。しかし、彼らは他人のデータを使用して独自のモデルをトレーニングすることに何の躊躇もありません。 OpenAI、Google、Anthropic は Insider のコメント要請を拒否し、返答しませんでした。 実際、他の企業は何が起こっているのかを理解したとき満足していませんでした。 AI モデルのトレーニングに長年使用されてきた Reddit は 4 月に、そのデータへのアクセスに対する課金を開始する予定です。 Reddit CEO の Steve Huffman 氏は、「Reddit のデータ コーパスは価値がありすぎて、その価値を世界最大の企業に無料で提供することはできません。」 また今年4月、マスク氏はOpenAIの主要支援者であるMicrosoftがTwitterデータを違法に使用してAIモデルをトレーニングしたと非難した。同氏は「訴訟の時が来た」とツイートした。 #しかし、Insider のコメントに応じて、Microsoft は次のように述べています。「この前提には非常に多くの間違いがあり、私にもわかりません OpenAI CEO のサム アルトマンは、著作権を尊重する新しい AI モデルを検討することで、この問題をさらに深めようとしました。 Axiosによると、彼は最近、「私たちは新しいモデルを開発しようとしている。もしAIシステムがあなたのコンテンツを使用したり、あなたのスタイルを使用したりすれば、あなたはそれに対して報酬を受け取ることになるだろう」と語ったという。 パブリッシャー (インサイダーを含む) はすべて既得権益を持っています。さらに、US News Corp.を含む一部の出版社はすでに、AIモデルのトレーニングにコンテンツを使用するためにテクノロジー企業に料金を支払うよう求めている。 AI モデルの現在のトレーニング方法はネットワークを「破壊」します

Reddit、Twitter、その他: もう十分です

##サム アルトマン

##サム アルトマン

彼は、投稿には、「以前は、クロールされたデータはクリックスルー率と引き換えに使用されていました。しかし、現在ではモデルをトレーニングするためにのみ使用されており、クリエイターや著作権所有者には何の価値ももたらしません。」

おそらく、より多くの企業が目覚めれば、生成 AI の時代におけるこの不均一なデータ使用状況はすぐに変わるでしょう。

以上がOpenAI と Google には二重基準があります。他人のデータを使用して大規模なモデルをトレーニングしますが、自分のデータが外部に漏洩することは決して許可しません。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。