ホームページ >テクノロジー周辺機器 >AI >両眼自動運転システムの普及が難しい理由を技術的な観点からお話しましょう。

両眼自動運転システムの普及が難しい理由を技術的な観点からお話しましょう。

- 王林転載

- 2023-05-19 10:12:201613ブラウズ

モービルアイ (ME) の魔法の武器である単眼視は、当時は両眼視も検討していましたが、最終的には断念しました。

単眼測距と 3D 推定は何に依存しますか?対象物を検出するのはバウンディングボックス(BB)ですが、障害物が検出できない場合、システムは障害物までの距離や3次元姿勢・方位を推定できません。ディープラーニングを行わない場合、ME は主に BB、カメラキャリブレーションによって得られた姿勢と高さ、および路面が直線であるという仮定に基づいて距離を推定します。

ディープ ラーニングを使用すると、3 次元のグラウンド トゥルースに基づいて NN モデルをトレーニングし、3 次元のサイズと姿勢の推定値を取得できます。距離は平行線原理 (単一ビュー) に基づいて取得されます。計測学)。 Baidu Apollo が最近発表した単眼 L3 ソリューションがそれを明確に説明しています。参考論文は「深層学習と幾何学による 3D Bounding Box Estimation」です。

双眼でも確実に視差と奥行きを計算できます、障害物が検出されなかった場合でも(追加の深さ情報があるため、検出器は単眼鏡よりも優れています)、警報が鳴ります。問題は、両眼視システムが視差を推定するのはそれほど簡単ではないということです。ステレオ マッチングは、コンピュータ ビジョンにおける典型的な問題です。広いベースラインは遠くのターゲットに対して正確な測距結果をもたらしますが、短いベースラインはターゲットに対して良好な測距結果をもたらします。ここにはトレードオフがあります。

現在市販されているADAS双眼視覚システムはスバルアイサイトで、その性能は大丈夫と言われています。

百度が発売したアポロ L4 シャトルバスは 100 台が量産され、双眼システムが搭載されました。 EUの自動駐車プロジェクトV-Chargeも前方両眼視システムを採用しており、レーダーシステムと一体化した自動運転研究開発システムのベルタベンツもその中でも両眼照合障害物検知アルゴリズムStixelは非常に有名です。ボッシュやコンティなどのティア1企業も過去に両眼視ソリューションを開発していたが、市場に影響を与えず、開発を中止したと伝えられている。

双眼システムの難しさと言えば、ステレオマッチングに加えてキャリブレーションもあります。校正されたシステムは「ドリフト」するため、オンライン校正が必須です。単眼の場合も同様です。タイヤの変形や車体の凹凸がカメラの外部パラメータの変化に影響を与えるため、ピッチ角やヨー角などの一部のパラメータはオンラインで校正および修正する必要があります。

両眼オンラインキャリブレーションはより複雑です。両眼マッチングは 1 次元検索と同じくらい簡単なので、2 つのレンズの光軸をベースラインに対して平行および垂直にする必要があります。ステレオ整流を介して。したがって、得られる利益と比較して、複雑さとコストの増加により費用対効果がなければ、加盟店は諦めることになります。

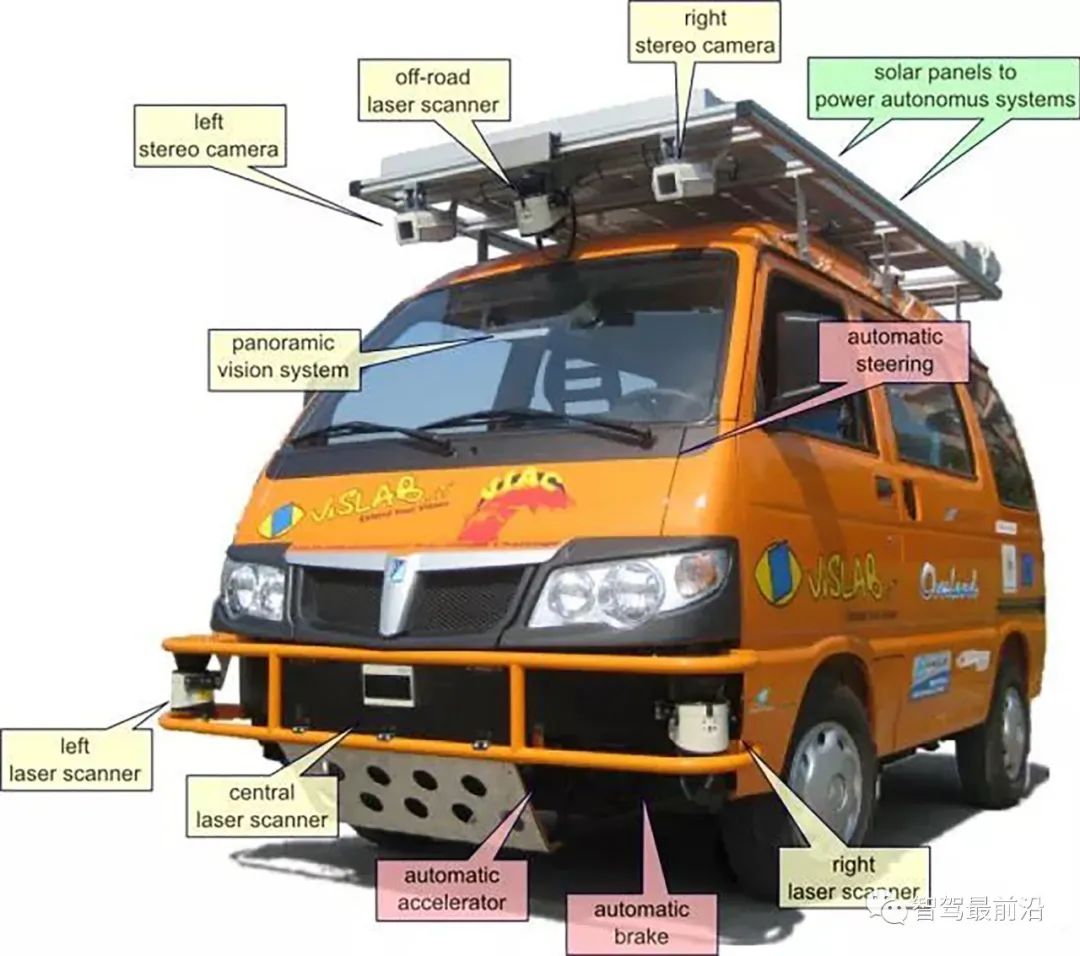

シリコンバレーのチップ企業アンバレラが2014年にイタリアのパルマ大学のVis Labを買収し、昨年のCESの後、両眼視ADASと自動運転チップを開発したことから、両眼視機能が最近話題になっています。 、自動車会社やTier-1に参入し始めました。さらに、Ambarella は現在、システムのパフォーマンスを向上させるための研究を継続しています。

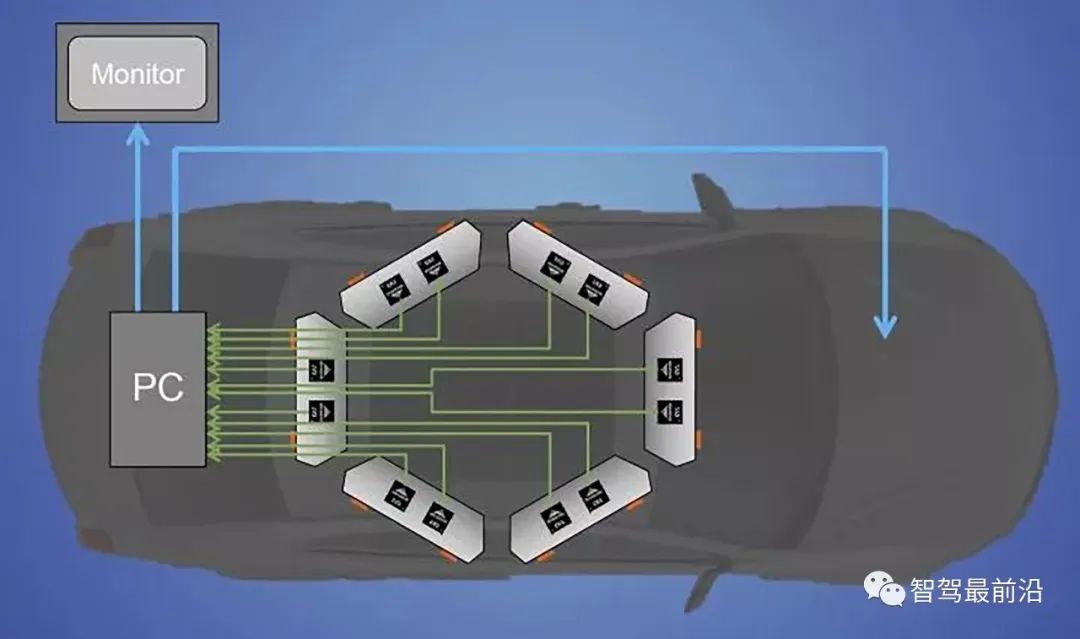

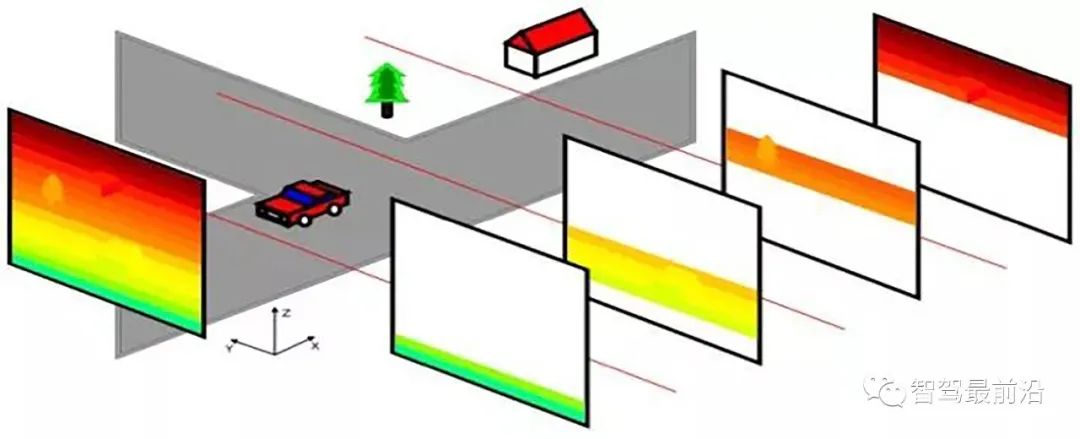

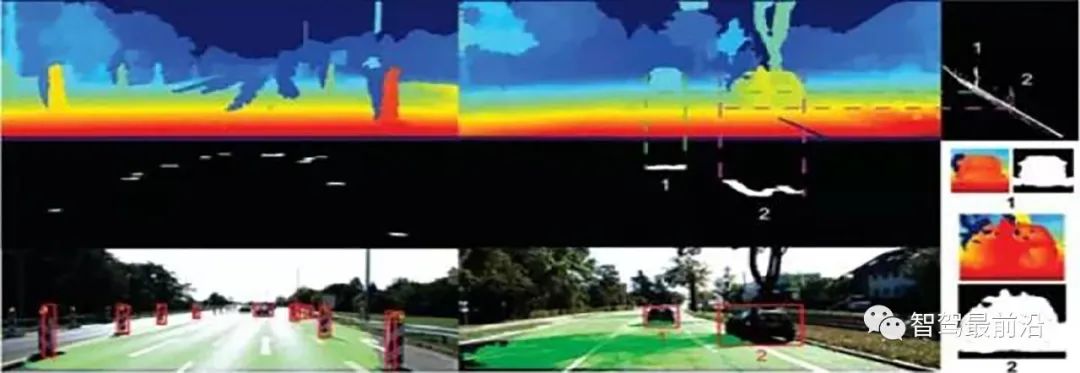

下の図は、車のルーフに設置された 6 組のステレオ ビジョン システムの概略図です。ベースライン幅が異なる場合があり、それに応じて有効検出距離も異なります。筆者も自動運転車に乗ったことがあるが、200メートル先、20~30メートル先まで見えることができた。確かに、オンラインキャリブレーションを実行し、いつでもいくつかの両眼視パラメータを調整できます。

01 ステレオ マッチング

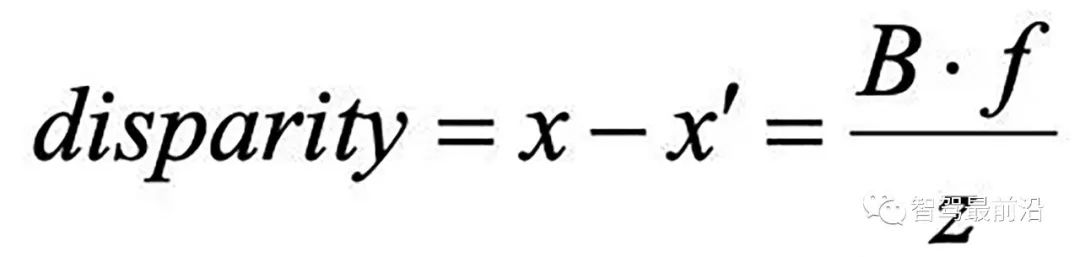

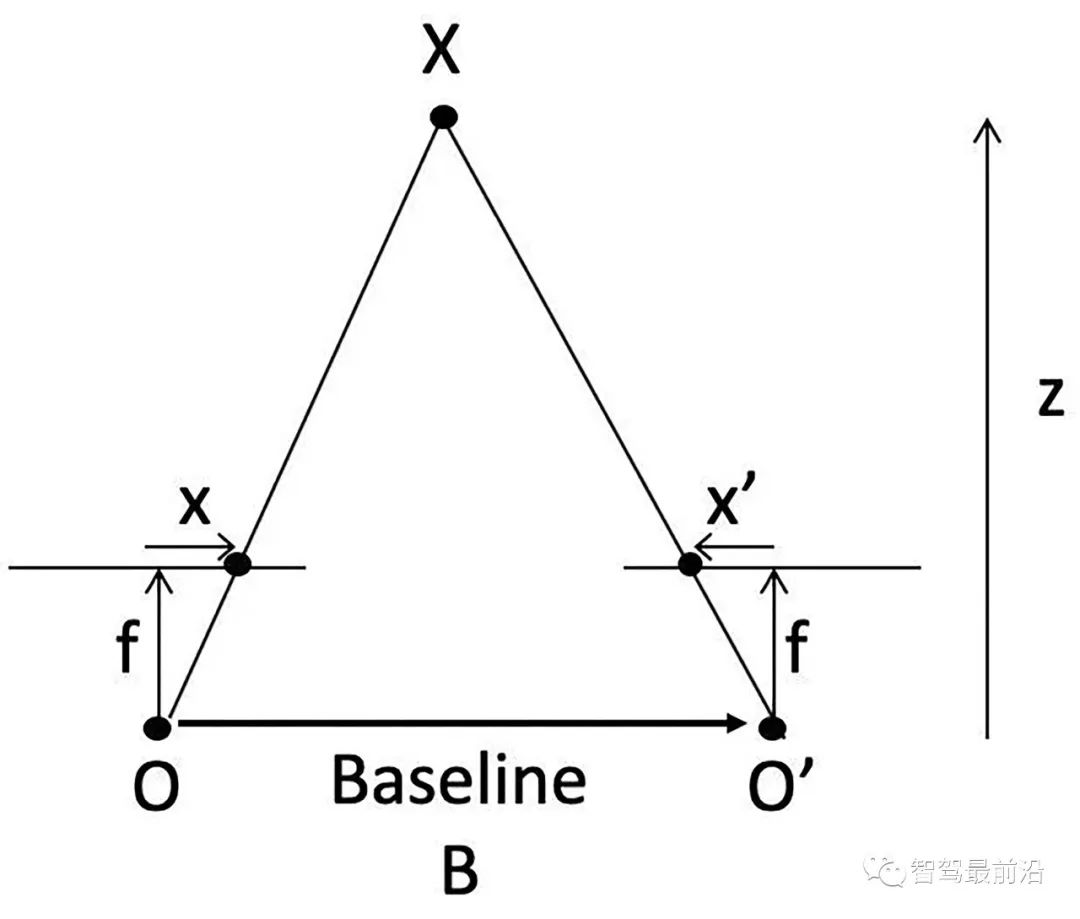

まずはステレオ マッチング、つまり視差/奥行き推定について話しましょう。 。図に示すように、左右のカメラの焦点距離をf、ベースライン(2つの光学中心を結ぶ線)の幅をB、3次元点の深さを##とします。

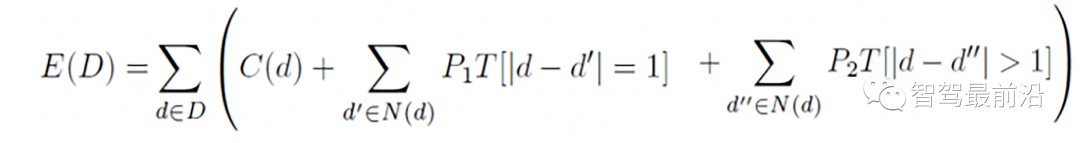

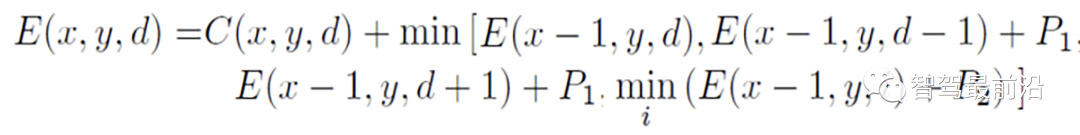

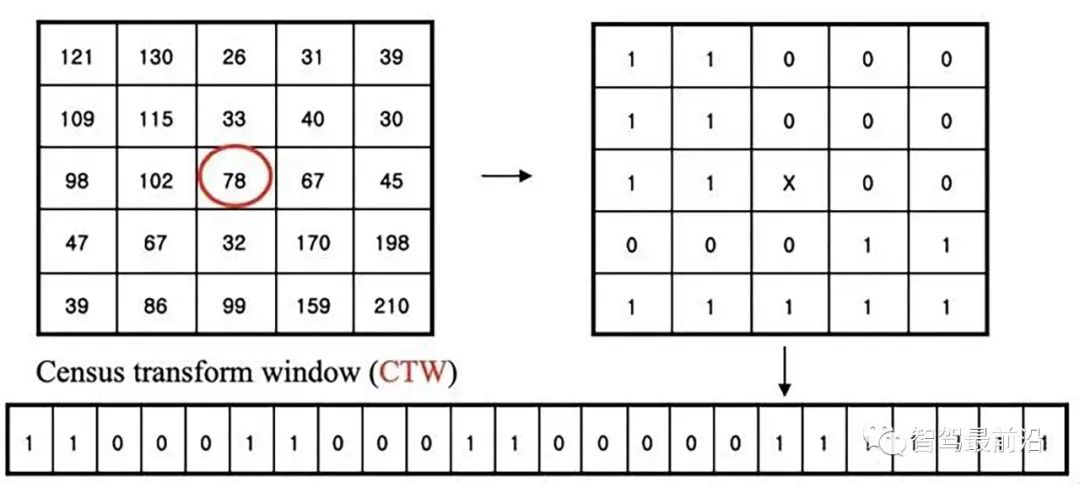

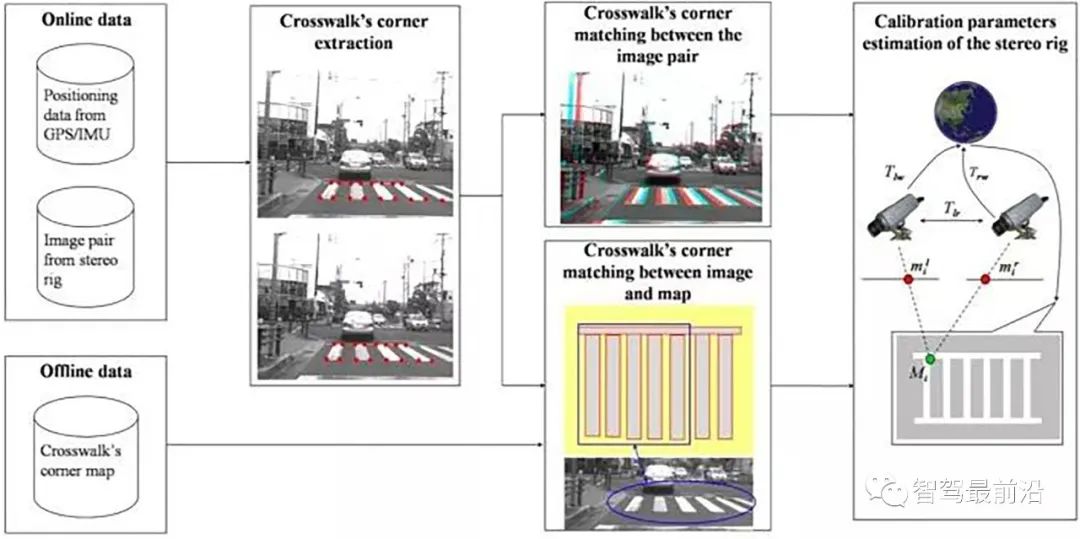

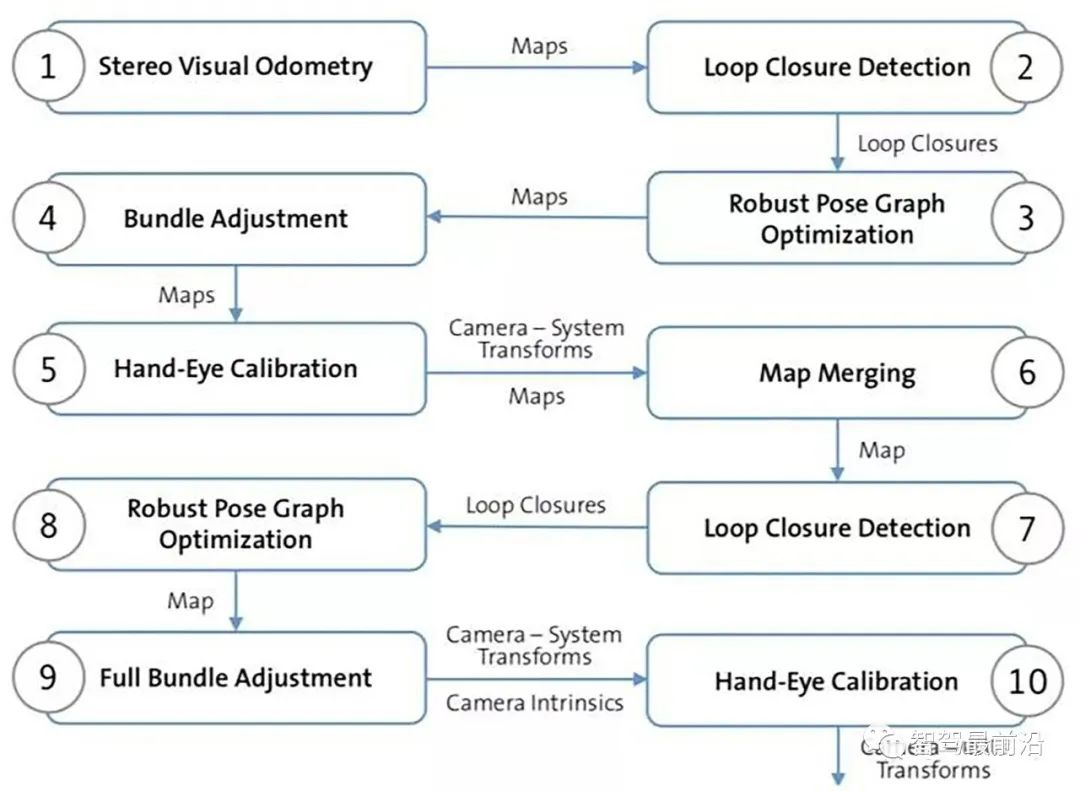

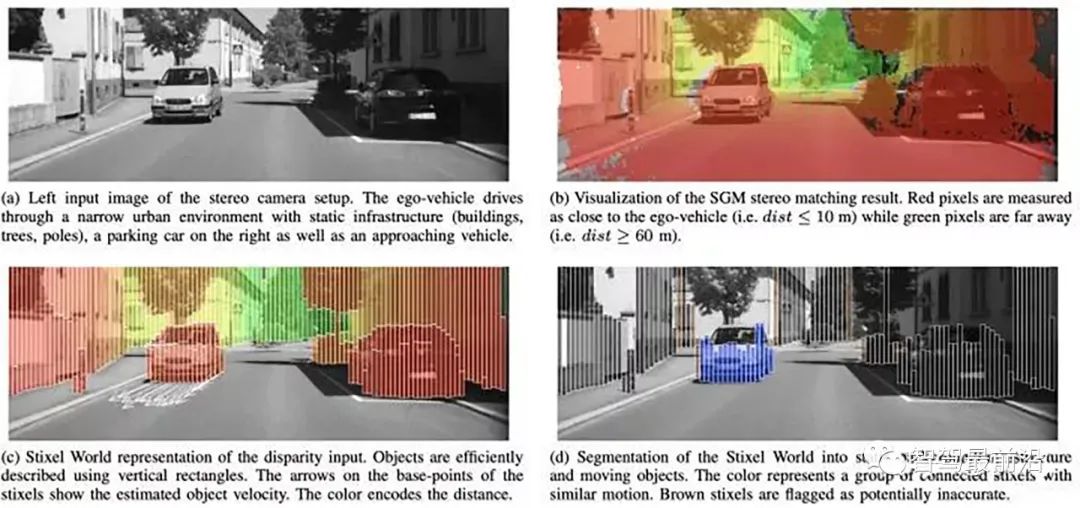

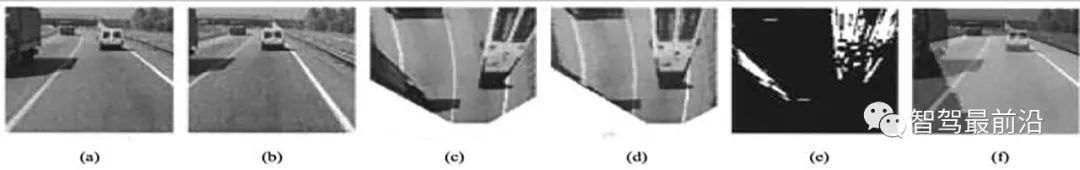

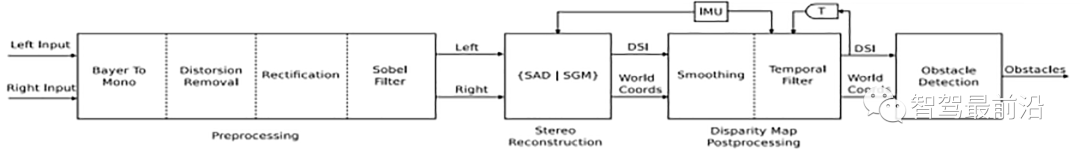

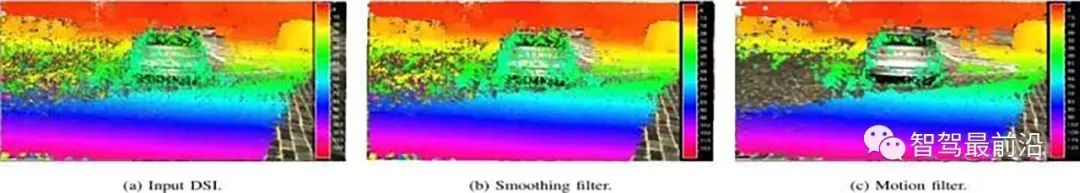

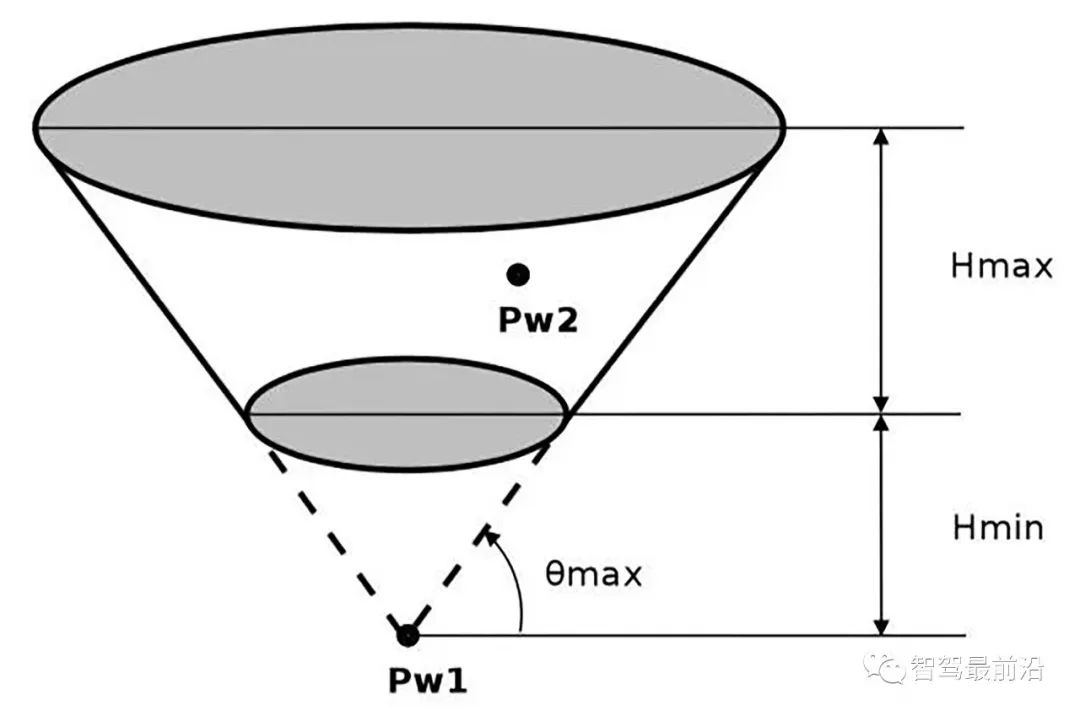

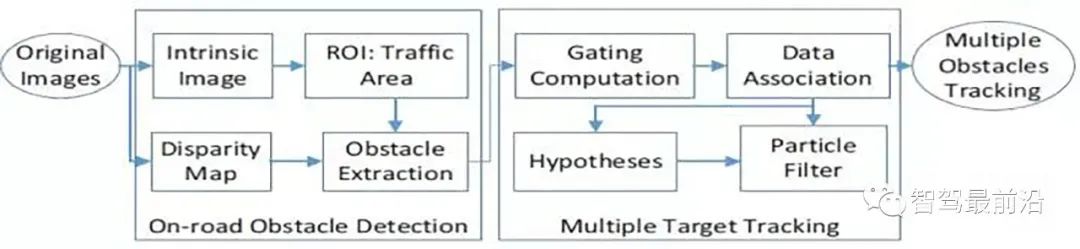

マッチング方法にはグローバル方式とローカル方式の 2 つがあり、両眼マッチングには次の 4 つのステップがあります: 最も有名なローカル方式は SGM (セミグローバル マッチング) です。多くの製品で使用されている方式はこの改良に基づいており、多くのビジョン チップがこの方式を使用しています。 SGM は、グローバル最適化を複数のローカル最適化問題の組み合わせに近似します。次の式は 2 次元マッチングの最適化目的関数です。SGM は複数の 1 次元最適化パスとして実装されます #次の図は、水平方向に沿ったパス最適化関数です ##Census Transform は 8/24 ビット ピクセルをバイナリ シーケンスに変換します。LBP (ローカル バイナリ パターン) と呼ばれる別のバイナリ機能もこれに似ています。ステレオ マッチング アルゴリズムはこの変換に基づいており、マッチングをハミング距離の最小化検索に変換します。 Intel の RealSense は、この技術をベースに 1994 年に設立された両眼視ビジョンのスタートアップ企業を買収し、さらに他のいくつかの中小企業も買収して統合して設立しました。 次の図は CS 変換の概略図です。 PatchMatch は、CS 変換を高速化するアルゴリズムです画像テンプレート マッチングは、オプティカル フローの計算と視差推定に使用されます。 Microsoft Research は、以前に、RGB-D アルゴリズムに基づいて以前に成功した KinectFusion を模倣し、MonoFusion に似た名前で、単眼の携帯電話カメラの 3D 再構成に基づくプロジェクトを実施しました。このプロジェクトでは、深度マップの推定には修正された PatchMatch メソッドが使用されます。 。 基本的な考え方は、視差パラメータと平面パラメータをランダムに初期化し、隣接するピクセル間の情報伝播を通じて推定値を更新することです。 PM アルゴリズムは 5 つのステップに分かれています: #次の図は PM の概略図です。 オンライン校正の詳細。 これは、道路標示(横断歩道)を使用したキャリブレーション手法です。横断歩道の平行線パターンが既知であり、横断歩道を検出してコーナー点を抽出し、横断歩道パターンと路面を計算してマッチングを実現し、ホモグラフィー パラメータを使用して校正パラメータを取得します。 もう 1 つの方法は VO と SLAM に基づいており、より複雑ですが、マップベースの測位を同時に行うことができます。オンライン キャリブレーションに SLAM を使用することは、高頻度の操作には適していません。次の図はそのアルゴリズムのフローチャートです: ステップ 1 ~ 4、ステレオ ビジョン SLAM を通じてグローバル連続マップを取得します。ステップ 5 は、双眼カメラの初期推定を示します。変換、ステップ 6 すべてのステレオ カメラのマップを 1 つのマップに集約し、ステップ 7 ~ 8 で複数のカメラ間のポーズを取得します。 単眼法と同様に、オンライン キャリブレーションは、車線の境界線が平行で道路が平坦であるという仮定、つまり消失点理論を使用して迅速に完了できます。平坦な道路モデル、明確な縦方向の車線の境界線、他のオブジェクトにそれらに平行なエッジがないことを前提としています。運転速度は遅くする必要があり、車線の境界線は連続しており、左右のカメラの両眼構成を比較する必要があります。路面に対する左カメラのエレベーション/ロール角(ヨー/ロール角)が小さいため、初期化された消失点と比較することで両眼外部パラメータのドリフト量を計算できます(オフラインキャリブレーションに関連) (図 5-269). アルゴリズムは、消失点からカメラの仰角/斜角を推定することです。 代表的な双眼自動走行システムの駆動システムをいくつか紹介します。 。 Berta Benz が使用する障害物検出アルゴリズム Stixel は、次の前提に基づいています。シーン内のターゲットは柱として記述され、ターゲットの重心は地面に立っています。 、各ターゲットの上部は下部よりも大きく、深さは大きくなります。次の図 (a ~ d) は、SGM 視差結果がどのように Stixel セグメンテーション結果を生成するかを示しています。 次の図は、Stixel 計算の概略図です。 ) ダイナミクスに基づく計画された自由走行空間の計算 (b) 高さセグメンテーションの属性値 (c) コスト画像 (グレースケール値の反転) (d) 高さセグメンテーション。 #これは、視差融合を行うために深層学習を追加した後の Stixel のブロック図と新しい結果です: #VisLab の初期の両眼障害物アルゴリズムである汎用障害物および車線検出システム (GOLD) を紹介します。 IPM (逆遠近マッピング) に基づいて、車線境界線を検出し、左右の画像の差に基づいて道路上の障害物を計算します。 (a) 左 (b) 右 (c) 再マッピングされた左 (d) 再マッピングされた右 (e) 再マッピングされたビュー間のしきい値とフィルター処理された差 (f) 明るい灰色で、両方のカメラから見える道路エリア。 (a) オリジナル (b) リマップ (c) フィルタリング (d) 拡張 (e) バイナリ化 GOLD システムアーキテクチャ 自動運転競技会 VIAC (VisLab Intercontinental Autonomous Challenge) に参加する VisLab の車両です。双眼カメラのほか、道路分類の補助として車両レーダーにもレーザーが搭載されています。 #これは、両眼障害物検出のフローチャートです。視差推定では、SGM アルゴリズムと SAD に基づく関連アルゴリズムが利用されます。 図 5-274 に示すように、2 つの DSI (視差空間画像) 空間フィルターが後処理に追加されます。1 つはスムージング処理です。もう 1 つは慣性航法 (IMU) に基づく運動軌跡処理です。 障害物検出アルゴリズムはJPL法を採用し、空間レイアウト特性と車両の物理的特性に基づいて障害物をクラスタリングします。物理的特性には、道路の最大高さ (車両)、最小高さ (障害物)、および最大通行可能範囲が含まれます。これらの制約により、図に示すように空間的な円錐台が定義され、クラスタリング プロセス中にすべてがその範囲内の点に収まります。円錐台は障害物として指定されます。 #視差推定アルゴリズムを高速化するために、DSI を分割する方法が採用されています。

#02 オンライン キャリブレーション

03 代表的な双眼自動走行システム

一般に、両眼で障害物を検出する方法は、基本的に視差マップに基づいています。 、道路格差に基づいた多くの方法があります。おそらく、ディープラーニングの急速な発展とコンピューティングプラットフォームの強化により、両眼式の自動運転システムも普及するでしょう。

以上が両眼自動運転システムの普及が難しい理由を技術的な観点からお話しましょう。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。