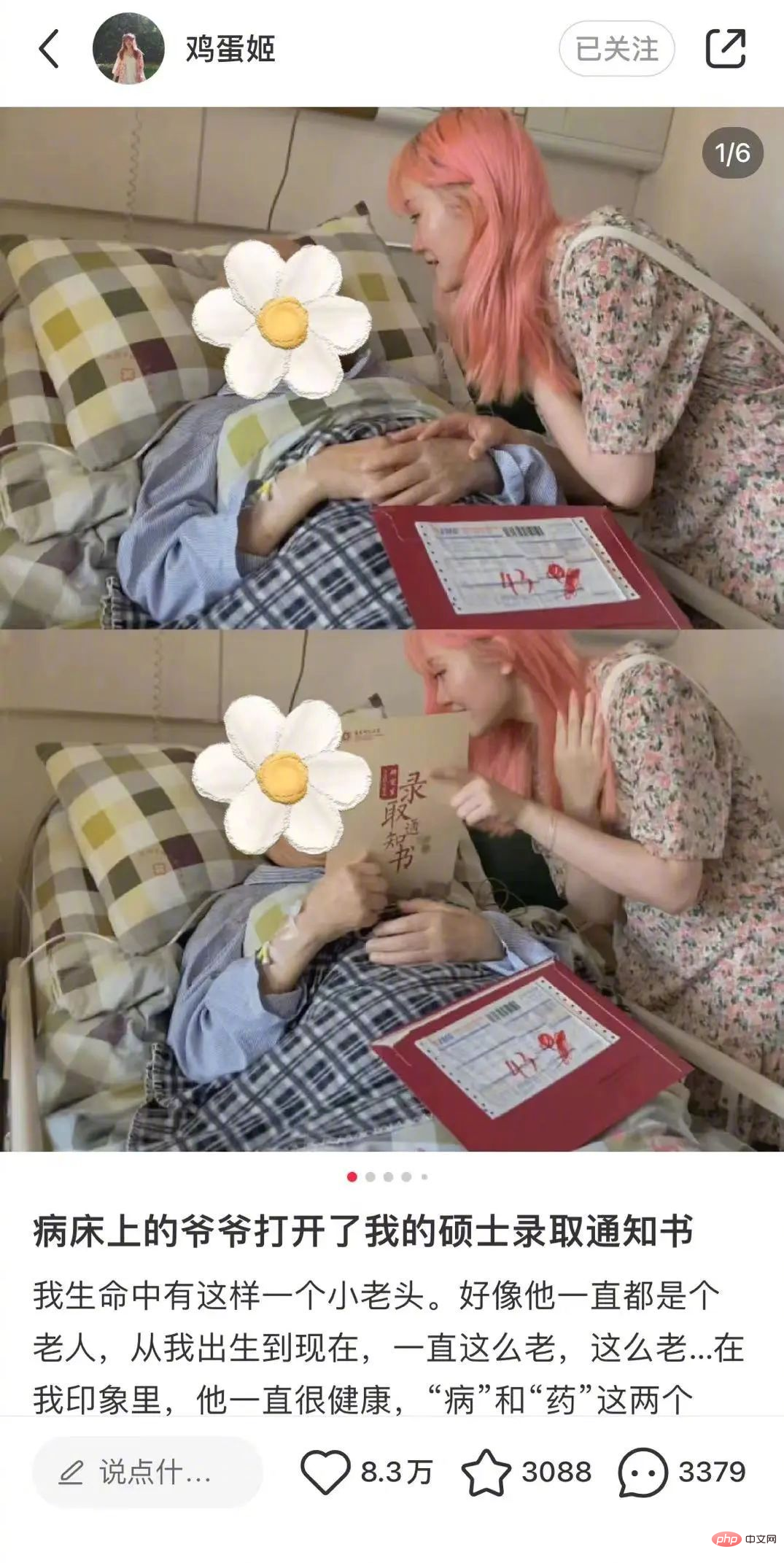

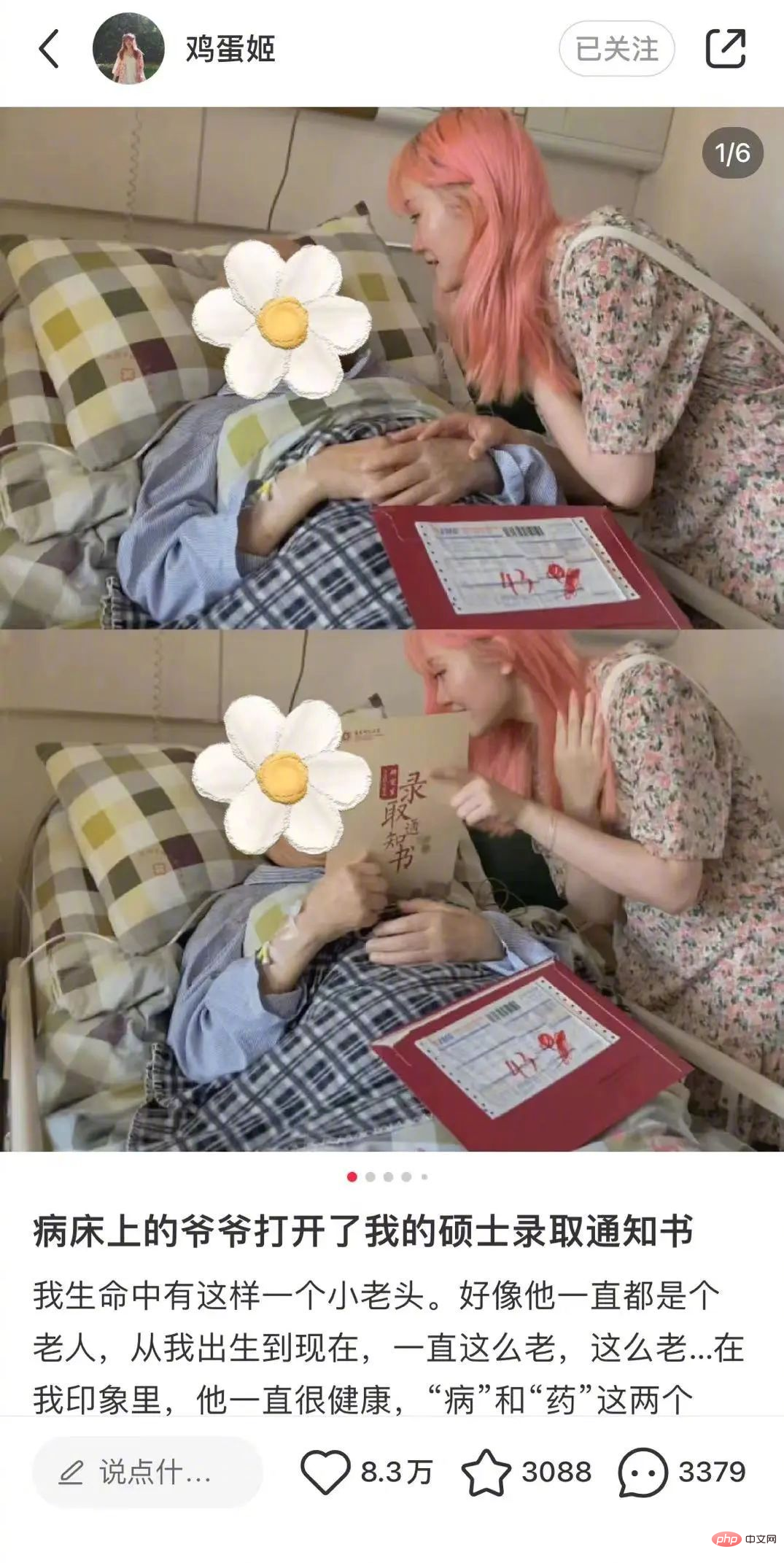

1995 年生まれの少女は、ブログ投稿をオンラインに投稿したことが原因で自殺しました。

##この優しいブログ投稿の公開後、主人公の鄭玲華は多くの噂や虐待に遭遇しました。

髪がピンクだったという理由だけで彼女の身元を疑問視し、「バーテンダー」であるという噂を広めた人もいれば、彼女が「老いも若きも恋人」であり、恋人同士だったという噂を広めた人もいました。祖父の病気を利用して金儲けをしているという噂を広めた「嘘つき」「cha-flow」。

これはとても見苦しいです。多くのメディアがこの噂に反論したが、鄭玲華氏は謝罪を受けておらず、権利を守るために合法的な武器をとったときでも、依然として嫌がらせを受けていた。

結局、鄭玲華さんはうつ病を患い、つい最近その生涯を閉じました。

インターネット上では、このようなことが何度も起きています。インターネットの世界に蔓延するこのような「ひどい言葉」は、人々に嫌悪感を与えるだけでなく、人の命を奪うことさえあります。また、この行為を表す特別な用語、サイバー暴力、または略して「サイバー暴力」とも呼ばれます。

それでは、AI がすでに人間と流暢にコミュニケーションできるようになった今日、AI はサイバー残虐行為を特定する役割を果たすことができるのでしょうか?

2 つの大きな問題を乗り越え、オンラインの暴力的なコメントの識別精度は 90% を超えました。

ほとんどのインターネット プラットフォームはすでに何らかの特別な認識を開始していますが、システム 音声システムですが、これらのシステムのほとんどはキーワードを検出して削除するだけであり、明らかに十分にスマートではありませんが、少し注意することでこれらの制限を回避できます。

実際、オンラインの暴力的な発言を正確に特定するには、次の 2 つのことを行う必要があります:

オンラインの暴力的な発言を文脈に基づいて正確に特定するにはどうすればよいでしょうか? - オンラインの暴力的なコメントを効果的に特定するにはどうすればよいですか?

-

インターネット上のほとんどの文字やメッセージは細分化されており、サイバー暴力は会話の中で発生することが多いため、最初に注意すべき点はサイバー暴力発言の内容です。それは深刻になり、最終的にはマイナスの結果につながります。

2 番目の懸念点は速度です。結局、インターネット環境では処理できないデータが多すぎます。検出に時間がかかると、このシステムは実用的な価値はなく、採用されません。

#英国の研究者チームは、次の研究結果を克服する BiCapsHate と呼ばれる新しい人工知能モデルを開発しました。これら 2 つの課題は、1 月 19 日に「IEEE Transactions on Computational Social Systems」の論文で発表されました。

モデルは 5 つのディープ ニューラル ネットワーク層で構成されており、入力層から始まり、入力テキストを処理し、埋め込み層がテキストを数値表現に埋め込み、次に BiCaps 層が逐次的および言語的コンテキスト表現を学習し、密層が最終分類用のモデルを準備し、最後に出力層が結果を出力します。

BiCaps レイヤーは最も重要なコンポーネントであり、カプセル ネットワークを通じて入力テキストの前後のさまざまな方向のコンテキスト情報を効果的に取得します。手作業で調整された豊富な浅い補助関数と深い補助関数 (Hatebase 辞書を含む) のおかげで、モデルの情報がさらに豊富になります。研究者らは、提案された BiCapsHate モデルの有効性を実証するために、5 つのベンチマーク データセットに対して広範な実験を実施しました。全体的な結果は、BiCapsHate が fBERT、HateBERT、ToxicBERT などの既存の最先端の手法よりも優れていることを示しています。

バランスの取れたデータセットとアンバランスのデータセットで、BiCapsHate はそれぞれ 94% と 92% の f スコア精度を達成しました。

高速で GPU で実行可能

Tarique Anwar は、ヨーク大学のコンピューター サイエンス学部の講師です。この研究。同氏は、オンライン討論では否定的、憎悪的、虐待的な荒らしコメントが生じることが多く、ソーシャルメディアプラットフォーム上の既存のコンテンツモデレーション慣行では制御できないと指摘した。

同氏は、「さらに、オンラインのヘイトスピーチは現実の環境を反映しており、犯罪や暴力につながることもあります。」と述べ、タリク・アンワル氏はまた、オンラインのヘイトスピーチは身体的暴力につながると述べた。暴動の例。

#この問題の解決を支援するために、Tariq Anwar のチームは BiCapsHate を開発することを決定し、非常に良い結果を達成しました。

アンワルが指摘しているように、言語は場合によっては曖昧になることがあります。つまり、ある単語は、ある文脈では肯定的であり、別の文脈では否定的である可能性があります。 HateBERT、有毒BERT、fBERTなどの以前のモデルは、この点で十分ではありませんでした。これらの人工知能はある程度コンテキストを捕捉できますが、タリク・アンワル氏は「これらはまだ十分ではない」と考えています。

BiCapsHate のもう 1 つの利点は、限られたハードウェア リソースを使用して計算を実行できるモデルの機能です。 「(他のモデルは)GPU などのハイエンドのハードウェア リソースや、コンピューティング用のハイエンド システムが必要です」と Tariq Anwar 氏は説明しました。 「対照的に、BiCapsHate は、メモリが 8 GB しかない場合でも、CPU マシンで実行できます。」

この人工知能が開発され、これまでのところテストされているが、英語の音声を分析するようにのみ設計されているため、他の言語にも適応させる必要がある。また、より激しいヘイトスピーチに比べて、穏やかまたは微妙なヘイトトーンの攻撃的な言葉を見つけるのが苦手です。

研究者らは次に、オンラインで憎悪を表明するユーザーの精神的健康を評価する方法を探求したいと考えています。その人が精神的に不安定で、現実世界の人々に対して身体的に暴力を振るう可能性があると懸念される場合は、その可能性を減らすために早期の介入が検討される可能性があります。

以上がAI を使用してキーボード戦士やインターネット荒らしと戦い、オンラインでいじめられている人々の命を守りますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。