ホームページ >テクノロジー周辺機器 >AI >Nature|GPT-4が爆破され、科学者たちは懸念している!

Nature|GPT-4が爆破され、科学者たちは懸念している!

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-28 17:16:071086ブラウズ

GPT-4 の出現は、刺激的でもあり、もどかしいものでもあります。

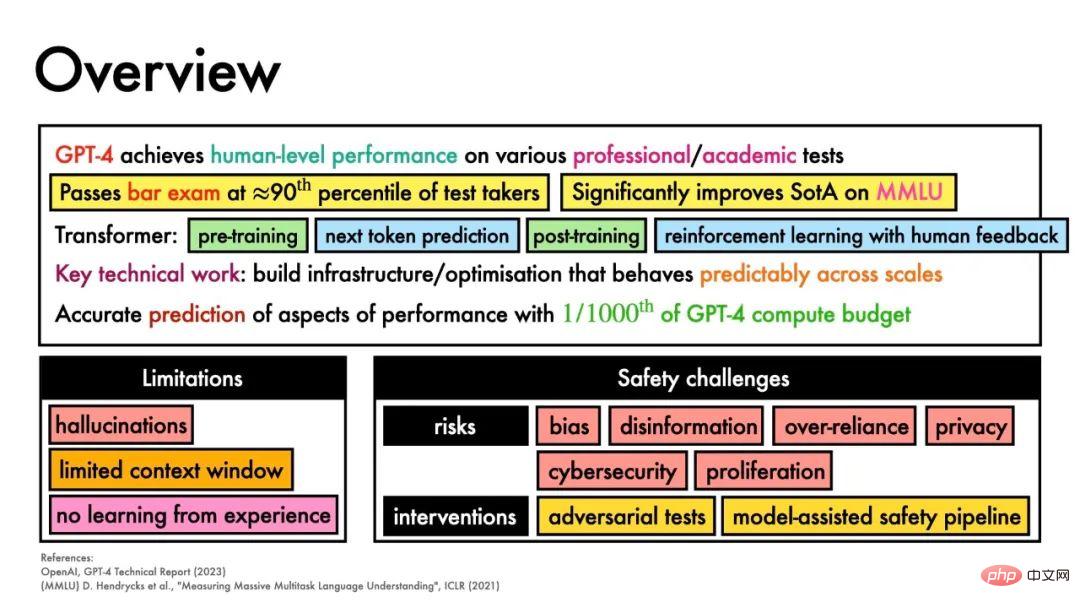

GPT-4 は驚くべき創造性と推論能力を備えていますが、科学者はこのテクノロジーのセキュリティについて懸念を表明しています。

OpenAI は当初の意図に反して GPT-4 をオープンソース化しなかったため、モデルのトレーニング方法とデータを公開しなかったため、実際の動作条件は不明です。

科学界はこれについて非常に不満を抱いています。

オープンソース AI コミュニティ HuggingFace で環境研究を専門とする科学者である Sasha Luccioni 氏は、「OpenAI は研究に基づいて開発を続けることができますが、コミュニティ全体にとっては、これらすべてが重要です」と述べています。

幸いなことに、レッドチームテストがあります

アンドリュー、ロチェスター大学の化学エンジニア 「レッドチーム」のメンバーとして、ホワイトは GPT-4 への特権的アクセス権を持っています。

OpenAI は、レッドチームにお金を払ってプラットフォームをテストし、悪いことをさせようとします。つまり、アンドリュー・ホワイトは過去 6 か月の間に GPT-4 に接触する機会がありました。

彼は、化合物を作るためにどのような化学反応ステップが必要かを GPT-4 に質問し、反応収率を予測して触媒を選択するように依頼しました。

「これまでのバージョンと比較すると、GPT-4 は何の違いもないようで、何もないと思いました。しかし、実際には本当に驚きました。とてもリアルに見えました。ここに原子が生成されるのです。」

しかし、彼がテストを続けて GPT-4 に質問したとき、私がその論文を訪れたとき、状況は劇的に変わりました。

「私たちは、これらのモデルがそれほど素晴らしいものではないかもしれないことに突然気づきました。しかし、それらをバックトラック合成プランナーや計算機などのツールに接続し始めると、突然、新しい機能が追加されました。

これらの能力の出現により、人々は心配し始めました。たとえば、GPT-4 は危険な化学物質の製造を許可する可能性がありますか?

Andrew White は、White のようなレッド チームのテスト入力と OpenAI エンジニアがそれをモデルに入力することで、GPT-4 が危険性、違法または破壊的なコンテンツを生み出すのを阻止できることを示しました。

虚偽の事実

虚偽の情報を出力することも問題です。

ルッチョーニ氏は、GPT-4のようなモデルはまだ幻覚の問題を解決できていない、つまり依然としてしゃべり続ける可能性があると述べた。

「幻覚が多すぎるため、このタイプのモデルに依存することはできません。OpenAI は GPT-4 でセキュリティが向上したと言っていますが、これは依然として問題です。最新バージョンの問題。」

トレーニング用のデータにアクセスできないため、OpenAI のセキュリティ保証はルッチョーニ氏の見解では不十分でした。

「データが何であるかがわかりません。したがって、データを改善することはできません。そのようなモデルを使用して科学を行うことは完全に不可能です。」

GPT-4 がどのように訓練されるかについて、この謎は心理学者のクラウディ・ボッキングも悩ませています: 「人間が監督できない事柄に対して責任を負うことは非常に困難です。」

Luccioni 氏はまた、GPT-4 はトレーニング データによってバイアスがかかると考えており、GPT-4 の背後にあるコードにアクセスしなければ、バイアスがどこから発生しているのかを確認することは不可能であり、それを修正することも不可能です。

倫理的議論

科学者は GPT について常に懸念を抱いてきました。

ChatGPT が立ち上げられたとき、科学者たちはすでに GPT が著者欄に表示されることに反対していました。

#出版社はまた、ChatGPT などの人工知能は科学論文の内容と完全性を評価できないため、研究著者の基準を満たしていないと考えています。 。 責任者。しかし、論文執筆に対する AI の貢献は、著者リストを超えて認識される可能性があります。

さらに、これらの人工知能システムが大手テクノロジー企業の手に渡ることが増えているのではないかという懸念もあります。これらのテクノロジーは科学者によってテストされ、検証される必要があります。

人工知能や GPT-4 などのツールの使用と開発を管理する一連のガイドラインを早急に作成する必要があります。

そのような懸念にもかかわらず、ホワイト氏は、GPT-4 とその将来の反復は科学を揺るがすだろうと述べました。 「インターネットのような大きな変化です。私たちは、論文、データ プログラム、ライブラリ、計算作業、さらにはロボット実験さえも接続できることに気づき始めています。科学者に代わるものではありませんが、いくつかのタスクを完了するのに役立ちます。」

しかし、人工知能テクノロジーを取り巻くあらゆる法律は、開発のペースに追いつくのに苦労しているようです。

4月11日、アムステルダム大学は招待サミットを開催し、ユネスコの科学倫理委員会、経済協力開発機構、経済協力開発機構などの組織の代表者と議論する予定です。世界経済フォーラムではこれらの質問が行われます。

主なトピックには、LLM 出力の手動検査の主張、透明性、完全性、公平性を目的とした科学コミュニティ内での相互責任ルールの確立、信頼性の高い独立した非営利団体が投資を所有することなどが含まれます。透明性の高い大規模言語モデル、AI の利点を受け入れるが、AI の利点と自律性の喪失との間でトレードオフを考慮する必要がある、GPT について関係者 (出版社から倫理学者まで) と議論するよう科学コミュニティを招待するなど。

以上がNature|GPT-4が爆破され、科学者たちは懸念している!の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。