ホームページ >テクノロジー周辺機器 >AI >GoogleとMITが統一フレームワークMAGEを提案:表現学習はMAEを超え、教師なし画像生成は潜在拡散を超える

GoogleとMITが統一フレームワークMAGEを提案:表現学習はMAEを超え、教師なし画像生成は潜在拡散を超える

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-14 20:28:011277ブラウズ

認識と生成は人工知能の分野における 2 つの中心的なタスクであり、これらを統合したシステムに統合できれば、これら 2 つのタスクは補完的になるはずです。実際、自然言語処理では、BERT [1] のようなモデルは高品質のテキストを生成できるだけでなく、テキストから特徴を抽出することもできます。

しかし、コンピューター ビジョンの分野では、現在の画像生成モデルと認識モデルはほとんどが別々にトレーニングされており、これら 2 つのタスクの相乗効果が十分に活用されていません。これは主に、画像生成と画像認識のモデルには通常、本質的な構造上の違いがあるという事実によるものです: 画像生成の入力は低次元の特徴またはノイズであり、出力は高次元の元の画像です。画像認識の入力は高次元の元の画像であり、出力は低次元の特徴です。

最近、MIT と Google Research の研究者は、画像セマンティック マスキングに基づいた表現学習手法を提案しました。これにより、統合フレームワークでの画像生成と表現が初めて実現され、学習され、SOTA パフォーマンスが実現されました。複数のデータセットに対して。研究論文は CVPR 2023 に受理され、関連するコードと事前トレーニングされたモデルはオープンソースになりました。

- 紙のアドレス: https://arxiv.org/abs/2211.09117

- コード アドレス: https://github.com/LTH14/mage

CVPR 2022 以降MAE [2] は、イメージ マスク (MIM) に基づく表現学習方法を提案し、複数のサブタスクで非常に良好な結果を達成しました。 MAE は、最大 75% のマスキング率で、元の画像のセマンティクスに厳密に一致する画像を再構築できるため、ネットワークが画像内の特徴を自己監視しながら学習できるようになります。ただし、図 1 に示すように、MAE によって再構成された画像は元の画像と同様の意味情報を持っていますが、深刻なぼやけや歪みの問題が発生します。同様の問題は、すべての MIM ベースの表現学習方法で発生します。同時に、拡散モデルであれ GAN であれ、現在の生成モデルには高品質の画像特徴を抽出する機能がありません。

#図 1: MAE と MAGE の再構築の比較手法概要

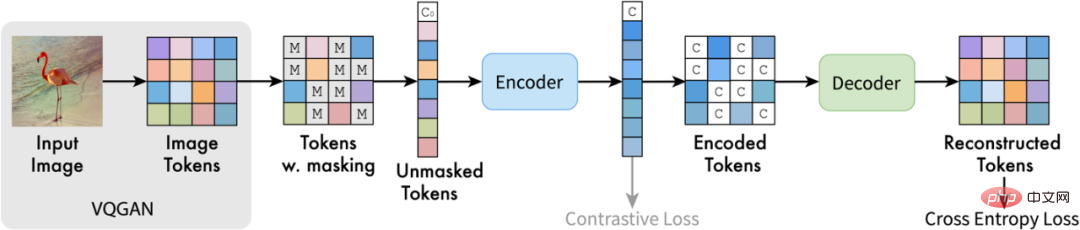

上記の課題に対し、本稿の著者は画像の生成と機能を統一的に実現したMAGE(Masked Generative Encoder)を提案しました。抽出モデル。 MIM が画像に直接作用するマスキング方法とは異なり、MAGE は画像の意味シンボルに基づいたマスクされた画像トークン モデリング方法を提案します。図に示すように、MAGE はまず VQGAN [3] エンコーダを使用して、元の画像を離散的な意味シンボルに変換します。その後、MAGE がランダムにマスクし、トランスフォーマーベースのエンコーダー/デコーダー構造を使用してマスクを再構築し、再構築されたセマンティック シンボルを使用して、VQGAN デコーダーを通じて元の画像を生成できます。トレーニングで異なるマスキング レートを使用することにより、MAGE は生成モデル (ほぼ 100% のマスキング レート) と表現学習 (50% ~ 80% のマスキング レート) の両方をトレーニングできます。図1に示すように、MAGEによって再構成された画像は、元の画像と一致する意味情報を有するだけでなく、生成された画像の多様性と信頼性を同時に保証できます。

実験結果

MAGE は、複数の画像生成および画像認識タスクにおいて SOTA に達したか、それを超えました。

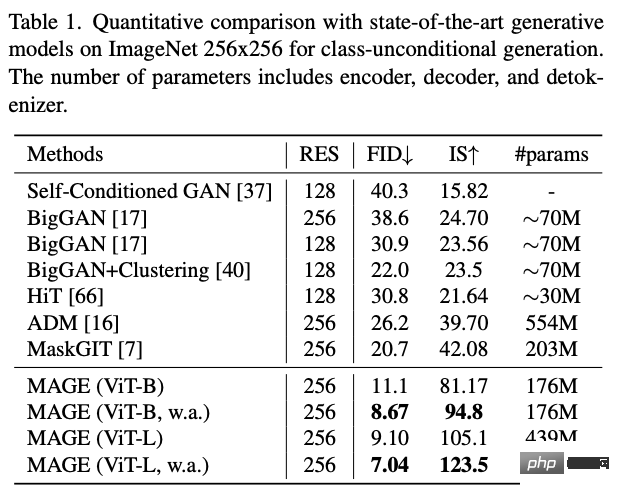

ImageNet の教師なし画像生成タスクでは、MAGE の FID は以前の > 20 から 7.04 に低下し、教師あり画像生成のレベルにさえ達しました (ImageNet 上の教師あり潜在拡散の FID は 3.60) :

#写真 3: MAGE の教師なしイメージ生成の例

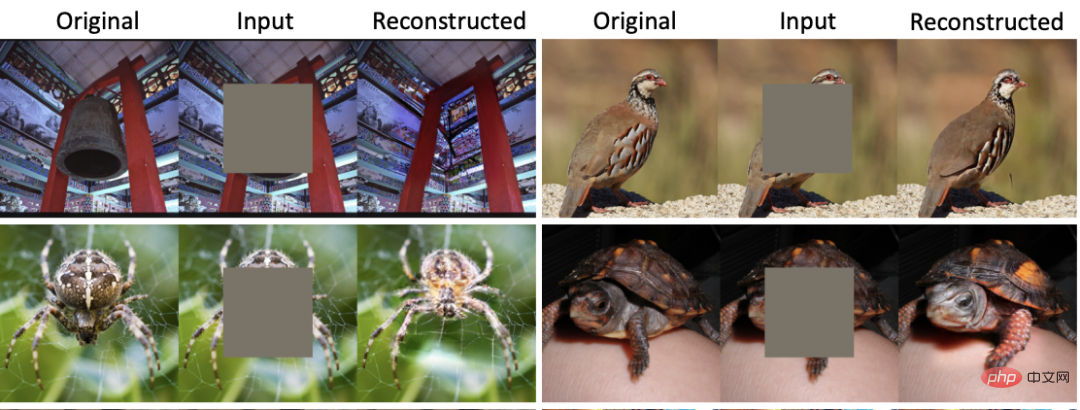

#MAGE は、イメージのインペイント、アウトペイント、アンクロップなどのさまざまなイメージ編集タスクも実行できます。

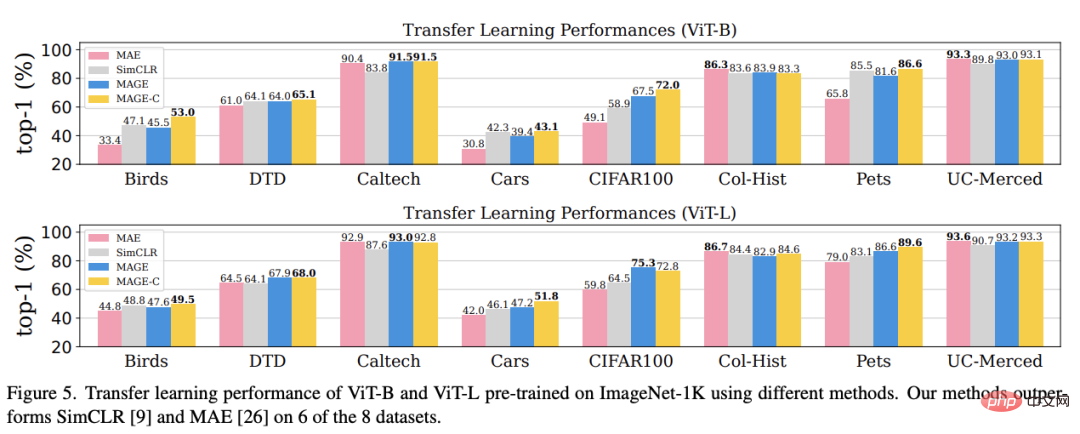

#図 4: MAGE 画像編集サンプル表現学習の観点から見ると、MAGE ImageNet 線形プローブ、少数ショット学習、転移学習などのタスクにおいて、現在の MIM 手法と比較して大幅に改善されており、現在の最適な自己教師あり学習手法のレベルに達するか、それを超える可能性があります。

#結論

以上がGoogleとMITが統一フレームワークMAGEを提案:表現学習はMAEを超え、教師なし画像生成は潜在拡散を超えるの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。